Ich habe diesen Bereich lange genug beobachtet, um den Rhythmus zu erkennen, bevor ich die Melodie verstehe. Dinge erscheinen, sammeln eine Anhängerschaft, verhärten sich zu Erzählungen und werden dann wieder weicher, wenn die Realität zurückdrängt. Privatsphäre, insbesondere, hat sich immer so bewegt – leise versprochen, laut debattiert und nie ganz geklärt.

Wenn etwas wie PIXELS auftaucht – an der Oberfläche eine sanfte, fast entschärfende Art von Erlebnis, Farm-Schleifen, Erkundung, ein Gefühl von Ort – wird es nicht sofort als Teil des älteren Gesprächs über Privatsphäre registriert. Es fühlt sich weicher an als das. Weniger ideologisch. Aber dann verbringst du genug Zeit mit diesen Systemen und fängst an zu bemerken, wie selbst die einfachsten Mechaniken Annahmen über Sichtbarkeit, über das, was geteilt wird und was zurückgehalten wird, tragen.

Und ich schätze, genau dort beginnt das Unbehagen.

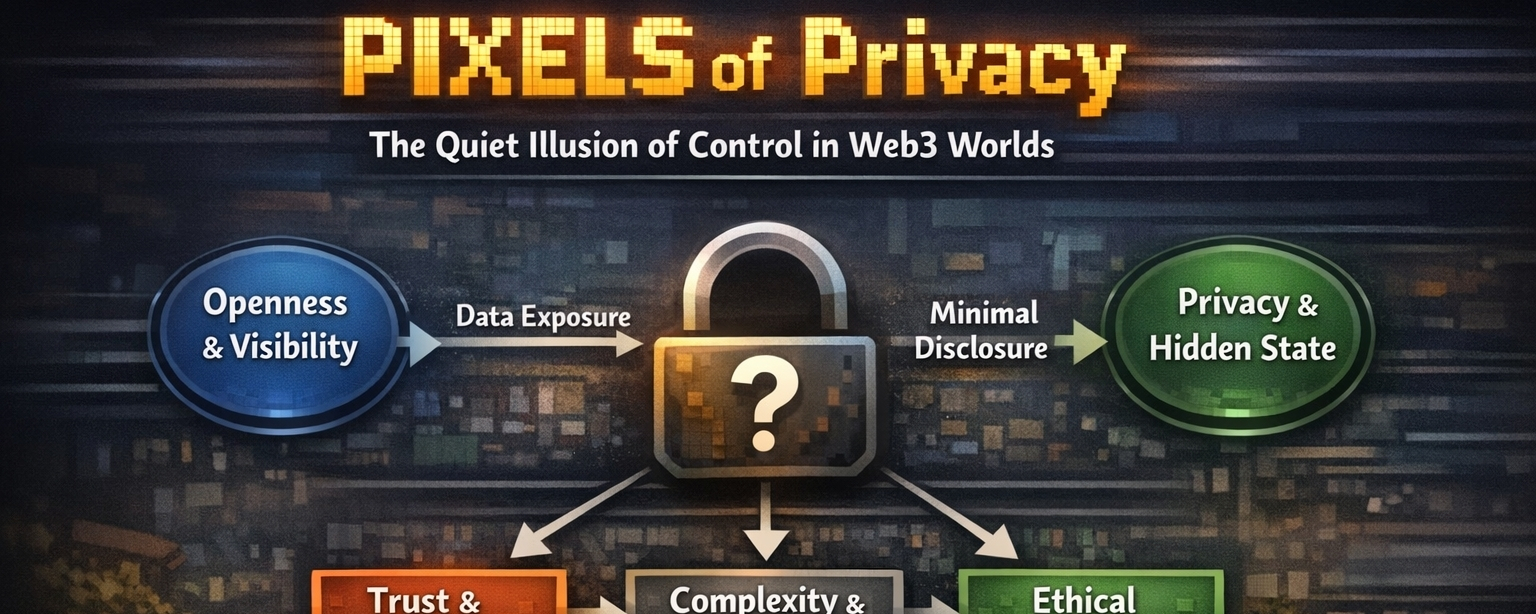

Denn „Privatsphäre“ in Krypto ging nie nur darum, Dinge zu verbergen. Es ging um Kontrolle oder zumindest um die Vorstellung von Kontrolle. Die Fähigkeit zu entscheiden, welche Teile von dir selbst – oder deiner Aktivität – für andere lesbar werden. Aber Systeme, die diese Art von Kontrolle versprechen, neigen dazu, die Verantwortung auf den Benutzer in einer Weise zu verschieben, die nicht immer offensichtlich ist. Du spielst nicht mehr nur ein Spiel oder nutzt ein Netzwerk – du verwaltest die Exposition, selbst wenn du die Dimensionen davon nicht vollständig verstehst.

Ich frage mich manchmal, ob die meisten Menschen das wirklich wollen.

Es gibt einen Unterschied zwischen dem Wunsch, nicht beobachtet zu werden, und dem Wunsch, aktiv zu steuern, was gesehen wird. Das erste ist instinktiv. Das zweite ist Arbeit. Und Arbeit, besonders unsichtbare Arbeit, neigt dazu, leise anzusammeln, bis sie zu Reibung wird.

In etwas wie PIXELS ist die Oberfläche ansprechend. Das ist Teil ihres Reizes. Du pflanzt, du sammelst, du bewegst dich durch eine Welt, die sich beständig, aber nicht erdrückend anfühlt. Doch darunter gibt es immer noch ein Hauptbuch. Es gibt immer noch Rückverfolgbarkeit, auch wenn sie abstrahiert ist. Und wenn Datenschutzfunktionen integriert sind – ob ausdrücklich oder implizit –, beseitigen sie nicht diese Spannung. Sie verschieben sie einfach.

Minimale Offenlegung klingt theoretisch sauber. Teile nur, was notwendig ist. Enthülle nichts mehr. Aber notwendig für wen? Und definiert durch was? Systeme treffen diese Entscheidungen oder rahmen sie zumindest. Governance-Organe passen sie an. Entwickler interpretieren sie. Benutzer erben sie.

Und Erbschaft ist in diesen Systemen eine seltsame Sache. Du erbst Regeln, die du nicht selbst geschrieben hast. Du erbst Annahmen über Vertrauen – was sicher zu offenbaren ist, was nicht. Du erbst eine Art leise Verantwortung, die dir gegebene Privatsphäre nicht missbrauchen, auch wenn dir niemand ausdrücklich beibringt, wo die Grenzen sind.

Es gibt auch das ethische Unbehagen, das sich nie ganz auflöst.

Privatsphäre schützt, ja. Das ist leicht zuzustimmen. Aber sie verschleiert auch. Sie kann gewöhnliche Benutzer vor unnötiger Exposition schützen und gleichzeitig Räume schaffen, in denen schädliches Verhalten schwerer zu erkennen und anzugehen ist. Der gleiche Mechanismus macht beides. Und die Menschen neigen dazu, entweder die eine oder die andere Seite zu betrachten, selten beide gleichzeitig.

Vielleicht, weil es ermüdend ist, beides gleichzeitig zu halten.

Benutzerfreundlichkeit kompliziert es weiter. Systeme, die zur Offenheit tendieren, sind oft einfacher zu durchschauen. Du kannst sehen, was passiert, auch wenn du es nicht vollständig begreifst. Es gibt eine Art von ambienter Beruhigung in der Transparenz, selbst wenn sie unvollkommen ist. Datenschutzorientierte Systeme hingegen verlangen von dir, dem zu vertrauen, was du nicht sehen kannst. Sie ersetzen sichtbare Komplexität durch versteckte Komplexität.

Ich bin mir nicht sicher, ob das ein Handel ist, den die meisten Menschen bewusst eingehen. Es passiert einfach irgendwie…

Und dann gibt es die Leistung. Nicht im technischen Sinne – obwohl das wichtig ist – sondern im erfahrungsmäßigen Sinne. Die subtilen Verzögerungen, die zusätzlichen Schritte, die Momente, in denen sich etwas etwas schwerer anfühlt, als es sollte. Privatsphäre kommt selten umsonst, und selbst wenn die Kosten gering sind, häuft sie sich auf eine Weise an, die schwer zu artikulieren ist. Eine Pause hier. Eine Bestätigung dort. Eine mentale Notiz, dass du innerhalb von Einschränkungen operierst, die du nicht vollständig wahrnimmst.

Es ist leicht, diese als geringfügig abzutun. Aber kleine Reibungen formen das Verhalten im Laufe der Zeit.

Worauf ich immer wieder zurückkomme, ist Vertrauen. Nicht die laute, deklarative Art, die in Whitepapers geschrieben wird, sondern die leise, alltägliche Art. Die Art, bei der du nicht über das System nachdenken musst, weil es deine Aufmerksamkeit nicht fordert. Ironischerweise zieht Privatsphäre oft dieses Vertrauen in den Fokus. Sie fordert dich auf, über das nachzudenken, worüber du lieber nicht nachdenken würdest – wer dich sehen kann, was sie ableiten können, was verborgen bleibt und warum.

Und wenn du erst einmal anfängst, darüber nachzudenken, ist es schwer, aufzuhören.

In Spielen wie PIXELS fühlt sich diese Spannung fast fehl am Platz an. Die Welt lädt dich ein, dich zu entspannen, dich lässig zu engagieren, nicht zu überanalysieren. Aber die zugrunde liegende Infrastruktur erlaubt diese Unschuld nicht vollständig. Sie ist immer noch Teil eines breiteren Ökosystems, in dem Daten Gewicht haben, in dem Handlungen bestehen bleiben, in dem selbst „gelegentliche“ Teilnahme in etwas Permanentes einfließt.

Ich denke nicht, dass das an sich schlecht ist. Es ist einfach… ungelöst.

Governance fügt eine weitere Ebene hinzu, obwohl sie dazu neigt, im Hintergrund zu bleiben, bis etwas bricht. Wer entscheidet, wie viel Privatsphäre genug ist? Wer passt die Schwellenwerte an? Wer darf reagieren, wenn das Gleichgewicht zu weit in eine Richtung kippt? Das sind keine Fragen, die die meisten Benutzer stellen, während sie virtuelle Pflanzen anbauen oder eine Karte erkunden. Aber sie existieren, formen leise die Erfahrung.

Und vielleicht ist das der Punkt, an dem die Dinge am unsichersten erscheinen.

Denn trotz aller Gespräche über Dezentralisierung und Benutzerkontrolle gibt es immer noch eine Struktur, die irgendwo Entscheidungen trifft. Vielleicht ist sie verteilter als zuvor. Vielleicht ist sie im Prozess transparenter. Aber sie ist immer noch da. Und die Datenschutzeinstellungen, Offenlegungsregeln, die Definition dessen, was „sichtbar“ ist — die entstehen nicht von selbst. Sie werden gewählt.

Ich habe aufgehört, saubere Antworten aus diesem Bereich zu erwarten. Privatsphäre vereinfacht die Dinge nicht. Sie ordnet sie neu. Sie verschiebt die Last, verteilt Vertrauen neu, führt neue Arten von Mehrdeutigkeit ein. Sie löst bestimmte Probleme, während sie leise andere schafft, die sich nicht sofort ankündigen.

Und Systeme wie PIXELS, mit ihren sanfteren Kanten und ansprechendem Design, entkommen dem nicht. Wenn überhaupt, macht es den Kontrast schärfer. Je natürlicher sich die Oberfläche anfühlt, desto leichter ist es zu vergessen, was darunter liegt – und desto schwieriger ist es zu entscheiden, ob dieses Vergessen ein Merkmal oder ein Risiko ist.

Ich weiß nicht, ob Benutzer jemals die Systeme, auf die sie hier angewiesen sind, vollständig verstehen werden. Vielleicht müssen sie das nicht. Vielleicht ist Verständnis überbewertet, und was zählt, ist, ob sich die Dinge sicher genug, konsistent genug, fair genug anfühlen.

Oder vielleicht ist das nur eine weitere Erzählung, die wir uns erzählen, wenn die Komplexität zu leise wird, um sie zu bemerken.