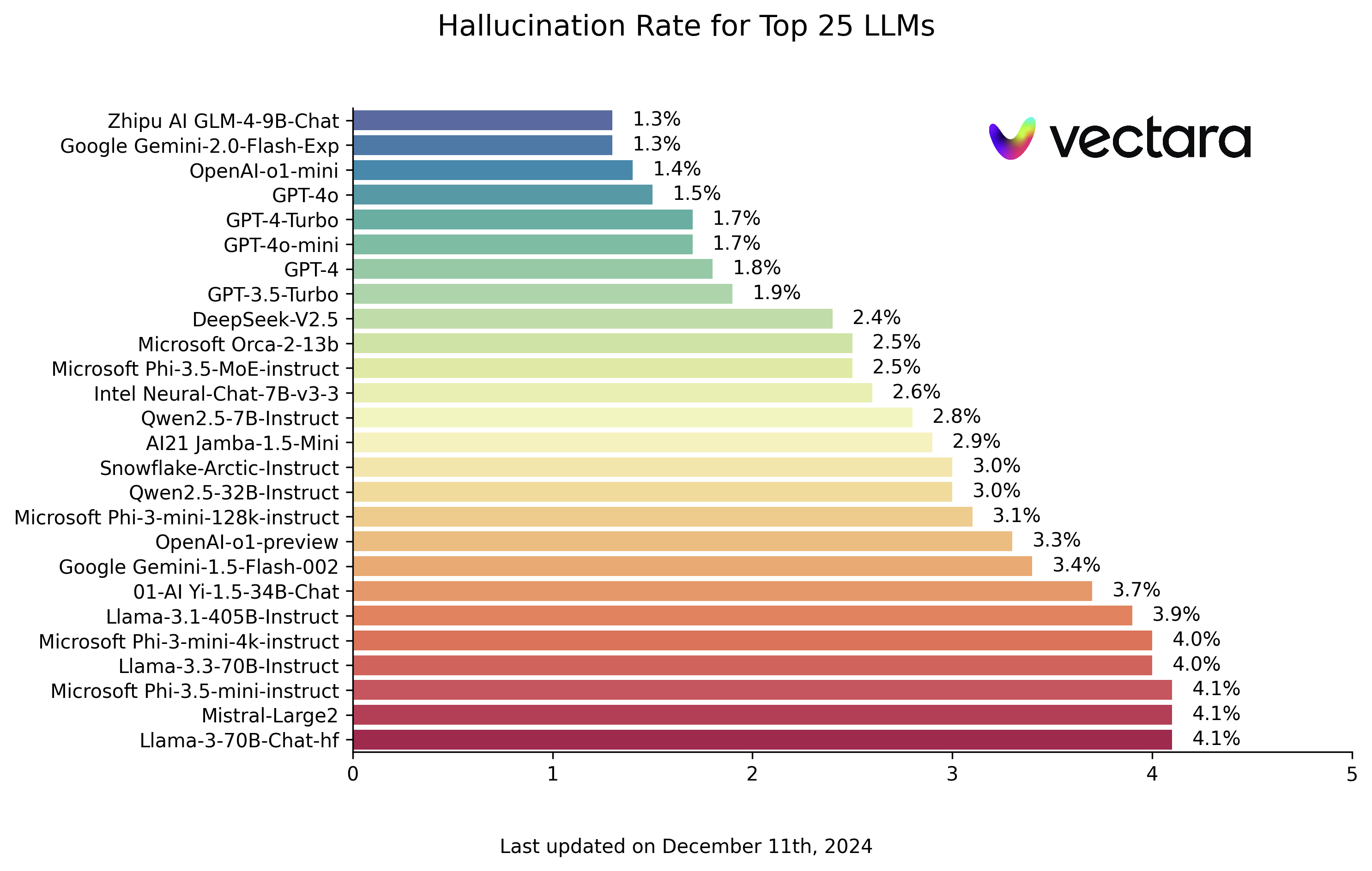

Cuando comencé a usar inteligencia artificial, honestamente estaba muy impresionado. Las respuestas eran rápidas y seguras. Se sentía como si estuviera hablando con un sistema que sabía todo. Pero después de un tiempo, comencé a notar pequeños problemas. A veces las respuestas parecían correctas, pero cuando las revisaba cuidadosamente, no eran completamente ciertas. En algunos casos, la información era completamente incorrecta. Muchos investigadores y expertos en IA también han hablado sobre este problema. Explican que la IA puede crear información falsa que suena real. No estoy diciendo que la IA sea inútil. Estoy diciendo que no es perfecta.

Hoy, estamos viendo que la IA se utiliza en áreas serias como finanzas, atención médica, investigación y sistemas automatizados. Si la IA comete un pequeño error en una conversación casual, puede que no sea un gran problema. Pero si comete un error en consejos médicos o decisiones financieras, el resultado puede ser peligroso. Me queda claro que ser inteligente no es suficiente. La IA también debe ser confiable. Necesitamos una forma de verificar si la información es realmente correcta.

Esta es la razón por la que Mira Network llamó mi atención. No lo miré con emoción al principio. Lo miré con preguntas. ¿Cómo podemos confiar en la IA si sabemos que puede cometer errores? ¿Cómo podemos permitir que la IA trabaje sola en sistemas importantes sin la verificación adecuada? Mira intenta resolver este problema de manera práctica. En lugar de confiar completamente en un modelo de IA, descompone la respuesta en partes más pequeñas. Cada parte se puede verificar por separado. Esta idea me parece simple pero muy poderosa.

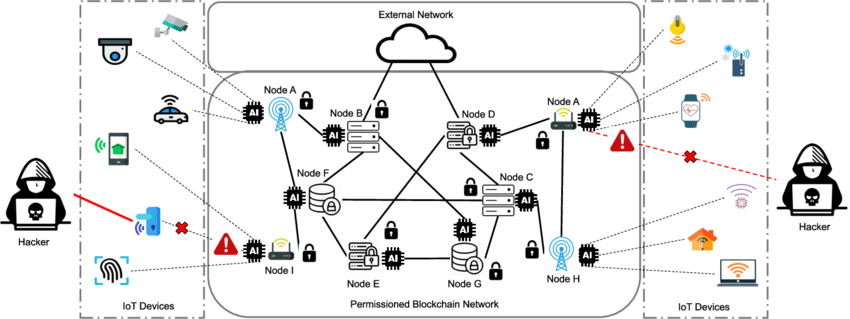

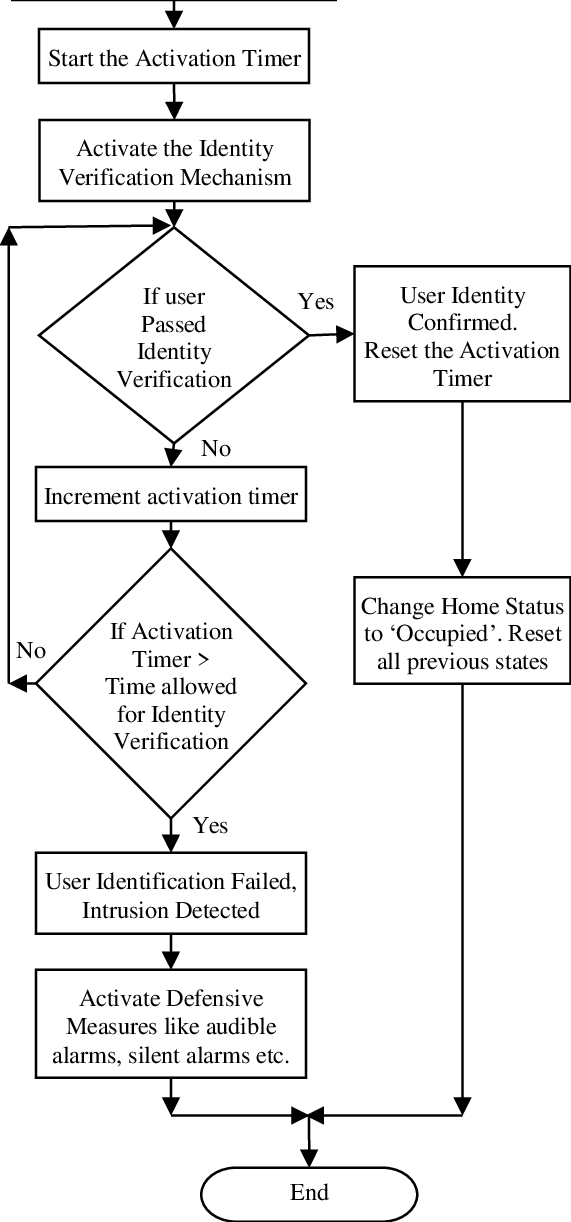

Si un sistema de IA da una respuesta, Mira envía esa respuesta a otros modelos de IA independientes para su verificación. Si muchos modelos están de acuerdo, la confianza aumenta. Si no están de acuerdo, el sistema sabe que algo puede estar mal. Esto se siente natural porque los humanos también verifican la información de la misma manera. No confiamos solo en una fuente. Comparamos diferentes fuentes antes de creer algo importante.

Otra parte importante de Mira es la tecnología blockchain. La blockchain ya ha demostrado que las personas pueden ponerse de acuerdo sobre datos compartidos sin confiar en una autoridad central. Mira utiliza esta idea para verificar la información de la IA. En lugar de aceptar solo lo que dice la IA, la información pasa por una red que la verifica y la confirma. Esto reduce la confianza ciega y aumenta la transparencia.

También encuentro interesante el sistema de incentivos económicos. Las personas que ayudan a verificar información de manera honesta pueden ganar recompensas. Si alguien valida información incorrecta, puede enfrentar pérdidas. Esto crea responsabilidad dentro de la red. Da valor a la verdad. En un mundo donde la desinformación se propaga rápidamente, esto se siente muy importante.

No estoy diciendo que este sistema resolverá todo de la noche a la mañana. Cada red descentralizada tiene desafíos. Debe crecer con cuidado. Debe mantener los costos razonables. Debe asegurarse de que los participantes se mantengan honestos. Estos son problemas reales. Pero lo que respeto es que Mira está tratando de resolver un problema real y serio. La confiabilidad de la IA no es solo una teoría. Es algo con lo que ya estamos lidiando.

Creo que el futuro de la IA dependerá no solo de cuán inteligente se vuelva, sino también de cuán confiable se vuelva. La inteligencia puede impresionar a las personas. La confiabilidad construye confianza a largo plazo. Si queremos que la IA opere de manera segura en áreas importantes, la verificación debe convertirse en una parte central del sistema. Para mí, esa es la razón por la que proyectos como Mira Network se sienten significativos.@Mira - Trust Layer of AI #Mira #mira $MIRA