Un Patrón Extraño Que Noté Mientras Observaba Proyectos de IA

Hoy temprano estaba revisando un montón de publicaciones de campaña de CreatorPad en Binance Square. Normalmente las reviso bastante rápido; la mayoría de los hilos giran en torno a estrategias de cultivo de tokens o ideas de trading a corto plazo. Pero algo sobre las discusiones de Mira seguía repitiéndose en diferentes publicaciones.

Las personas no estaban debatiendo el rendimiento de los modelos o el bombo de la IA. En cambio, estaban hablando sobre la verificación. Al principio, parecía un detalle técnico menor, pero cuanto más leía la documentación y los hilos de la comunidad, más parecía que Mira estaba abordando una brecha estructural en los sistemas de IA descentralizados.

Me di cuenta de que la mayoría de las conversaciones sobre IA en cripto se centran en la computación. Mira está planteando una pregunta diferente: ¿quién confirma que la salida es realmente correcta?

El problema oculto con la IA descentralizada

Los modelos de IA generan respuestas constantemente—análisis, predicciones, resúmenes, decisiones. En entornos centralizados, el problema de confianza es mayormente invisible porque las empresas controlan los modelos y los flujos de datos.

Pero en los sistemas descentralizados, las cosas se complican.

Si un agente de IA está interactuando con contratos inteligentes, analizando propuestas de gobernanza, o generando decisiones financieras, una salida incorrecta no es solo un inconveniente. Puede desencadenar consecuencias reales en la cadena.

Por eso la verificación se vuelve importante.

Cuando comencé a profundizar en la arquitectura de Mira, noté que el protocolo no intenta competir con los proveedores de modelos. En su lugar, está construyendo una capa económica donde participantes independientes validan las salidas de IA antes de que esas salidas se conviertan en entradas de confianza para sistemas descentralizados.

En otras palabras, el protocolo trata la corrección como algo que necesita su propio mercado.

Cómo funciona la capa de verificación de Mira

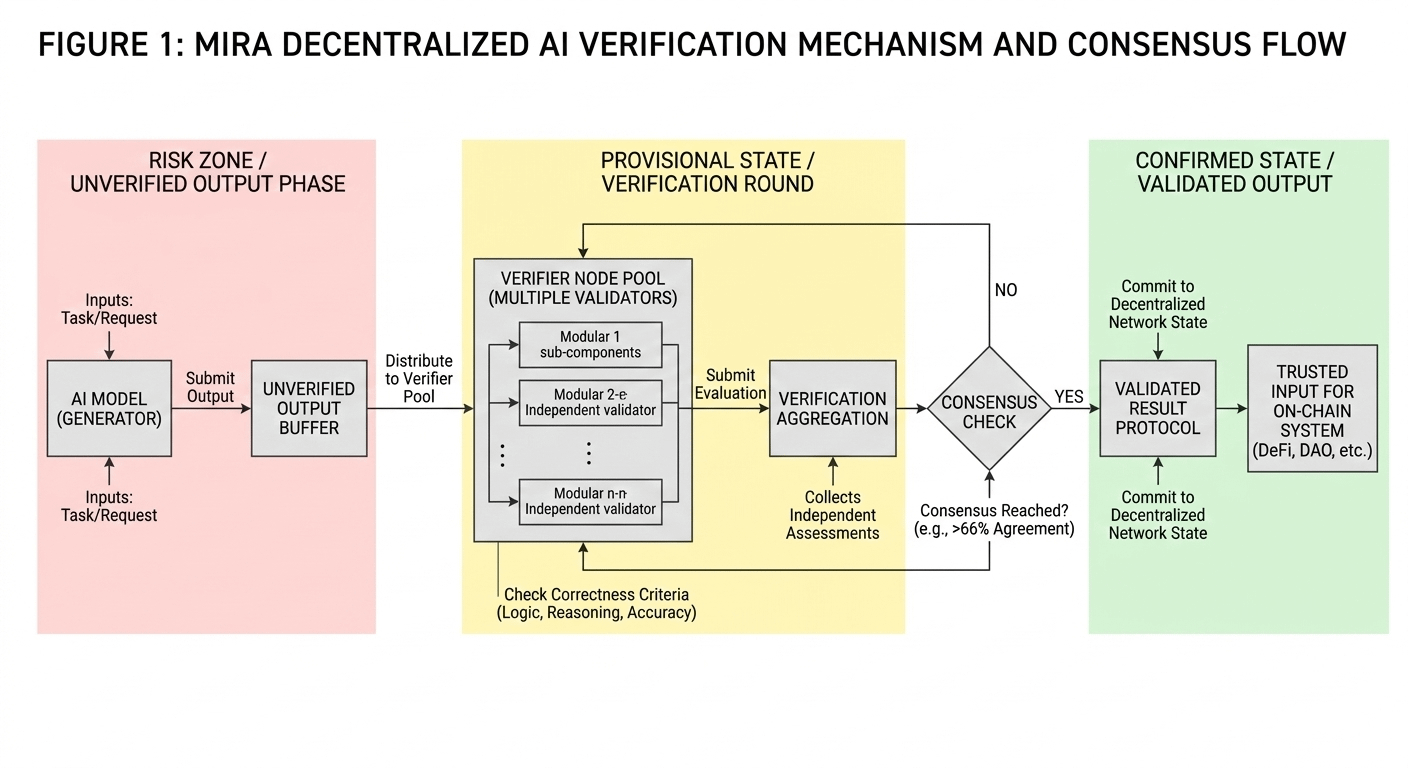

A partir de las descripciones técnicas compartidas en las discusiones de la campaña de CreatorPad, Mira separa el proceso en dos roles diferentes: generadores y verificadores.

Los generadores son modelos de IA que producen respuestas o decisiones. Esa parte es sencilla.

Los verificadores son participantes de la red que evalúan si esas salidas cumplen con criterios de corrección definidos. Múltiples verificadores analizan el mismo resultado, y solo cuando se alcanza el consenso, la salida se acepta por el sistema.

El flujo se ve algo así:

Modelo de IA → Envío de salida → Ronda de verificación → Verificación de consenso → Resultado validado

Mientras leía esta estructura, en realidad dibujé un pequeño diagrama de proceso en mis notas. La línea de producción se asemeja a la lógica de consenso de blockchain, pero en lugar de validar transacciones, está validando conocimiento generado por máquinas.

Esa elección de diseño parece sutil pero importante.

Por qué esto crea una “economía de verificación”

Un detalle que destacó en el diseño del protocolo es la estructura de incentivos.

Los verificadores no son solo voluntarios que chequean salidas. Son participantes económicamente motivados que apuestan reputación o tokens y ganan recompensas por validación precisa.

Eso convierte la verificación en un mercado.

Si los sistemas de IA están produciendo millones de resultados en diferentes redes—análisis de datos, predicciones financieras, percepciones de gobernanza—alguien tiene que evaluar esos resultados. Mira convierte efectivamente ese proceso de evaluación en un servicio distribuido.

Aquí es donde la idea de una economía de verificación comienza a tener sentido. En lugar de confiar en un solo proveedor de IA, las redes pueden depender de validadores independientes para juzgar colectivamente si una respuesta es aceptable.

Es un modelo mental diferente de la infraestructura típica de IA.

Dónde podría ser realmente útil

Mientras leía publicaciones de CreatorPad sobre Mira, seguía pensando en agentes autónomos operando dentro de DeFi.

Imagina un agente de IA escaneando pools de liquidez y sugiriendo ajustes de portafolio. Sin verificación, el sistema confía ciegamente en lo que el modelo produce.

Pero con la estructura de Mira, esas salidas podrían ser revisadas antes de la ejecución.

Los verificadores examinarían el razonamiento, validarían la lógica y aprobarían o rechazarían la decisión antes de que los fondos se muevan en la cadena. Para sistemas automatizados de alto valor, esa capa adicional podría prevenir muchos errores catastróficos.

Otro escenario involucra redes de investigación descentralizadas. El análisis generado por IA podría ser verificado colectivamente antes de ser aceptado como información confiable.

Los compromisos son reales

Por supuesto, el diseño introduce sus propias complicaciones.

Las capas de verificación añaden latencia. Los sistemas de IA a menudo apuntan a la velocidad, mientras que la verificación requiere que múltiples participantes revisen los resultados. Equilibrar esas dos prioridades será complicado.

También está la cuestión de la corrección subjetiva. Algunas salidas de IA son fácticas, otras implican interpretación. Diseñar marcos de evaluación que los verificadores puedan aplicar de manera consistente no será fácil.

Y como cualquier sistema impulsado por incentivos, el protocolo necesita mecanismos sólidos para prevenir la colusión entre validadores.

Así que la idea es prometedora, pero la ejecución determinará si se escala.

Por qué esta discusión sigue apareciendo en CreatorPad

Después de pasar tiempo leyendo los hilos de la campaña de CreatorPad, creo que la razón por la que Mira sigue atrayendo discusión analítica es simple.

No está tratando de construir otro modelo de IA.

En cambio, está explorando algo más fundamental: cómo las redes descentralizadas deciden si la información generada por IA puede ser confiable.

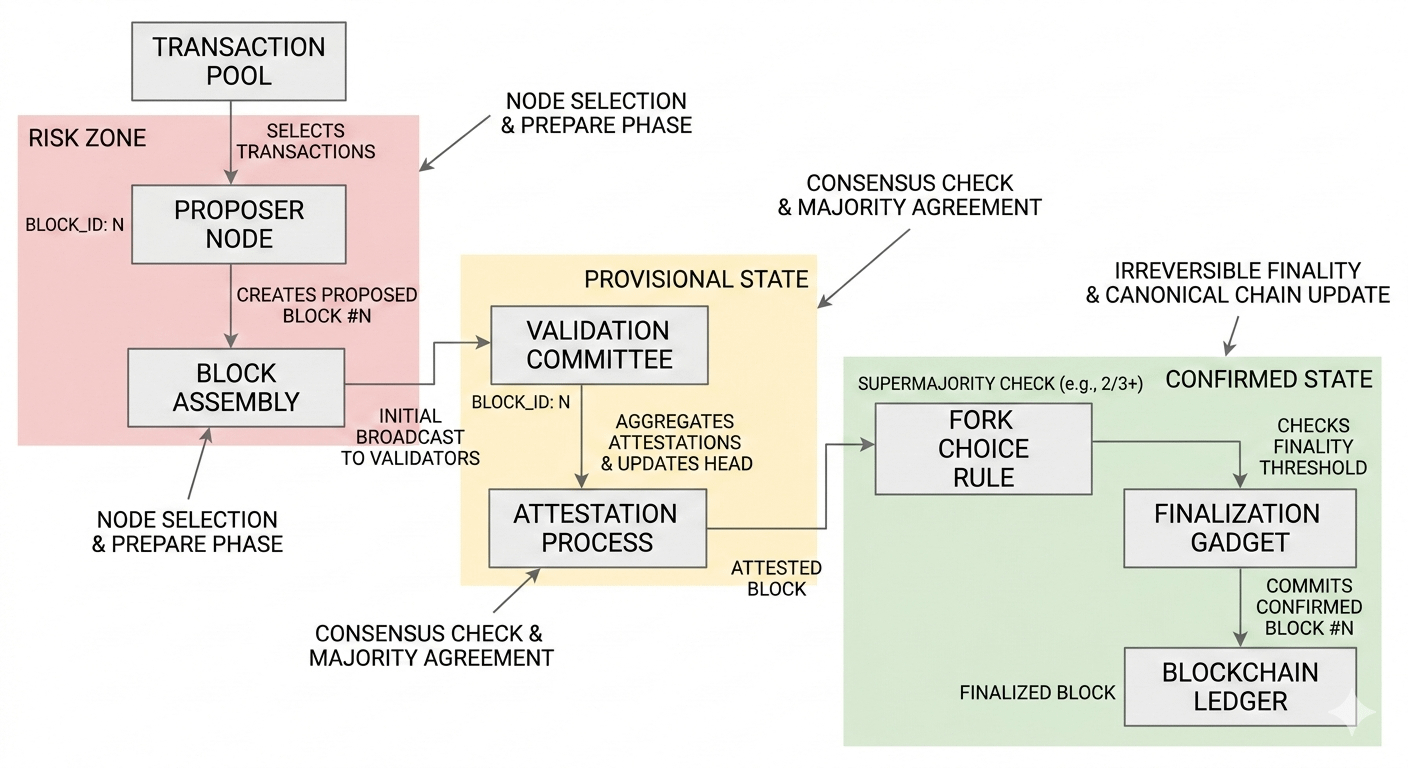

Las blockchains resolvieron la confianza para las transacciones financieras a través del consenso distribuido. Pero los sistemas de IA producen conocimiento, no transacciones.

Mira parece estar experimentando con cómo podría ser el consenso para el razonamiento generado por máquinas.

Y si la IA descentralizada sigue creciendo, capas de verificación como esta podrían terminar siendo tan importantes como las redes de computación de las que todos están hablando hoy.

Sigo observando cómo evoluciona el protocolo, pero la pregunta subyacente que plantea Mira parece más grande que la narrativa típica de una campaña. Se trata de cómo los sistemas descentralizados manejan la verdad en un mundo donde las máquinas están generando constantemente respuestas.

$SIGN $MIRA #Mira #TradingSignals @Mira - Trust Layer of AI #creatorpad #LearnWithFatima #TrendingTopic