Mira Network tiene más sentido cuando se ve no como un intento de crear inteligencia artificial más inteligente, sino como un esfuerzo por hacer que las salidas de la IA sean lo suficientemente confiables como para ser tratadas como entradas verificadas. El verdadero objetivo parece menos sobre mejorar cómo suenan los modelos y más sobre convertir sus respuestas en resultados que lleven responsabilidad, similar a los números financieros auditados o transacciones confirmadas. Cuando examiné por primera vez el concepto, me pareció claro que la ambición es la confiabilidad más que la inteligencia sola.

El proyecto comienza con una observación sencilla. Un solo modelo de IA puede generar respuestas seguras y pulidas mientras sigue siendo incorrecto. Para un uso casual como redactar ideas o hacer una lluvia de ideas, ese error podría causar solo inconvenientes. Pero cuando los sistemas de IA comienzan a activar acciones automatizadas que involucran pagos, permisos, verificaciones de cumplimiento o decisiones de seguridad, incluso errores raros se vuelven críticos. Mira parece estar construido alrededor de aceptar esta incómoda verdad en lugar de ignorarla.

Descomponiendo la Salida de IA en Unidades Verificables

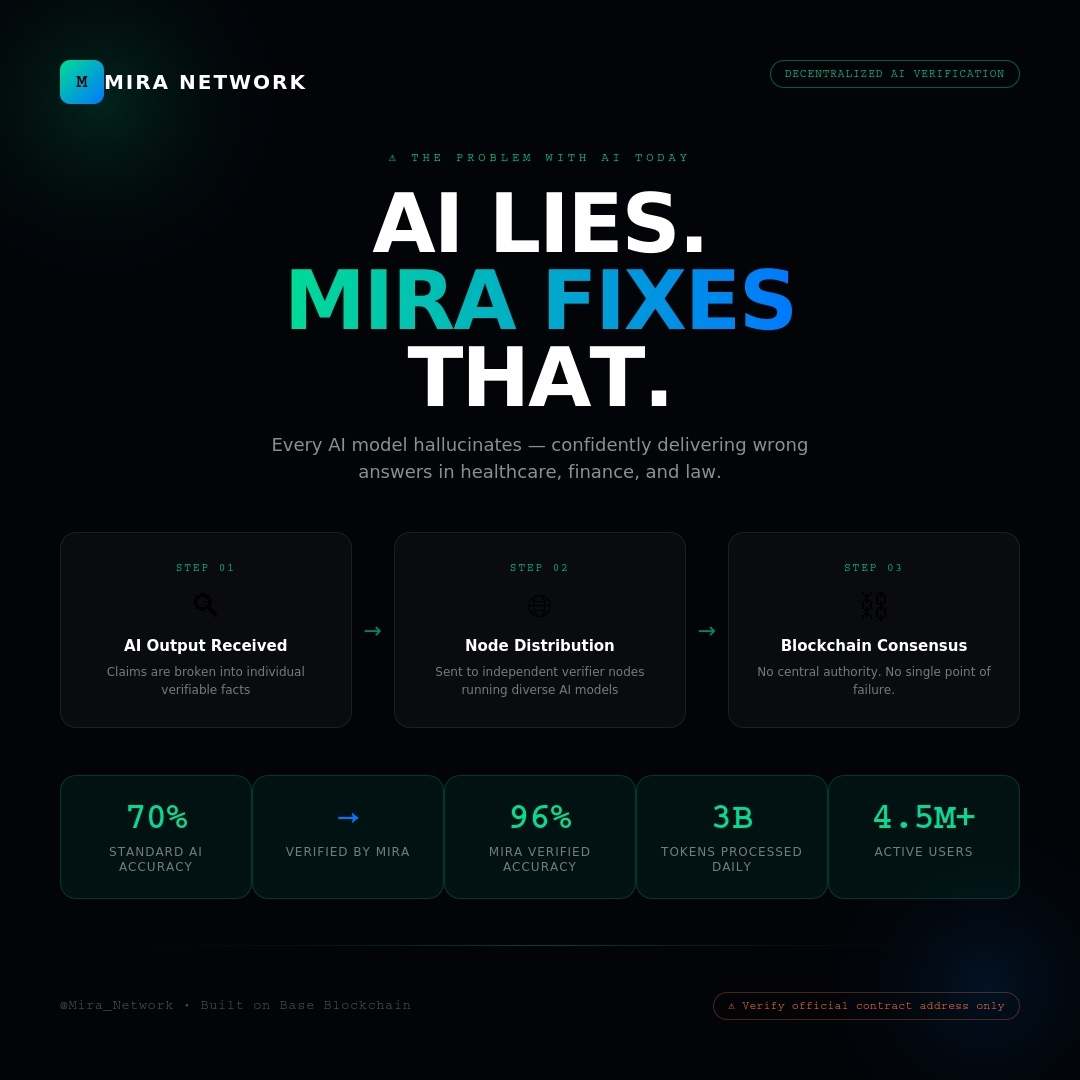

En lugar de confiar en la conclusión de un modelo, Mira introduce un proceso que separa una respuesta de IA en componentes más pequeños conocidos como reclamos. Estos reclamos representan declaraciones específicas que la red puede evaluar independientemente. Noté que este paso cambia todo porque una vez que el lenguaje se convierte en reclamos estructurados, el sistema puede enrutarlos para su verificación, desafiarlos, comparar resultados y, eventualmente, llegar a un resultado verificado.

Esta etapa de descomposición tiene más importancia de lo que podría parecer inicialmente. La forma en que se forman los reclamos determina lo que realmente se puede verificar y cuán costoso se vuelve el proceso. Si los reclamos son demasiado amplios, la verificación se convierte en debates vagos sobre respuestas enteras. Si son demasiado estrechos, la verificación se vuelve costosa e ineficiente. La efectividad de Mira depende en gran medida de encontrar un equilibrio donde los reclamos sigan siendo significativos mientras aún sean prácticos de verificar.

Verificación Impulsada por Incentivos en Lugar de Opiniones

Después de que se crean los reclamos, Mira se desplaza hacia un sistema de verificación construido en torno a las consecuencias en lugar de un simple acuerdo. La verificación no se trata como un voto casual, sino como un proceso estructurado económicamente. Los participantes responsables de la verificación deben asumir riesgos, las recompensas están vinculadas a juicios precisos y existen penalizaciones por comportamiento incorrecto o sospechoso. Desde mi perspectiva, esto hace que el sistema se asemeje a un mecanismo de liquidación en lugar de una discusión comunitaria.

La lógica es sencilla. Si los participantes pudieran ganar recompensas sin precisión, el sistema se llenaría rápidamente con contribuciones de bajo esfuerzo. Al adjuntar consecuencias financieras, la red intenta desalentar las conjeturas y fomentar una evaluación cuidadosa. En lugar de depender de la buena voluntad, los incentivos guían el comportamiento hacia resultados confiables.

Múltiples Modelos Independientes para Reducir el Sesgo

Mira también distribuye la verificación a través de múltiples modelos independientes. La idea aquí es evitar depender de un solo sistema que podría tener debilidades ocultas. En entornos del mundo real, los errores a menudo aparecen en patrones. Cuando muchos sistemas dependen de datos de entrenamiento o diseño de modelo similares, tienden a cometer errores similares. Al introducir evaluadores independientes, Mira trata de prevenir que los puntos ciegos compartidos se conviertan en fallos sistémicos.

Veo este enfoque como similar a tener múltiples examinadores que revisan el mismo trabajo en lugar de permitir que un sistema se califique a sí mismo. Las perspectivas independientes crean fricción, y esa fricción puede ayudar a exponer errores antes de que se conviertan en resultados aceptados.

Construyendo un Registro Creciente de Información Verificada

Uno de los aspectos más interesantes aparece después de que se completa la verificación. Con el tiempo, los reclamos verificados pueden acumularse en una colección creciente de resultados comprobados. En lugar de reiniciar la verificación desde cero cada vez, los sistemas futuros podrían referirse a reclamos previamente resueltos. Esto crea una capa de confiabilidad basada no en la verdad filosófica, sino en la historia de verificación documentada.

Esa acumulación importa porque la confiabilidad comienza a acumularse. Cada resultado verificado contribuye a una base reutilizable que reduce el trabajo repetido y fortalece la confianza en futuros procesos. En mi opinión, esto transforma la verificación de una acción temporal en una infraestructura duradera.

Riesgos Ocultos Dentro del Proceso de Verificación

A pesar de los fuertes objetivos de diseño, permanecen varios riesgos específicos del proyecto. Una preocupación importante involucra la formación de reclamos en sí. La entidad o mecanismo responsable de convertir salidas en reclamos decide efectivamente qué preguntas evalúa la red. Incluso con verificación descentralizada, el control sobre la estructura del reclamo puede influir silenciosamente en los resultados. Los reclamos mal enmarcados podrían llevar al sistema hacia conclusiones seguras pero incorrectas.

Otro riesgo involucra la posibilidad de producir certificados de verificación que parecen confiables sin realmente reducir fallos raros pero serios. Los sistemas optimizados para velocidad y acuerdo pueden pasar por alto casos extremos difíciles. Una red de verificación saludable debería mostrar desacuerdo y escalamiento ocasionalmente, especialmente en dominios complejos donde la certeza requiere un esfuerzo adicional. Si todo se verifica demasiado rápido, podría indicar una simplificación excesiva en lugar de fortaleza.

Equilibrio de Privacidad y Enrutamiento de Información

El diseño de la privacidad también juega un papel importante en la arquitectura de Mira. La red describe la división de información para que los verificadores individuales solo vean entradas parciales, con detalles adicionales revelados solo cuando sea necesario. Este enfoque intenta proteger datos sensibles mientras aún permite una evaluación significativa. Sin embargo, equilibrar la privacidad y la precisión es delicado. Muy poco contexto puede llevar a un mal juicio, mientras que demasiada exposición arriesga filtrar información privada.

La forma en que la información fluye a través del sistema, por lo tanto, afecta tanto la seguridad como la calidad de la verificación. No es solo una característica de privacidad, sino un componente estructural que influye en cuán resistente se vuelve la red a la manipulación.

Un sistema que recompensa la precisión

Si tuviera que resumir el proyecto de manera simple, describiría la red Mira como un intento de construir un sistema económico en torno a ser correcto. La precisión se mide reclamo por reclamo, la confiabilidad es comprada por aquellos que necesitan resultados confiables, y las penalizaciones desalientan la participación descuidada. El enfoque no está en prometer una verdad perfecta, sino en crear un proceso donde la verificación se comporte como una infraestructura responsable.

Esa dirección es lo que hace que el proyecto sea realmente convincente para mí. En lugar de depender de la suposición de que la IA generalmente funciona lo suficientemente bien, Mira intenta transformar la verificación en algo medible, auditable y fundamentado económicamente. Al tratar la corrección como un recurso que se puede evaluar y recompensar, el proyecto acerca las salidas de IA a algo en lo que las organizaciones podrían confiar realmente en entornos operativos reales.

@Mira - Trust Layer of AI $MIRA #Mira