Cuanto más uso las herramientas de IA en flujos de trabajo de toma de decisiones reales, menos impresionado estoy por lo pulidas que suenan. La fluidez ya no es rara. Lo que sigue siendo raro es la certeza.

La IA moderna puede escribir de manera persuasiva, resumir eficientemente y construir argumentos lógicos. Pero, ¿te permitirías ejecutar algo irreversible sin revisión? La mayoría de las personas dudan. Esa duda refleja un problema estructural más profundo.

Los modelos de IA generan resultados probabilísticos. Predicen patrones; no verifican inherentemente la verdad. Cuando ocurren errores, a menudo parecen seguros. Eso no es un defecto menor de la interfaz: es una limitación de la arquitectura.

Cuando exploré la Red Mira, lo que destacó no fue un intento de construir un modelo de lenguaje más poderoso. En cambio, el enfoque está en la verificación. Mira se posiciona como una capa descentralizada que evalúa las salidas de la IA antes de que se asuma la confianza.

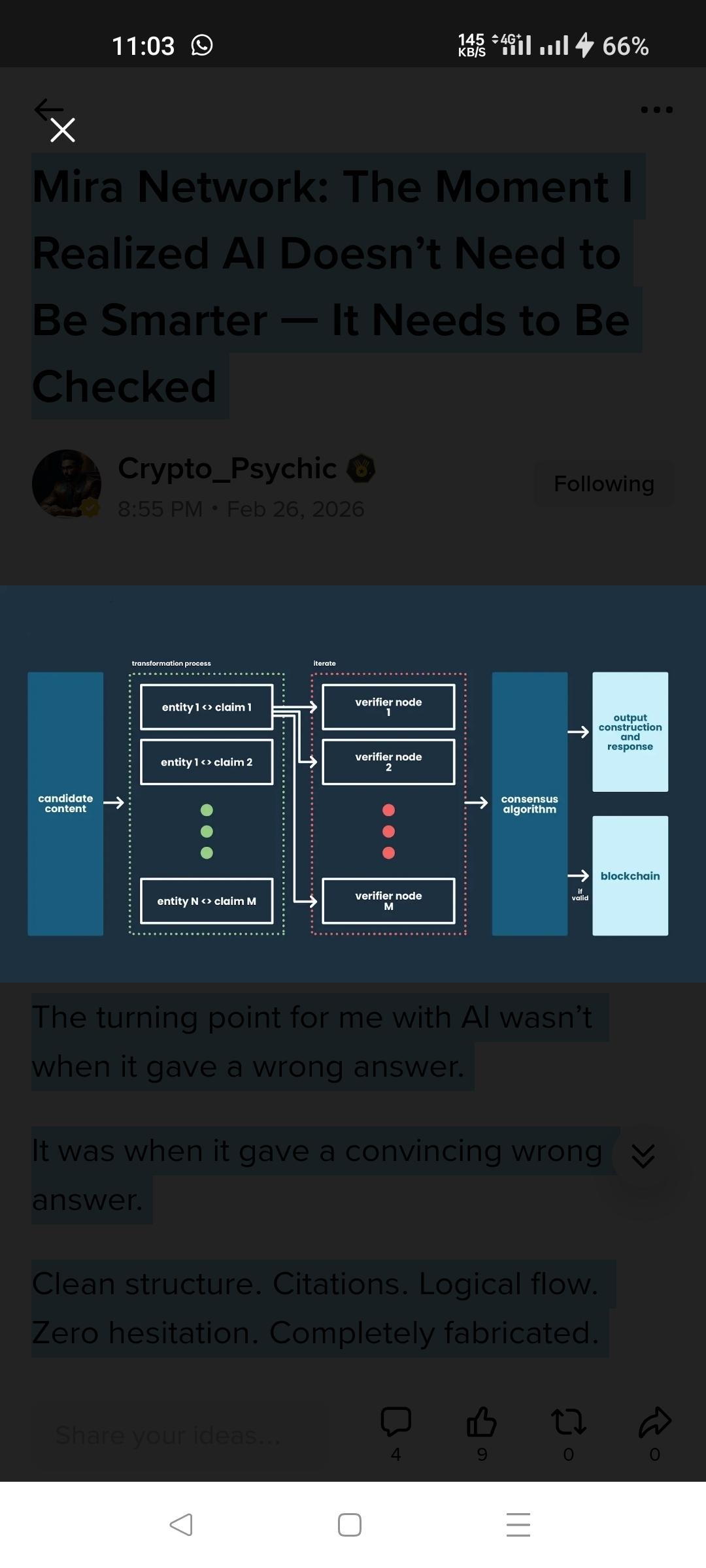

En lugar de tratar una respuesta de IA como una respuesta indivisible, el sistema la descompone en reclamaciones más pequeñas. Estas reclamaciones son luego evaluadas por validadores distribuidos. Se utilizan mecanismos de consenso e incentivos económicos para coordinar los resultados de la validación.

Esto cambia el modelo de confianza. En lugar de depender de la autoridad de un solo proveedor, la validación se vuelve distribuida y alineada con los intereses. Los validadores tienen incentivos para evaluar las reclamaciones cuidadosamente, ya que los resultados les afectan económicamente.

Esa distinción se vuelve importante a medida que los sistemas de IA avanzan hacia una mayor autonomía. En contextos como análisis financiero, flujos de trabajo empresariales o sistemas de ejecución automatizados, 'mayormente precisos' puede no ser suficiente. Las salidas pueden necesitar ser impugnables y auditables.

El diseño de Mira sugiere que las alucinaciones no desaparecerán por completo, y en su lugar construye mecanismos en torno a la verificación. Ese enfoque parece pragmático más que idealista.

Hay preguntas abiertas. La granularidad de las reclamaciones, la alineación de los validadores y los incentivos de coordinación son desafíos de diseño complejos. Los sistemas distribuidos rara vez son simples. Pero la tesis central es clara: la inteligencia por sí sola no garantiza fiabilidad.

A medida que la IA se integra más en sistemas críticos, la infraestructura de responsabilidad puede volverse cada vez más importante.

Mira está explorando esa capa.

No prometiendo una inteligencia perfecta, sino enfocándose en la confianza verificable.

@Mira - Trust Layer of AI #mira $MIRA