Durante mucho tiempo, pensé que la mayor debilidad de la IA era la precisión. Malas respuestas. Alucinaciones. Tonterías confiadas. Pero cuanto más observaba la escalabilidad de los sistemas de IA, más me daba cuenta de que la precisión es solo el problema a nivel superficial. El problema más profundo se encuentra debajo: la IA no sabe cómo coordinar la verdad a gran escala.

Esa realización es lo que eventualmente me atrajo hacia Mira Network — no como un brillante proyecto de IA, sino como una capa faltante en cómo los sistemas inteligentes están comenzando a interactuar con el mundo.

Los sistemas de IA de hoy no existen en aislamiento. Hablan con APIs, ejecutan transacciones, comercian activos, dirigen información y, cada vez más, hablan con otros sistemas de IA. Cuando eso sucede, el costo de un pequeño error no se mantiene pequeño. Se multiplica. Una suposición incorrecta se convierte en la entrada de otro sistema, que se convierte en la acción de otro sistema. Aquí es donde comienzan los fracasos de coordinación — y donde la mayoría de las arquitecturas de IA se desmoronan silenciosamente.

Lo que me sorprendió es que ya hemos resuelto este problema en otros dominios. Los mercados financieros dependen del consenso. Los sistemas distribuidos dependen de la verificación. Las cadenas de bloques dependen de un estado compartido y de la resolución de disputas. Pero ¿IA? La IA fue apresurada directamente de la inteligencia a la autoridad, saltándose completamente la capa de coordinación.

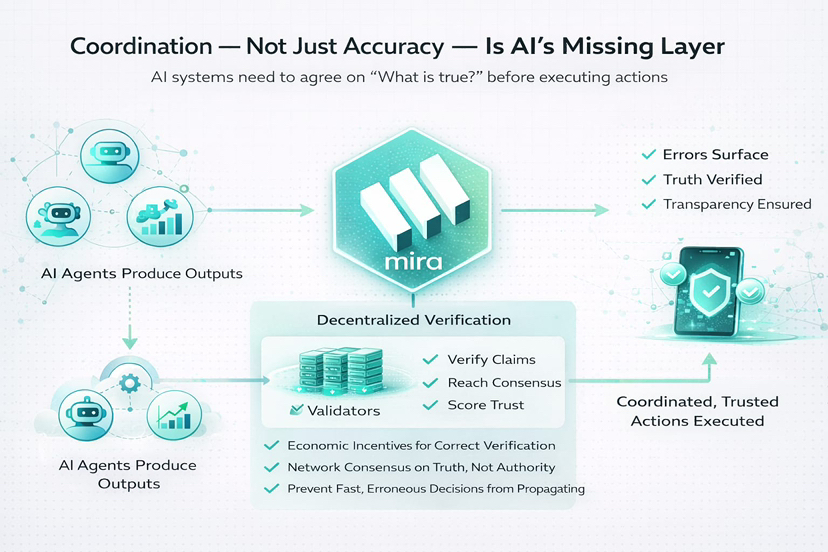

Mira Network se siente como una respuesta a esa brecha. No al hacer que la IA esté 'más alineada' en teoría, sino al forzar la alineación a través de la estructura. En lugar de dejar que las salidas de la IA fluyan libremente a través de los sistemas, Mira introduce fricción donde realmente importa: antes de que las decisiones se propaguen.

La idea central no es ralentizar la IA en todas partes. Es ralentizarla en el punto de confianza. Cuando una IA produce una salida que influirá en otro sistema, esa salida ya no es solo texto. Se convierte en una entrada operativa. Mira lo trata de esa manera: como algo que debe ser verificado, puntuado y acordado antes de que se le permita avanzar.

Lo que encuentro especialmente interesante es cómo Mira reformula los errores. En la mayoría de los sistemas de IA, los errores se tratan como casos extremos. En el diseño de Mira, los errores son esperados. El desacuerdo es esperado. Eso no es una debilidad: es una característica. Cuando múltiples validadores no están de acuerdo en una afirmación, el sistema no lo oculta. Superficia la incertidumbre. Y la incertidumbre es infinitamente más segura que la falsa confianza.

Esto se vuelve crítico a medida que los agentes de IA comienzan a ejecutar acciones en el mundo real. Imagina agentes autónomos negociando precios, reasignando capital o dirigiendo recursos. En esos entornos, el resultado más peligroso no es una respuesta lenta: es una rápida y errónea. La capa de consenso de Mira actúa como un interruptor de circuito. Asegura que las acciones estén respaldadas por un acuerdo compartido, no por una confianza unilateral.

Otra cosa que me destaca es la alineación de incentivos. Mira no depende solo de la buena voluntad o la reputación. Los validadores están económicamente motivados para verificar honestamente y son penalizados por manipulaciones. Eso cambia el comportamiento a gran escala. Los sistemas tienden a convertirse exactamente en lo que recompensan. Mira recompensa la corrección, la transparencia y el trabajo demostrable, no la velocidad por el simple hecho de la velocidad.

Por eso veo a Mira menos como un 'proyecto de IA' y más como infraestructura de coordinación. Está más cerca en espíritu de lo que fue TCP/IP para Internet o lo que fueron los protocolos de consenso para las cadenas de bloques. Invisible cuando funciona. Catastrófico cuando falta.

La incómoda verdad es que la IA seguirá volviéndose más rápida, más barata y más autónoma, esté o no estemos listos. La verdadera pregunta es si construiremos las barandillas que permitan a múltiples sistemas inteligentes coexistir sin amplificar los errores de los demás. La inteligencia sin coordinación no escala. Colapsa.

No creo que el próximo avance en IA provenga de otro lanzamiento de modelo. Creo que vendrá de sistemas que saben cómo discrepar, verificar y converger hacia la verdad sin la supervisión humana. Esa es la dirección hacia la que apunta Mira Network.

A largo plazo, los sistemas de IA más valiosos no serán los que respondan primero. Serán los que respondan juntos.