La mayoría de los sistemas de IA hoy en día son buenos generando respuestas. Son mucho menos confiables al garantizarlas.

Haces una pregunta. El modelo responde con confianza. La estructura suena lógica. La explicación se siente completa. Pero debajo de esa respuesta hay un problema simple: podría estar equivocada.

Esa incertidumbre es la limitación invisible de los sistemas de conocimiento de IA moderna.

La información se genera más rápido de lo que puede ser validada.

Aquí es donde Mira comienza a cambiar la ecuación.

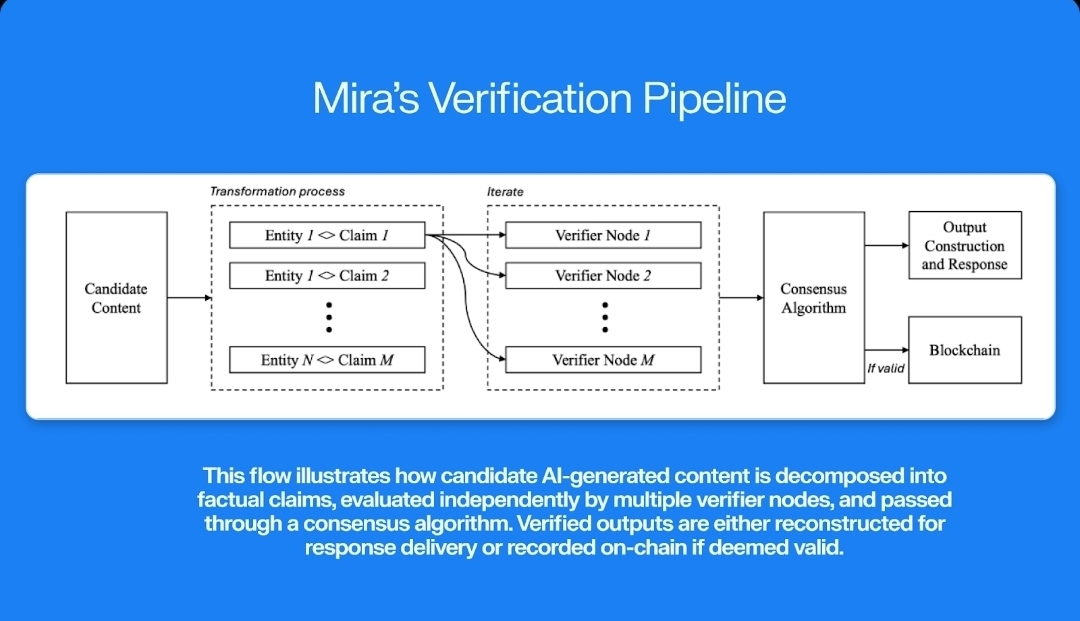

En lugar de tratar las salidas de IA como respuestas terminadas, Mira las trata como afirmaciones que necesitan verificación. El sistema descompone el contenido generado en declaraciones más pequeñas que pueden ser verificadas independientemente a través de una red descentralizada de validadores.

Ese proceso transforma cómo se puede estructurar el conocimiento mismo.

Los grafos de conocimiento tradicionales almacenan relaciones entre entidades. Mapean conexiones entre personas, lugares, eventos y conceptos en una estructura basada en grafos donde los nodos representan entidades y los bordes representan relaciones.

Pero estos grafos suelen asumir que la información dentro de ellos ya es correcta.

En realidad, la mayoría de los grafos de conocimiento modernos están construidos a partir de datos extraídos, entrada humana o tuberías de extracción automatizadas. Los errores pueden propagarse silenciosamente a través del sistema.

Mira introduce un modelo diferente.

Antes de que la información se convierta en parte del grafo, debe pasar por la verificación.

Cada declaración generada por un modelo de IA puede descomponerse en afirmaciones estructuradas. Estas afirmaciones se distribuyen a través de múltiples modelos o validadores independientes, que evalúan su precisión y alcanzan un consenso antes de que sean aceptadas.

Una vez validadas, esas afirmaciones pueden anclarse como puntos de datos confiables dentro de un grafo de conocimiento.

El resultado es un grafo que no solo almacena relaciones.

Almacena relaciones verificadas.

Esa distinción importa más de lo que parece.

En un sistema normal de conocimiento de IA, la información es probabilística. El sistema cree que algo es probable que sea cierto porque ha visto patrones similares en los datos de entrenamiento.

En un grafo de conocimiento verificado, la información se vuelve trazable. Cada nodo y relación puede llevar prueba de que la afirmación ha sido evaluada y acordada por múltiples validadores en la red.

Esto cambia cómo razonan los sistemas de IA.

En lugar de generar respuestas a partir de probabilidades débilmente conectadas, los modelos pueden consultar un mapa estructurado de conocimiento validado.

El razonamiento se vuelve más confiable porque la base en sí ha sido verificada.

Para los agentes de IA autónomos, esto podría ser crítico.

Los agentes que operan de forma independiente necesitan una fuente confiable de información. Si su base de conocimiento contiene hechos alucinados o datos inconsistentes, sus decisiones pueden volverse rápidamente poco fiables.

Un grafo de conocimiento verificado reduce ese riesgo.

Los agentes pueden referirse a afirmaciones que ya han sido validadas por una capa de verificación distribuida en lugar de depender únicamente de sus propias predicciones.

Con el tiempo, esto crea un ciclo de retroalimentación.

La IA genera conocimiento.

La red lo verifica.

Las afirmaciones verificadas expanden el grafo de conocimiento.

Los futuros sistemas de IA consultan ese grafo para razonar de manera más precisa.

El sistema se vuelve progresivamente más confiable a medida que crece.

Esta es la visión más amplia detrás de capas de verificación como Mira.

No solo se trata de corregir alucinaciones.

Pero construir infraestructura para el conocimiento confiable en sí mismo.

Si cada afirmación dentro de un grafo de conocimiento de IA lleva prueba de verificación, la información deja de ser un texto efímero producido por un modelo.

Se convierte en un conocimiento estructurado y auditable.

Y una vez que el conocimiento se vuelve verificable, los sistemas de IA dejan de adivinar tan a menudo.

Comienzan a razonar sobre algo más cercano a la verdad.