Cómo la Red de Nodos Verificadores de Mira Valida los Resultados de IA

@Mira - Capa de Confianza de IA por qué existen los nodos verificadores de Mira en primer lugar

Hace unos meses vi a un asistente de IA producir una nota de riesgo que parecía perfecta a primera vista: lenguaje preciso, estructura limpia, incluso el tono adecuado para una audiencia de cumplimiento. Luego rastreé un número de vuelta a la fuente y me di cuenta de que no estaba “mal” de una manera obvia. Estaba mal de la manera más peligrosa: había llenado silenciosamente un vacío con algo plausible. Sin mensaje de error. Sin bandera de incertidumbre. Solo una frase confiada que se deslizó en el flujo de trabajo como si perteneciera allí.

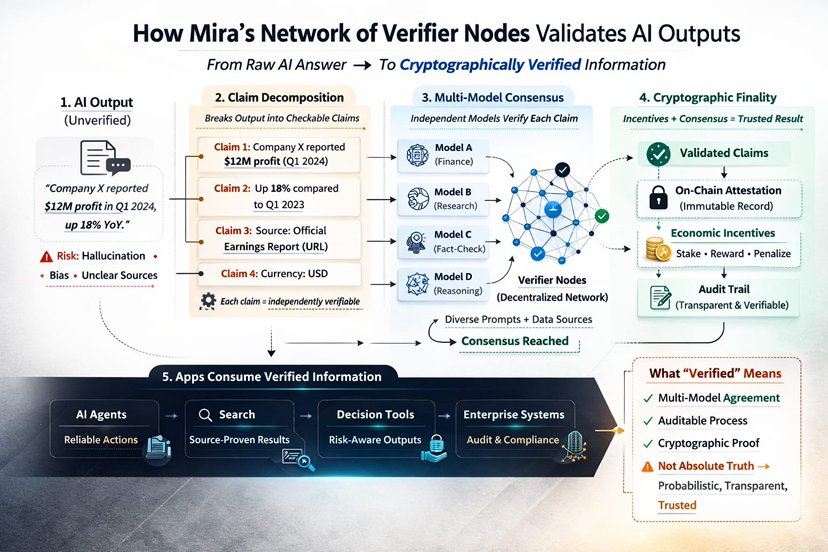

Esa es la brecha que la Red Mira está tratando de abordar con nodos verificadores. En flujos de trabajo de alto riesgo, el problema no es solo la alucinación: es que las salidas de IA a menudo llegan con la apariencia de certeza. “Suena confiable” no es lo mismo que “es verdadero”, y esa diferencia se vuelve inaceptable una vez que los sistemas pasan de redactar texto a desencadenar acciones. Mira enmarca su red como un protocolo de verificación descentralizado diseñado para convertir las salidas de IA en reclamos verificables y validarlos a través de un proceso de consenso, produciendo pruebas auditables de lo que se evaluó y lo que aprobó.

De salida a reclamos verificables: lo que los nodos verificadores están realmente comprobando

La primera idea que busco en cualquier presentación de “verificación de IA” es si intenta verificar un bloque completo de texto a la vez. Porque eso tiende a fallar en la práctica. Cuando pasas una respuesta completa a un verificador, diferentes verificadores se enfocan en diferentes partes. Un modelo verifica una fecha. Otro verifica la esencia general. Un tercero verifica el tono y asume que los hechos están bien. Terminas con un acuerdo que es más como alineación de vibras que validación.

El enfoque de Mira, como se describe en su propia escritura, es transformar las salidas de IA en reclamos más pequeños, verificables de forma independiente que pueden ser validados por una red descentralizada de nodos verificadores. Esa es la dirección correcta conceptualmente, porque la “verificación” solo se vuelve concreta cuando todos están verificando las mismas declaraciones atómicas.

Pero la descomposición de reclamos es difícil de hacer bien, y no lo trato como un problema resuelto. Si divides un párrafo en reclamos demasiado libremente, pierdes las partes peligrosas. Si lo divides demasiado agresivamente, creas un gran número de pequeños controles que aumentan el costo y la latencia. Y hay una falla más sutil: puedes verificar la cosa equivocada. Un reclamo puede ser técnicamente verificable mientras se pierde el verdadero punto de decisión. Así que cuando pienso en nodos verificadores, no solo pienso “¿cómo votan?” pienso “¿qué se les está pidiendo exactamente que juzguen?”

La compensación es sencilla: más estructura y más controles pueden aumentar la garantía, pero también aumentan los costos y crean nuevos bordes para atacar. La intención de diseño de Mira es hacer que la verificación sea sistemática, no ad hoc, pero la calidad de la descomposición del reclamo sigue siendo importante porque define lo que “verdad” incluso significa dentro del protocolo.

Consenso de múltiples modelos: por qué “jueces independientes” importa más que “jueces inteligentes”

En la superficie, la verificación de múltiples modelos suena como un simple truco de conjunto: preguntar a múltiples modelos, tomar la respuesta mayoritaria. En realidad, la palabra clave es independencia. Si todos tus “verificadores” son de la misma familia de modelos, entrenados con datos similares, solicitados de la misma manera y desplegados a través de la misma pila de proveedores, puedes obtener fallas correlacionadas: todos alucinan la misma cita incorrecta, o todos pasan por alto la misma contradicción sutil.

El lenguaje del producto de Mira en torno a la verificación se basa en “múltiples modelos de IA especializados verifican independientemente cada reclamo” y alcanzan una validación basada en consenso. Leo eso como una intención de reducir los modos de falla de un solo modelo: alucinaciones, puntos ciegos, sesgos y la tendencia general de que un modelo esté excesivamente seguro de sus propios errores.

En la práctica, la independencia debería significar variación en al menos tres dimensiones:

El primero es la diversidad del modelo—diferentes familias o proveedores, no solo diferentes configuraciones de temperatura. El segundo es la diversidad de avisos—diferentes formas de enmarcar la pregunta de verificación para que no agrades a todos los verificadores en el mismo camino de razonamiento. El tercero es la diversidad de contexto—controlando cuidadosamente lo que cada verificador ve para que no todos se anclen en el mismo fragmento engañoso.

Aquí es donde importa una postura “sin confianza”. Mira se enmarca en torno a eliminar puntos centrales de arbitraje confiando en nodos de verificación descentralizados en lugar de una única entidad actuando como juez y jurado. Eso es atractivo, pero también eleva el estándar: necesitas el diseño de la red—selección, ponderación, incentivos—para mantener la independencia real en lugar de cosmética.

Finalidad económica y criptográfica: credibilidad que no depende de las vibras

Soy escéptico de los sistemas que dicen: “Confía en nosotros, tenemos una reputación.” La reputación es útil, pero también es social y reversible. Lo que quiero, especialmente para las salidas generadas por máquinas, es algo más cercano a la finalización: un resultado es creíble porque el proceso es auditable y costoso de falsificar.

El marco de Mira enfatiza la auditoría “desde la entrada hasta el consenso”, y proporciona certificados auditables para salidas validadas. Ese es el lado criptográfico de la historia: puedes inspeccionar lo que se verificó y cómo el sistema llegó al resultado, en lugar de tratar la verificación como una caja negra.

Luego está la parte económica. En la documentación relacionada con MiCA de Mira en su propio sitio, se describe que la red utiliza un token que permite la participación en el proceso de verificación de la red; los operadores de nodos que ejecutan modelos de IA para verificación “tendrán que participar” para contribuir a la seguridad validando transacciones y proponiendo nuevos bloques. El mismo documento también describe la gobernanza basada en tokens y los pagos en tokens por acceso a la API.

El punto de los incentivos, en teoría, es simple: la verificación honesta debería ser recompensada, y el comportamiento deshonesto o de bajo esfuerzo debería ser costoso. Pero mantengo mi escepticismo. Los incentivos pueden ser manipulados. Si las recompensas están atadas a “acordar con el consenso”, puedes obtener conformidad en lugar de verdad. Si las penalizaciones son débiles o la aplicación es poco clara, obtienes validadores perezosos que aprueban las salidas sin cuestionar. La verificación es tan buena como las reglas, los participantes y la superficie de ataque que esas reglas crean.

Información totalmente verificada: la parte que realmente les importa a los constructores

Muchos proyectos se quedan atascados a nivel de eslogan—“IA verificada”—y nunca lanzan el flujo de trabajo que lo hace real. Si quieres que los desarrolladores confíen en “información verificada”, necesitas más que teoría del consenso. Necesitas plomería.

Como mínimo, necesitas un flujo que tome una salida, la descomponga en reclamos, ejecute verificación a través de múltiples modelos, agregue resultados, produzca atestaciones y exponga una interfaz limpia para que las aplicaciones puedan consumir el resultado verificado sin reimplementar todo el sistema.

La propia página de producto “Mira Verify” de Mira describe un camino de API donde puedes “verificar todo”, luego “auditar todo”, con certificados atados al proceso de verificación y la verificación de múltiples modelos alcanzando consenso. Por separado, la documentación del SDK de Mira describe una interfaz unificada para integrar múltiples modelos de lenguaje con enrutamiento, balanceo de carga y gestión de flujos—más una superficie de desarrollador de capa de aplicación que un artefacto de investigación puro.

Desde la perspectiva de un constructor, lo que quiero es: clara procedencia, auditabilidad, pasos de verificación reproducibles y composabilidad en agentes, búsqueda y herramientas de soporte de decisiones. No porque suene impresionante, sino porque es la diferencia entre “una demostración que parece segura” y “un sistema que puedes explicar a un equipo de riesgo cuando algo sale mal.”

Requisitos de rendimiento: costo, latencia y rendimiento no negocian

La verificación no es gratuita. Si involucras múltiples modelos y una capa de consenso, estás pagando por inferencias adicionales, coordinación adicional y cualquier costo adicional que venga de producir artefactos de auditoría. Incluso antes de tocar la mecánica del blockchain, ya has aumentado la computación y el tiempo.

Así que la tensión es inevitable: una mayor garantía generalmente significa un mayor costo y una mayor latencia. Mira tiene que equilibrar “lo suficientemente rápido para ser útil” con “lo suficientemente estricto para ser significativo”, o de lo contrario se convierte en un juguete (demasiado lento/caro) o en teatro (demasiado débil para importar).

La presión del mundo real aparece en lugares aburridos: demanda explosiva, grandes cargas útiles y entradas adversariales. Los estallidos rompen sistemas que suponen un tráfico fluido. Las grandes cargas útiles te obligan a decidir qué verificas frente a lo que simplemente registras. Las entradas adversariales castigan cada regla ambigua. Y una vez que se involucra dinero, las personas optimizarán de manera adversarial.

Si la red de verificadores de Mira va a estar en el bucle para agentes, no solo para informes fuera de línea, el perfil de rendimiento importa tanto como la criptografía.

Incentivos y participación: utilidad sobre narrativa

Las redes descentralizadas solo funcionan cuando la participación es racional. En la propia documentación de cumplimiento de Mira, se enmarca la participación como un mecanismo de verificación, con recompensas por participar y derechos de gobernanza basados en tokens. Ese es un patrón de diseño reconocible en cripto: participar para alinear incentivos, recompensar comportamientos útiles y (en muchos diseños) penalizar comportamientos dañinos.

Pero lo que más me importa es la claridad definicional. ¿Qué significa “verificado” en este sistema? ¿Significa que un reclamo es probable que sea verdadero? ¿Significa que múltiples modelos acordaron? ¿Significa que la red produjo un certificado auditable de que se llevó a cabo algún proceso?

No trates estos como lo mismo. “Verificado” necesita barandas: no es una garantía total, no es un sustituto de las verificaciones de fuente cuando las consecuencias son serias, y no puede hacer que un aviso ambiguo se vuelva de repente preciso. Explicar eso establece las expectativas correctas y ayuda en el lado del cumplimiento.

No trates estos como lo mismo. “Verificado” necesita barandas: no es una garantía total, no es un sustituto de las verificaciones de fuente cuando las consecuencias son serias, y no puede hacer que un aviso ambiguo se vuelva de repente preciso. Explicar eso establece las expectativas correctas y ayuda en el lado del cumplimiento. Si exageras la verificación, entrenas a los usuarios a confiar demasiado en ella.

Riesgos y uso seguro: cómo lo integraría sin engañarme a mí mismo

Incluso con la intención correcta, los riesgos son reales.

Las fallas correlacionadas de los modelos son las primeras: se puede reclamar diversidad, pero no se puede lograr. La inducción adversarial es la segunda: los verificadores pueden ser manipulados, especialmente si el encuadre del reclamo es descuidado. “Teatro de verificación” es el tercero: terminas verificando el formato, la consistencia o la plausibilidad en lugar de la verdad. La gobernanza o la deriva de parámetros es la cuarta: la red cambia lentamente lo que considera válido. La concentración es la quinta: demasiado poder en unos pocos validadores o en unos pocos proveedores de modelos. Y el riesgo de integración es el sexto: los desarrolladores tratan “verificado” como permiso para automatizar decisiones que aún merecen revisión humana.

Mis hábitos de seguridad permanecen aburridos a propósito. Trato las salidas como probabilísticas. Verifico fuentes cuando las apuestas son altas. Comienzo con casos de uso de menor riesgo donde los errores son recuperables. Registro pruebas y atestaciones para que haya un rastro. Y resisto dar a los sistemas más autonomía de la que la verificación puede justificar, incluso si la demostración se ve limpia.

Conclusión: una dirección que coincide con hacia dónde va la IA

No creo que el mundo necesite más IA fluida. Necesita IA que pueda ser responsabilizada. Mira es temprana y lleva un riesgo real de ejecución, pero su dirección de diseño—descomponer salidas en reclamos verificables, validarlos a través del consenso de múltiples modelos y respaldar resultados con artefactos auditables y participación criptoeconómica—apunta a la forma futura correcta.

Cuando imagino la próxima ola de agentes, no los imagino siendo confiables porque son persuasivos. Los imagino siendo confiables porque pueden mostrar su trabajo, probar lo que se verificó y marcar claramente lo que sigue siendo incierto. Si Mira puede hacer eso práctico a gran escala—sin convertir la verificación en teatro—es el tipo de infraestructura que podría cambiar cómo juzgamos la IA: no por confianza, sino por confiabilidad.

\u003ct-108/\u003e\u003cc-109/\u003e\u003cm-110/\u003e