Un análisis en primera persona de por qué la verificación de IA puede convertirse en una de las capas de infraestructura más importantes en la próxima fase de sistemas autónomos.

Idea central

Creo que Mira se vuelve interesante en el momento en que dejamos de tratar la fiabilidad de la IA como un problema de UX y comenzamos a tratarla como infraestructura económica.

Preparado como un análisis en primera persona de formato largo con un enfoque en la verificación de IA, utilidad de tokens, dirección del ecosistema y la tesis de inversión más amplia en torno a sistemas autónomos confiables.

Mira a simple vista

Lo que veo en Mira es una tesis sobre inteligencia verificada: la IA no solo debe generar resultados, debe probar que esos resultados son confiables antes de que los sistemas reales actúen sobre ellos. Esa es la perspectiva que utilicé para este escrito.

Posicionamiento

Mira se describe a sí misma como una capa de confianza para la IA, enfocándose en hacer que las salidas y acciones sean confiables a través de la inteligencia colectiva.

Modelo de verificación

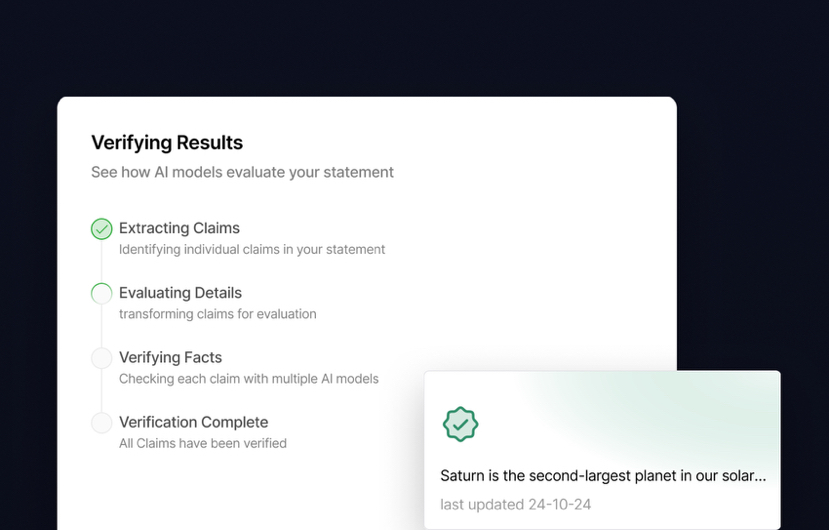

El protocolo descompone el contenido en reclamos verificables de forma independiente y empuja esos reclamos a través de un consenso distribuido entre múltiples modelos y validadores.

Diseño económico

Los validadores apuestan valor, ganan recompensas por participación honesta y pueden ser penalizados por manipulación o verificación consistentemente deficiente.

Dirección del producto

El ecosistema incluye APIs de verificación, certificados auditable y experiencias a nivel de aplicación como Klok.

Rol del token

El $MIRA activo está ligado a la apuesta, gobernanza, recompensas y pagos por acceso a la API en lugar de estar desconectado de la función de la red.

El atractivo práctico, desde mi punto de vista, es que Mira está tratando de empaquetar la verificación como infraestructura utilizable en lugar de como un concepto puramente académico.

El verdadero problema no es el poder de la IA, es la confianza en la IA

Creo que el mercado ha pasado demasiado tiempo celebrando lo que la IA puede generar y no lo suficiente cuestionando lo que la IA realmente puede respaldar. Esa brecha importa más que nunca ahora. Estamos pasando de la IA como asistente de escritura a la IA como capa de ejecución. Los modelos ya están ayudando a las personas a tomar decisiones financieras, resumir información legal, filtrar datos médicos, dirigir flujos de trabajo, escribir código y potenciar agentes cada vez más autónomos. En ese entorno, una respuesta fluida no es lo mismo que una respuesta confiable.

Lo que sigue destacándose para mí es que la mayor debilidad en la IA moderna no es la creatividad. Es la confianza sin prueba. Un modelo puede producir algo que parece pulido, suena inteligente y aún así estar equivocado de una manera que es costosa, peligrosa o imposible de detectar a tiempo. Cuanto más se incruste la IA en sistemas reales, más la verificación deja de ser un bonito complemento y comienza a parecerse a una infraestructura esencial.

Esa es exactamente la razón por la que Mira captó mi atención. No lo veo como solo otra narrativa de IA más-crypto tratando de aprovechar el entusiasmo de ambos lados. Lo veo como un intento de resolver un cuello de botella muy específico: ¿cómo hacemos que las salidas de IA sean lo suficientemente confiables para ser usadas en entornos de mayor riesgo sin obligar a los humanos a cuidar manualmente cada resultado?

Por qué el modelo de Mira se siente diferente para mí

La forma en que entiendo a Mira es simple: está construyendo una capa de verificación que se sitúa entre la generación de IA y la acción en el mundo real. En lugar de pedir a los usuarios que confíen en un modelo, una empresa o un sistema cerrado, Mira toma contenido generado, lo transforma en reclamos verificables más pequeños y envía esos reclamos a través de una verificación distribuida. Diferentes modelos y validadores evalúan el resultado, y se utiliza el consenso para decidir qué se sostiene.

Esa arquitectura importa porque cambia la fuente de confianza. En la mayoría de los productos de IA convencionales, la confianza se basa en la marca. Los usuarios confían en el proveedor, o confían en la interfaz, o confían en la reputación de la familia de modelos. Mira está empujando la confianza hacia el proceso. Si una respuesta puede ser descompuesta, comprobada, desafiada y finalizada a través de una red verificable, entonces la confianza se vuelve menos sobre marketing y más sobre evidencia.

También me gusta que este enfoque es agnóstico al origen. En el documento técnico, el protocolo se enmarca como una forma de verificar la salida generada por la IA transformando contenido complejo en reclamos verificables de forma independiente y coordinando consenso distribuido en torno a ellos. Para mí, esa es una de las partes más fuertes del diseño. No depende de que un modelo omnisciente se vuelva mágicamente perfecto. Acepta que los modelos individuales tienen puntos ciegos y luego intenta construir fiabilidad al forzar múltiples perspectivas a examinar el mismo reclamo.

La idea más fuerte dentro de Mira es la verificación colectiva

Si tuviera que reducir a Mira a una idea central, sería esta: un modelo puede ser impresionante, pero múltiples modelos con incentivos alineados pueden ser más confiables. Eso suena obvio, pero tiene grandes implicaciones. El protocolo se inclina hacia la diversidad en lugar de pretender que un único modelo fronterizo puede resolver alucinaciones, sesgo y fallas de contexto por sí solo.

Aquí es donde el proyecto se vuelve más interesante que un producto normal de conjunto. La tesis de Mira no es simplemente “usar varios modelos”. Es “usar consenso descentralizado para que ningún actor único tenga que definir la verdad para todos.” En otras palabras, el sistema no es solo técnico, también es impulsado por la economía y la gobernanza. Los validadores tienen interés en el juego. Si se comportan deshonestamente o con pereza, pueden ser penalizados. Si participan con precisión, son recompensados.

Eso importa porque la confianza suele desmoronarse cuando los incentivos son débiles. Creo que Mira entiende que la fiabilidad no puede resolverse solo con diseño de interfaz. Si los sistemas autónomos van a ejecutar acciones, entonces la red que asegura esas acciones necesita una dura disciplina económica detrás de ella. En el diseño de Mira, la verificación no es una opinión flotante. Se convierte en una actividad asegurada con consecuencias medibles.

“Para la IA de alto riesgo, la pregunta ya no es si un modelo puede responder. La pregunta es si la respuesta puede sobrevivir a la verificación.”

De la novedad del chatbot a la infraestructura real

Lo que me parece poderoso en esta narrativa es el tiempo. Estamos entrando en la etapa en la que la IA ya no es valiosa solo porque puede chatear, redactar o entretener. Está convirtiéndose en operativa. Los desarrolladores quieren herramientas de IA que puedan investigar, verificar, dirigir decisiones y actuar con menos intervención humana. La propia dirección del producto de Mira refleja ese cambio. Su producto Verify se presenta como una forma de construir IA autónoma con salidas fácticas y confiables, mientras que el ecosistema más amplio incluye aplicaciones como Klok y una API compatible con OpenAI que brinda a los desarrolladores acceso a múltiples modelos líderes.

Los materiales oficiales también apuntan a la tracción del ecosistema. Mira ha dicho que su ecosistema sirve a más de 4.5 millones de usuarios y procesa miles de millones de tokens diariamente. No creo que los números por sí solos hagan que un proyecto sea invertible, pero sí me dicen algo importante: esto no es solo una historia abstracta de un documento técnico. El equipo está tratando de convertir la verificación en algo que los desarrolladores realmente puedan integrar en productos en vivo.

Ese ángulo práctico es importante para la adopción. Muchos proyectos de blockchain suenan visionarios hasta que preguntas qué puede integrar un desarrollador hoy. Al menos Mira parece entender que si la verificación va a importar, debe estar disponible como infraestructura, no solo como ideología. Las APIs, integraciones a nivel de aplicación y certificados de verificación auditable hacen que el concepto se sienta mucho más cercano a un middleware utilizable que a un experimento teórico especulativo.

Dónde la blockchain realmente agrega valor aquí

Generalmente soy cuidadoso cuando un proyecto dice que está combinando IA y blockchain, porque muchos proyectos fuerzan esas dos palabras juntas sin probar por qué ambas son necesarias. En el caso de Mira, creo que el elemento de blockchain realmente tiene un rol claro. No está allí solo por la marca. Está allí para asegurar incentivos, finalizar resultados de verificación y crear un rastro de auditoría sobre cómo se alcanzó un resultado.

Eso importa mucho en sectores donde la explicabilidad y la responsabilidad son innegociables. En finanzas, herramientas legales, atención médica y automatización empresarial, las personas no solo quieren una respuesta. Quieren saber si la respuesta fue verificada, quién la verificó, qué estándar se utilizó y si el proceso puede ser auditado más tarde. El diseño de Mira, especialmente la idea de certificados criptográficos y resultados respaldados por consenso, aborda directamente esa demanda.

Para mí, esa es la diferencia entre “IA en la cadena” como eslogan y la inteligencia verificada como infraestructura. Mira no está tratando simplemente de almacenar la IA en algún lugar de una blockchain. Está tratando de usar consenso descentralizado para convertir salidas inciertas en algo más cercano a la verdad digital defendible. Esa es una propuesta mucho más valiosa si el objetivo es apoyar la ejecución autónoma en sistemas de alto riesgo.

Mi opinión sobre el token y dónde comienza el caso de inversión

Cuando miro el lado del token, no solo pregunto si $MIRA puede tener tendencia. Pregunto si el token está lo suficientemente cerca del motor económico de la red para importar si el uso crece. Basado en la documentación del proyecto y los materiales de listado, el token tiene varias funciones: apuesta para validadores, participación en gobernanza, recompensas y pagos por acceso a la API. Eso es importante porque lo vincula a la seguridad y demanda de servicio en lugar de dejarlo como un ticker decorativo adjunto a una historia técnica.

La estructura de suministro también vale la pena mencionar. Los materiales de listado de Binance establecen el suministro total en 1 mil millones de MIRA, con aproximadamente 191.24 millones en circulación en el listado en septiembre de 2025. Ese tipo de perfil de lanzamiento puede crear atención rápidamente, pero creo que la pregunta más grande es qué sucede después de que se desvanece el brillo del listado. Para mí, el caso a largo plazo depende menos de la óptica del intercambio y más de si la demanda de verificación se convierte en un mercado real.

Esa es la parte a la que sigo volviendo. Si los agentes de IA, copilotos, asistentes empresariales y flujos de trabajo impulsados por máquinas necesitan una capa de confianza antes de poder ser desplegados de manera segura a gran escala, entonces la verificación se convierte en una actividad económica recurrente. Si Mira captura incluso una porción significativa de esa capa, entonces el proyecto deja de ser una idea de nicho y comienza a convertirse en infraestructura con flujos de tarifas, demanda de apuestas y gravedad del ecosistema. Ahí es donde la narrativa del token se vuelve mucho más interesante para mí.

Lo que aún observo con cuidado

Aunque me gusta la tesis, no creo que este espacio obtenga un pase libre. La verificación es difícil y seguirá siendo difícil. El primer desafío es el rendimiento. Cualquier sistema que añada capas de revisión adicionales tiene que probar que la ganancia de fiabilidad vale la latencia y el costo. Si la verificación es demasiado lenta o demasiado cara, los desarrolladores pueden usarla solo en casos de nicho en lugar de hacerla estándar.

El segundo desafío es la educación del mercado. Muchos usuarios aún interactúan con la IA de manera casual, lo que significa que pueden no apreciar de inmediato por qué la verificación es importante hasta que algo salga mal. Mira puede estar temprano de la misma manera que la ciberseguridad estuvo temprano: esencial, pero no totalmente valorada hasta que las fallas se vuelven lo suficientemente dolorosas como para forzar la demanda.

El tercer desafío es la presión competitiva. Una vez que la necesidad de una IA confiable se vuelva obvia, más jugadores de infraestructura se moverán hacia la pila de verificación. Grandes laboratorios de IA pueden intentar internalizar sistemas similares. Los proveedores de middleware empresariales podrían empaquetar sus propias capas de confianza. Así que para mí, la ejecución importa tanto como la visión. Mira tiene un concepto sólido, pero aún necesita defender la distribución, la adopción de desarrolladores y la credibilidad de la red a lo largo del tiempo.

Mi conclusión

Mi opinión honesta es que $MIRA es interesante porque no está persiguiendo la versión más ruidosa de la narrativa de IA. Está apuntando a la capa que falta debajo de ella. Creo que ahí es donde a menudo se encuentran algunas de las oportunidades más valiosas: no en la aplicación más llamativa, sino en la infraestructura que hace que la próxima ola sea utilizable.

Si la IA autónoma realmente se expande de asistentes a agentes, y de agentes a sistemas de ejecución, entonces la confianza se convierte en un mercado por derecho propio. En ese mundo, el ganador no es solo el modelo que puede generar el texto más. Puede ser la red que puede decir al mercado qué salidas merecen ser actuadas. Esa es la razón por la que sigo viendo a Mira como más que una historia de tokens. Lo veo como una apuesta a que la inteligencia verificada se convierta en una capa requerida de la economía digital.

“La IA puede generar. Pero el siguiente verdadero foso puede pertenecer a las redes que pueden verificar.”

“En un mundo que se mueve hacia la ejecución autónoma, la confianza ya no es una característica. Es infraestructura.”

Para mí, esa es la forma más clara de enmarcar el proyecto. Mira está tratando de hacer que la IA sea útil no solo haciéndola más inteligente, sino haciéndola responsable. Y si eso funciona, el mercado direccionable es mucho más grande que una aplicación, un chatbot o una narrativa específica de un ciclo.

Conclusión final

Mi opinión es que #Mira no está tratando de ganar haciendo que la IA sea más ruidosa. Está tratando de hacer que la IA sea lo suficientemente confiable como para ser desplegada donde los errores realmente importan. Si el mercado comienza a valorar la verificación como una capa de servicio recurrente, eso podría convertirse en una categoría mucho más grande de lo que la mayoría de la gente espera hoy.