A menudo veo sistemas de IA automatizados que dependen de su propia inteligencia, pero en el mundo real, los resultados a menudo se desvían de las expectativas. A menudo sucede que cuando un sistema toma decisiones autónomas rápidamente, los errores o comportamientos inesperados aparecen tarde. Es en este momento cuando realmente tiene sentido que la inteligencia del modelo por sí sola no es suficiente, sino que su verificación práctica es necesaria.

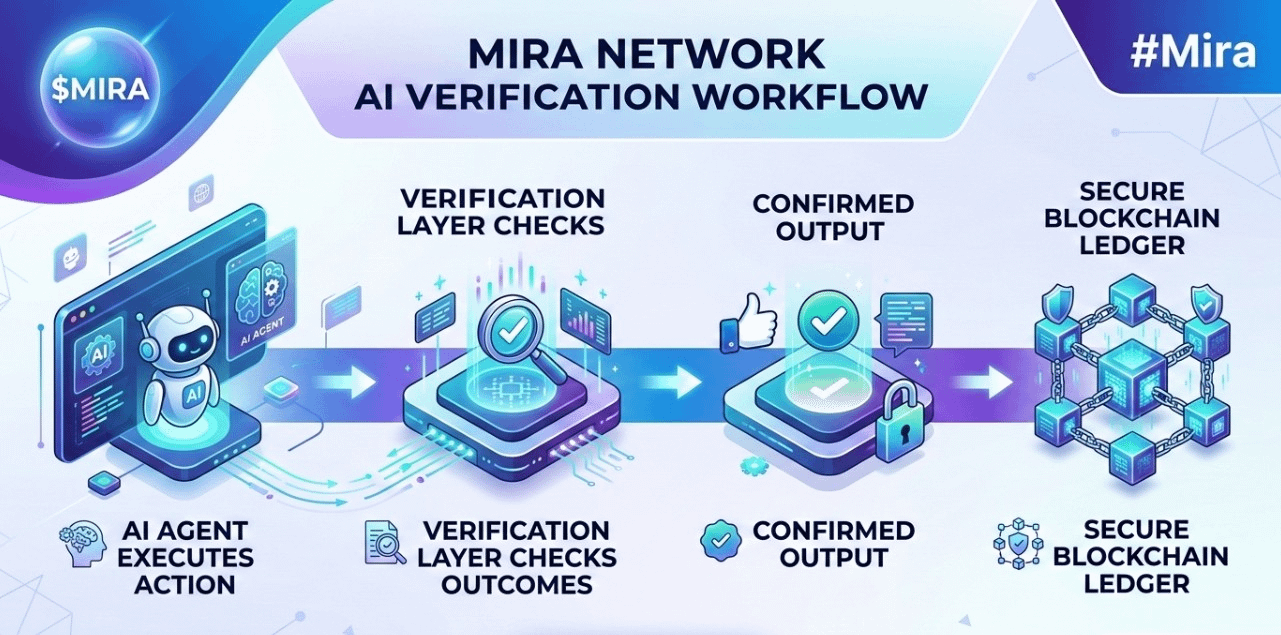

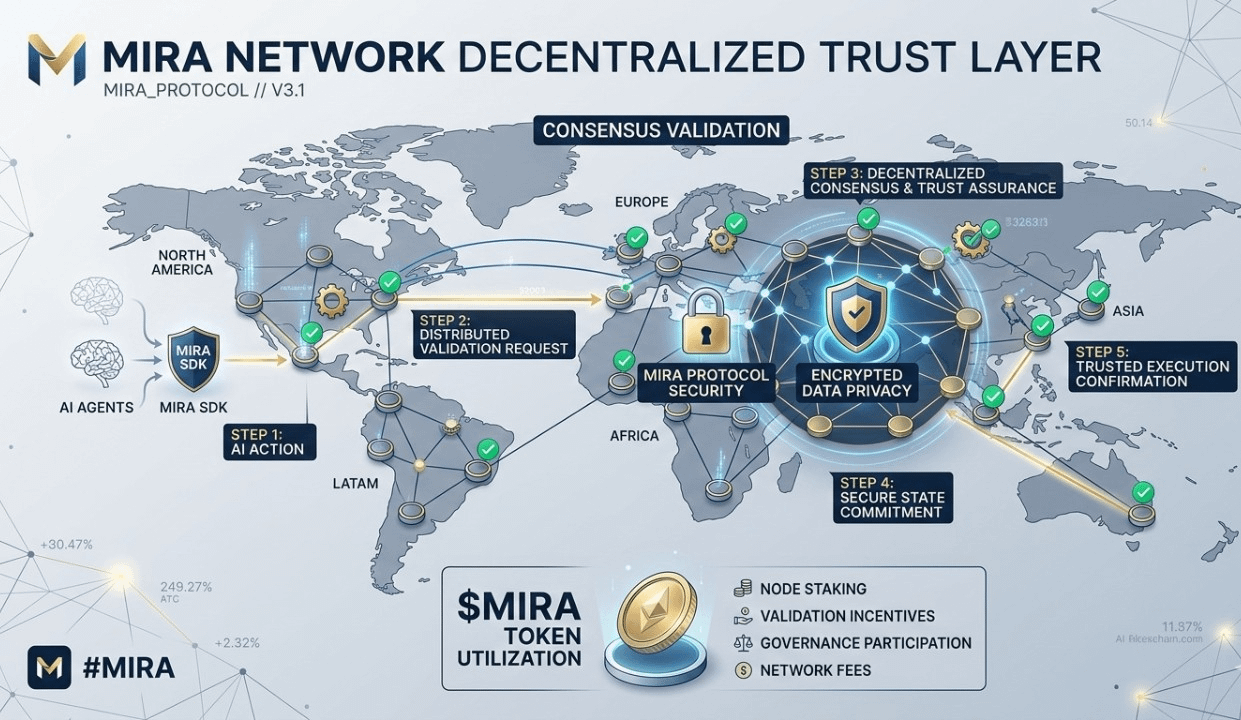

@mira_network me parece interesante porque su metodología no se basa solo en los resultados, sino que también verifica cada acción. $MIRA actúa como una capa que revisa continuamente los resultados y asegura que la salida sea confiable. El sistema parece estar aprendiendo por su cuenta cuándo los resultados son correctos y cuándo es necesaria una nueva verificación, y esta es la diferencia que aclara la distinción entre experimentos y resultados verdaderamente confiables.

Además, el diseño de Mira Network también mantiene la privacidad y la imparcialidad. No se expone información sensible ni datos financieros en cada proceso de verificación, y no hay sesgo hacia ningún proveedor de IA. Esta característica es especialmente importante cuando se toman decisiones de IA en áreas sensibles como legales, financieras o de infraestructura. Esto significa que los resultados no solo deben ser precisos a lo largo del tiempo, sino que también deben ser monitoreados continuamente.

Espero con ansias ver cómo funcionará este sistema a gran escala y cuán confiable se mantiene a lo largo del tiempo a medida que diferentes agentes de IA se vuelven autónomos. Creo que este proceso de verificación constante establece un límite fundamental que aclara la diferencia entre el entorno experimental y el mundo real. Si este sistema tiene éxito a gran escala, $MIRA no solo será un token, sino también una representación de confianza y transparencia, que jugará un papel clave en hacer que el uso de IA sea seguro y confiable en el futuro. #Mira