La próxima carrera de IA no solo se trata de inteligencia

Cuanto más estudio la Red Mira, más siento que la verdadera oportunidad aquí está siendo malinterpretada. Mucha gente todavía habla de la IA como si lo único que importa es la calidad del modelo, la velocidad o el poder de razonamiento en bruto. Pero no creo que el próximo gran cuello de botella sea solo la inteligencia. Creo que es la confianza. El propio posicionamiento de Mira está centrado en esa idea exacta: construir una capa de confianza para la IA verificando salidas y acciones a través de la inteligencia colectiva en lugar de pedir a los usuarios que confíen ciegamente en un solo modelo o proveedor.

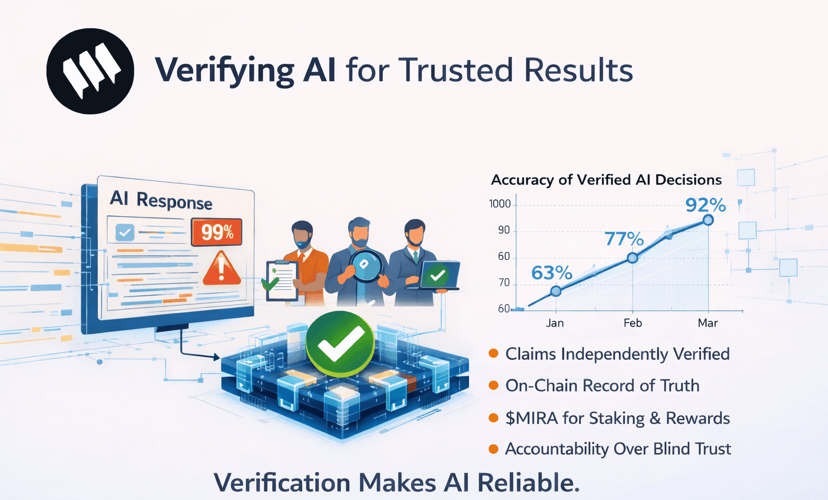

Eso me importa porque estamos entrando en una fase donde la IA ya no se limita a redactar texto o responder preguntas casuales. Se está integrando en flujos de trabajo, productos, decisiones y eventualmente en agentes autónomos que pueden desencadenar acciones en sistemas en vivo. En ese momento, una respuesta impresionante no es suficiente. Tiene que ser confiable. El documento técnico de Mira describe un protocolo de verificación descentralizado que transforma contenido complejo generado por IA en afirmaciones verificables de forma independiente, luego verifica esas afirmaciones a través de consenso distribuido entre diversos modelos y participantes incentivados. Esa es una base mucho más seria que simplemente esperar que un modelo poderoso acierte con suficiente frecuencia.

No creo que el mayor ganador de IA sea el modelo que suena más inteligente. Creo que será el sistema que haga que la inteligencia sea lo suficientemente confiable como para confiar.

Lo que Mira está resolviendo realmente

El problema central que Mira está abordando es simple de describir y difícil de resolver: la IA puede sonar segura mientras está equivocada. Eso no es solo un problema de marca para la industria. Se convierte en un problema real de infraestructura en el momento en que se utiliza la IA en lógica financiera, herramientas para desarrolladores, flujos de trabajo de investigación, ejecución automatizada o cualquier entorno donde los errores conllevan costos a nivel inferior. Mira dice explícitamente que está haciendo que la IA sea confiable al verificar salidas y acciones en cada paso usando inteligencia colectiva, y sus materiales de investigación se centran en reducir la alucinación y el sesgo a través de la verificación distribuida en lugar de la autoridad de un solo modelo.

Lo que me gusta de este marco es que trata la confianza como un problema de protocolo en lugar de un problema de relaciones públicas. La mayoría de los sistemas de IA centralizados todavía operan como cajas negras. Una empresa entrena el modelo, ejecuta la inferencia y pide a todos los demás que acepten el resultado. Mira invierte esa estructura. Según el documento técnico, descompone las salidas en afirmaciones más pequeñas, hace que esas afirmaciones sean revisadas por múltiples modelos y validadores independientes, y luego agrega los resultados en un resultado de consenso. En otras palabras, está tratando de hacer que la verificación sea nativa para el sistema en lugar de opcional después del hecho.

Por qué esto es más importante en la era de los agentes de IA

Creo que Mira se vuelve mucho más importante cuando dejas de ver la IA como una categoría de chatbot y comienzas a verla como una categoría de agente. Los agentes de IA están siendo diseñados cada vez más para recuperar información, llamar herramientas, ejecutar flujos de trabajo, enrutear decisiones y eventualmente gestionar acciones dentro de economías digitales. Una vez que eso sucede, la alucinación ya no es solo “salida mala”. Se convierte en un riesgo operativo. Los materiales oficiales de Mira enmarcan repetidamente la red como infraestructura para la ejecución de IA sin confianza e inteligencia verificada, incluidas las anunciaciones de asociaciones que la posicionan como una capa de verificación para aplicaciones de IA en cadena y a nivel de ecosistema.

Esta es exactamente la razón por la que creo que Mira tiene una relevancia a largo plazo más fuerte que muchas narrativas de IA que solo se centran en la generación. Si un agente va a mover fondos, analizar riesgos, presentar una acción de gobernanza o ayudar a coordinar lógica de múltiples pasos, entonces la confiabilidad tiene que ser parte de la arquitectura. Mira está tratando de convertirse en esa arquitectura. No la parte que escribe la respuesta, sino la parte que verifica si la respuesta merece ser confiada antes de que se mueva más abajo.

El modelo de verificación es el núcleo de la tesis

Lo que más me destaca es que Mira no solo está afirmando “mejorar la IA”. Está proponiendo un diseño específico de cómo se puede producir la confianza. El documento técnico dice que el protocolo transforma el contenido en afirmaciones verificables de forma independiente, enruta esas afirmaciones a través del consenso distribuido entre diversos modelos de IA y utiliza incentivos económicos más salvaguardias técnicas para fomentar la verificación honesta. Esa estructura es importante porque no se basa en una única fuente de inteligencia dominante. Se basa en la verificación cruzada, la resolución de desacuerdos y la alineación de incentivos.

Creo que el ángulo de diversidad es una de las partes más subestimadas del proyecto. Diferentes modelos tienen diferentes puntos ciegos, diferentes sesgos y diferentes modos de falla. Cuando un sistema está equivocado, otro puede atraparlo. Cuando un modelo se excede, otro puede ser más conservador. Mira está tratando de convertir esa diversidad de una molestia en un motor de verificación. Para mí, eso está mucho más cerca de cómo funciona la verdadera confianza en sistemas complejos: no a través de una única autoridad, sino a través de revisiones por capas y desafíos estructurados.

En IA de alto riesgo, la pregunta no es solo “¿puede el modelo responder?” Es “¿quién verificó la respuesta antes de que importara?”

Por qué el diseño de la red se siente más práctico de lo que la gente asume

Otra razón por la que tomo a Mira en serio es que no es solo un documento teórico. El proyecto tiene infraestructura activa orientada a desarrolladores en torno a la red. Los documentos describen un SDK que proporciona una interfaz unificada a múltiples modelos de lenguaje, con capacidades de enrutamiento, balanceo de carga y gestión de flujos. La plataforma también tiene creación de tokens de API, seguimiento de uso y herramientas para desarrolladores, lo que me indica que Mira está tratando de hacer que esta capa de verificación sea utilizable, no solo conceptualmente elegante.

Esa capa práctica importa mucho. Muchos proyectos en IA x cripto suenan interesantes hasta que haces la simple pregunta: ¿puede un constructor realmente integrar esto en un producto hoy? Mira al menos parece estar construyendo hacia una respuesta que es más concreta que la mayoría. Los documentos muestran caminos de trabajo para el acceso a la API y operaciones de modelos, mientras que el sitio principal y el portal de escritura siguen reforzando la misma tesis sobre la inteligencia verificada y los sistemas de IA sin confianza. Esa consistencia entre la investigación, el mensaje y las herramientas hace que el proyecto me parezca más coherente.

El token tiene más sentido cuando lo veo como infraestructura de red

También creo que $MIRA se vuelve más fácil de entender cuando dejo de verlo como un token de IA típico y empiezo a verlo como un activo de red de confianza. El documento de notificación de MiCA de Mira dice que el token está destinado a la participación en el proceso de verificación, participación en la gobernanza, recompensas y pago por acceso a la API de la red. Se espera que los operadores de nodos que ejecutan modelos de IA para la verificación pongan en juego el token, y los desarrolladores pueden usarlo como método de pago para capacidades de verificación de IA descentralizadas. Eso le da al token un papel de infraestructura en lugar de uno puramente narrativo.

Esta parte importa porque siempre hago la misma pregunta con estos proyectos: ¿está el token realmente vinculado al comportamiento de la red, o está solo adjunto a una historia? En el caso de Mira, la documentación oficial al menos presenta un vínculo directo entre la participación, la validación, la gobernanza y el uso. Eso no garantiza automáticamente el éxito a largo plazo, pero hace que el diseño sea más creíble. Si la red crece, se espera que el token esté dentro del bucle de confianza central en lugar de afuera.

Por qué el ángulo de delegador y ecosistema importa

Una cosa que encuentro interesante sobre Mira es que no solo está hablando con constructores de modelos o diseñadores de protocolos. También está abriendo caminos de participación en torno a su red de verificación. La propia escritura de Mira sobre el Programa de Delegadores enmarca la red como una capa de verificación fundamental para sistemas de IA sin confianza y posiciona la participación más amplia de la comunidad como parte de asegurar y escalar esa infraestructura. Incluso sin ejecutar un nodo de verificación completo, las personas aún pueden convertirse en parte de la red económica y socialmente conectada al crecimiento de la red.

Para mí, eso es estratégicamente inteligente. Una capa de confianza se vuelve más fuerte cuando no solo es técnicamente sólida, sino también socialmente integrada. Cuantos más desarrolladores, validadores, delegadores y socios del ecosistema confíen en los mismos raíles de verificación, más defendible se vuelve la red. La reciente escritura de Mira sobre asociaciones, subvenciones y campañas del ecosistema sugiere que está tratando de crear ese volante más amplio en lugar de seguir siendo un experimento de investigación de nicho.

La idea más grande: Mira está tratando de hacer que el contexto sea confiable

Cuando me alejo, creo que lo más profundo que Mira está construyendo no es solo la verificación de salidas. Es un contexto confiable para sistemas autónomos. La verdadera debilidad de muchos agentes no es que no pueden ejecutar lógica. Es que ejecutan lógica sobre información no confiable o mal fundamentada. Si Mira puede convertirse en una capa donde las afirmaciones sean verificadas, rastreables y aseguradas económicamente, entonces los agentes dejan de actuar en una niebla informativa y comienzan a actuar sobre algo más cercano a la verdad compartida. Esa es mi interpretación de la arquitectura descrita en el documento técnico y en los materiales del producto.

Ese cambio es mucho más grande de lo que parece. Mueve los sistemas de IA de “herramientas probabilísticas que pueden ser útiles” hacia “sistemas auditables que pueden ser confiables en entornos más serios”. Creo que esa distinción se volverá cada vez más importante a medida que los agentes en cadena, la automatización financiera y las aplicaciones impulsadas por IA maduren. Mira se está posicionando justo en esa intersección.

La verdadera ventaja para la IA autónoma puede no venir de más confianza. Puede venir de una mejor verificación.

Los riesgos siguen siendo reales

Dicho esto, no creo que esta tesis deba leerse de manera acrítica. La verificación a gran escala es difícil. La latencia importa. El costo importa. Los sistemas de consenso pueden agregar fricción. Y siempre está la pregunta de si los desarrolladores elegirán la verificación descentralizada sobre opciones centralizadas más rápidas y simples. Mira tiene una tesis convincente, pero el mercado aún pondrá a prueba si la confianza es lo suficientemente importante para que los constructores paguen por ella de manera consistente. Esta es mi inferencia de la naturaleza del producto y el desafío de adopción en lugar de una afirmación que Mira hace directamente.

También existe el riesgo de categoría más amplio en torno a IA x cripto. Muchos proyectos hablan sobre descentralización, verificabilidad e infraestructura, pero solo un número menor logra convertirse en indispensable. Para Mira, la pregunta a largo plazo es si la verificación se convierte en una capa predeterminada a la que muchas aplicaciones y agentes se conectan, o si sigue siendo una característica especializada utilizada solo en ciertos entornos de alta confianza. Creo que esa es la pregunta clave de adopción desde aquí. Esta es una inferencia basada en el rol declarado de la red y las herramientas actuales para desarrolladores.

Mi opinión final sobre Mira

Mi opinión honesta es que Mira es uno de los proyectos más intelectualmente sólidos en la categoría de infraestructura de IA en este momento porque se centra en un problema que solo se volverá más urgente con el tiempo. La industria ya tiene muchos sistemas que pueden generar. Lo que aún falta es una forma robusta y escalable de verificar, auditar y asegurar económicamente lo que se genera antes de que se confíe en flujos críticos. Mira está tratando de construir exactamente eso.

Esa es la razón por la que no veo $MIRA como solo otro activo narrativo de IA. Lo veo más como una apuesta a la idea de que la inteligencia verificada se convierte en una categoría real de infraestructura. Si eso sucede, el papel de Mira podría volverse mucho más grande de lo que la gente espera hoy. Porque una vez que los agentes de IA y las aplicaciones impulsadas por IA comiencen a mover valor real, la confianza dejará de ser un extra agradable. Se convertirá en parte de la capa base.

@Mira - Trust Layer of AI #Mira $MIRA