@Mira - Trust Layer of AI |. $MIRA

@Mira - Trust Layer of AI |. $MIRA

La industria de la IA ama hablar sobre precisión, escala e innovación.

Pero hay una pregunta más silenciosa que nadie quiere responder:

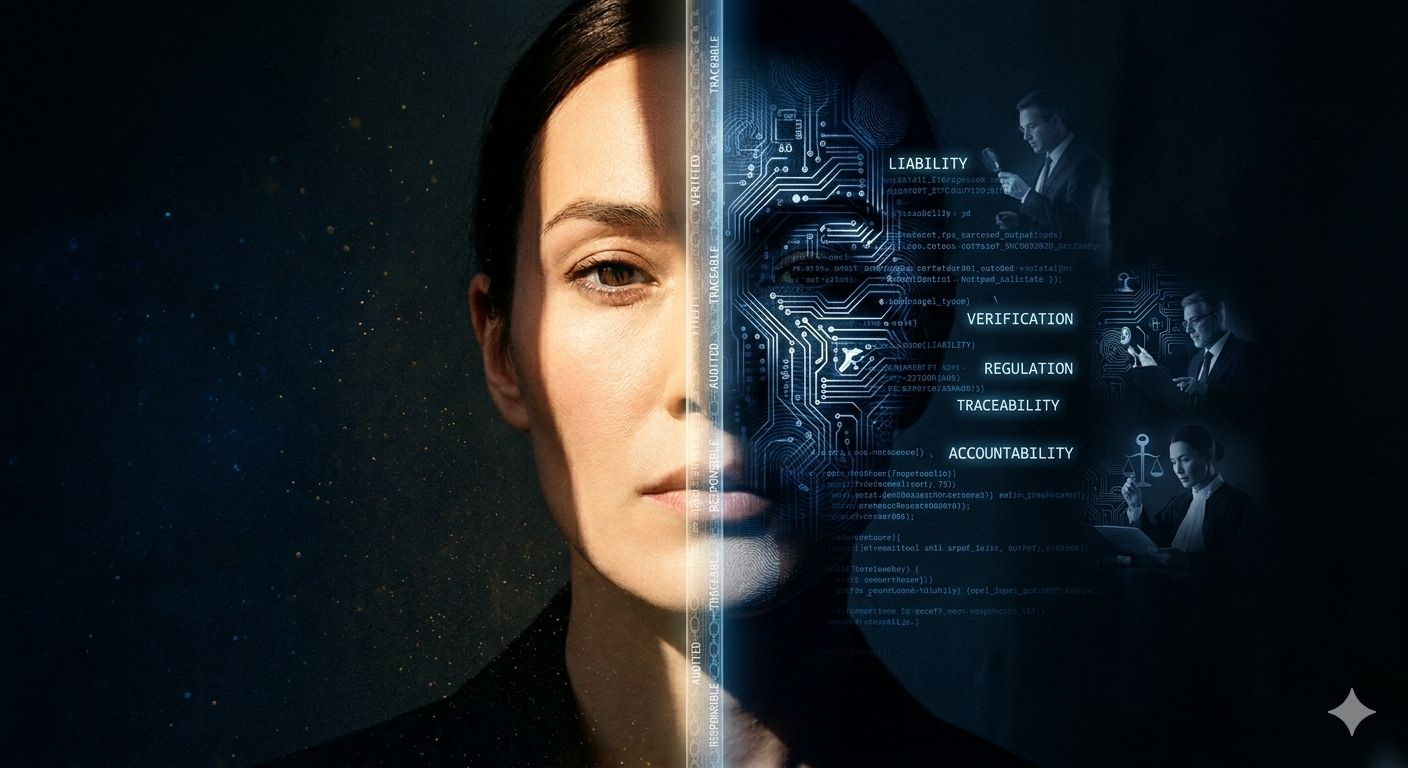

Cuando un sistema de IA causa daño — ¿quién es responsable?

No teóricamente.

Legalmente.

En finanzas, seguros, atención médica y crédito, la responsabilidad no es abstracta.

Termina carreras.

Desencadena investigaciones.

Mueve tribunales.

En este momento, la IA opera en una zona gris.

Los modelos “recomiendan.”

Los humanos “deciden.”

Pero cuando un modelo procesa miles de solicitudes y un humano simplemente aprueba, la distinción se vuelve cosmética. La decisión ya ha sido moldeada.

Las instituciones obtienen eficiencia.

Pero evitan la propiedad.

Esa brecha — no la calidad del modelo — es lo que ralentiza la adopción institucional.

Los reguladores están reaccionando.

Requisitos de explicabilidad.

Rutas de auditoría.

Las mandatos de trazabilidad.

¿La respuesta de la industria?

Tarjetas de modelo. Informes de sesgo. Tableros de control.

Estas herramientas documentan el sistema.

No verifican el resultado.

Y esa diferencia importa.

Un modelo que es 94% preciso aún falla el 6% del tiempo.

Si ese 6% incluye una hipoteca rechazada o un reclamo de seguro denegado, los promedios no importan.

Los auditores examinan decisiones específicas.

Los tribunales examinan resultados específicos.

Los reguladores examinan registros específicos.

La verificación debe operar a nivel de resultado — no a nivel de modelo.

Ese es el cambio.

En lugar de decir: “Nuestro modelo funciona bien en promedio.”

El sistema dice: “Este resultado fue revisado y confirmado de manera independiente.”

Como la inspección de productos.

No la reputación del producto.

Para las industrias reguladas, eso lo cambia todo.

Los incentivos económicos refuerzan esto.

Los validadores son recompensados por precisión.

Sanciones por negligencia.

La responsabilidad está integrada en la infraestructura.

Los desafíos permanecen.

Velocidad.

Asignación de responsabilidad.

Claridad legal en torno a la verificación distribuida.

Pero la dirección es inevitable.

La IA se está moviendo hacia dominios donde el dinero, la libertad y el acceso están en juego.

Estos dominios ya operan bajo marcos de responsabilidad.

La IA no puede estar exenta.

La confianza no se declara.

Se registra.

Y los sistemas que desean legitimidad institucional deben demostrar responsabilidad — un resultado a la vez.

Eso no es una característica.

Es un requisito.