Recientemente, he estado examinando la red Mira y el token $MIRA desde una perspectiva tecnológica e infraestructural en lugar de centrarme solo en su precio de mercado. Lo que más me interesa es cómo está diseñada la red, cómo funcionan sus sistemas internos y qué papel juega el token dentro del ecosistema más amplio.

La inteligencia artificial está evolucionando a un ritmo increíble. Los sistemas de IA hoy en día pueden generar ideas impresionantes, automatizar tareas y apoyar procesos de toma de decisiones complejos. Sin embargo, junto con estos avances, continúa existiendo un problema grave: la fiabilidad.

Los sistemas de IA a veces pueden producir alucinaciones, salidas sesgadas o resultados inconsistentes. En aplicaciones casuales o de entretenimiento, esto puede no causar un daño importante, pero en entornos donde las decisiones tienen consecuencias reales, los riesgos se vuelven significativos. Los servicios financieros, la atención médica, el análisis legal y las decisiones de políticas requieren un nivel de certeza mucho más alto del que los sistemas de IA actuales pueden proporcionar de manera consistente.

Este desafío es parte de la razón por la que se ha desarrollado la Red Mira. El proyecto se centra en transformar las salidas de IA en información verificable en lugar de simplemente aceptar el resultado de un solo modelo.

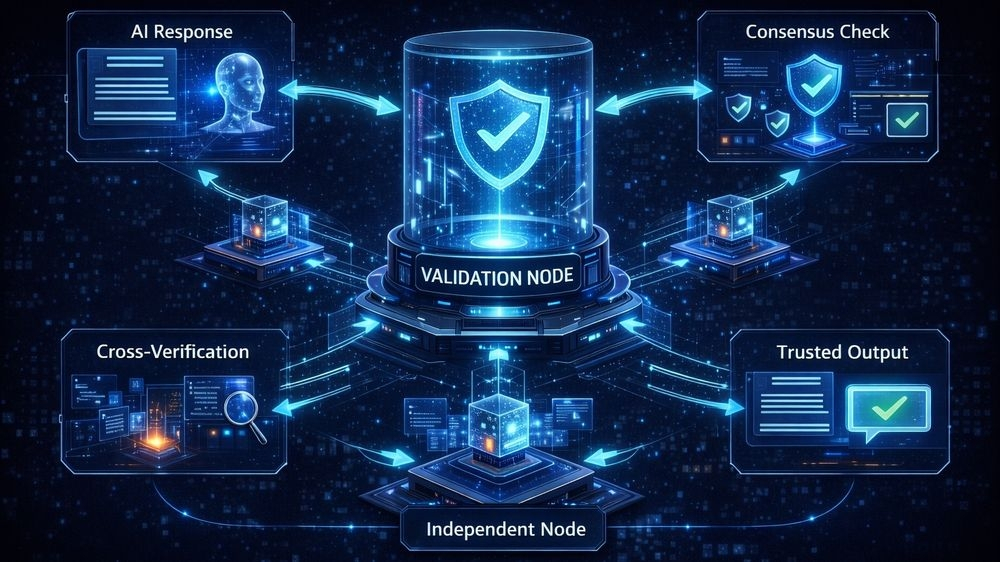

El concepto detrás de Mira es relativamente sencillo pero poderoso. En lugar de depender de un modelo de IA para generar y validar una respuesta, Mira descompone salidas complejas de IA en afirmaciones verificables individuales. Estas afirmaciones se distribuyen a través de una red donde múltiples sistemas de IA participan en verificar la precisión de la información.

A través de este proceso, el sistema introduce una capa adicional de verificación que a menudo falta en las arquitecturas de IA tradicionales. En lugar de confiar en un solo sistema, la red crea un mecanismo de validación colaborativa.

Una de las ventajas clave de este enfoque es la transparencia. Los resultados del proceso de verificación pueden ser registrados en una blockchain, creando un registro rastreable de cómo se llegó a una conclusión. Desarrolladores y organizaciones pueden revisar estos registros para entender el camino de verificación detrás de un resultado generado por IA.

Este nivel de transparencia es especialmente importante en sectores donde la responsabilidad y la auditabilidad son esenciales.

Otro aspecto interesante de la Red Mira es su diseño neutral. El sistema no está construido alrededor de un solo proveedor de IA o modelo. En cambio, está diseñado para trabajar con múltiples sistemas de IA de diferentes desarrolladores. Al permitir que varios modelos evalúen y verifiquen las salidas de los demás, la red busca reducir la dependencia de cualquier fuente de información única.

En teoría, esta estructura podría mejorar significativamente la fiabilidad de los conocimientos generados por IA.

Sin embargo, al igual que con cualquier infraestructura emergente, quedan varias preguntas importantes. Las redes de verificación deben asegurar mecanismos de incentivo sólidos para que los validadores participen de manera honesta. Sin incentivos adecuados, el sistema podría tener dificultades para mantener una participación fiable.

También hay desafíos relacionados con la escalabilidad y la gobernanza. A medida que la red crece, debe mantener la eficiencia mientras previene riesgos como la colusión de validadores o la manipulación. Los marcos de gobernanza desempeñarán un papel importante en determinar cómo evoluciona y se adapta el sistema con el tiempo.

A pesar de estos desafíos, la Red Mira representa un cambio interesante en la conversación en torno a la inteligencia artificial. Gran parte de la discusión actual sobre IA se centra en la capacidad: cuán poderosos se están volviendo los modelos.

Mira introduce una perspectiva diferente: verificación.

Si las capas de verificación se adoptan ampliamente, podrían desempeñar un papel crítico en cómo se implementan los sistemas de IA en entornos del mundo real. La verificación fiable podría convertirse en la infraestructura faltante que permite que la IA pase de herramientas experimentales a sistemas de soporte de decisión confiables.

En ese contexto, proyectos como la Red Mira y el $MIRA ecosistema están explorando una pregunta importante: no solo qué puede hacer la IA, sino cómo podemos confiar en lo que produce.