En el mundo de la inteligencia artificial en rápida evolución, la mayoría de los proyectos persiguen los mismos objetivos: más velocidad, más escala y resultados más impresionantes. Pero Mira Network aborda el problema desde un ángulo muy diferente. En lugar de centrarse en cuán poderosa puede llegar a ser la IA, se enfoca en una pregunta más difícil y incómoda: ¿Qué sucede cuando las personas comienzan a confiar en las respuestas de la IA demasiado fácilmente?

Esta pregunta se sitúa en el centro de la filosofía de Mira.

Hoy en día, muchos sistemas de IA son juzgados por lo fluidos que son al generar lenguaje. Si una respuesta suena segura, estructurada e inteligente, las personas tienden a aceptarla. El problema es que la fluidez no es lo mismo que la fiabilidad. Un modelo de IA puede producir una explicación pulida que suena convincente mientras aún contiene errores sutiles, malas interpretaciones o conclusiones exageradas.

Y una vez que una respuesta parece completa, la mayoría de los usuarios rara vez se detiene a verificarla. La leen, la aceptan y avanzan. Ese comportamiento crea un riesgo silencioso pero serio: la IA puede estar equivocada de una manera muy persuasiva.

Mira Network parece entender este problema mejor que la mayoría de los proyectos en el espacio de AI-crypto.

En lugar de intentar hacer que las salidas de IA sean más impresionantes, Mira se centra en hacer que la confianza sea más difícil de otorgar sin verificación. Esto desplaza la conversación de un rendimiento puro hacia algo más importante: el juicio y la responsabilidad.

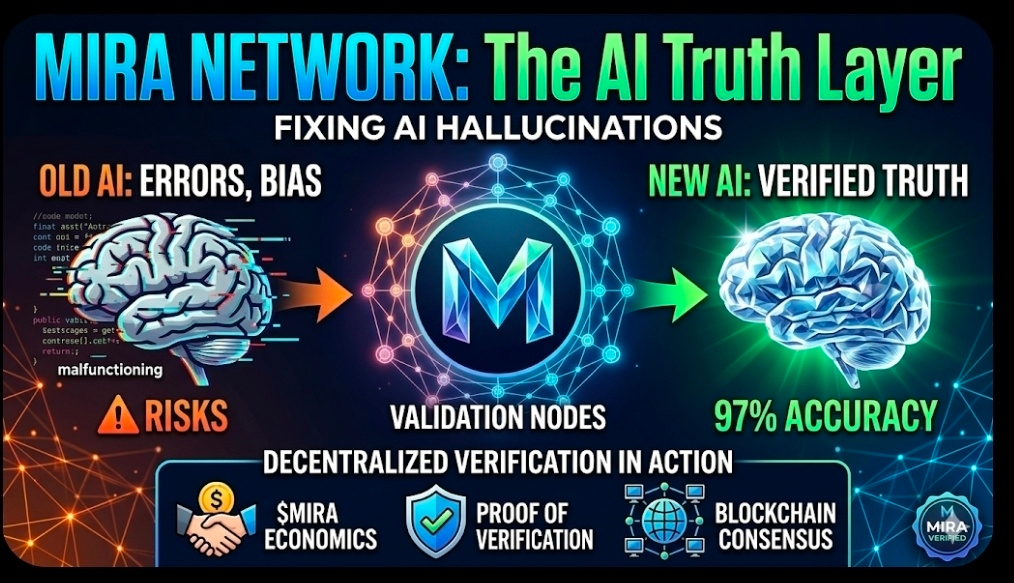

En el núcleo del enfoque de Mira hay una idea simple pero poderosa: las salidas de IA no deben ser confiadas solo porque un sistema las produjo. Deben ser verificadas.

Esto significa que las reclamaciones hechas por un sistema de IA deben pasar por un proceso donde se verifiquen y validen antes de ser consideradas confiables. La confianza debe surgir después de la verificación, no antes.

Aunque ese concepto suena obvio, la mayoría del ecosistema actual de IA aún supone que mejores modelos eventualmente resolverán el problema de confianza por sí solos. Un entrenamiento mejorado, conjuntos de datos más grandes, sistemas de recuperación más fuertes y mejores interfaces pueden reducir errores, pero no pueden eliminarlos por completo.

Incluso el modelo más avanzado aún puede producir un error convincente.

Mira parte de una suposición más disciplinada: el problema de confianza en la IA no se trata solo de mejores modelos, se trata de construir sistemas que verifiquen las salidas.

Curiosamente, esta filosofía se alinea estrechamente con los principios detrás de la tecnología blockchain. El cripto fue originalmente construido sobre el escepticismo hacia la confianza centralizada. En lugar de depender de una única autoridad, los sistemas blockchain utilizan validación distribuida para confirmar información.

Mira aplica esa misma mentalidad a la inteligencia artificial.

En lugar de asumir que la inteligencia merece automáticamente confianza, el proyecto intenta crear un marco donde las salidas de IA deben ganar credibilidad a través de la verificación.

Esto hace que Mira se trate menos de la producción de IA y más de la responsabilidad de la IA.

Otra razón por la que el proyecto se siente fundamentado es que refleja el comportamiento real de los usuarios. En la práctica, las personas rara vez verifican las respuestas de IA. La mayoría de los usuarios están ocupados y prefieren respuestas rápidas. Cuando una respuesta de IA parece pulida y completa, naturalmente disminuye el impulso de cuestionarla.

Mira parece diseñado con esa realidad en mente. En lugar de esperar que los usuarios se conviertan en verificadores de hechos perfectos, intenta construir la verificación directamente en el sistema.

Este enfoque se vuelve cada vez más importante a medida que la IA comienza a influir en decisiones en lugar de solo generar texto.

La próxima fase de la IA no solo se trata de escribir resúmenes o responder preguntas. Ayudará cada vez más a las personas a interpretar información, evaluar oportunidades, analizar riesgos y tomar decisiones.

Cuando la IA opera en esas áreas, los errores ya no son inofensivos.

Una salida defectuosa podría influir en inversiones, decisiones de gobernanza, conclusiones de investigación o estrategias empresariales. En ese momento, las consecuencias del error se vuelven reales. Los errores de IA dejan de ser fallos embarazosos: se convierten en riesgos operacionales.

Ahí es donde la tesis de Mira comienza a ganar fuerza.

El proyecto está explorando esencialmente si la confianza en la salida de IA puede convertirse en una forma de infraestructura, en lugar de algo que los usuarios simplemente asumen. En lugar de pedir a los sistemas de IA que generen más respuestas, Mira pregunta si el entorno alrededor de esas respuestas puede hacer que la falsa confianza sea más difícil de crear.

Pocos proyectos están trabajando actualmente en esa capa.

La mayoría de las plataformas de IA compiten en capacidad: quién puede generar respuestas más rápidas, textos más inteligentes o automatización más avanzada. Mira, en contraste, está tratando de competir en credibilidad.

Ese es un mercado mucho más difícil de construir. La verificación introduce fricción. Puede añadir tiempo, costo y complejidad. Los desarrolladores y usuarios solo aceptarán esos intercambios si los beneficios son claramente visibles.

Este se convierte en el mayor desafío de Mira.

El éxito del proyecto dependerá de si la verificación se vuelve prácticamente necesaria, no solo teóricamente atractiva. Si la gente admira el concepto pero evita usarlo porque se siente inconveniente, Mira podría seguir siendo una idea fuerte sin una adopción generalizada.

Sin embargo, si las salidas de IA no verificadas comienzan a sentirse arriesgadas, especialmente en entornos donde las decisiones conllevan consecuencias reales, la verificación podría volverse esencial.

Cuando eso suceda, sistemas como Mira podrían pasar de ser herramientas opcionales a convertirse en infraestructura básica, similar a las capas de seguridad en internet.

Los sistemas invisibles a menudo se convierten en los más importantes una vez que la tecnología madura. Cuando la verificación funciona bien, los usuarios pueden apenas notarlo. Simplemente experimentan menos salidas engañosas ganando confianza.

Esa ausencia de error puede ser difícil de comercializar, pero su valor puede ser enorme.

En última instancia, Mira Network no es simplemente otro proyecto de IA conectado a la tecnología blockchain. Representa un intento de formalizar el escepticismo en una era donde las máquinas pueden hablar de manera convincente.

En lugar de confiar en respuestas porque suenan inteligentes, Mira intenta crear un proceso donde las respuestas sean confiadas porque sobrevivieron a la verificación.

Esa ambición es más estrecha que muchas narrativas de IA, pero también es más profunda. El proyecto no persigue la historia más amplia sobre la inteligencia artificial. En cambio, está explorando un problema específico y cada vez más importante: cómo construir confianza en la información generada por IA.

A medida que la IA se involucra más en cómo las personas interpretan datos, evalúan riesgos y toman decisiones, ese problema solo crecerá en relevancia.

Mira se está posicionando directamente dentro de esa brecha entre apariencia y fiabilidad.