Cuando escucho por primera vez la frase “inteligencia artificial verificada”, mi reacción no es la emoción inmediata que suele rodear los anuncios de nueva infraestructura de IA, sino un sentido más tranquilo de reconocimiento porque reconoce algo que las personas que trabajan estrechamente con sistemas de aprendizaje automático han sabido durante mucho tiempo, que es que la verdadera barrera para una IA confiable nunca ha sido la generación de resultados, sino la capacidad de probar que esos resultados se produjeron de una manera confiable, rastreable y verificable en lugar de surgir de una caja negra que nadie puede auditar o reproducir con confianza.

Durante años, la conversación en torno a la inteligencia artificial se ha centrado en la capacidad, la escala y la velocidad, lo que llevó al despliegue rápido de modelos cada vez más poderosos que pueden generar texto, código, imágenes y decisiones con notable fluidez, sin embargo, este progreso también expuso una debilidad fundamental que se vuelve imposible de ignorar a medida que estos sistemas comienzan a influir en decisiones financieras, conclusiones de investigación e infraestructura digital, porque a menudo se les pide a los usuarios que confíen en resultados que no pueden verificar de forma independiente y se espera que los desarrolladores defiendan modelos cuyos procesos de razonamiento permanecen en gran medida opacos.

El modelo tradicional de implementación de IA coloca la carga de la confianza en el usuario, lo que significa que individuos, organizaciones y plataformas deben decidir si creen en los resultados de un sistema sin tener una forma clara de verificar la integridad de la computación que los produjo y, aunque este arreglo puede funcionar para tareas de bajo riesgo como generar copias de marketing o resumir documentos, rápidamente se vuelve frágil cuando la IA comienza a participar en sistemas donde la precisión, la responsabilidad y la transparencia no son características opcionales, sino requisitos fundamentales.

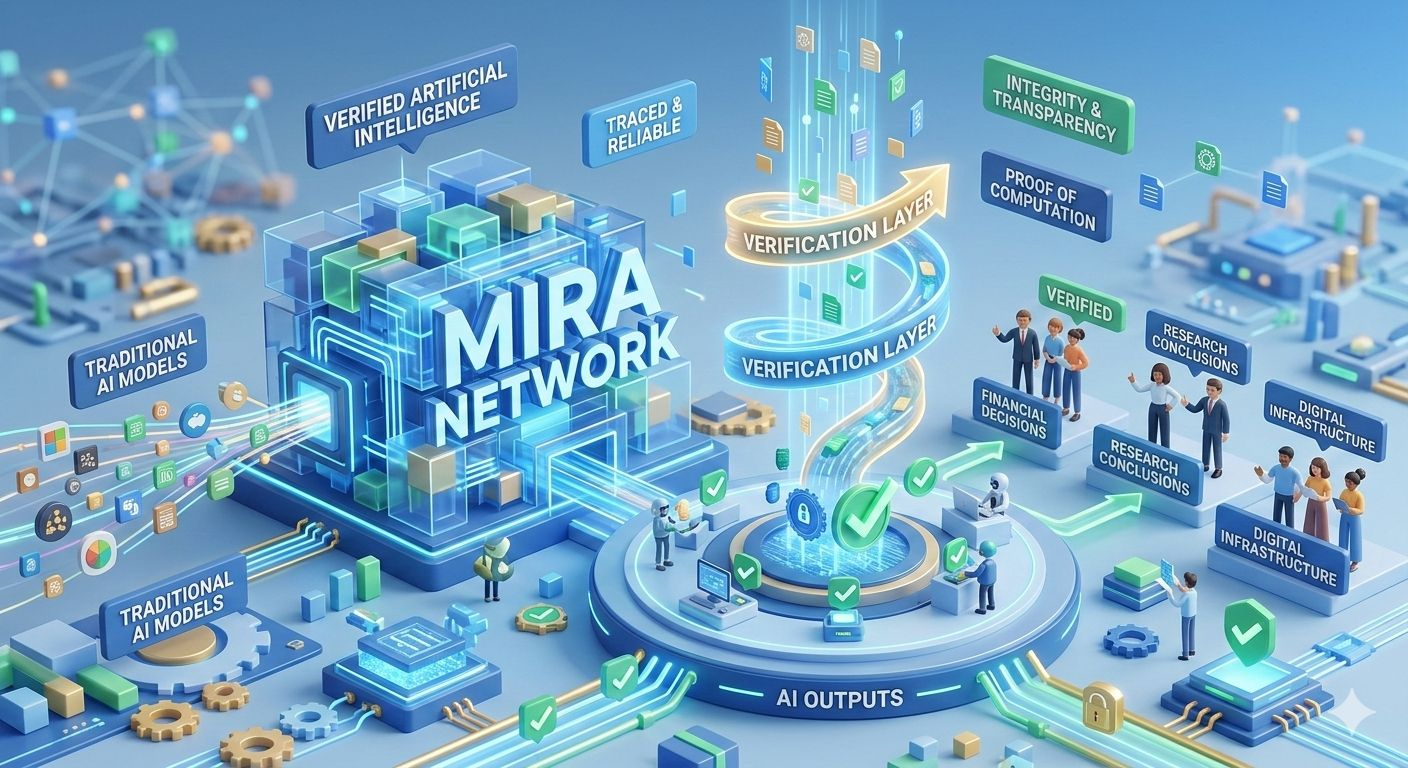

Este es el contexto en el que Mira Network comienza a importar porque el concepto detrás de él no es simplemente crear otra plataforma de inteligencia artificial o competir en la carrera por modelos más grandes, sino introducir una capa de verificación que permita que los resultados de la IA estén acompañados por una prueba criptográfica o computacional de que el proceso subyacente ocurrió exactamente como se afirmó, transformando efectivamente la IA de un sistema que simplemente produce respuestas en un sistema que puede demostrar la integridad de cómo se produjeron esas respuestas.

Una vez que la conversación cambia de generación a verificación, aparece inmediatamente un nuevo conjunto de preguntas de infraestructura, porque producir resultados de IA verificables requiere más que ejecutar un modelo en un servidor y devolver un resultado, ya que implica rastrear pasos computacionales, anclar estructuras de prueba, coordinar procesos de verificación entre participantes distribuidos y asegurar que el costo y la latencia de la verificación permanezcan lo suficientemente prácticos como para respaldar aplicaciones reales en lugar de convertirse en una garantía teórica que pocos sistemas pueden permitirse utilizar.

Lo que emerge de esta arquitectura no es solo una mejora técnica, sino un cambio estructural en cómo los sistemas de inteligencia artificial se integran en los ecosistemas digitales, porque la verificación introduce una capa operativa completamente nueva que se sitúa entre la computación de IA cruda y el consumo del usuario, y esa capa comienza a parecerse a la infraestructura de la misma manera que las procesadoras de pagos, los proveedores de nube y los validadores de blockchain forman componentes invisibles pero esenciales de los servicios digitales modernos.

Las implicaciones de este cambio se vuelven más claras cuando uno considera cómo opera actualmente la confianza en la industria de la IA, donde la credibilidad a menudo se concentra en un puñado de grandes organizaciones cuyos modelos son aceptados en gran parte debido a la reputación de marca, el prestigio de la investigación o el dominio de la plataforma, lo que significa que los usuarios, en última instancia, confían en instituciones en lugar de en la integridad verificable de la computación en sí, creando una estructura de dependencia que funciona solo mientras esas instituciones permanezcan competentes y benevolentes.

Una red de verificación cambia esa dinámica al distribuir la responsabilidad de validación a través de un sistema más amplio de participantes que pueden confirmar de forma independiente que una ejecución de modelo particular siguió un conjunto específico de reglas o computaciones, lo que transforma gradualmente la confianza de una promesa institucional en una propiedad técnica que puede ser verificada, reproducida y validada independientemente de qué entidad generó originalmente el resultado.

Sin embargo, la introducción de la verificación también crea un nuevo conjunto de consideraciones operativas que muchos observadores subestiman porque verificar los resultados de la IA requiere gestionar pruebas computacionales, coordinar validadores, mantener estructuras de incentivos y asegurar que las capas de verificación permanezcan resistentes durante períodos de alta demanda o actividad adversarial, lo que significa que la fiabilidad de la red de verificación en sí se convierte en un factor crítico para determinar si todo el sistema puede funcionar a gran escala.

En este sentido, Mira Network no simplemente introduce una característica que hace que los resultados de IA sean más fáciles de confiar, sino que establece la base para una nueva clase de operadores de infraestructura cuyo papel se asemeja al de las cámaras de compensación financieras o los validadores de blockchain, porque participan en el proceso de confirmar la integridad computacional y mantener la fiabilidad de un mercado de verificación que se sitúa entre los productores de IA y los consumidores de IA.

Este desarrollo tiene importantes implicaciones en el mercado, ya que una vez que la verificación se convierte en una expectativa estándar para los resultados de IA, el panorama competitivo comienza a cambiar de la pura capacidad del modelo hacia la calidad de la tubería de verificación que rodea a esos modelos, incluidos factores como la rapidez con que se pueden verificar los resultados, cuán transparente es el proceso de verificación, cuán robusta permanece la red durante períodos de uso intenso y cuán resistente es el sistema a la manipulación o el fraude.

El resultado es que las aplicaciones de inteligencia artificial pueden competir cada vez más no solo en cuán inteligentes parecen ser sus modelos, sino también en cuán fiablemente pueden probar que la inteligencia se ejecutó correctamente, lo que eleva sutilmente pero significativamente el estándar de lo que los usuarios esperan al interactuar con sistemas impulsados por IA que influyen en decisiones del mundo real o actividades financieras.

También hay una dimensión estratégica más profunda en esta evolución, porque la IA verificada introduce un modelo de responsabilidad que las plataformas tradicionales de aprendizaje automático han tenido dificultades para proporcionar, ya que los desarrolladores y las organizaciones ya no pueden confiar únicamente en la autoridad de su infraestructura, sino que deben asegurarse de que sus sistemas operen dentro de marcos que puedan resistir la verificación y el escrutinio independientes.

Si este modelo tiene éxito, la importancia a largo plazo de redes como Mira no se medirá meramente por la cantidad de tareas de IA procesadas a través de su infraestructura, sino por cuán efectivamente transforman la confianza en la inteligencia artificial de un acuerdo social en un estándar técnico verificable que opera de manera fiable incluso cuando los sistemas subyacentes se vuelven más complejos, más autónomos y más profundamente integrados en el tejido económico e informativo de Internet.

Lo que, en última instancia, lleva a la pregunta que más importa al evaluar el auge de la inteligencia artificial verificada, porque la verdadera prueba de esta arquitectura no ocurrirá cuando los sistemas operen bajo condiciones ideales, sino cuando la demanda aumente, actores adversariales intenten manipular resultados y los incentivos económicos de los participantes en la verificación se vean sometidos a estrés, ya que la credibilidad a largo plazo de la IA verificada dependerá de si redes como Mira pueden mantener la integridad, la transparencia y la fiabilidad precisamente cuando esas cualidades se vuelven más difíciles de garantizar.

@Mira - Trust Layer of AI #Mira $MIRA