La inteligencia artificial se está volviendo más poderosa cada año. Desde la redacción de contenido hasta el análisis de datos y la asistencia en la investigación, las herramientas de IA ahora se utilizan en muchas áreas de la vida diaria. Sin embargo, todavía existe un gran problema: la confianza. Los sistemas de IA a veces pueden producir información que suena convincente pero que en realidad es incorrecta. Estos errores, a menudo llamados alucinaciones, dificultan confiar en la IA en situaciones donde la precisión realmente importa.

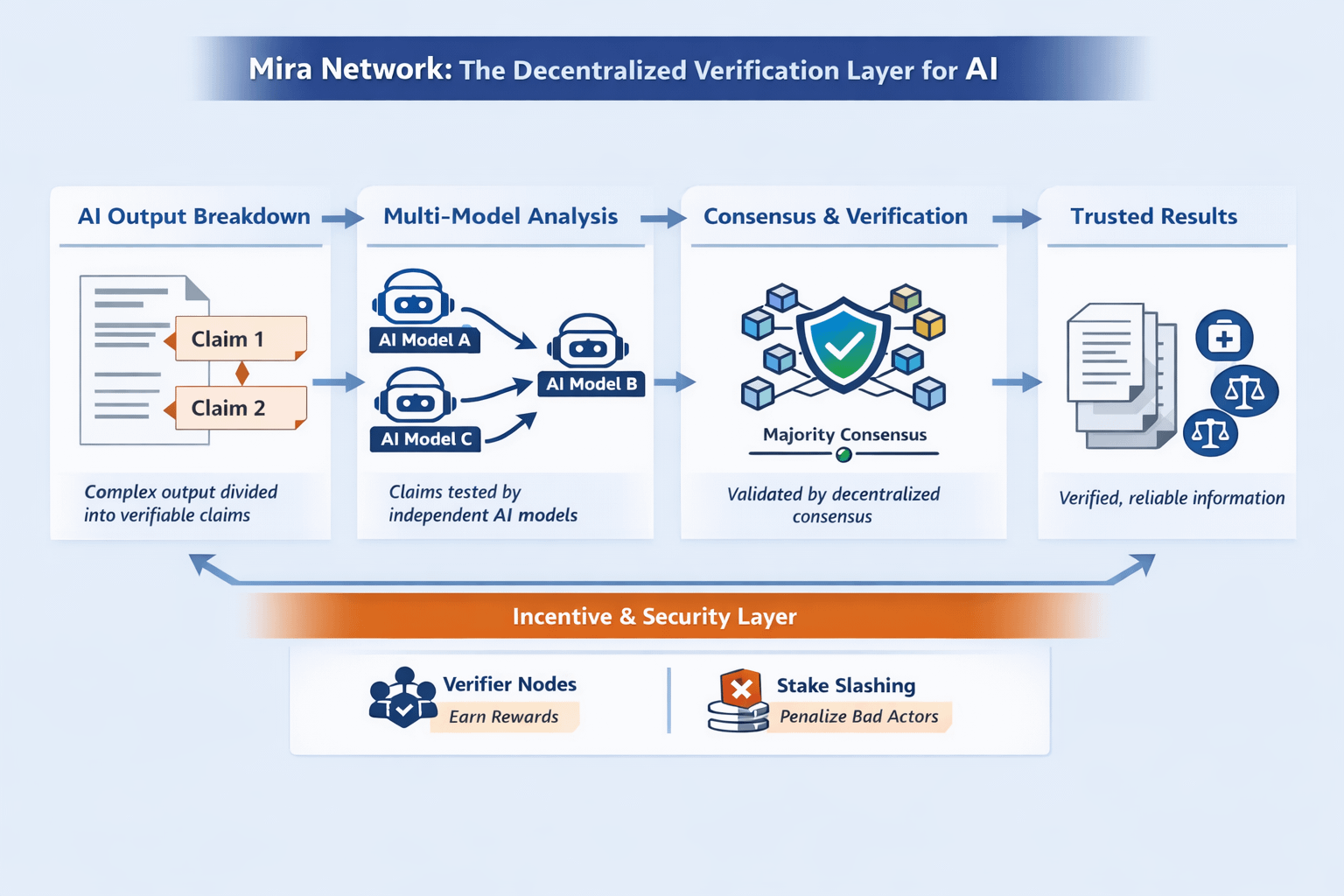

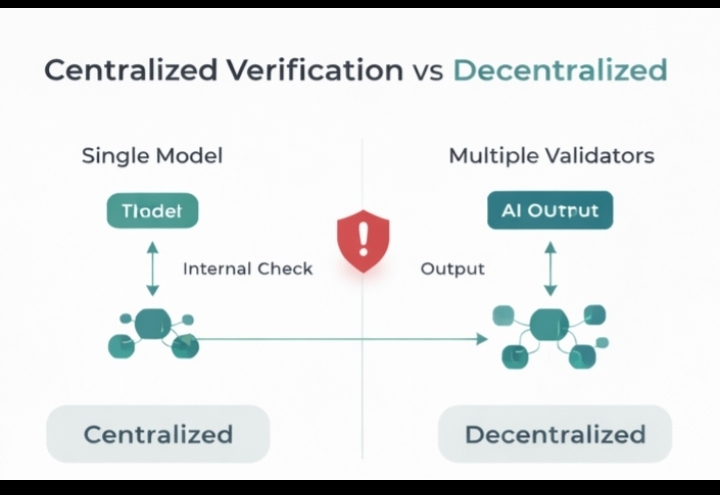

Mira Network está tratando de resolver este problema introduciendo un sistema descentralizado que verifica la información generada por IA. En lugar de depender de un solo modelo de IA para producir y validar respuestas, la red utiliza múltiples modelos independientes para verificar la misma información. Este enfoque reduce el riesgo de errores porque diferentes sistemas evalúan las afirmaciones antes de que se acepte un resultado final.

El proceso funciona dividiendo las salidas complejas de IA en declaraciones más pequeñas y claras que pueden ser revisadas individualmente. Cada afirmación es revisada por diferentes modelos de IA dentro de la red. Cuando varios modelos llegan a la misma conclusión, el resultado se considera verificado. Esta verificación es respaldada por la tecnología blockchain, que registra el resultado de manera transparente y resistente a manipulaciones.

Otra parte importante de la Red Mira es su sistema de incentivos. Los participantes que ayudan a verificar información contribuyen con poder de computación y reciben recompensas por su trabajo. Esto crea un sistema donde se anima a los participantes a actuar de manera honesta y cuidadosa. Si alguien intenta manipular el proceso de verificación, el sistema puede detectarlo y aplicar sanciones, ayudando a mantener la fiabilidad de la red.

La idea detrás de la Red Mira se vuelve especialmente importante cuando pensamos en el futuro de los sistemas de IA autónomos. A medida que la IA comienza a realizar más tareas de forma independiente, la necesidad de información confiable se vuelve aún más crítica. Industrias como las finanzas, la atención médica y los servicios legales requieren datos precisos, y los errores en estas áreas pueden tener consecuencias graves. Una capa de verificación como Mira podría ayudar a que la IA sea más segura y más confiable en estos entornos.

Si bien el concepto todavía se está desarrollando, el enfoque destaca un cambio importante en cómo las personas piensan sobre la inteligencia artificial. En lugar de simplemente hacer que los modelos de IA sean más inteligentes, proyectos como Mira se centran en hacer que las salidas de IA sean más confiables. Al combinar la verificación descentralizada con la tecnología de IA moderna, la Red Mira tiene como objetivo construir un sistema donde la información generada por máquinas pueda ser verificada, validada y confiable.

A medida que la inteligencia artificial continúa evolucionando, las soluciones que mejoran la transparencia y la fiabilidad probablemente jugarán un papel importante. La Red Mira representa un intento de abordar estos desafíos y crear un marco donde los sistemas de IA puedan operar con mayor confianza y responsabilidad.#mira $MIRA @Mira - Trust Layer of AI #Mira