La mayoría de las personas asumen que el mayor desafío de la IA es la inteligencia. En realidad, el desafío siempre ha sido la confianza. Los grandes modelos pueden producir respuestas seguras, pero la confianza no equivale a la corrección. Errores sutiles—hechos malinterpretados, citas fabricadas o razonamientos incompletos—se deslizan silenciosamente y rara vez se anuncian con gran ruido.

Estos errores no son catastróficos individualmente. Pero en sistemas financieros de contratos inteligentes, o redes autónomas, incluso pequeños descuidos pueden desencadenar consecuencias en el mundo real. Y esa es exactamente la razón por la que confiar en un solo modelo es frágil.

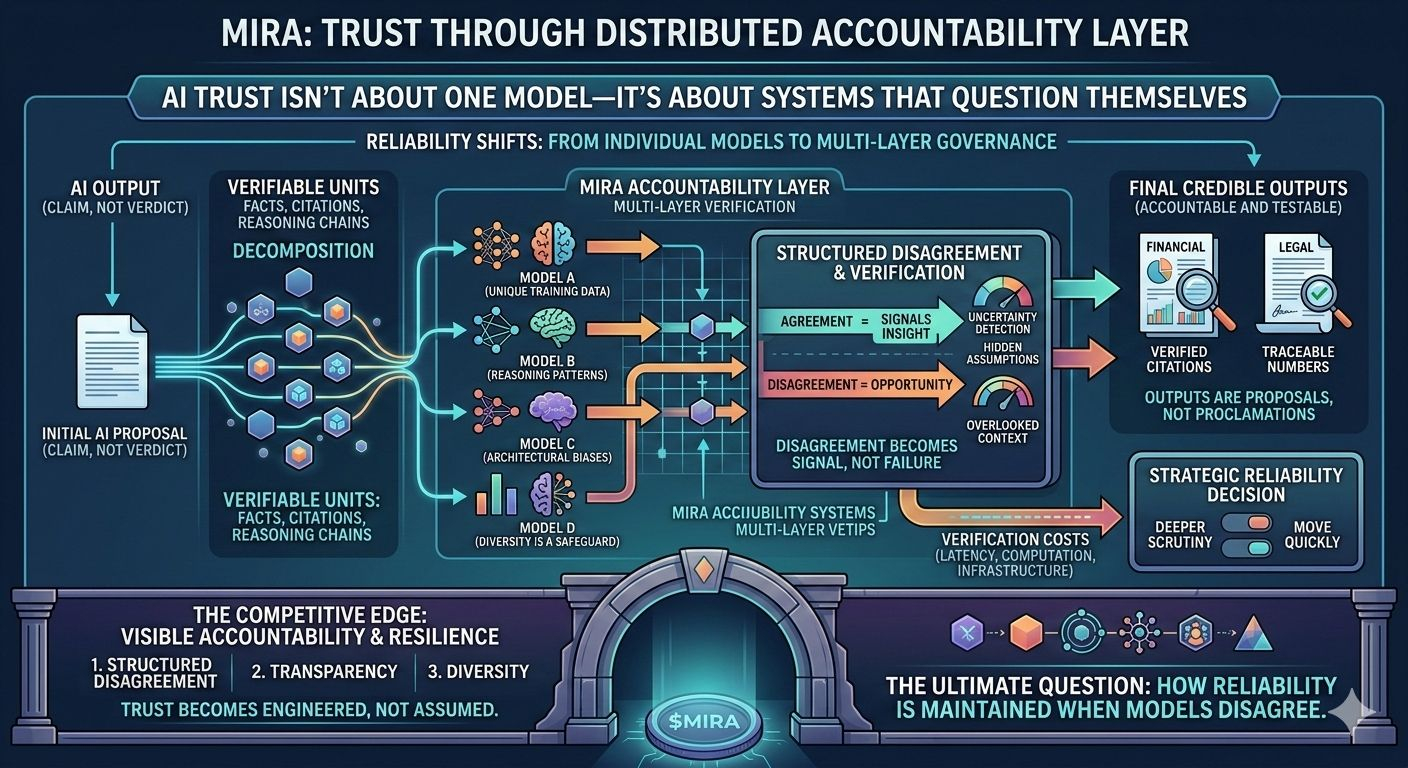

Mira introduce una nueva forma: trata cada salida como un reclamo, no como un veredicto. Múltiples modelos independientes evalúan el mismo reclamo, cada uno aportando datos de entrenamiento únicos, patrones de razonamiento y sesgos arquitectónicos. El acuerdo señala visión, pero el desacuerdo señala oportunidad: oportunidad para detectar incertidumbres, supuestos ocultos o contextos pasados por alto.

En la práctica, las salidas se descomponen en unidades verificables. Un resumen financiero complejo se convierte en números rastreables. Una interpretación legal se transforma en una cadena de razonamiento. La IA no se vuelve mágicamente más inteligente; sus reclamos se vuelven responsables y verificables.

La confianza se desplaza de modelos individuales y se mueve hacia una gobernanza de múltiples capas. Las salidas son creíbles no porque un modelo las produzca, sino porque sistemas independientes llegaron a conclusiones compatibles. La transparencia es crítica: conjuntos de datos superpuestos o arquitecturas similares pueden sesgar el consenso, por lo que la diversidad es una salvaguarda de fiabilidad.

La verificación tiene costos: latencia, computación e infraestructura. Las aplicaciones que integran estas capas deben decidir qué reclamos necesitan un examen más profundo y cuáles pueden avanzar rápidamente. La fiabilidad ya no es un atributo pasivo; es una decisión estratégica incrustada en el diseño del sistema.

La ventaja competitiva para la próxima generación de IA no vendrá de quién responde más rápido o suena más inteligente. Vendrá de la responsabilidad visible, el desacuerdo estructurado y la resiliencia frente a los errores.

La gobernanza multi-modelo de Mira no es solo una característica: es una capa de responsabilidad para la inteligencia de las máquinas. Las salidas se convierten en propuestas, no en proclamaciones. El desacuerdo se convierte en señal, no en fracaso. La confianza se convierte en ingeniería, no en suposición.

La pregunta definitiva no es si los modelos están de acuerdo. Es quién interpola el desacuerdo, qué salvaguardas se activan y cómo se mantiene la fiabilidad. Este es el mundo donde la IA puede ser realmente confiable.

#Mira

@Mira - Trust Layer of AI