Cuando las personas escuchan la frase “IA verificable”, la primera suposición suele ser que se trata de otra actualización técnica diseñada principalmente para ingenieros y equipos de infraestructura, sin embargo, mi reacción inicial es diferente porque el verdadero significado de la verificación no reside dentro de la arquitectura del modelo, sino dentro de los entornos donde las decisiones de IA realmente tienen consecuencias, particularmente en sectores como las finanzas y la atención médica, donde un solo resultado incorrecto puede dar lugar a pérdidas financieras, violaciones regulatorias o riesgos médicos, por lo que el trabajo que está realizando Mira Network se siente menos como una mejora de características y más como un intento de corregir una debilidad estructural en cómo la inteligencia artificial interactúa actualmente con sistemas críticos del mundo real.

La incómoda realidad que muchas instituciones reconocen en silencio es que los modelos de IA modernos son generadores de respuestas extremadamente persuasivos pero no inherentemente fuentes confiables de verdad, porque producen respuestas seguras incluso cuando el razonamiento subyacente está defectuoso o cuando los datos de entrenamiento no respaldan la afirmación que se genera, lo que significa que las industrias construidas alrededor del cumplimiento, la auditoría y la seguridad del paciente no pueden tratar las salidas del modelo como decisiones finales sin construir capas adicionales de verificación alrededor de ellas, y la ausencia de esas capas es precisamente lo que mantiene a muchas instituciones financieras y proveedores de atención médica cautelosos sobre el despliegue de sistemas de IA autónomos más allá de roles experimentales limitados.

Tradicionalmente, la carga de gestionar esta incertidumbre recae en la supervisión humana, donde los analistas revisan las salidas de IA, los auditores revisan los informes automatizados y los clínicos verifican los conocimientos generados por máquinas antes de que influyan en las decisiones de tratamiento, pero ese modelo escala mal porque cuanto más poderoso se vuelve la IA, más datos produce, y cuanto más datos produce, más difícil se vuelve para los humanos validar manualmente cada pieza de información, lo que significa que la promesa de la automatización comienza a chocar con la realidad operativa de que la confianza no puede ser automatizada a menos que la verificación misma se vuelva programable.

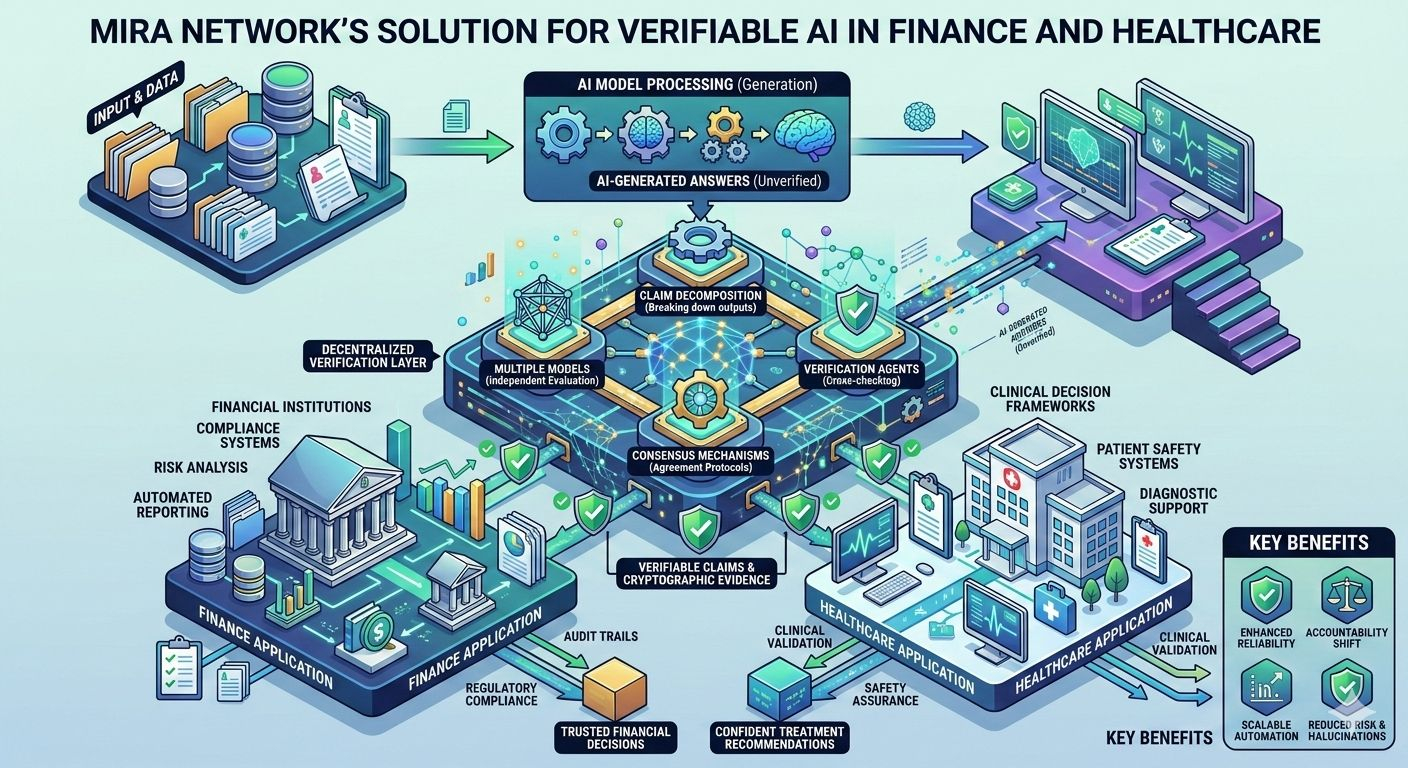

Este es el contexto en el que la arquitectura detrás de Mira se vuelve interesante, porque en lugar de pedir a las organizaciones que simplemente confíen en la salida de un solo modelo, la red reformula las respuestas de IA como un conjunto de afirmaciones verificables que pueden ser evaluadas independientemente por múltiples modelos que operan a través de una capa de verificación descentralizada, lo que transforma efectivamente los resultados de IA de respuestas opacas en declaraciones estructuradas que pueden ser verificadas, desafiadas y validadas a través de mecanismos de consenso que se asemejan a las garantías de fiabilidad comúnmente asociadas con los sistemas de contabilidad distribuida.

Una vez que ese cambio ocurre, la conversación deja de tratar sobre si un modelo individual alucinó y comienza a convertirse en una cuestión de cuán fuertemente una red de agentes de verificación está de acuerdo sobre la precisión de cada afirmación incrustada dentro de una respuesta generada por IA, lo que introduce una estructura de confianza probabilística con la que las instituciones pueden trabajar, porque los sistemas de cumplimiento financiero y los marcos de decisión en atención médica ya dependen de modelos de validación en capas donde múltiples fuentes deben estar de acuerdo antes de que se tomen acciones críticas.

En finanzas, este enfoque aborda directamente un conjunto de problemas que las instituciones encuentran al desplegar IA para tareas como la detección de fraude, la generación automatizada de informes, el análisis de riesgos o el monitoreo del cumplimiento regulatorio, porque aunque los sistemas de IA pueden procesar conjuntos de datos masivos más rápido que los analistas humanos, también introducen la posibilidad de que suposiciones incorrectas o correlaciones fabricadas puedan colarse en decisiones automatizadas, y una capa de verificación descentralizada proporciona un mecanismo para comprobar esas salidas de una manera que se asemeja a cómo las auditorías financieras validan registros a través de revisión independiente en lugar de depender de una sola autoridad.

Los entornos de atención médica revelan una versión aún más sensible del mismo desafío, porque las herramientas de apoyo diagnóstico, los sistemas de documentación clínica y los asistentes de investigación médica dependen cada vez más de la IA para resumir historiales de pacientes, interpretar literatura médica y proponer ideas de tratamiento, sin embargo, las consecuencias de una alucinación no verificada son mucho más serias cuando una recomendación influye en el juicio clínico, lo que significa que los proveedores de atención médica necesitan sistemas que puedan transformar las sugerencias de IA en declaraciones verificables cuya precisión puede ser confirmada antes de ser integradas en los flujos de trabajo de atención al paciente.

Lo que la arquitectura de Mira introduce silenciosamente en esta ecuación es la idea de que la fiabilidad puede convertirse en una propiedad emergente de una red de verificación en lugar de una promesa adjunta a un solo modelo, porque al descomponer salidas complejas en afirmaciones fácticas más pequeñas y distribuir esas afirmaciones entre múltiples evaluadores, el sistema reemplaza la confianza ciega con un acuerdo medible, y ese acuerdo se convierte en una forma de evidencia criptográfica que las organizaciones pueden adjuntar a las salidas de IA cuando se utilizan dentro de entornos operativos sensibles.

Sin embargo, la implicación más profunda de este diseño no es simplemente una precisión mejorada, sino una redefinición de cómo funciona la responsabilidad cuando la IA participa en la toma de decisiones de alto riesgo, porque cuando las salidas son validadas a través de verificación descentralizada, la responsabilidad por la corrección ya no recae completamente en el desarrollador del modelo o en la institución que despliega el modelo, sino que se convierte en parte de la integridad y el rendimiento de la red de verificación que evalúa las afirmaciones producidas.

Este cambio comienza a parecerse a la evolución que los sistemas financieros experimentaron cuando la contabilidad centralizada gradualmente dio paso a marcos de verificación distribuidos, porque la pregunta crítica deja de ser si un sistema puede generar respuestas rápidamente y comienza a ser si la infraestructura circundante puede garantizar que esas respuestas cumplan con los umbrales de fiabilidad requeridos por reguladores, auditores, clínicos y gerentes de riesgo financiero.

Desde una perspectiva de sistemas, la consecuencia más importante es que la verificación se convierte en una capa de infraestructura en lugar de un proceso manual, lo que significa que las organizaciones que integran IA en flujos de trabajo financieros o de atención médica ya no se ven obligadas a elegir entre automatización y fiabilidad, porque la red misma puede hacer cumplir los estándares de validación que de otro modo requerirían supervisión humana constante.

Dicho esto, la verdadera prueba de tal sistema no aparecerá durante las operaciones normales donde las salidas del modelo son en su mayoría precisas y la verificación es rutinaria, sino durante períodos en los que los modelos de IA encuentran datos ambiguos, entradas adversariales o entornos de información en rápida evolución donde las alucinaciones y sesgos se vuelven más probables, porque esos son los momentos en los que la resiliencia de la capa de verificación determina si las instituciones continúan confiando en sistemas automatizados o regresan a procesos más lentos solo humanos.

La importancia estratégica a largo plazo del enfoque de Mira, por lo tanto, no descansa únicamente en si sus mecanismos de verificación funcionan en condiciones ideales, sino en si la red puede mantener una fiabilidad consistente cuando los modelos subyacentes están en desacuerdo, cuando nuevos modelos se unen al ecosistema y cuando las afirmaciones que se evalúan involucran interpretaciones financieras complejas o conocimientos médicos que evolucionan con el tiempo.

Si esa infraestructura demuestra ser capaz de mantener la confianza en esas condiciones, entonces las implicaciones van mucho más allá de aplicaciones individuales de IA, porque las finanzas y la atención médica ganarían un marco en el cual la inteligencia de máquina puede participar en la toma de decisiones sin requerir fe ciega en ningún algoritmo único, y la verdadera pregunta se convierte en no si la IA puede generar respuestas, sino si los sistemas que la rodean pueden demostrar continuamente que esas respuestas merecen ser confiadas.

$MIRA #Mira @Mira - Trust Layer of AI

#OilTops$100 #SolvProtocolHacked #StockMarketCrash $COLLECT $PENGU