*El Momento en que una Respuesta de IA Me Hizo Pausar"

Hoy más temprano estaba revisando un panel de DeFi mientras seguía algunas discusiones de campañas de CreatorPad en Binance Square. Le había pedido a un asistente de IA que resumiera la actividad de liquidez en algunos pools que he estado observando. La respuesta se veía genial a primera vista. Análisis estructurado, razonamiento claro, incluso un pequeño pronóstico sobre dónde podría moverse la liquidez a continuación. Luego revisé los datos en bruto. Una de las suposiciones que hizo la IA estaba ligeramente equivocada. No dramáticamente equivocada, pero lo suficiente como para que su conclusión sobre la dirección del mercado realmente no se sostuviera. Ese momento me recordó algo incómodo sobre los sistemas de IA: son extremadamente buenos para producir respuestas que suenan confiables, incluso cuando la lógica detrás de ellas no es perfecta. Y ese es exactamente el tipo de problema que Mira parece estar tratando de abordar. El Verdadero Problema de Confianza Detrás de las Salidas de IA. En cripto pasamos mucho tiempo hablando sobre descentralización y minimización de confianza. Las blockchains resolvieron el problema de las transacciones al reemplazar la confianza con consenso distribuido. Pero los sistemas de IA todavía operan principalmente en un entorno de alta confianza. Cuando un modelo genera un pedazo de información — un análisis, recomendación o resumen — los usuarios generalmente confían en esa salida sin ningún proceso de verificación. En sistemas centralizados, la empresa que ejecuta el modelo actúa como la autoridad detrás de esa confianza. Una vez que la IA comienza a interactuar con sistemas descentralizados, las cosas se complican. Imagina agentes de IA analizando mercados de DeFi, resumiendo propuestas de gobernanza o generando señales para estrategias de trading automatizadas. Si esas salidas son incorrectas, las consecuencias podrían repercutir a través de aplicaciones descentralizadas. Ahí es donde la arquitectura de Mira se vuelve interesante. En lugar de asumir que las salidas de IA son confiables, introduce una capa de verificación entre la generación y la confianza.

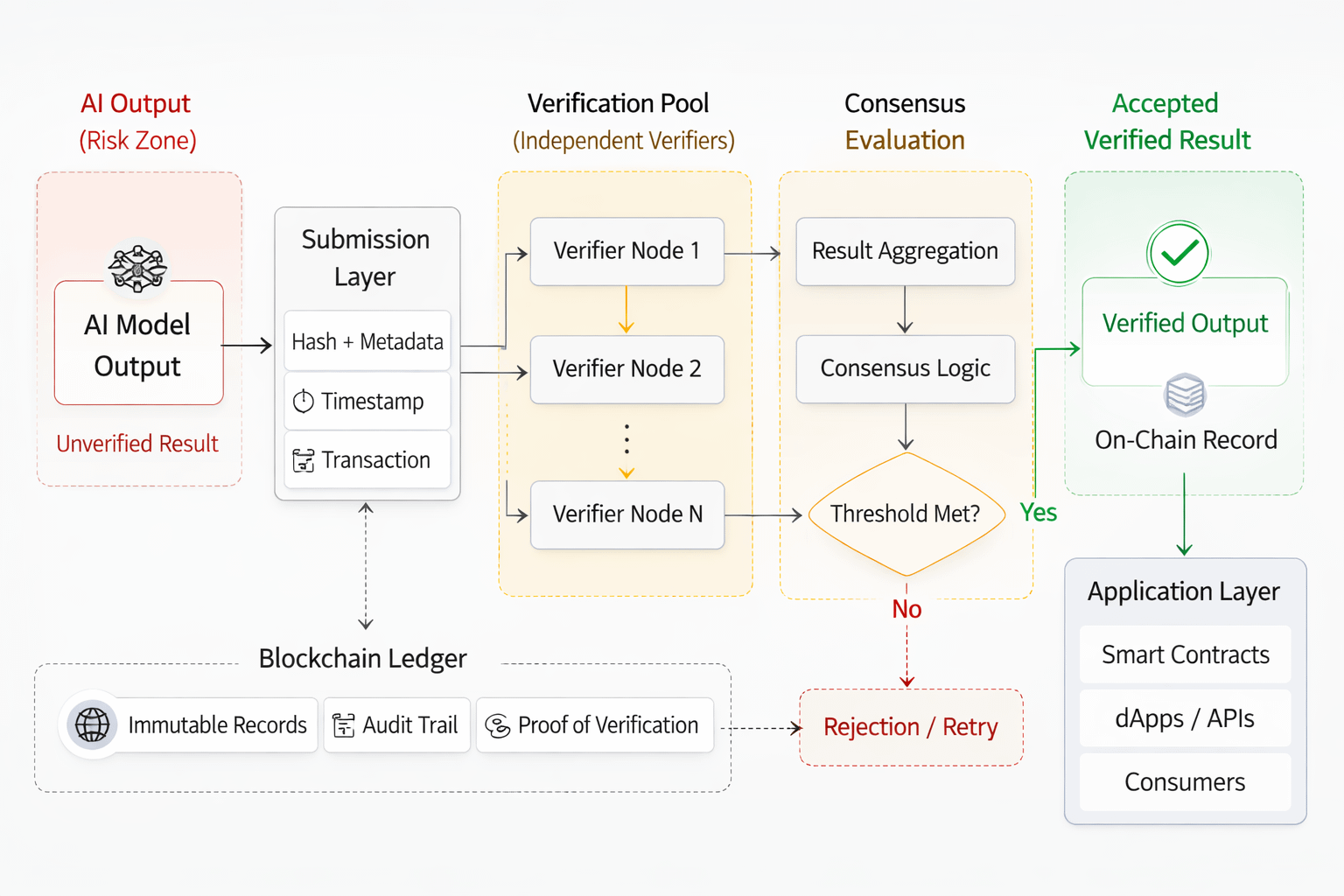

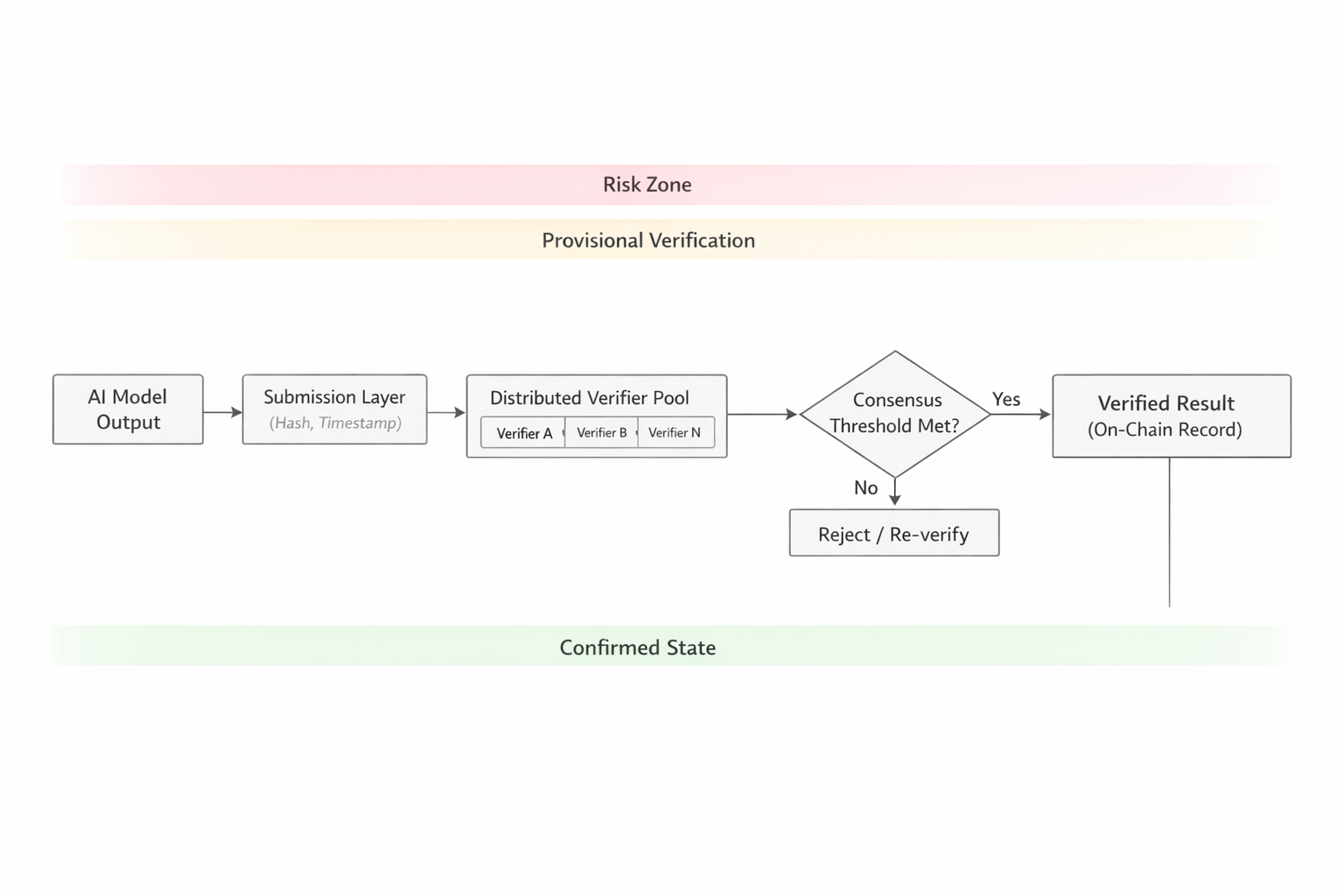

El mecanismo central de Mira: Separando la salida de la aceptación. Al leer las publicaciones de CreatorPad y explorar las referencias documentales compartidas en los hilos de Binance Square, el sistema de Mira funciona dividiendo el proceso en dos etapas. La primera etapa es directa: los modelos de IA producen salidas. Pero esas salidas no son aceptadas de inmediato por la red. En cambio, entran en una fase de verificación donde participantes independientes evalúan el resultado antes de que se convierta en información confiable. El flujo se ve algo así:

Salida de IA → Ronda de Verificación → Acuerdo de Validador → Resultado Aceptado

Mientras estudiaba el diseño, en realidad dibujé un pequeño diagrama de flujo para entenderlo. La estructura me recordó a los pipelines de validación de blockchain, excepto que la red está verificando información en lugar de transacciones. Ese pequeño cambio de diseño podría resultar bastante significativo. Transformando la verificación en una red descentralizada. Uno de los detalles que destaca en el modelo de Mira es la dependencia de múltiples verificadores independientes. En lugar de confiar en una sola entidad para evaluar las salidas de IA, la red distribuye esa responsabilidad entre los participantes. Cada verificador revisa la salida y presenta una evaluación. Si suficientes participantes están de acuerdo en que la información es válida, la red la acepta. Si no, la salida es rechazada o marcada. En esencia, Mira aplica el mismo principio que asegura las blockchain — consenso distribuido — a la evaluación de la información generada por máquinas. Y ese enfoque podría reducir drásticamente la confianza ciega en las salidas de IA. Dónde podría importar esto en aplicaciones reales. Mientras leía las discusiones de campañas de CreatorPad, seguía pensando en agentes de IA operando dentro de sistemas de DeFi. Algunos protocolos ya están experimentando con herramientas de análisis impulsadas por IA que recomiendan asignaciones de cartera o estrategias de liquidez. Si esas herramientas producen razonamientos incorrectos, los usuarios podrían tomar decisiones financieras basadas en información defectuosa. Con la capa de verificación de Mira, esas salidas podrían ser evaluadas por múltiples participantes antes de influir en las aplicaciones. En lugar de confiar directamente en el modelo, la red confirma si el razonamiento se sostiene. Ese paso adicional podría sonar pequeño, pero en sistemas financieros podría reducir significativamente el riesgo. El lado económico de la confianza. Otro aspecto del diseño de Mira que llamó mi atención es el modelo de incentivos. Los participantes que verifican las salidas de IA no solo están realizando una tarea técnica. Son recompensados económicamente por evaluaciones precisas. Eso crea un sistema donde la confianza en sí misma se convierte en un servicio de red. Los desarrolladores de IA generan información. Los verificadores evalúan esa información. Las aplicaciones consumen los resultados verificados. Algunos contribuyentes de CreatorPad han comenzado a referirse a esta estructura como una economía de verificación, donde la validación del conocimiento generado por máquinas se convierte en una actividad productiva. Si el contenido generado por IA continúa expandiéndose a través de ecosistemas de Web3, ese tipo de capa económica podría volverse sorprendentemente valiosa.

Los desafíos que el sistema tendrá que resolver. Por supuesto, la arquitectura plantea algunas preguntas importantes. La verificación no siempre es directa. Algunas salidas de IA implican afirmaciones fácticas que se pueden verificar fácilmente, pero otras implican razonamiento o interpretación. El protocolo necesitará marcos de evaluación confiables para guiar a los verificadores. La velocidad es otra preocupación. Las aplicaciones de IA a menudo operan rápidamente, mientras que las capas de verificación introducen pasos adicionales antes de que se acepten las salidas. También existe el riesgo de problemas de coordinación si los verificadores simplemente copian las respuestas de los demás en lugar de realizar evaluaciones independientes. Estos son desafíos de diseño difíciles, pero también son similares a los problemas de coordinación que enfrentaron las primeras redes blockchain al construir sistemas de consenso. Por qué Mira sigue apareciendo en las discusiones de CreatorPad. Después de pasar tiempo leyendo las publicaciones de campaña de CreatorPad en Binance Square, noté que las discusiones sobre Mira a menudo profundizan más que las conversaciones típicas sobre tokens. La gente no solo pregunta sobre el rendimiento del precio. Están debatiendo cómo los sistemas descentralizados podrían verificar información generada por IA a gran escala. Ese es un tipo de conversación muy diferente. La pregunta más grande detrás del diseño de Mira. Las blockchain transformaron los sistemas financieros al eliminar la necesidad de confiar en intermediarios centralizados. Los sistemas de IA, sin embargo, todavía dependen en gran medida de la confianza. Los usuarios confían en el proveedor del modelo, en los datos de entrenamiento y en la infraestructura que produce las salidas. La arquitectura de Mira insinúa otra posibilidad. En lugar de confiar en la IA ciegamente, las redes podrían verificar la información generada por máquinas de manera colectiva antes de aceptarla. Si la IA continúa integrándose en ecosistemas descentralizados — desde análisis de DeFi hasta herramientas de gobernanza — ese tipo de capa de verificación podría volverse esencial. Y si eso sucede, proyectos como Mira no solo serán experimentos de IA. Podrían convertirse en parte de la infraestructura que define cómo funciona la confianza en la era del conocimiento generado por máquinas.

$ARIA $UAI $MIRA #Mira @Mira - Trust Layer of AI

#creatorpad #LearnWithFatima

#TrendingTopic #Market_Update