Por qué la privacidad no es un pensamiento posterior en una red de verificación, y cómo la arquitectura la protege

Cada vez que envías contenido para verificación, estás compartiendo información. Eso es inevitable, no puedes verificar algo sin que los verificadores lo vean. Pero la forma en que un sistema maneja esa información, quién puede verla, cómo se almacena y qué protecciones existen contra el uso indebido, marca una gran diferencia en si el sistema es confiable en la práctica.

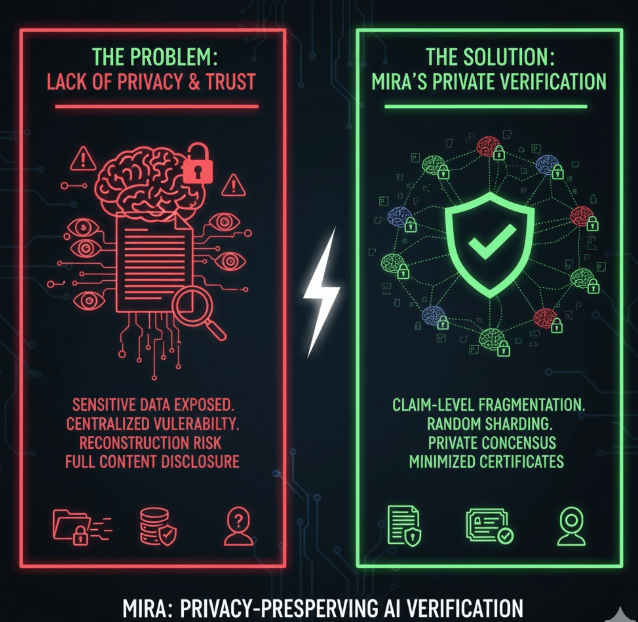

La privacidad es una de las dimensiones más subestimadas de la infraestructura de verificación de IA. Es fácil centrarse en el desafío técnico de lograr un consenso confiable, el desafío económico de incentivar la participación honesta y el desafío filosófico de definir lo que realmente significa "verificado". La privacidad tiende a ser tratada como un simple requisito de cumplimiento en lugar de un requisito de diseño fundamental.

El enfoque de Mira trata la privacidad como un principio arquitectónico central, no como una característica que se agregará más tarde. Las elecciones de diseño que implementan este principio están tejidas en la operación fundamental de la red en lugar de estar atornilladas encima.

La primera y más importante protección de privacidad es el proceso de transformación del contenido en sí. Cuando el contenido se envía para verificación, no se pasa de manera integral a los nodos verificadores. Primero se descompone en pares de entidad-afirmación individuales, afirmaciones discretas y aisladas que pueden ser evaluadas de forma independiente. Estas afirmaciones se distribuyen aleatoriamente a través de la red de nodos, lo que significa que ningún nodo verificador recibe todas las afirmaciones de un dado contenido.

La importancia de esta elección arquitectónica es sustancial. Un nodo verificador que ve solo afirmaciones aisladas no puede reconstruir el contexto completo del contenido que se está verificando. Si envías un documento legal para verificación, ningún operador de nodo ve el documento completo, solo ve afirmaciones individuales extraídas de él, mezcladas con afirmaciones de otros trabajos de verificación que se distribuyen al mismo nodo al mismo tiempo. El todo coherente se fragmenta antes de que salga del entorno del cliente.

Esta protección de privacidad no es algo que los operadores puedan eludir a través de inferencias adicionales. Debido a que las afirmaciones de diferentes trabajos de verificación se distribuyen aleatoriamente juntas, un operador ni siquiera puede distinguir de manera confiable qué afirmaciones provienen del mismo documento fuente. La fragmentación aleatoria crea una incertidumbre genuina sobre la procedencia de cualquier afirmación individual.

La segunda capa de protección de privacidad se refiere al proceso de verificación en sí. Cuando los nodos verificadores evalúan afirmaciones y preparan sus respuestas, esas respuestas se mantienen privadas hasta que se alcanza el consenso. Esto previene la fuga de información durante el proceso de verificación; una divulgación parcial de los resultados de verificación antes de que se alcance el consenso podría revelar información sobre el contenido que se está verificando, incluso si el contenido en sí ha sido debidamente fragmentado.

El momento de la divulgación importa. Los estados de verificación intermedios, la información sobre cómo diferentes nodos están respondiendo a afirmaciones específicas antes de que la red haya alcanzado el consenso, podrían en teoría ser utilizados para reconstruir información sobre el contenido subyacente. Al mantener las respuestas privadas hasta que el consenso esté completo, la red previene este tipo de reconstrucción.

La tercera protección de privacidad es la minimización de datos en la salida final. Cuando la red genera un certificado de verificación para un contenido, ese certificado contiene solo los detalles de verificación necesarios para confirmar el resultado de la verificación. Registra qué afirmaciones fueron verificadas, qué umbral de consenso se aplicó, si se alcanzó el consenso y la prueba criptográfica del proceso de verificación. No contiene el contenido completo de las afirmaciones verificadas, las identidades de los operadores de nodo que participaron, ni ninguna información más allá de lo necesario para validar la autenticidad del certificado.

Este enfoque de minimización es consistente con las mejores prácticas en la regulación de protección de datos a nivel global. El principio de recopilar y almacenar solo los datos mínimos necesarios para el propósito declarado es tanto una buena práctica de privacidad como, cada vez más, un requisito legal en muchas jurisdicciones. El diseño de Mira incorpora el cumplimiento de este principio en la arquitectura fundamental en lugar de requerir que se implemente como un complemento.

Vale la pena ser honesto sobre las limitaciones de la protección de privacidad en la fase inicial del desarrollo de la red. La transformación de contenido en afirmaciones verificables, el proceso de fragmentar y estandarizar contenido candidato antes de la distribución, se maneja de manera centralizada en las primeras etapas de la evolución de la red. Esta centralización crea un punto en el proceso donde el contenido completo existe en una forma coherente antes de la fragmentación. Es un compromiso técnico necesario en las primeras etapas, y representa la principal limitación de privacidad de la arquitectura inicial.

La hoja de ruta de la red incluye la descentralización progresiva de este paso de transformación. El camino técnico implica protocolos criptográficos, computación segura multipartita, pruebas de conocimiento cero y técnicas relacionadas, que permitirían que el contenido se fragmentara sin que jamás existiera en forma completa en un solo entorno computacional. Estas técnicas son lo suficientemente maduras para ser desplegadas, pero introducen complejidad y costos adicionales que las hacen imprácticas en las primeras etapas de la red.

La representación honesta de esta limitación es en sí misma una forma de construir confianza. Los sistemas que afirman tener una privacidad perfecta desde el primer día y luego no logran cumplirla son más perjudiciales para la confianza del usuario que los sistemas que son transparentes sobre sus limitaciones actuales y están comprometidos con una hoja de ruta para la mejora. El enfoque de Mira, reconocer la limitación, comprometerse con la hoja de ruta, construir los cimientos arquitectónicos para futuras mejoras, es más confiable que

una afirmación de privacidad perfecta que sería técnicamente prematura.

Para clientes empresariales con datos particularmente sensibles, registros de pacientes, comunicaciones legales privilegiadas, información financiera propietaria, la arquitectura de privacidad necesita ser evaluada cuidadosamente en función de la sensibilidad del caso de uso específico. La red proporciona protecciones de privacidad significativas, pero no garantías absolutas en la fase actual. La pregunta correcta para los adoptantes empresariales no es "¿es esto perfecto?" sino "¿es esto mejor que nuestras alternativas, y mejora a lo largo de la hoja de ruta que necesitamos?"

Para la mayoría de los casos de uso de verificación, la arquitectura actual proporciona una protección de privacidad sustancial. La fragmentación a nivel de afirmación, el proceso de consenso privado y el formato de certificado minimizado crean juntos un sistema de verificación que revela mucho menos sobre el contenido subyacente que enviarlo para revisión a cualquier experto humano, revisor legal o servicio de IA centralizado.

A medida que la red madura y el paso de transformación se descentraliza a través de protocolos criptográficos, el modelo de privacidad se acercará a algo cercano a garantías de privacidad matemática: verificación sin divulgación. El contenido que se está verificando nunca existirá en forma completa fuera del entorno de la parte verificadora, sin embargo, su precisión será certificada por una red diversa de modelos de IA independientes. Esa combinación, verificada pero privada, es una capacidad genuinamente

nueva que ninguna infraestructura de IA actual proporciona.

La privacidad en la era de la verificación de IA no es solo un problema de cumplimiento legal. Es una cuestión fundamental de si las organizaciones e individuos pueden usar la infraestructura de verificación de IA sin exponer información sensible a los participantes de la red. Hacer esto bien es tan importante como hacer bien la mecánica de verificación. La arquitectura de Mira, con su reconocimiento claro de las limitaciones actuales y su hoja de ruta comprometida hacia protecciones más sólidas, es el enfoque correcto para un problema genuinamente difícil.

@Mira - Trust Layer of AI #Mira $MIRA