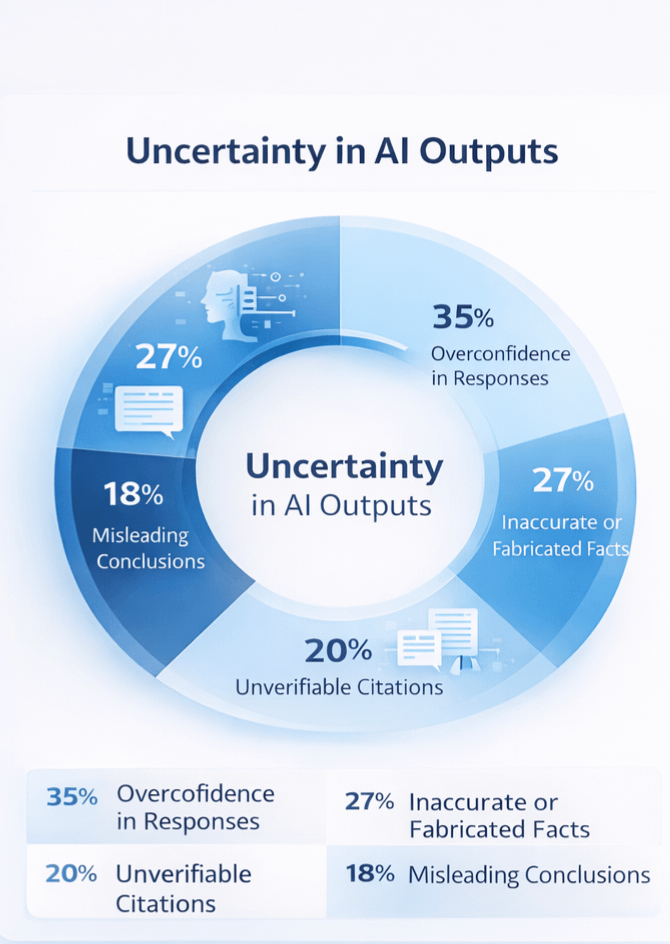

@Mira - Trust Layer of AI Mira Network comienza con una observación bastante simple: la inteligencia artificial moderna produce una enorme cantidad de información, pero la fiabilidad de esa información a menudo sigue siendo incierta. Cualquiera que pase tiempo trabajando con modelos de lenguaje grandes eventualmente lo nota. Las respuestas suenan seguras, estructuradas, a menudo persuasivas. Sin embargo, de vez en cuando aparece algo ligeramente extraño, una estadística que no coincide del todo, una cita que no lleva a ninguna parte, una conclusión que se siente ordenada pero frágil. El problema rara vez es dramático. Es más silencioso que eso, lo que puede ser la razón por la que persiste.

Los sistemas de IA modernos son indudablemente capaces. Resumen artículos de investigación, generan código, analizan documentos, responden preguntas técnicas con sorprendente fluidez. Pasa suficiente tiempo usándolos, sin embargo, y comienza a formarse un patrón. La certeza de las respuestas a veces va por delante de la evidencia que las respalda. Un modelo puede explicar algo claramente, a veces incluso de manera elegante, y aún así caer ligeramente fuera de la verdad.

Lo que suena como una preocupación filosófica se vuelve práctico bastante rápido.

Imagina un sistema de IA produciendo resúmenes de cumplimiento, análisis financieros o investigaciones médicas condensadas. Un pequeño error factual puede moverse a través del sistema casi de manera invisible. El modelo sigue escribiendo. No duda, no señala incertidumbre. El error simplemente se convierte en parte de la salida. En el uso cotidiano, eso puede no importar mucho. Dentro de entornos profesionales, la tolerancia a ese tipo de ambigüedad disminuye rápidamente.

La arquitectura detrás de Mira parece surgir de esa tensión.

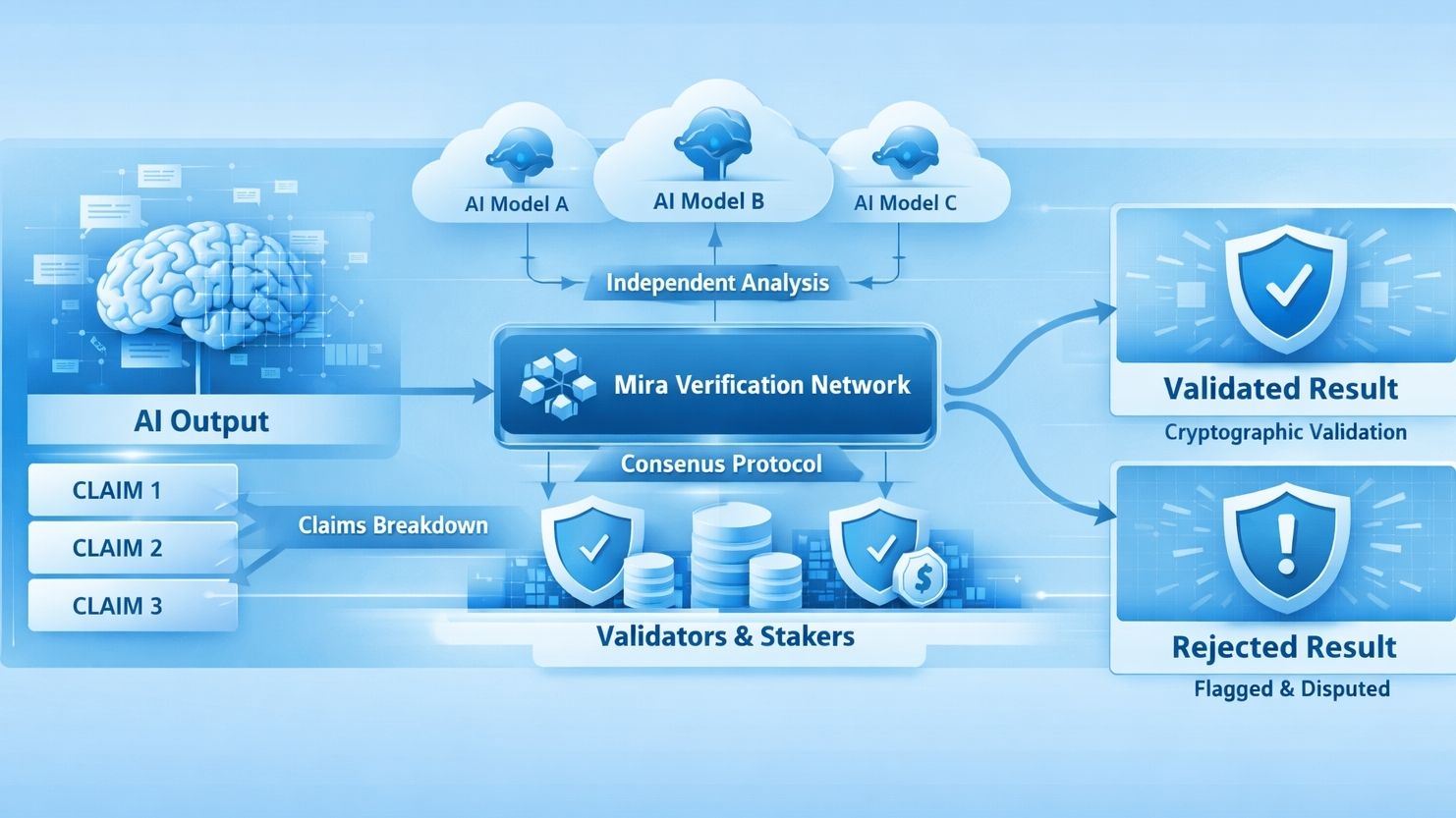

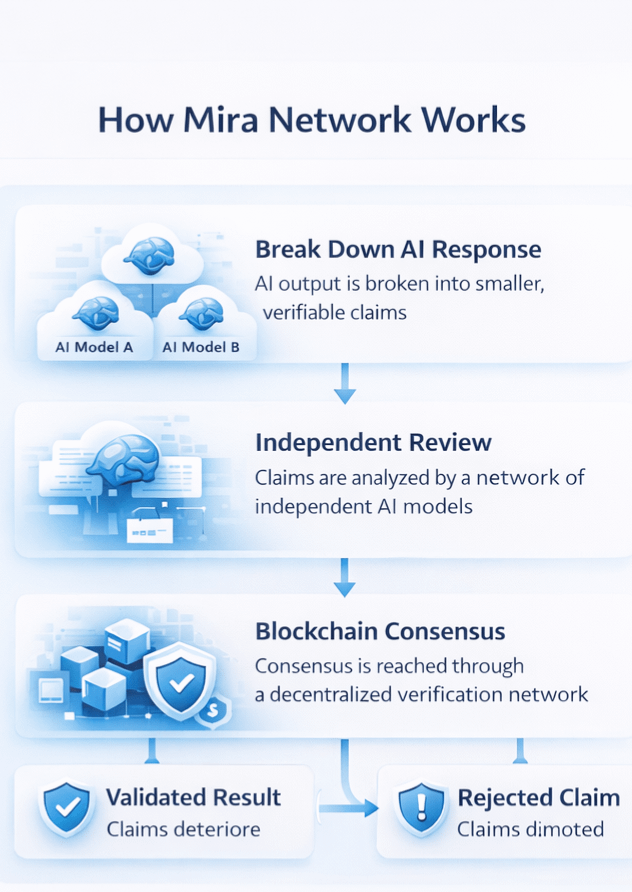

En lugar de tratar las respuestas de IA como respuestas terminadas, el sistema las trata más como reclamaciones que deben ser examinadas. Ese cambio es sutil pero importante. Una respuesta ya no es solo texto, se convierte en una colección de declaraciones más pequeñas que pueden ser evaluadas individualmente.

La mecánica toma un momento para entenderse. No son complicadas exactamente, solo están en capas.

Una respuesta generada se descompone en reclamaciones discretas. Esas reclamaciones se mueven a través de una red distribuida donde modelos de IA independientes intentan evaluarlas. Cada evaluador observa la misma declaración y prueba si parece consistente con la información o patrones de razonamiento disponibles.

Los resultados se coordinan a través del consenso de blockchain. El libro mayor registra cómo se evaluaron las reclamaciones en lugar de simplemente almacenar la salida original.

Un sistema produce información. Otra capa la cuestiona.

El acuerdo entre evaluadores comienza a formar una especie de señal colectiva sobre si una reclamación parece confiable. Interesante en teoría. Pero las preguntas aparecen bastante rápido.

El consenso entre modelos no produce automáticamente verdad. Los sistemas de IA a menudo comparten datos de entrenamiento, suposiciones arquitectónicas y a veces puntos ciegos similares. Si esas debilidades se superponen, múltiples evaluadores podrían reforzar el mismo error en lugar de capturarlo. Las redes de verificación pueden reducir ciertos riesgos, aunque no pueden eliminarlos por completo.

Eventualmente, la conversación regresa a los incentivos.

Sistemas como este no funcionan solo por curiosidad. Se basan en recompensas de tokens y mecanismos de participación que alientan a los participantes a evaluar las reclamaciones de manera honesta. Los validadores y evaluadores tienen una razón financiera para examinar la información cuidadosamente, porque una verificación inexacta podría acarrear consecuencias económicas.

Pero los incentivos en cripto rara vez permanecen estables por mucho tiempo. La participación sube y baja con las condiciones del mercado, los ciclos de liquidez y la relevancia percibida de la red. Si las recompensas se debilitan o la participación de los validadores disminuye, la calidad de la verificación podría deteriorarse silenciosamente. Muchos diseños descentralizados parecen robustos en arquitectura y mucho más delicados una vez que las presiones económicas reales entran en el sistema.

La adopción es donde la discusión se vuelve menos teórica.

Los ingenieros tienden a apreciar las capas de verificación. Los gerentes a veces no. Los incentivos en torno a la complejidad rara vez se alinean. Introducir una red de verificación añade coordinación, pasos adicionales y a veces flujos de trabajo más lentos. Las organizaciones pueden estar de acuerdo con la lógica detrás de las salidas de IA verificadas mientras aún dudan en integrar otra pieza de infraestructura.

Esa tensión puede, en última instancia, dar forma a la trayectoria de redes como Mira.

La idea en sí misma sigue surgiendo cuanto más se considera. A medida que los sistemas de IA se integran en la toma de decisiones profesionales, la cuestión de si se deben confiar en sus salidas deja de ser abstracta. En un sistema como Mira, esa pregunta se traslada a la arquitectura en lugar de seguir siendo responsabilidad de los usuarios individuales.

Si las redes de verificación descentralizadas se convierten en una capa permanente del ecosistema de IA es difícil de predecir. Las tecnologías a menudo parecen convincentes en papel y mucho más complicadas una vez que las personas comienzan a depender de ellas.

Por ahora, Mira se siente menos como una respuesta terminada y más como un intento de explorar una pregunta necesaria. Preguntas como esa rara vez se resuelven rápidamente. Tienden a desarrollarse lentamente, a menudo de maneras que solo se hacen visibles después de que la infraestructura ya ha comenzado a tomar forma.