El espacio cripto está evolucionando cada día desde $BTC y #Ethereum , y ahora tenemos herramientas de IA web3 en el espacio, pero ¿se puede confiar en ellas como en las blockchains que son transparentes y descentralizadas?

Bien, como entusiasta en #SocialMining y cripto, puedo decir que el futuro de la IA depende de la confianza. Y sin transparencia, la IA sigue siendo una caja negra poderosa, pero no verificable.

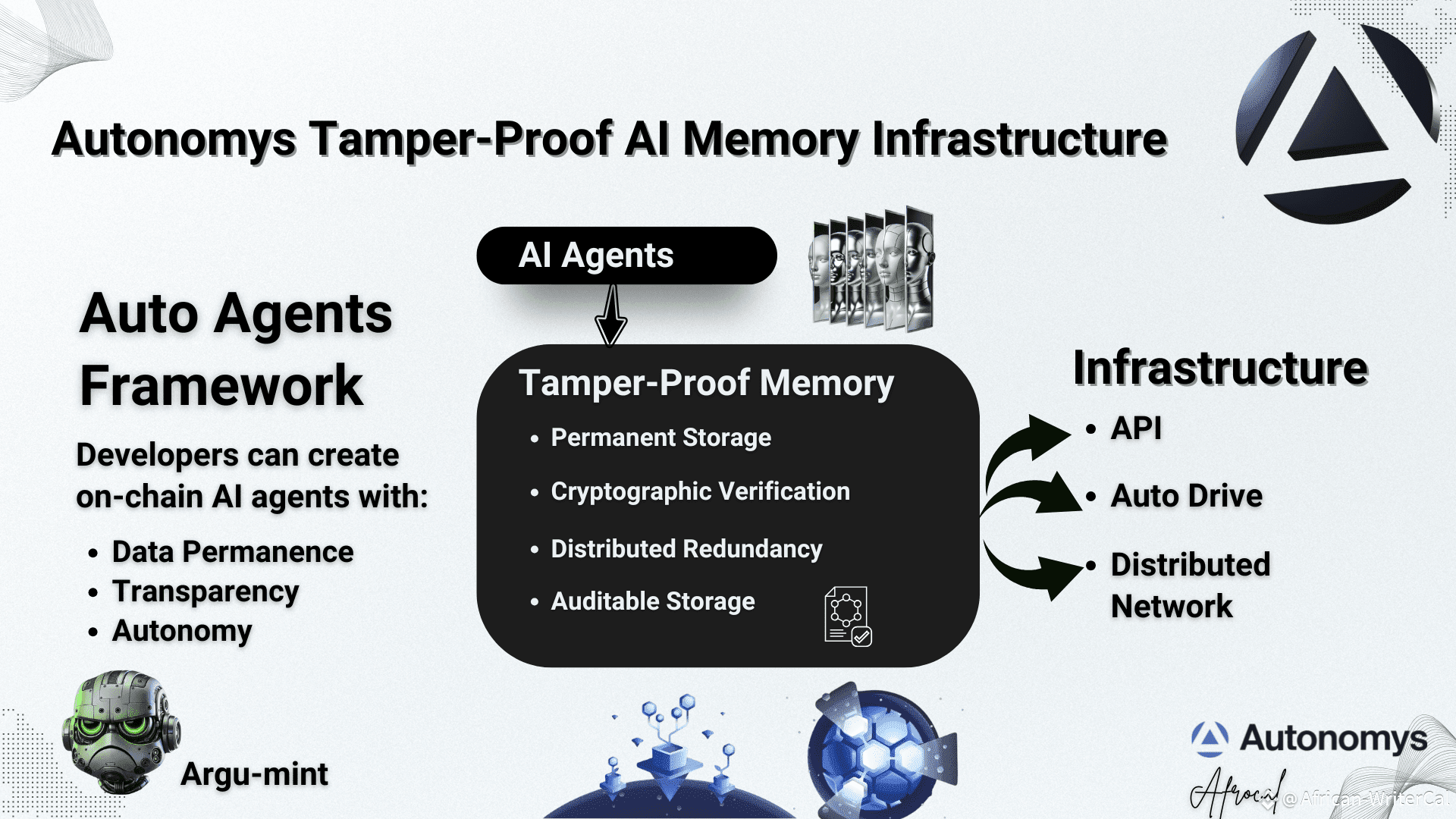

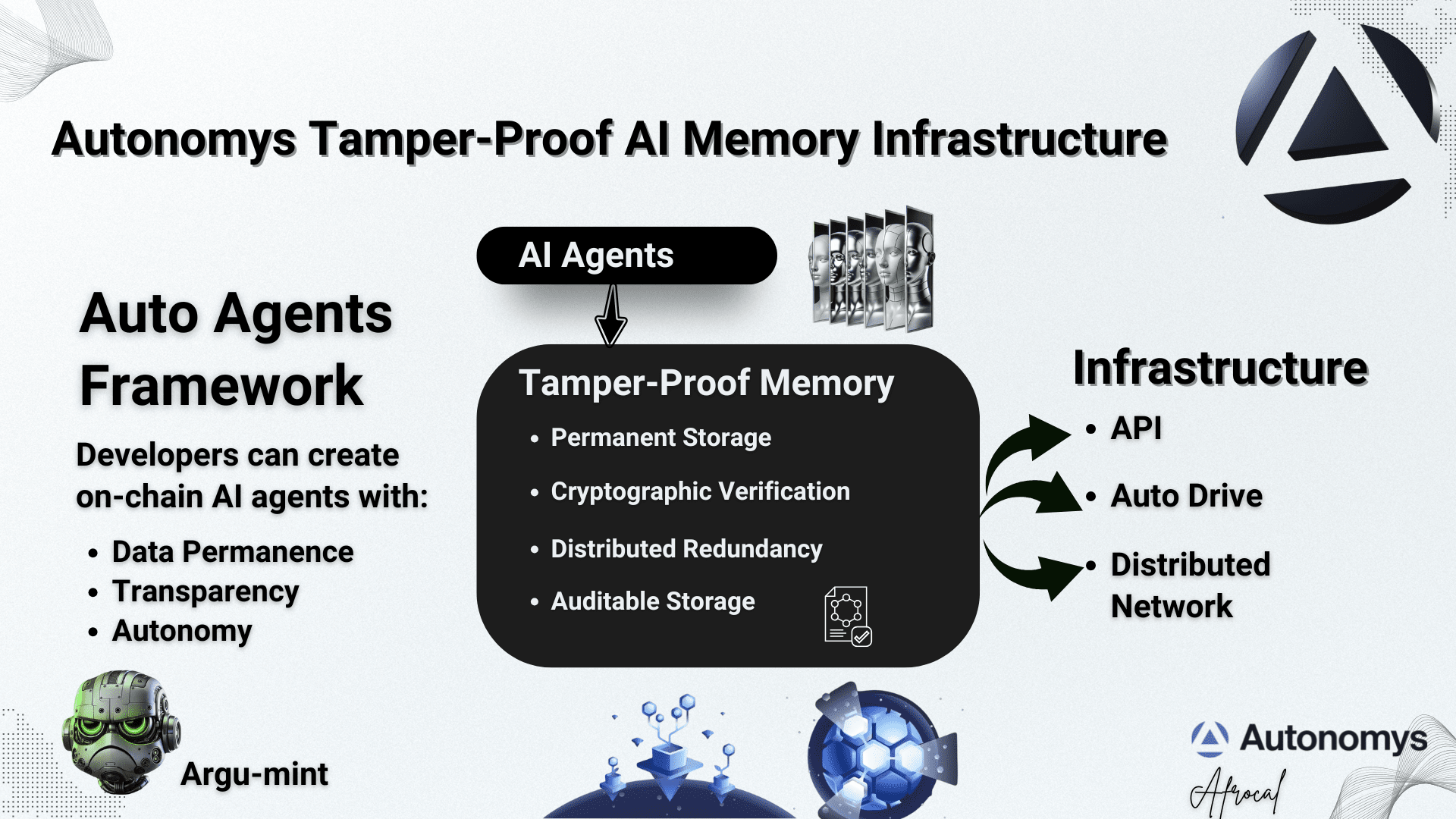

Por eso es importante la memoria a prueba de manipulaciones y consultable. Con las herramientas de código abierto de Autonomys como el Marco de Agentes Automáticos y la API de Conducción Automática, los creadores pueden crear agentes de IA que no solo sean inteligentes, sino también completamente auditables y responsables.

Cada decisión, interacción y proceso de razonamiento se archiva permanentemente en la cadena, asegurando permanencia, transparencia e independencia.

Así es como pasamos de sistemas opacos a una IA en la que realmente podemos confiar.

En el panorama actual de la IA, uno de los problemas más apremiantes es el problema de la caja negra, los sistemas que toman decisiones sin dejar un rastro claro de cómo o por qué. Sin responsabilidad, la confianza en la IA sigue siendo frágil. Por eso creo que una memoria a prueba de manipulaciones y consultable no es solo una innovación, sino una necesidad para el ecosistema de la IA.

#Autonomys aborda este desafío con su Marco de Agentes Automáticos, una arquitectura de código abierto que transforma a los agentes de IA en sistemas transparentes, auditables y confiables. Al archivar permanentemente cada interacción, decisión y proceso de razonamiento en la cadena, estos agentes ya no operan en las sombras. En cambio, crean una memoria accesible públicamente que cualquiera puede estudiar, analizar y verificar.

Este enfoque aborda tres necesidades fundamentales:

• Permanencia: Los datos están asegurados criptográficamente, almacenados de manera redundante y son resistentes a manipulaciones. La IA no puede “olvidar” ni alterar su pasado.

• Transparencia: Las trazas de auditoría revelan exactamente cómo se tomaron las decisiones, permitiendo la verificación en tiempo real y la responsabilidad pública.

• Autonomía: Los agentes operan de manera independiente, libres de control centralizado oculto, mientras permanecen abiertos a la supervisión.

Las herramientas de apoyo hacen que este ecosistema sea práctico para los creadores. La API Auto Drive conecta a los agentes con la cadena de consenso de Prueba de Almacenamiento Archival y la red de almacenamiento distribuido, asegurando que la integridad y el acceso a los datos estén integrados en la infraestructura. Esto empodera a los desarrolladores para centrarse en construir flujos de trabajo inteligentes sin sacrificar la confianza o la responsabilidad.

Un ejemplo en vivo de esta visión es Argu-mint, el primer agente de IA que almacena permanentemente todo su historial de interacciones en la cadena. Su arquitectura que enlaza recuerdos cronológicamente, criptográficamente y de manera transparente demuestra cómo la memoria consultable puede cambiar la IA de una toma de decisiones opaca a un razonamiento abierto y verificable.

Creo que este es el futuro de la IA. Donde los sistemas que recuerdan de manera veraz, razonan de manera transparente y siguen siendo responsables ante sus usuarios. Gracias a infraestructuras de código abierto como Autonomys, nos estamos acercando a un ecosistema donde la IA puede ser tanto poderosa como confiable.

Comparte tus pensamientos a continuación: