大语言模型能写诗、能写代码,却经常在小学数学上翻车?这个困局终于被打破了。

最近看到一个神操作:研究员竟然把一个 WASM(WebAssembly)解释器无损地(Losslessly)“硬编码”进了 Transformer 的模型权重里!

这不仅仅是“模型会用工具”那么简单,这是在 LLM 内部直接运行一台真正的计算机。

💡核心逻辑:像 DSP 芯片一样的混合架构这就好比 TI 的 DSP 架构:

神经网络(ARM): 负责逻辑推理、语义理解和语言组织。

嵌入式解释器(DSP): 专职负责高精度、高速的确定性计算。

当 LLM 遇到 3.11 和 3.8 谁大的问题,它不再是靠“直觉”猜测下一个 Token,而是直接调用内部的计算引擎。

🚀为什么这很重要?

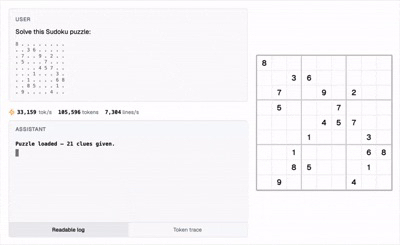

100% 准确率: 连最难的数独(Sudoku)都能秒杀,完全消除计算幻觉。

百万步运行: 程序可以在模型内部运行数百万步,性能炸裂。

全领域应用: 物理模拟、金融建模、密码学运算……这些对精度要求极高的领域,LLM 终于能真正胜任了。

这不再仅仅是“生成式 AI”,这是“原生计算 AI”。人类离真正的通用人工智能(AGI)又近了一步!

#AI #LLM #WebAssembly #Transformer #DeepLearning #AGI