He estado pensando en el problema de descubrimiento de aplicaciones en Midnight durante los últimos días y no puedo quitarme la sensación de que es uno de esos desafíos que está tan lejos de la conversación normal sobre blockchain que las personas que construyen el ecosistema no han confrontado completamente lo que realmente significa para la adopción de usuarios y creo que cuando finalmente se haga visible va a sentirse como una pared que nadie vio venir 😂

déjame explicarte por qué este me llamó la atención porque comienza desde un lugar que suena casi demasiado simple para ser interesante y luego se vuelve genuinamente complicado muy rápido.

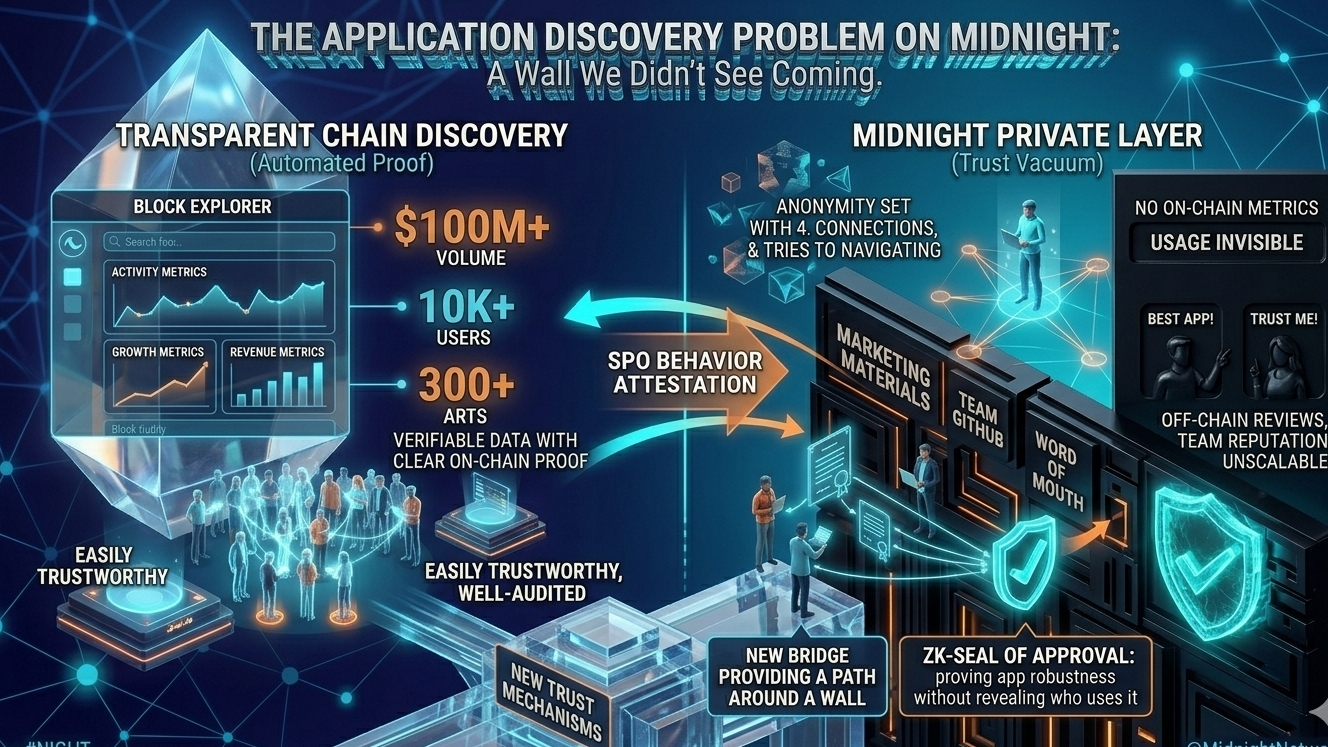

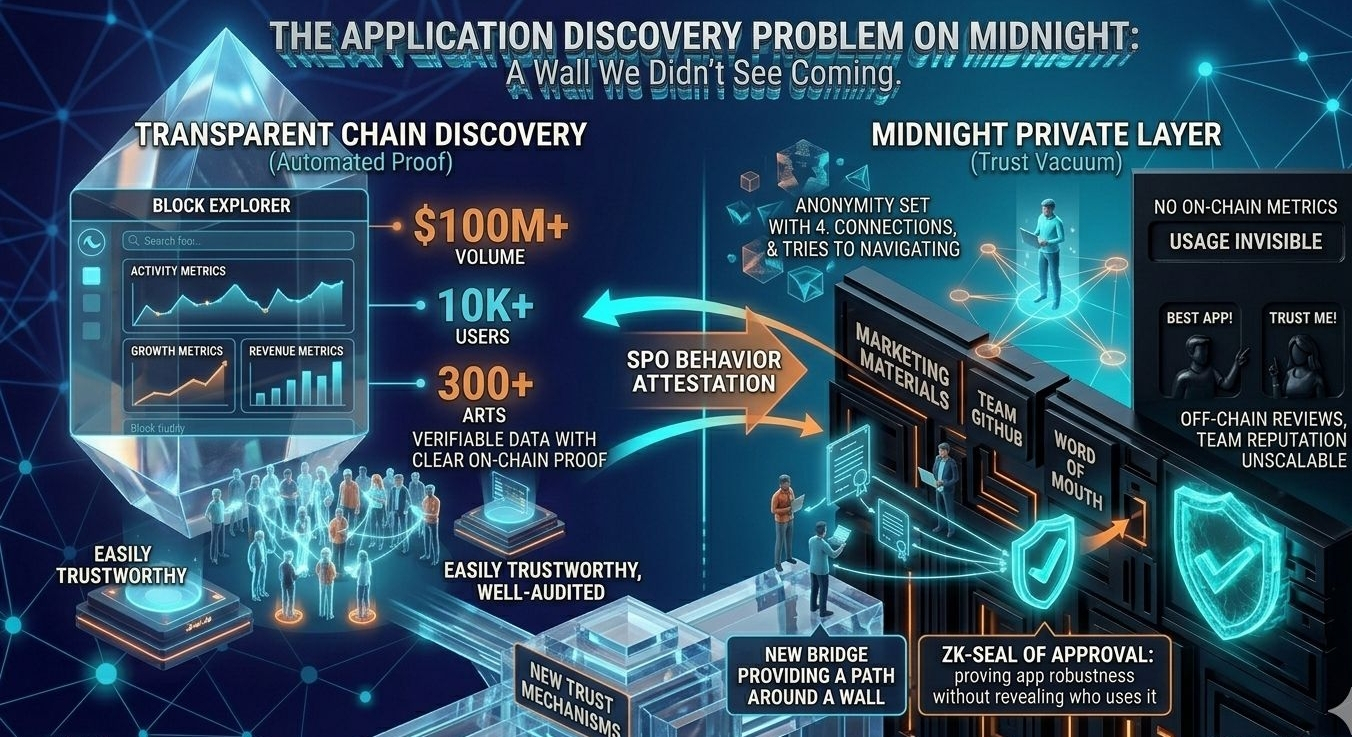

en una cadena transparente, descubrir aplicaciones es sencillo. vas a un explorador de bloques. ves qué contratos están obteniendo más transacciones. ves qué aplicaciones están creciendo. ves métricas de actividad en cadena que te dicen qué protocolos están activos, cuáles están siendo utilizados, cuáles están atrayendo capital, cuáles están muriendo. todo el paisaje competitivo del ecosistema de aplicaciones es visible para cualquiera que sepa cómo leer los datos.

esa transparencia cumple una función para la cual nadie la diseñó explícitamente, pero que resulta ser enormemente valiosa. crea una capa de descubrimiento. los usuarios que buscan aplicaciones pueden ver cuáles están siendo realmente utilizadas por personas reales. los desarrolladores que evalúan si construir pueden ver qué categorías de aplicaciones están desatendidas. los inversores que buscan oportunidades pueden ver qué protocolos están ganando tracción. los periodistas e investigadores pueden informar sobre el crecimiento del ecosistema. la transparencia de la cadena es en sí misma un mecanismo de distribución para aplicaciones.

la capa privada de Midnight destruye completamente esa capa de descubrimiento.

y quiero decir completamente. no parcialmente. no para algunas categorías de información, sino no para otras. completamente.

una aplicación que opera en la capa protegida de Midnight produce casi ninguna señal observable en cadena de su actividad. el número de usuarios que tiene es invisible. el volumen de transacciones que procesa es invisible. la tasa de crecimiento de su base de usuarios es invisible. si está siendo utilizada por una persona o diez mil es invisible. si se lanzó la semana pasada o ha estado en funcionamiento durante dos años es esencialmente indistinguible desde el exterior.

la aplicación privada existe. la evidencia de que se está utilizando no.

ahora piensa en lo que eso significa desde la perspectiva de un usuario tratando de navegar en el ecosistema de aplicaciones de Midnight.

¿cómo decides qué aplicación privada confiar con tus datos sensibles?

en una cadena transparente, miras las métricas en cadena. este protocolo ha procesado cinco mil millones de dólares en volumen durante dos años sin incidentes de seguridad. ese historial es visible y verificable. la cadena misma es la señal de confianza.

en Midnight, la cadena no puede proporcionar esa señal. el historial de uso de la aplicación es privado. su volumen de transacciones es privado. su retención de usuarios es privada. la evidencia que normalmente construiría confianza en una aplicación financiera o sensible a la privacidad es exactamente la evidencia que el modelo de privacidad está diseñado para suprimir.

entonces, ¿cómo se ve realmente la construcción de confianza para una aplicación de Midnight?

la primera respuesta que la mayoría de la gente busca es la reputación. el equipo de desarrollo tiene una reputación pública. han publicado su código. tienen una historia en el ecosistema. confías en la aplicación porque confías en las personas que la construyeron.

eso funciona para los primeros adoptantes en la comunidad técnica que conocen a los desarrolladores personalmente o por reputación. no escala. la gran mayoría de los usuarios que eventualmente usarán aplicaciones de Midnight no van a investigar la historia de GitHub del equipo de desarrollo antes de decidir si confiar en una aplicación con sus datos médicos privados o sus registros financieros privados. necesitan señales de confianza que sean accesibles sin experiencia técnica y legibles sin contexto de la industria.

en una cadena transparente, esas señales de confianza accesibles y legibles provienen de métricas en cadena. volumen de uso. longevidad. ausencia de exploits. estas son cosas que los usuarios no técnicos pueden entender y actuar incluso sin saber nada sobre el diseño técnico de la aplicación.

en Midnight, ninguna de esas señales existe para aplicaciones privadas.

la segunda respuesta que la gente busca son las auditorías. auditorías de seguridad de terceros del código de la aplicación. si una firma de auditoría respetable ha revisado el código y no ha encontrado problemas críticos, esa es una señal de confianza significativa que no depende de la transparencia en cadena.

las auditorías son reales y importan. pero tienen limitaciones importantes como mecanismo principal de confianza para una amplia base de usuarios.

las primeras auditorías son caras. no todas las aplicaciones legítimas pueden permitirse una auditoría integral de una firma de primer nivel, especialmente en las primeras etapas de desarrollo. la barrera para obtener una auditoría creíble crea una ventaja de costo para aplicaciones bien capitalizadas y una desventaja para desarrolladores más pequeños con buenas ideas pero recursos limitados.

las segundas auditorías certifican el código en un momento específico. no proporcionan garantía continua de que la aplicación se comporta como se pretende. una aplicación que pasó una auditoría hace dos años y ha sido actualizada múltiples veces desde entonces no es la misma que una aplicación que pasó una auditoría la semana pasada.

tercero y más importante, las auditorías evalúan si el código hace lo que afirma hacer. no evalúan si lo que el código afirma hacer es realmente lo que los usuarios necesitan que haga. una aplicación puede ser técnicamente correcta y aún estar diseñada de maneras que socavan sutilmente la garantía de privacidad que afirma ofrecer a través de elecciones arquitectónicas que ninguna auditoría marcaría como incorrectas.

la tercera respuesta es la reputación de la comunidad. el boca a boca dentro del ecosistema. prueba social de voces confiables que han evaluado y recomendado aplicaciones específicas.

la reputación de la comunidad funciona en comunidades unidas donde las redes de confianza son densas y la información fluye rápidamente. se descompone a medida que la comunidad crece y a medida que la relación señal-ruido en los canales de la comunidad se degrada. en un gran ecosistema con muchas aplicaciones y muchas voces, la reputación de la comunidad se vuelve difícil de agregar de manera confiable y fácil de manipular a través de promociones coordinadas.

y aquí está el modo de falla específico que más me preocupa.

la ausencia de señales de descubrimiento en cadena crea un vacío. y los vacíos se llenan. el vacío que crea la capa privada de Midnight en el espacio de descubrimiento de aplicaciones será llenado por marketing fuera de la cadena. por las aplicaciones que pueden gastar más en visibilidad en lugar de por las que tienen el uso más genuino. por promoción de influencers y contenido pagado y prueba social fabricada que imita señales de confianza orgánicas sin la sustancia subyacente.

en una cadena transparente, el marketing tiene que competir con la realidad en cadena. puedes gastar mucho en promoción, pero los usuarios pueden verificar las métricas y ver si el uso coincide con la exageración. la cadena es un mecanismo de rendición de cuentas para las afirmaciones sobre la calidad y adopción de la aplicación.

en la capa privada de Midnight no hay un mecanismo de rendición de cuentas en cadena para las afirmaciones de marketing sobre el uso de aplicaciones privadas. una aplicación que afirma tener miles de usuarios activos no puede ser verificada o falsificada al mirar la cadena. el diseño de privacidad que protege a los usuarios legítimos también protege las afirmaciones engañosas sobre la adopción de aplicaciones.

esa asimetría entre las afirmaciones de marketing y la realidad verificable no es un problema pequeño. es una característica fundamental de cómo funciona la información en sistemas privados y tiene serias consecuencias para cómo se desarrollan las dinámicas competitivas del ecosistema de aplicaciones.

las aplicaciones que ganen cuota de mercado en el temprano ecosistema de Midnight serán las que tengan el mejor marketing y la presencia de marca más confiable, no necesariamente las que tengan el mejor diseño o el uso más genuino. eso es cierto hasta cierto punto en cada mercado, pero es mucho más cierto en mercados donde la verificación en cadena de las afirmaciones de uso es imposible.

sigo pensando en cómo podría ser en realidad una infraestructura legítima para el descubrimiento privado de aplicaciones.

una dirección es la prueba de transparencia voluntaria. aplicaciones que quieren construir confianza publican pruebas ZK de sus métricas de uso agregadas. no los datos de transacciones individuales. no la información privada del usuario. solo hechos agregados demostrables. esta aplicación ha procesado más de diez mil usuarios únicos. esta aplicación ha estado funcionando continuamente durante más de dieciocho meses. el volumen de transacciones de esta aplicación ha crecido más del veinte por ciento mes a mes durante los últimos seis meses.

esos hechos agregados pueden probarse con pruebas ZK sin revelar nada sobre usuarios individuales. una aplicación que publica pruebas agregadas creíbles de su uso está proporcionando señales de confianza en las que los usuarios pueden actuar sin comprometer la privacidad de ningún individuo.

la complicación es que las pruebas de transparencia voluntarias son voluntarias. las aplicaciones con métricas genuinas y fuertes tienen todo el incentivo para publicarlas. las aplicaciones con métricas débiles no tienen ningún incentivo para publicarlas y pueden preferir permanecer opacas. la distribución de aplicaciones que publican pruebas voluntarias no es una muestra aleatoria de todas las aplicaciones. es una selección de las aplicaciones con las mejores métricas, lo que parece una señal útil hasta que te das cuenta de que la ausencia de una prueba voluntaria es en sí misma informativa y los actores maliciosos sofisticados encontrarán formas de generar pruebas de métricas que parezcan plausibles pero que no reflejan el uso genuino.

otra dirección es la infraestructura de reputación a nivel de ecosistema. un sistema descentralizado donde los usuarios pueden atestiguar su experiencia con aplicaciones específicas de una manera que se agrega y se hace pública sin revelar identidades individuales. un sistema de revisión que preserva la privacidad donde la señal de calidad agregada es pública, aunque cada revisor individual sea anónimo.

eso es técnicamente alcanzable. también es un desafío de gobernanza y un desafío de diseño de incentivos. quién ejecuta la infraestructura de reputación. cómo se detectan y filtran los intentos de manipulación. cómo evitas la manipulación coordinada de las puntuaciones de reputación. estos no son problemas insolubles, pero requieren inversión y un diseño cuidadoso que va más allá de lo que cualquier desarrollador de aplicaciones individual puede proporcionar por su cuenta.

la tercera dirección es algo que encuentro genuinamente interesante y que no he visto discutido en ningún lugar. es la idea de la atestación del comportamiento de la aplicación a través de los SPO.

los SPO procesan transacciones. pueden observar ciertas cosas sobre los patrones de transacciones a nivel de bloque sin ver el contenido de las transacciones. saben cuántas transacciones se procesaron en cada bloque. conocen la distribución del tiempo. conocen la distribución de tarifas. saben qué aplicaciones recibieron transacciones y cuándo.

un SPO que ha estado procesando bloques de Midnight durante dos años ha observado la historia de comportamiento de cada aplicación en la red a nivel de bloque. no el contenido, sino el patrón. esa observación del comportamiento podría potencialmente agregarse en una señal de confianza que se basa en la observación directa de los participantes de la red en lugar de métricas auto-reportadas o auditorías de terceros.

las métricas de comportamiento de la aplicación atestiguadas por SPO serían difíciles de falsificar porque falsificarlas requeriría convencer a múltiples SPO independientes para que atestiguen información falsa. la naturaleza descentralizada de la base de atestiguación es en sí misma una propiedad de confiabilidad.

la complicación es que la observación a nivel de SPO de los patrones de transacciones de la aplicación es la misma metadata de la que me preocupaba como vector de ataque a la privacidad en análisis anteriores. la información que es útil para construir señales de confianza de aplicaciones también es información que es útil para ataques de inferencia contra el estado privado. los mismos datos sirviendo a dos propósitos completamente diferentes con implicaciones completamente diferentes, dependiendo de quién los está utilizando y por qué.

esa tensión no tiene una resolución limpia. cada mecanismo para construir confianza en aplicaciones en un ecosistema privado crea alguna información que teóricamente podría usarse para reducir la privacidad. la cuestión de diseño es si el beneficio de confianza vale el costo de inferencia y cómo estructurar el mecanismo para maximizar el valor de confianza mientras se minimiza la fuga de privacidad.

quiero ser directo sobre algo aquí porque creo que es el punto más urgentemente práctico de todo esto.

el problema del descubrimiento de aplicaciones no es un problema que se resuelva por sí solo a medida que el ecosistema madura. en los ecosistemas de cadenas transparentes, la infraestructura de descubrimiento surgió orgánicamente porque los datos subyacentes estaban disponibles públicamente y los emprendedores construyeron herramientas sobre ello. exploradores de bloques, plataformas de análisis, rastreadores de portafolios, agregadores de rendimiento que comparan rendimientos a través de protocolos: toda esta infraestructura se construyó sola porque los datos estaban ahí para construir.

en la capa privada de Midnight, los datos no están ahí. la infraestructura no puede construirse a partir de datos disponibles porque los datos relevantes son exactamente lo que el diseño de privacidad suprime. la infraestructura de descubrimiento para la capa privada tiene que ser construida deliberadamente por personas que entienden tanto las limitaciones de privacidad como los requisitos de confianza del usuario y que están dispuestas a invertir en un problema que no es tan emocionante como la arquitectura criptográfica, pero es igual de importante para que los usuarios comunes puedan navegar por el ecosistema de manera segura.

sin esa inversión deliberada, el ecosistema de aplicaciones de Midnight enfrenta un vacío de confianza que será llenado por el marketing en lugar de por el mérito. las aplicaciones que ganen serán las que tengan la mayor visibilidad, no las que tengan el valor más genuino. y los usuarios que más necesitan la garantía de privacidad, los que confían en aplicaciones privadas con su información más sensible, no tendrán una forma confiable de distinguir entre las aplicaciones que valen la pena confiar y las que no.

las pruebas de conocimiento cero protegen los datos dentro de las aplicaciones.

no pueden proteger a los usuarios de elegir la aplicación equivocada en primer lugar.

y en este momento, el ecosistema de Midnight no tiene la infraestructura para ayudar a los usuarios a tomar esa decisión bien. 🤔