Recuerdo estar en un almacén logístico de tamaño mediano en las afueras de una ciudad portuaria hace unos años, observando un envío sentado inactivo durante horas. No había nada físicamente mal. Los bienes estaban intactos, la ruta estaba despejada y el destino estaba listo. El retraso se redujo a algo menos visible: un sistema no podía verificar una credencial emitida por otro. La certificación de un conductor, un registro de despacho aduanero, un documento de cumplimiento existían en algún lugar, pero ninguno de los sistemas involucrados podía estar de acuerdo, lo suficientemente rápido, en que eran válidos. Lo que me sorprendió no fue el retraso en sí, sino lo ordinario que se sentía para todos allí.

He visto versiones de ese mismo problema en diferentes industrias desde entonces. En finanzas, los retrasos en la incorporación a menudo se remontan a verificaciones de identidad fragmentadas. En las cadenas de suministro, el seguimiento de la procedencia todavía depende de capas de validación manual. Incluso en sistemas digitales, donde los datos deberían moverse sin fricción, la confianza no viaja con la misma facilidad. La información se mueve rápido, pero la verificación se queda atrás. Y cuando la verificación se queda atrás, todo lo demás se ralentiza.

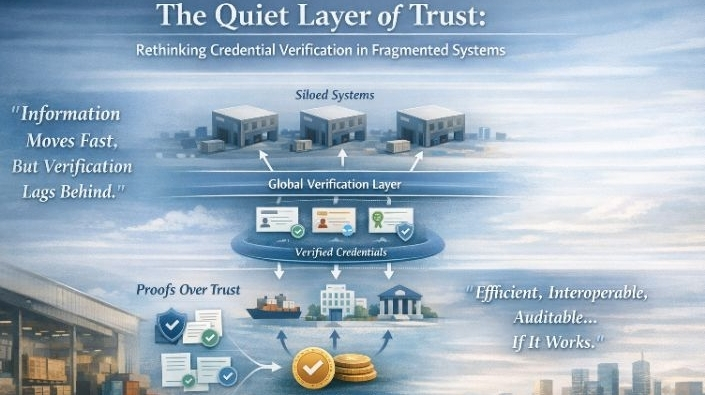

Este es el problema estructural más amplio que sigue resurgiendo: hemos construido sistemas altamente eficientes para transmitir datos, pero no para establecer confianza en esos datos a través de fronteras. Cada organización, plataforma o jurisdicción tiende a mantener sus propios estándares para credenciales y verificación. La interoperabilidad existe en teoría, pero en la práctica es frágil. Lo que terminas teniendo es un mosaico de sistemas que pueden almacenar y enviar información, pero luchan por ponerse de acuerdo sobre si esa información es confiable.

Es en este contexto que la idea de una infraestructura global para la verificación de credenciales y la distribución de tokens comienza a volverse interesante. No como una gran solución a todo, sino como un intento de abordar una capa muy específica del problema: ¿cómo hacemos que las pruebas sean portátiles, verificables y utilizables en sistemas que no confían inherentemente entre sí?

El proyecto en cuestión no se posiciona como un reemplazo de los sistemas existentes. Al menos, esa no es mi interpretación. En cambio, se siente más como un experimento en construir una capa de verificación compartida, algo que se sitúa entre sistemas aislados y les permite coordinarse en torno a las credenciales sin necesidad de una profunda integración o acuerdos de confianza mutua. Esa distinción importa. He visto demasiados proyectos fracasar porque intentaron reconfigurar industrias enteras en lugar de enfocarse en un pedazo estrecho y componible de infraestructura.

En su esencia, la idea es relativamente simple, incluso si la implementación no lo es. Una credencial, ya sea un certificado, una licencia, un registro de cumplimiento o alguna forma de identidad, se representa en un formato estandarizado y criptográficamente verificable. Esta credencial puede ser emitida, transferida y verificada en diferentes sistemas sin requerir que cada sistema valide independientemente su origen desde cero. Los tokens, en este contexto, no son solo unidades de valor; actúan como portadores de prueba.

Lo que hace que este enfoque sea diferente de las bases de datos tradicionales es que la lógica de verificación está incrustada en la propia infraestructura. En lugar de preguntar, “¿Confío en el sistema que me dio estos datos?”, la pregunta se convierte en, “¿Puedo verificar la prueba adjunta a estos datos?” Ese cambio suena sutil, pero cambia la forma en que los sistemas interactúan. La confianza pasa de ser basada en instituciones a ser basada en pruebas.

He notado que muchas personas subestiman cuán importante es ese cambio. En la mayoría de los flujos de trabajo actuales, la verificación es un proceso externo. Implica verificar con autoridades, consultar bases de datos o depender de intermediarios. Es lento porque no es componible. Cada nueva interacción requiere una nueva ronda de validación. Lo que este tipo de infraestructura intenta hacer es hacer que la verificación sea más como una función reutilizable, algo que puede ejecutarse rápida y consistentemente en diferentes contextos.

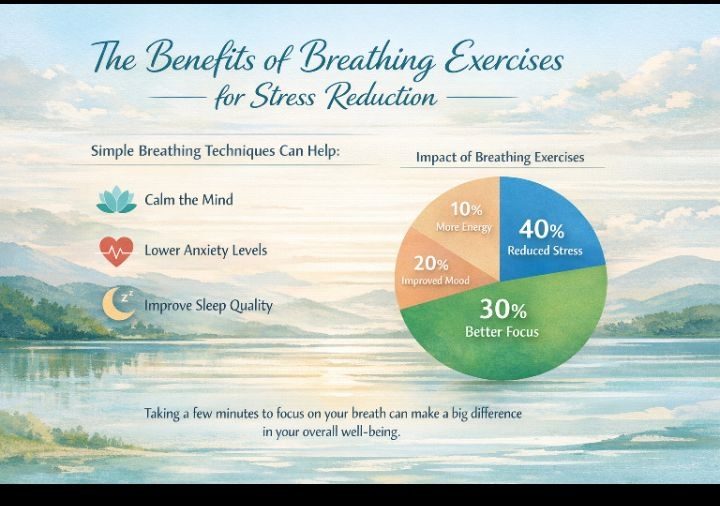

Hay fortalezas prácticas en este enfoque, asumiendo que funciona como se pretende. Una es la eficiencia. Si las credenciales pueden ser verificadas instantáneamente y de manera confiable, desaparece toda una clase de retrasos. Otra es la interoperabilidad. Los sistemas que antes estaban aislados pueden comenzar a interactuar sin necesidad de integraciones a medida para cada nuevo socio. También hay un elemento de audibilidad. Cuando las pruebas están estandarizadas y son rastreables, se vuelve más fácil entender cómo se llegó a una decisión o estado particular.

Puedo ver por qué esto podría atraer a industrias donde el cumplimiento y la coordinación son desafíos constantes. Las cadenas de suministro son un ejemplo obvio, pero también lo son áreas como la atención médica, las finanzas e incluso los sistemas autónomos. En cualquier lugar donde tengas múltiples actores que dependen de información compartida, la capacidad de verificar esa información rápidamente se vuelve valiosa.

Dicho esto, soy cauteloso sobre hasta dónde puede llegar esto en la práctica. He estado alrededor el tiempo suficiente para ver ideas similares luchar cuando se encuentran con restricciones del mundo real. Uno de los mayores desafíos es la adopción. Para que una infraestructura de verificación sea útil, necesita una amplia participación. Si solo un puñado de entidades emiten credenciales en este formato, el efecto de red sigue siendo débil. Y convencer a instituciones establecidas para que cambien la forma en que emiten y gestionan credenciales no es trivial.

También está la cuestión de los estándares. La interoperabilidad depende del acuerdo, y el acuerdo a menudo es lento. Las diferentes industrias tienen diferentes requisitos, y alinearlos bajo un único marco puede ser difícil. Incluso si la tecnología funciona, la gobernanza se convierte en un cuello de botella. ¿Quién decide qué cuenta como una credencial válida? ¿Cómo se resuelven las disputas? Estas no son preguntas puramente técnicas.

El rendimiento es otra preocupación que tiende a pasarse por alto en las discusiones iniciales. La verificación a gran escala no se trata solo de corrección; se trata de velocidad y costo. Si la infraestructura introduce latencia o complejidad, corre el riesgo de recrear las mismas ineficiencias que intenta eliminar. He visto sistemas que parecían elegantes en papel, pero lucharon bajo la carga del mundo real.

Los incentivos también juegan un papel. Para que este tipo de sistema se mantenga, los participantes necesitan una razón para utilizarlo más allá de las ganancias de eficiencia abstractas. Los mecanismos de distribución de tokens pueden ayudar a alinear incentivos, pero también introducen sus propias complejidades. Si el modelo económico no está bien diseñado, puede llevar a comportamientos que socavan la integridad del sistema.

Otro punto de escepticismo proviene de patrones históricos. Hemos visto oleadas de proyectos intentando construir capas “universales” para la identidad, el intercambio de datos o la verificación. Muchos de ellos fracasaron no porque la idea fuera defectuosa, sino porque se subestimó la coordinación requerida. Es una cosa construir un sistema técnicamente sólido; es otra hacer que diversos interesados lo adopten y confíen en él.

Aún así, no creo que eso invalide el intento. Si acaso, resalta por qué enfocarse en una capa específica: la verificación de credenciales y las pruebas tokenizadas, podría ser un enfoque más realista. En lugar de tratar de resolver todo, el proyecto limita su alcance a un problema que es tanto persistente como bien definido.

En términos de implicaciones en el mundo real, puedo imaginar que esto sea más útil en entornos donde la verificación es frecuente y costosa. El cumplimiento regulatorio es un área. Si las organizaciones pueden compartir credenciales verificables sobre su estado, las auditorías podrían volverse menos intrusivas. En logística, el seguimiento de la procedencia podría volverse más confiable, reduciendo disputas y retrasos. En finanzas, los procesos de incorporación podrían volverse más fluidos si las credenciales de identidad y cumplimiento pueden reutilizarse entre instituciones.

También hay un ángulo interesante en las tecnologías emergentes. A medida que los sistemas se vuelven más autónomos, ya sea en robótica, IoT o flujos de trabajo impulsados por IA, la necesidad de credenciales legibles por máquina y verificables aumenta. Los humanos pueden tolerar ambigüedad y retrasos en la verificación; las máquinas no pueden. Una infraestructura que permita la verificación automatizada podría convertirse en un componente fundamental en estos contextos.

Pero de nuevo, todo esto depende de la ejecución. La idea es sólida en principio, pero los principios no siempre sobreviven al contacto con la realidad. Los desafíos de integración, la resistencia de los incumbentes y los casos extremos imprevistos pueden ralentizar el progreso. He aprendido a tratar este tipo de proyectos como experimentos a largo plazo en lugar de soluciones a corto plazo.

Si regreso a esa escena en el almacén, lo que me destaca ahora no es solo el retraso, sino la aceptación de este. Todos los involucrados se habían adaptado a un sistema donde la verificación es lenta y fragmentada. Cambiar ese comportamiento requiere más que tecnología; requiere un cambio en cómo las organizaciones piensan sobre la confianza y la coordinación.

Esta es la razón por la que encuentro el proyecto interesante, pero no de la manera en que a menudo se enmarcan estas cosas en los titulares. No se trata de transformar industrias de la noche a la mañana. Se trata de abordar una ineficiencia específica que aparece en muchos lugares, a menudo en silencio, y ver si un enfoque diferente a la verificación puede marcar una diferencia medible.

Si funciona, no creo que será obvio. No habrá un solo momento en el que todo cambie. En cambio, las mejoras aparecerán de maneras más pequeñas: menos retrasos, interacciones más fluidas, menos verificación manual. El tipo de cambios que la gente nota solo cuando ya no están.

Y si no funciona, probablemente fallará de maneras conocidas: no suficiente adopción, demasiada complejidad o incentivos mal alineados. Ese es el riesgo con cualquier proyecto de infraestructura que depende de la coordinación a gran escala.

Por ahora, lo veo como un intento reflexivo de abordar un problema que es fácil de pasar por alto pero costoso de ignorar. Si tiene éxito o no dependerá menos de la elegancia de la idea y más de cuán bien navega las realidades desordenadas de los sistemas que intenta conectar.

@SignOfficial #SignDigitalSovereignInfra $SIGN