He estado lo suficientemente tiempo en crypto para reconocer un patrón: cuanto más un proyecto enfatiza lo que podría llegar a ser, más me encuentro buscando lo que realmente está eliminando hoy. No la narrativa, no los diagramas, no el roadmap—sino la fricción. Porque al final, los usuarios no se quedan por ideología. Se quedan porque algo se volvió más fácil, más seguro o simplemente menos agotador.

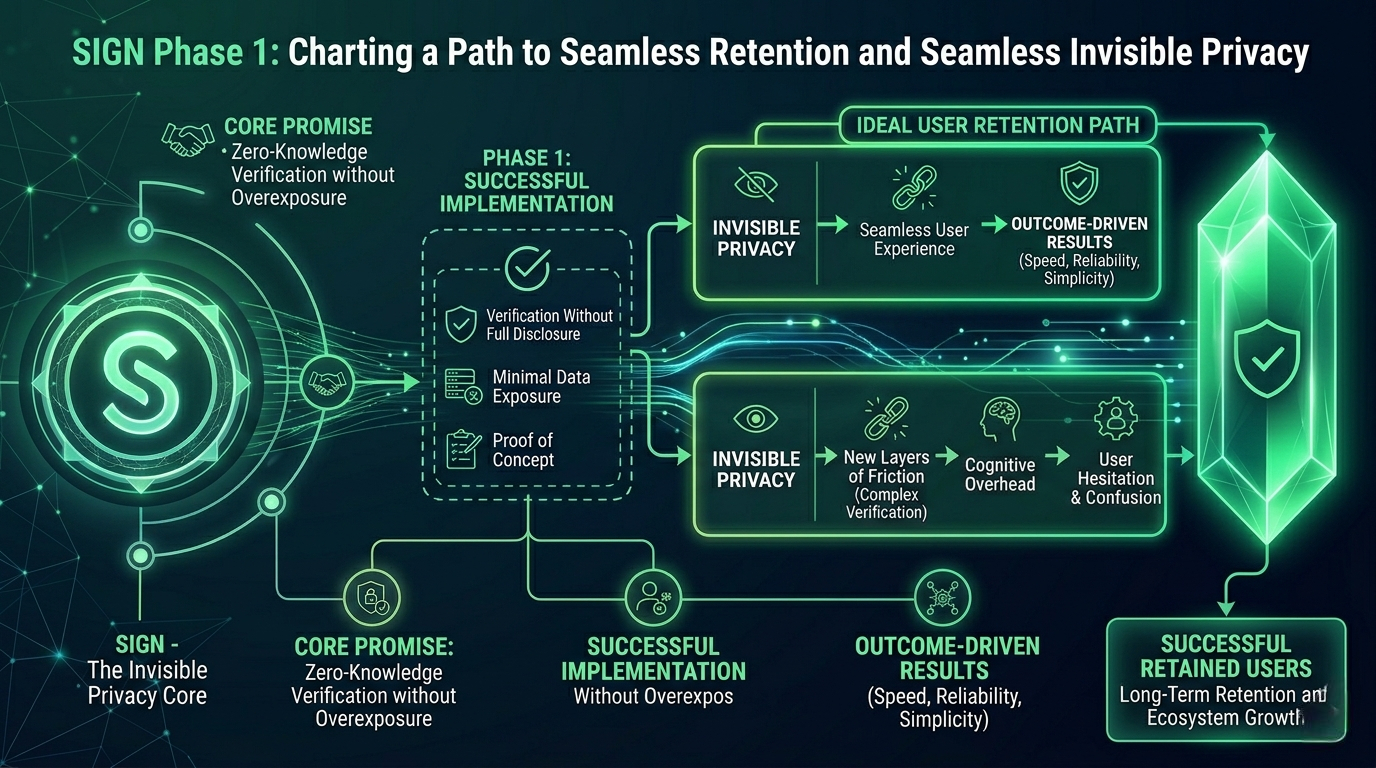

Esa es la lente a través de la cual miro la Fase 1 de SIGN.

A primera vista, la premisa es convincente. La verificación de credenciales y la distribución de tokens son dos áreas en las que Web3 ha luchado constantemente—no porque las herramientas no existan, sino porque son torpes, sobreexpuestas y a menudo se basan en suposiciones de confianza que se suponía que la blockchain iba a eliminar. SIGN se posiciona en esa brecha, ofreciendo una forma de verificar la elegibilidad o identidad sin revelar los datos subyacentes. En teoría, ese es exactamente el tipo de problema que vale la pena resolver.

Pero la Fase 1 es donde la teoría se encuentra con el comportamiento, y el comportamiento es donde la mayoría de los proyectos comienzan a fracturarse en silencio.

El ángulo de la privacidad, en particular, merece escrutinio. La criptografía ha tratado durante mucho tiempo la privacidad como un bien intrínseco, casi más allá de cuestionamiento. Y sí, la divulgación selectiva y la exposición mínima de datos son ideas poderosas. En entornos como la atención médica, el acceso a datos de IA, o incluso en airdrops de tokens, reducir la transparencia innecesaria no es solo una característica; es una necesidad.

Pero aquí está la verdad incómoda: la privacidad por sí sola rara vez ha sido suficiente para retener a los usuarios.

Hemos visto cadenas, billeteras y protocolos enfocados en la privacidad surgir con fuerte convicción, solo para estabilizarse una vez que la ola inicial de primeros adoptantes se desvanece. No porque la tecnología fallara, sino porque el usuario promedio no se despierta pensando en garantías criptográficas. Se preocupan por los resultados: velocidad, confiabilidad, simplicidad y, cada vez más, integración en sistemas que ya utilizan.

El desafío de SIGN, entonces, no es demostrar que la privacidad importa. Es demostrar que la privacidad puede coexistir con la usabilidad sin introducir nuevas capas de fricción.

La Fase 1 probablemente demostrará que la verificación sin divulgación completa es técnicamente posible. Ese es un hito importante. Pero la posibilidad técnica es la barrera más baja en este espacio. La verdadera pregunta es si los usuarios, especialmente los no técnicos, pueden moverse a través de este sistema sin vacilación o confusión. Si verificar una credencial a través de SIGN se siente incluso ligeramente más complejo que los métodos tradicionales, el beneficio de privacidad se vuelve abstracto, y la abstracción es donde muere la retención de usuarios.

También está el tema de la confianza, irónicamente. Incluso en un sistema diseñado para minimizar la confianza, los usuarios todavía necesitan confiar en algo: la interfaz, los emisores de credenciales, la integridad del flujo de verificación. Si SIGN no define claramente y distribuye ese modelo de confianza, corre el riesgo de recrear las mismas dependencias que afirma eliminar, solo que en una forma más opaca.

Y luego está la distribución de tokens. Aquí es donde muchos sistemas bien intencionados comienzan a desmoronarse. La equidad, la elegibilidad y la resistencia a Sybil son problemas que suenan solucionables en teoría. Pero en la práctica, se convierten en juegos adversariales. Si SIGN se convierte en un guardián para el acceso a tokens, inevitablemente atraerá intentos de explotar, eludir o engañar al sistema. La Fase 1 puede no exponer completamente estas debilidades, pero surgirán con el tiempo, y cómo SIGN se adapte será más importante que cómo se lance.

Entonces, ¿la privacidad conduce a la retención a largo plazo?

Solo si es invisible.

El momento en que los usuarios tienen que pensar en la privacidad: gestionarla, configurarla, solucionarla, deja de ser una fortaleza y comienza a convertirse en una carga cognitiva. Los sistemas más exitosos no son los que publicitan la privacidad de manera más ruidosa; son aquellos donde los usuarios se sienten seguros sin ser recordados por qué.

SIGN tiene el instinto correcto al dirigirse a la sobreexposición y la verificación ineficiente. Esa es la verdadera fricción. Pero la Fase 1 no es una validación de la visión; es una prueba de moderación. ¿Puede el sistema seguir siendo simple mientras hace algo inherentemente complejo? ¿Puede evitar la trampa del sobreingeniería en busca de una privacidad perfecta?

Porque he visto demasiados proyectos equivocarse en esta parte. Construyen para un usuario ideal que entiende profundamente el problema, en lugar del usuario real que solo quiere que las cosas funcionen.

Si SIGN puede hacer que la privacidad se sienta como un defecto en lugar de una decisión, tiene una oportunidad. Si no, corre el riesgo de convertirse en otro sistema bien diseñado que la gente respeta, pero no al que regresa.

Y en criptografía, el respeto sin retención no dura mucho tiempo.