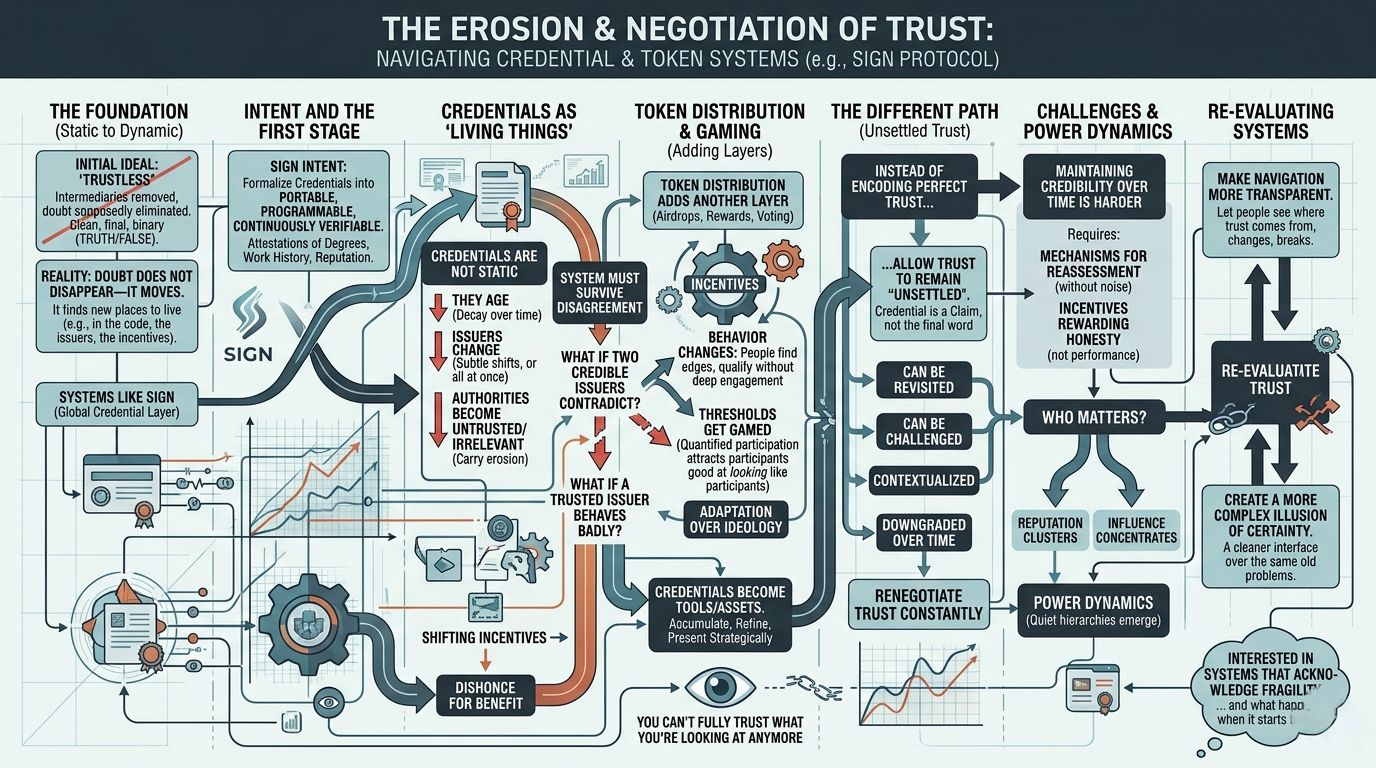

He estado alrededor el tiempo suficiente para recordar cuando “sin confianza” era la palabra en la que todos se apoyaban. Sonaba limpio. Final. Como si eliminar intermediarios de alguna manera eliminaría la duda misma. Pero con el tiempo, te das cuenta de que la duda no desaparece—simplemente se mueve. Encuentra nuevos lugares para vivir.

Últimamente he estado pensando en sistemas como SIGN—esta idea de construir una capa global para la verificación de credenciales y la distribución de tokens. En papel, tiene sentido. Siempre hemos tenido credenciales: títulos, historial laboral, reputación, prueba de participación. Lo nuevo es el intento de formalizarlas en algo portátil, programable, y—esta es la parte importante—verificable de manera continua.

Pero cuanto más tiempo observas evolucionar estos sistemas, menos parecen máquinas que crean confianza, y más como entornos donde la confianza se pone a prueba.

Porque las credenciales no son cosas estáticas. Envejecen. Se cuestionan. La persona o institución que las emitió cambia, a veces sutilmente, a veces de golpe. Una autoridad respetada hoy puede volverse irrelevante—o incluso no confiable—mañana. Y cuando eso sucede, la credencial no se queda ahí sin cambios. Lleva consigo esa erosión.

Ahí es donde las cosas se ponen interesantes.

Un sistema como SIGN no solo está almacenando atestaciones. Está implícitamente haciendo una afirmación: que la confianza puede ser rastreada a lo largo del tiempo, que la credibilidad puede ser revisitada, no solo concedida una vez y olvidada. Eso suena razonable. Pero también abre una puerta que la mayoría de la gente no piensa: el sistema tiene que sobrevivir al desacuerdo.

¿Qué pasa cuando dos emisores creíbles se contradicen entre sí?

¿Qué pasa cuando un emisor ampliamente confiable comienza a comportarse mal?

¿Qué pasa cuando los incentivos cambian y la gente comienza a emitir credenciales no porque sean verdaderas, sino porque les beneficia?

Comienzas a ver las grietas allí.

La distribución de tokens agrega otra capa. Siempre lo hace. En el momento en que las recompensas entran en la imagen, el comportamiento cambia. La gente optimiza. No necesariamente mienten abiertamente—no al principio—pero encuentran formas de calificar, de parecer elegibles, de señalar suficiente credibilidad para pasar cualquier umbral que exista.

Y con el tiempo, esos umbrales tienden a ser manipulados.

Hemos visto este patrón antes. Airdrops, sistemas de reputación, votación de DAO—cada sistema que intenta cuantificar la participación eventualmente atrae participantes que son muy buenos en parecer participantes. Ni siquiera es malicioso en un sentido dramático. Es solo adaptación. Los incentivos moldean el comportamiento de manera más confiable de lo que lo hará la ideología.

Así que cuando un protocolo vincula credenciales a flujos de tokens, no solo está verificando identidad o contribución. Está creando un mercado alrededor de la credibilidad misma.

Eso es algo delicado.

Porque ahora las credenciales no son solo reflejos de la realidad—se convierten en herramientas. Activos, incluso. Algo que acumulas, refinas, presentas estratégicamente. Y una vez que eso sucede, no puedes confiar completamente en lo que estás mirando. No ciegamente, al menos.

Pero aquí es donde creo que SIGN—o sistemas como él—están tratando de tomar un camino diferente, ya sea intencionalmente o no.

En lugar de pretender que la confianza puede ser perfectamente codificada, permiten que permanezca... inestable.

Una credencial no es la última palabra. Es una afirmación. Una que puede ser revisitada. Desafiada. Contextualizada. Tal vez incluso degradada en relevancia con el tiempo. Eso está más cerca de cómo realmente funciona la confianza en el mundo real. No es binaria. No es permanente. Es algo que renegociamos constantemente.

Si el sistema se inclina hacia eso—si acepta que las credenciales son seres vivos, no verdades fijas—entonces se convierte menos en demostrar algo una vez, y más en mantener la credibilidad a lo largo del tiempo.

Pero eso también es más difícil. Mucho más difícil.

Porque ahora no estás construyendo una base de datos. Estás construyendo un sistema que tiene que manejar la descomposición, el desacuerdo y la manipulación sin colapsar en ruido. Necesitas mecanismos para la reevaluación, sin abrir la puerta a disputas interminables. Necesitas incentivos que recompensen la honestidad, pero que no conviertan la honestidad en algo performativo.

Y honestamente, no sé si ese equilibrio es alcanzable.

También está la cuestión de quién llega a importar. No todos los emisores son iguales, y nunca lo serán. Algunas voces tienen más peso. Algunas credenciales siempre se verán como más "reales" que otras. Incluso en un sistema descentralizado, las jerarquías tienden a reemerger. Grupos de reputación. La influencia se concentra.

Así que la idea de una capa de credenciales global suena neutral, pero en la práctica, está moldeada por dinámicas de poder—solo que más silenciosas.

Aun así, me encuentro prestando atención.

No porque crea que sistemas como SIGN resolverán la confianza. No creo que eso sea posible. La confianza no es algo de lo que eliminas la incertidumbre. Es algo que navegas a pesar de la incertidumbre.

Lo que estos sistemas podrían hacer—si son cuidadosos—es hacer esa navegación más transparente.

Deja que la gente vea de dónde proviene la confianza. Cómo cambia. Dónde se rompe.

Y tal vez eso sea suficiente.

O tal vez simplemente crea una ilusión más compleja de certeza. Una interfaz más limpia sobre los mismos problemas antiguos.

No estoy convencido de ninguna de las dos maneras aún.

Pero he dejado de buscar sistemas que prometan una confianza perfecta. En este momento, estoy más interesado en aquellos que reconocen cuán frágil es—y qué sucede cuando comienza a deslizarse.