Écrit par l'équipe scientifique Qubic

Un commentaire sur le dernier article de Nick Bostrom par l'équipe scientifique Qubic

Reformuler le débat sur la superintelligence : chirurgie, pas roulette

Il vient de publier un nouveau document de travail, Timing Optimal pour la Superintelligence : Considérations Banales pour les Personnes Existantes (2026), dans lequel il déplace la question centrale. Au lieu de se demander si nous devrions développer la superintelligence, Bostrom se concentre sur le moment où il est optimal de le faire. Pour quiconque suit l'intersection en rapide évolution de l'IA et de la blockchain, son cadre porte des implications profondes sur la façon dont nous concevons l'infrastructure qui soutiendra l'intelligence générale artificielle (AGI).

Reformuler le Débat sur la Superintelligence : Chirurgie, Pas Roulette

Le point de départ du document de Bostrom est à la fois élégant et disruptif. Il reformule entièrement le débat polarisé « IA oui contre IA non ». Développer la superintelligence, soutient-il, n'est pas comme jouer à la roulette russe. C'est plus comme subir une opération risquée pour une condition déjà fatale.

Quelle est cette condition ? L'état actuel de l'humanité elle-même. Considérez la base : environ 170 000 décès se produisent chaque jour à cause du vieillissement, des maladies et des défaillances systémiques. Une population mondiale vieillissante fait face à une détérioration biologique irréversible. Les maladies incurables, y compris les conditions oncologiques, neurodégénératives et cardiovasculaires, continuent de peser sur des millions. Nous faisons face à des risques mondiaux non atténués, allant de l'instabilité climatique à la corruption institutionnelle systémique, en passant par l'érosion de la qualité démocratique. Les pandémies, les guerres et l'effondrement de systèmes entiers demeurent des menaces omniprésentes.

Étant donné ces réalités, Bostrom soutient que formuler le choix comme « zéro risque sans IA » contre « risque extrême avec une superintelligence » est simpliste. La question plus rigoureuse est : quelle trajectoire génère une plus grande espérance de vie et une meilleure qualité de vie pour les personnes qui existent déjà ?

En ancrant son analyse dans les conditions réelles et présentes de la vie humaine, Bostrom évite les abstractions philosophiques et la spéculation théologique. Il parle de vous, de votre famille et des personnes vivantes en ce moment.

Espérance de Vie, Risque Mortel et le Cas pour l'Intelligence Artificielle Générale

Lorsque nous sommes jeunes, le risque annuel de mourir est extrêmement faible. Biologiquement, nous sommes loin de la mort dans la plupart des cas. Mais à mesure que nous vieillissons, la probabilité de mourir grimpe sans relâche en raison de la détérioration biologique.

Si la superintelligence pouvait radicalement réduire ou même éliminer le vieillissement, comme le propose Bostrom, votre risque de mortalité annuel resterait au niveau d'une personne jeune et en bonne santé. Votre mortalité cesserait d'augmenter avec le temps. Dans ce scénario, l'espérance de vie devient extraordinairement longue.

De ce point de vue, la valeur attendue de la superintelligence compense ses risques élevés. Mais que se passe-t-il si nous retardons jusqu'à ce que la technologie devienne parfaitement « sûre » ? Que se passe-t-il si nous accumulons la probabilité de mourir chaque année qui passe ? La question devient : est-il plus rationnel d'accepter la probabilité de catastrophe d'un déploiement précoce, sachant que les progrès en matière de sécurité de l'IA sont exponentiels, ou d'accepter la certitude des décès accumulés dus au retard ?

Actualisation Temporelle et le Coût de l'Attente

Bostrom introduit le concept de l'actualisation temporelle (ρ), un principe bien étudié en théorie de la décision. Les humains valorisent systématiquement les résultats présents plus que les futurs. C'est pourquoi nous restons dans des emplois, des relations et des schémas insatisfaisants : l'effort de changement semble énorme et la récompense semble lointaine.

Mais ici, une inversion intéressante se produit. Si la vie après l'AGI n'est pas seulement plus longue mais aussi dramatiquement meilleure, avec des améliorations radicales de la santé, de la capacité cognitive et de la qualité de vie, alors l'actualisation temporelle punit en fait l'attente. Chaque année de retard est une année passée dans une condition qualitativement pire alors qu'un état bien supérieur est accessible.

Qualité de Vie et Aversion au Risque dans le Déploiement de l'AGI

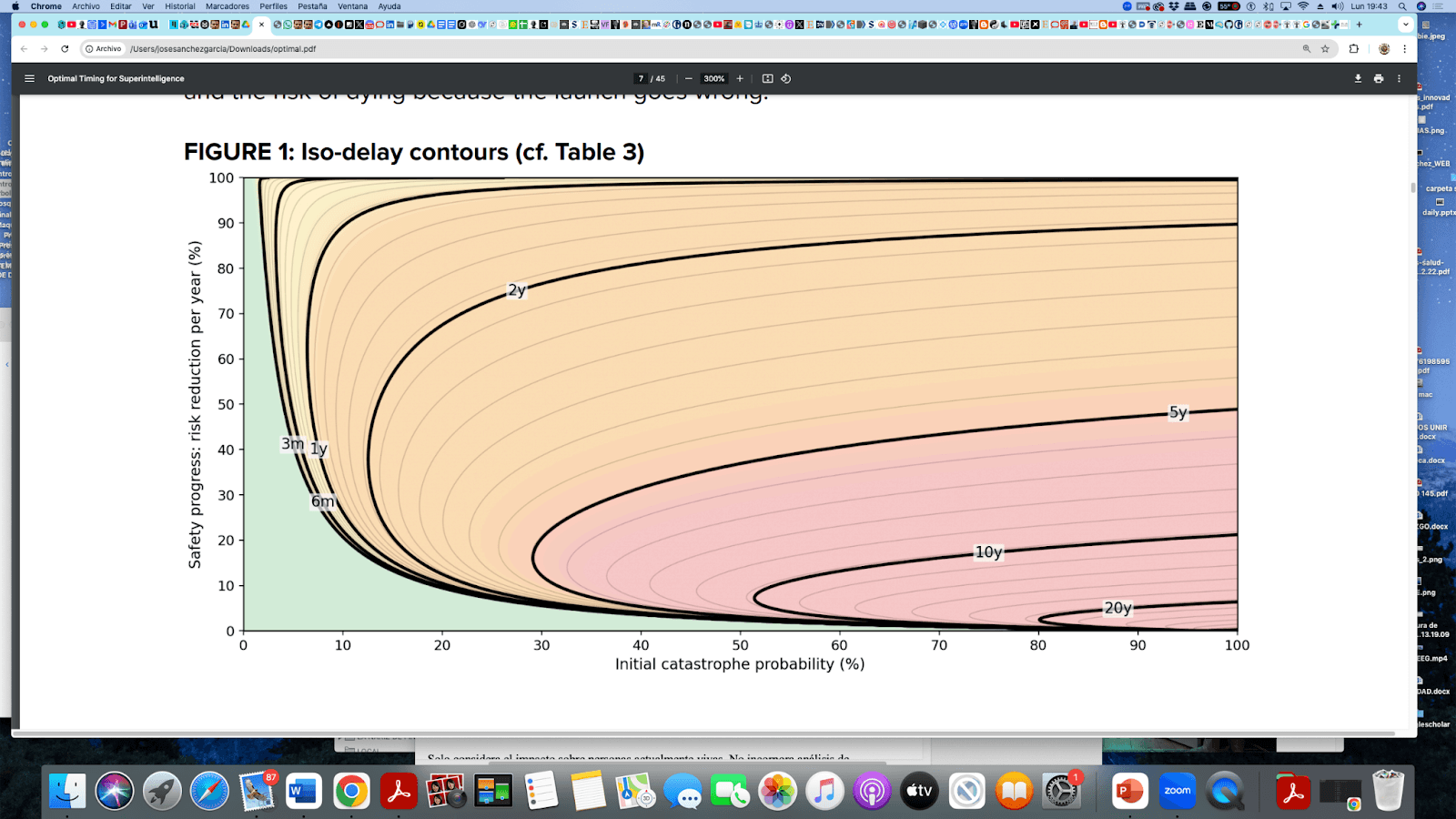

Le modèle de Bostrom ne suppose pas la longévité seule. Il intègre des améliorations substantielles du bien-être. Si la qualité de vie double après la transition vers la superintelligence, l'équilibre se déplace décisivement vers un déploiement plus précoce. Il intègre ensuite des métriques d'aversion au risque (CRRA et CARA), reconnaissant que si nous sommes plus sensibles aux pertes extrêmes, la fenêtre où « lancer maintenant » reste conseillé se rétrécit et les retards optimaux s'allongent.

Ce n'est pas de l'accélérationnisme imprudent. C'est une prise de décision calibrée face à l'incertitude, le type d'analyse qui devrait informer comment nous gouvernons le chemin vers l'intelligence artificielle générale.

Déploiement en Deux Phases : Rapide pour le Port, Lent pour le Quai

Une des contributions les plus fortes du document est sa division de la transition AGI en deux phases distinctes :

Phase 1 : Atteindre la capacité AGI. Avancer aussi rapidement que cela est responsable vers la construction d'un système démontrant une intelligence générale.

Phase 2 : Une pause stratégique avant le déploiement complet. Une fois le système existant, introduire un retard contrôlé pour l'étudier, le tester dans des conditions réelles et résoudre les problèmes de sécurité technique qui n'étaient auparavant que théoriques.

L'hypothèse de Bostrom est que, une fois qu'un système AGI existe réellement, un « coup de chance de sécurité » se produit. Les chercheurs peuvent observer un comportement réel plutôt que de spéculer à son sujet. Les progrès en matière de sécurité s'accélèrent considérablement car les problèmes deviennent empiriques plutôt qu'abstraits. Le slogan qu'il énonce : rapide pour le port, lent pour le quai.

Qui Bénéficie le Plus d'une Transition Plus Précoce vers la Superintelligence ?

Bostrom ne considère pas le moment optimal comme universel. Les personnes âgées, les malades graves et celles vivant dans des conditions précaires ont moins d'années d'espérance de vie restantes. Pour eux, le bénéfice potentiel d'une transition rapide vers la superintelligence est bien plus grand. Les jeunes avec des décennies devant eux peuvent tolérer plus d'attente.

Si vous appliquez une logique prioritaire, donnant plus de poids à ceux qui sont les plus défavorisés, le calendrier optimal se déplace vers l'avant. Bostrom rejette également explicitement l'hypothèse commune selon laquelle au-delà d'un certain âge, une vie supplémentaire n'apporte aucune valeur. Ce jugement, soutient-il, est enraciné dans notre expérience du vieillissement et de la détérioration actuels. Il ne tient pas compte d'un scénario de véritable rajeunissement, l'une des promesses centrales d'un avenir superintelligent.

Risques Institutionnels : Pourquoi l'Infrastructure de Gouvernance de l'IA est Importante

Dans les sections finales de son document, Bostrom introduit des avertissements institutionnels critiques. Le scénario le plus raisonnable, suggère-t-il, est celui où le leader technologique utilise son avantage pour la sécurité. Mais il signale également les dangers des moratoires nationaux, des interdictions internationales et des dynamiques compétitives qui surgissent lorsque plusieurs acteurs se précipitent vers l'AGI sous pression géopolitique.

Son analyse suppose implicitement un écosystème où la puissance de calcul tend à se concentrer. Dans un tel environnement, les risques se cumulent : militarisation des ressources de calcul, surcapacité de calcul (réserves massives prêtes à être activées sous pression concurrentielle) et les incitations perverses d'une centralisation extrême. Ce ne sont pas des préoccupations abstraites. La trajectoire actuelle du développement de l'IA, dominée par une poignée de fournisseurs de cloud hyperscale et de laboratoires d'entreprise, crée précisément cette concentration.

Implications pour Qubic : Pourquoi l'Infrastructure d'IA Décentralisée Réduit le Risque Existentiel

Si nous prenons au sérieux le cadre de Bostrom, la question fondamentale passe de « quand lancer l'AGI » à quel type d'infrastructure réduit les risques associés à ce lancement. C'est ici que l'architecture de Qubic devient directement pertinente pour la conversation mondiale sur la sécurité de la superintelligence.

Le Problème de Centralisation dans le Développement Actuel de l'IA

Si la superintelligence est construite sur des infrastructures centralisées, dépendant de gigantesques centres de données, de pipelines de formation opaques et de contrôle corporatif, le profil de risque s'étend au-delà du pur technique. Cela devient géopolitique. La concentration de calcul rend la gouvernance adaptative que Bostrom considère essentielle durant la phase critique de pré-déploiement beaucoup plus difficile. Cela crée également exactement le type de surcapacité de calcul dont il avertit : d'énormes réserves computationnelles prêtes à être activées d'un seul coup sous pression concurrentielle.

Comment l'Architecture de Calcul Distribué de Qubic Aborde Ces Risques

Qubic dilue ce goulot d'étranglement structurel. Son architecture distribue la puissance computationnelle à travers un réseau mondial plutôt que de la concentrer en un seul nœud. Qubic ne dépend pas d'une architecture de type LLM entraînée de manière opaque dans des mégacentres de données. Au lieu de cela, elle tire parti de l'Utilisation de la Preuve de Travail (uPoW), où les mineurs contribuent à un véritable calcul pour l'entraînement de son cœur d'IA, Aigarth, plutôt que de résoudre des énigmes de hachage arbitraires.

Ce choix de conception a des implications directes pour l'analyse de Bostrom. Une infrastructure moins centralisée réduit la probabilité des scénarios de déploiement abrupt et concurrentiels contre lesquels il met en garde. Le calcul distribué signifie que le pouvoir n'est pas situé dans une seule installation qui peut être capturée militairement, ni dans un laboratoire d'entreprise sous contrôle unilatéral. Cette résilience structurelle élargit l'espace pour la Phase 2 de Bostrom : la pause stratégique où de véritables tests, améliorations incrémentielles et gouvernance adaptative peuvent avoir lieu avant le déploiement complet.

Pour une compréhension plus approfondie de la façon dont l'approche de Qubic en matière d'IA diffère des modèles traditionnels, explorez Neuraxon : le grand bond en avant de Qubic vers une IA vivante et apprenante et l'analyse récente que l'IA statique est une impasse. Google le confirme.. Ces articles illustrent comment Qubic construit l'intelligence à travers un paradigme fondamentalement différent : conçu pour l'apprentissage continu, la résilience distribuée et l'adaptation au monde réel sur un réseau décentralisé.

IA décentralisée et blockchain : alignement structurel avec la sécurité de l'AGI

Du point de vue de Bostrom, le potentiel de Qubic ne repose pas simplement sur le fait d'être « décentralisé » comme un exercice de marque. Il repose sur la modification des variables structurelles qui déterminent le moment optimal pour le déploiement de la superintelligence. En distribuant le calcul, en construisant des protocoles de consensus qui alignent les incitations des mineurs avec une véritable formation en IA, et en rendant l'ensemble du processus open-source et auditable, Qubic crée le type d'infrastructure qui rend la transition vers l'AGI structurellement plus sûre.

Si vous êtes intéressé par l'évolution du modèle de minage CPU de Qubic et de son réseau de calcul distribué, l'analyse approfondie du minage Dogecoin sur Qubic explique la dernière expansion de l'Utilisation de la Preuve de Travail, et la Vision 2026 de Qubic détaille la feuille de route d'infrastructure plus large maintenant en cours.

Le Problème le Plus Difficile : Construire une AGI qui Apprend du Monde

Imaginer des scénarios utopiques et dystopiques est précieux. C'est, en fait, le meilleur chemin pour créer des futurs alignés sur les besoins et les valeurs humaines. Mais détourner le regard, attendre sans but ou accélérer sans retenue échoue tous à fournir les réflexions nécessaires.

Peut-être que le défi le plus difficile en ce moment n'est pas tant de peser le risque d'accélérer la transition et de le modéliser. Pour l'instant, la tâche la plus difficile est de construire une intelligence artificielle générale capable d'apprendre par elle-même à partir de différents environnements dynamiques, de créer des représentations du monde et d'agir à l'intérieur. C'est précisément le défi que le cadre Neuraxon de Qubic est conçu pour relever, non pas en s'entraînant sur des ensembles de données statiques derrière des portes closes, mais en évoluant à découvert, apprenant de la complexité du monde réel sur un réseau décentralisé auquel tout le monde peut participer.

Références et Sources

1. Bostrom, N. (2026). Moment Optimal pour la Superintelligence : Considérations Banales pour les Personnes Existantes. Document de travail, v1.0.

https://nickbostrom.com/optimal.pdf

2. Bostrom, N. (2014). Superintelligence : Chemins, Dangers, Stratégies. Oxford University Press.

3. Bostrom, N. (2003). Déchets Astronomiques : Le Coût d'Opportunité du Développement Technologique Retardé. Utilitas, 15(3), 308–314.

4. Yudkowsky, E. & Soares, N. (2025). Si quelqu'un le construit, tout le monde meurt.

5. Hall, R. E. & Jones, C. I. (2007). La Valeur de la Vie et l'Augmentation des Dépenses de Santé. Quarterly Journal of Economics, 122(1), 39–72.

6. Équipe Scientifique de Qubic. Neuraxon : le grand bond en avant de Qubic vers une IA vivante et apprenante.

https://qubic.org/blog-detail/neuraxon-qubic-s-big-leap-toward-living-learning-ai

7. Discussion de la communauté LessWrong : Moment Optimal pour la Superintelligence

https://www.lesswrong.com/posts/2trvf5byng7caPsyx/optimal-timing-for-superintelligence-mundane-considerations