Sebagian besar sistem AI saat ini baik dalam menghasilkan jawaban. Mereka jauh lebih tidak dapat diandalkan dalam menjamin jawaban tersebut.

Anda mengajukan pertanyaan. Model ini menjawab dengan percaya diri. Struktur suaranya terdengar logis. Penjelasannya terasa lengkap. Tetapi di bawah respons itu terdapat masalah sederhana: mungkin saja itu salah.

Ketidakpastian itu adalah batasan tak terlihat dari sistem pengetahuan AI modern.

Informasi dihasilkan lebih cepat daripada dapat divalidasi.

Inilah saatnya Mira mulai mengubah persamaan.

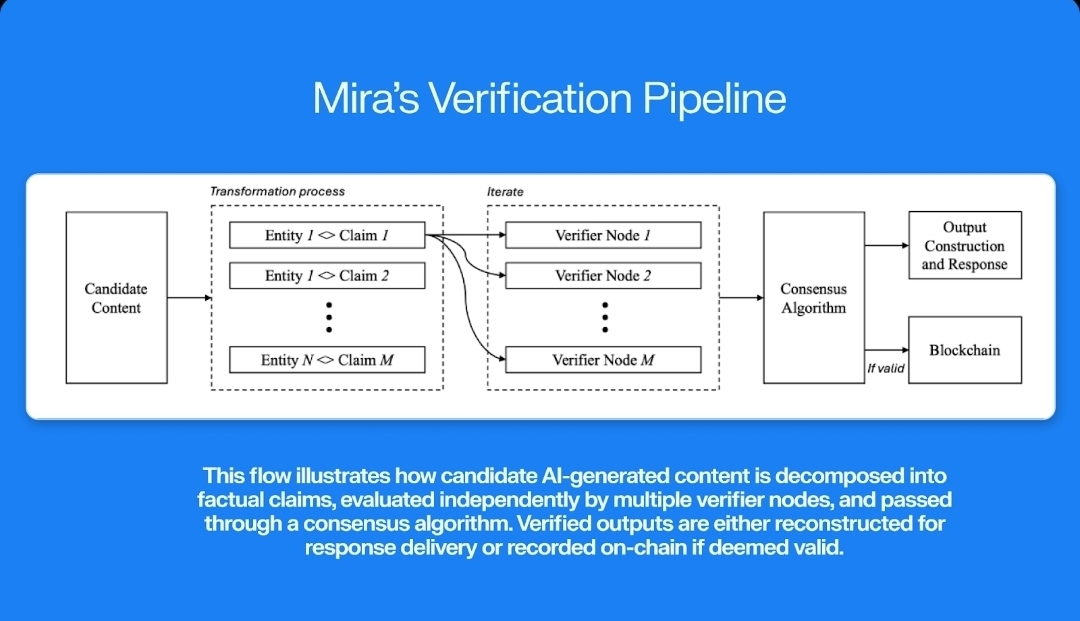

Alih-alih memperlakukan output AI sebagai jawaban yang selesai, Mira memperlakukannya sebagai klaim yang perlu diverifikasi. Sistem ini memecah konten yang dihasilkan menjadi pernyataan yang lebih kecil yang dapat diperiksa secara independen di seluruh jaringan validator terdesentralisasi.

Proses itu mengubah bagaimana pengetahuan itu sendiri dapat disusun.

Grafik pengetahuan tradisional menyimpan hubungan antara entitas. Mereka memetakan koneksi antara orang, tempat, peristiwa, dan konsep dalam struktur berbasis grafik di mana simpul mewakili entitas dan tepi mewakili hubungan.

Namun grafik ini biasanya mengasumsikan bahwa informasi di dalamnya sudah benar.

Dalam kenyataannya, sebagian besar grafik pengetahuan modern dibangun dari data yang dikumpulkan, input manusia, atau jalur ekstraksi otomatis. Kesalahan dapat menyebar dengan tenang melalui sistem.

Mira memperkenalkan model yang berbeda.

Sebelum informasi menjadi bagian dari grafik, ia harus melewati verifikasi.

Setiap pernyataan yang dihasilkan oleh model AI dapat diuraikan menjadi klaim terstruktur. Klaim ini didistribusikan di antara beberapa model atau validator independen, yang mengevaluasi akurasinya dan mencapai konsensus sebelum diterima.

Setelah divalidasi, klaim tersebut dapat diikat sebagai titik data yang dapat diandalkan di dalam grafik pengetahuan.

Hasilnya adalah grafik yang tidak hanya menyimpan hubungan.

Ini menyimpan hubungan yang terverifikasi.

Perbedaan itu lebih penting daripada yang terlihat.

Dalam sistem pengetahuan AI yang normal, informasi bersifat probabilistik. Sistem percaya bahwa sesuatu kemungkinan benar karena telah melihat pola serupa dalam data pelatihan.

Dalam grafik pengetahuan yang terverifikasi, informasi menjadi dapat dilacak. Setiap simpul dan hubungan dapat membawa bukti bahwa klaim telah dievaluasi dan disetujui oleh beberapa validator dalam jaringan.

Ini mengubah cara sistem AI bernalar.

Alih-alih menghasilkan jawaban dari probabilitas yang terhubung secara longgar, model dapat mengajukan pertanyaan kepada peta terstruktur dari pengetahuan yang telah divalidasi.

Bernalar menjadi lebih dapat diandalkan karena fondasinya sendiri telah diperiksa.

Untuk agen AI otonom, ini bisa menjadi krusial.

Agen yang beroperasi secara independen memerlukan sumber informasi yang tepercaya. Jika basis pengetahuan mereka mengandung fakta yang tidak nyata atau data yang tidak konsisten, keputusan mereka dapat dengan cepat menjadi tidak dapat diandalkan.

Grafik pengetahuan yang terverifikasi mengurangi risiko itu.

Agen dapat merujuk klaim yang telah divalidasi oleh lapisan verifikasi terdistribusi daripada hanya bergantung pada prediksi mereka sendiri.

Seiring waktu, ini menciptakan siklus umpan balik.

AI menghasilkan pengetahuan.

Jaringan memverifikasinya.

Klaim yang terverifikasi memperluas grafik pengetahuan.

Sistem AI masa depan mengajukan pertanyaan kepada grafik itu untuk bernalar lebih akurat.

Sistem menjadi semakin dapat diandalkan seiring pertumbuhannya.

Ini adalah visi yang lebih besar di balik lapisan verifikasi seperti Mira.

Tidak hanya memperbaiki halusinasi.

Tetapi membangun infrastruktur untuk pengetahuan yang dapat dipercaya itu sendiri.

Jika setiap klaim di dalam grafik pengetahuan AI membawa bukti verifikasi, informasi berhenti menjadi teks sementara yang dihasilkan oleh model.

Ini menjadi pengetahuan yang terstruktur dan dapat diaudit.

Dan begitu pengetahuan menjadi dapat diverifikasi, sistem AI berhenti menebak sesering mungkin.

Mereka mulai bernalar di atas sesuatu yang lebih dekat dengan kebenaran.