Kecerdasan Buatan ada di mana-mana saat ini. Ia menulis, menghitung, memprediksi, merangkum, merekomendasikan, dan bahkan memberi nasihat. Namun di balik kemampuan mengesankannya terdapat kekhawatiran yang tenang namun serius: AI dapat terdengar percaya diri bahkan ketika ia salah. Ia dapat menghasilkan jawaban yang terlihat akurat tetapi dibangun di atas asumsi yang cacat, data yang tidak lengkap, atau fakta yang halusinasi. Dalam situasi berisiko rendah, ini mungkin tidak berbahaya. Dalam lingkungan berisiko tinggi seperti perawatan kesehatan, keuangan, sistem hukum, atau operasi otonom, ini dapat berbahaya.

Jaringan Mira lahir dari ketegangan yang tepat antara kecerdasan dan keandalan. Visinya bukan untuk membangun model AI kuat lainnya yang bersaing untuk perhatian. Sebaliknya, ia berusaha untuk menyelesaikan masalah struktural yang lebih dalam — bagaimana kita membuat output AI dapat dipercaya secara skala?

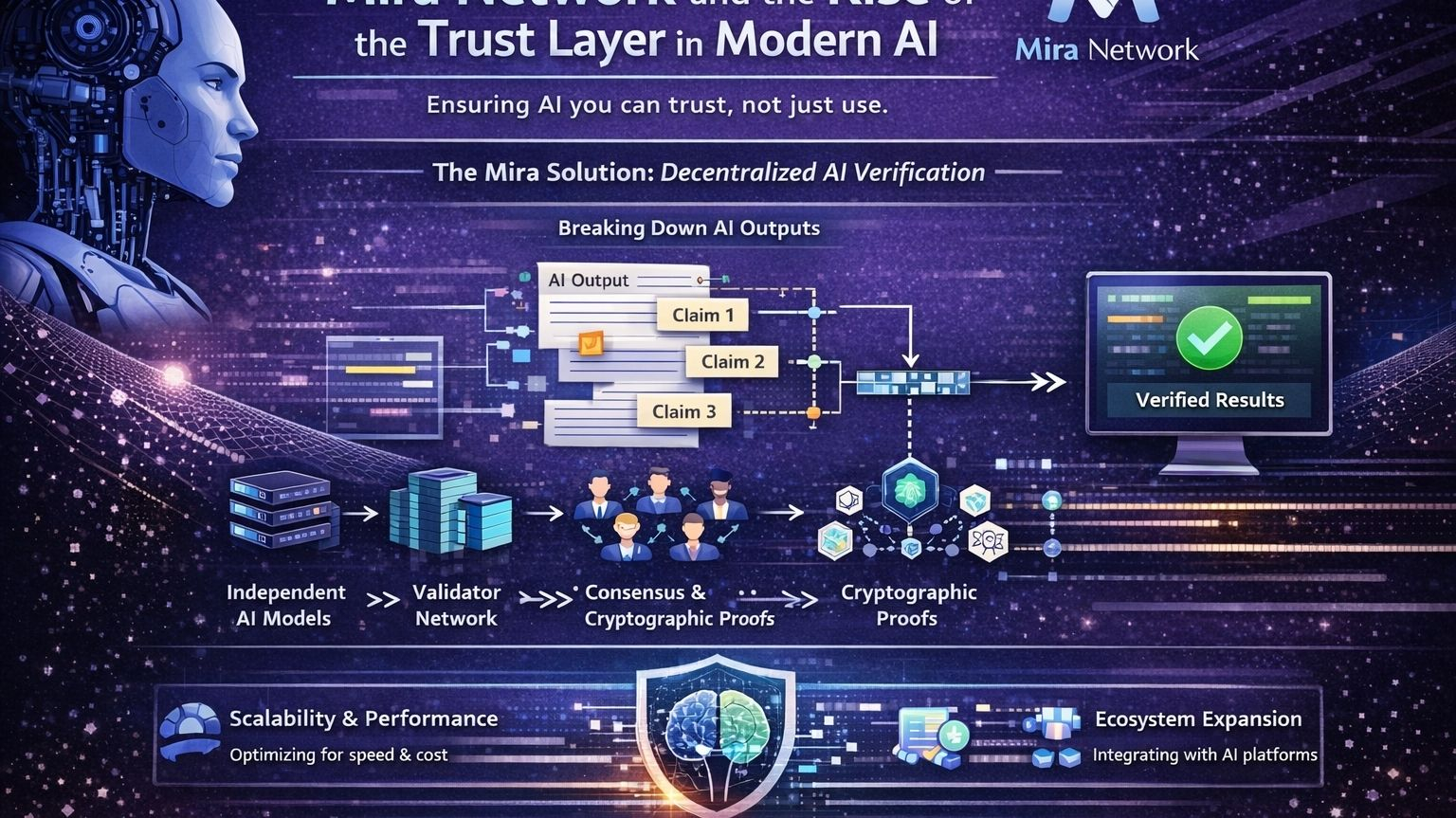

Di hati Mira, itu membayangkan dunia di mana respons AI tidak diterima secara membabi buta tetapi diverifikasi secara independen sebelum mereka mempengaruhi keputusan nyata. Alih-alih meminta pengguna untuk mempercayai satu penyedia terpusat, Mira membayangkan lingkungan terdesentralisasi di mana informasi yang dihasilkan AI melewati jaringan validator. Dalam sistem ini, kepercayaan tidak datang dari reputasi merek atau otoritas korporat. Ini datang dari konsensus, verifikasi kriptografis, dan penyelarasan ekonomi.

Ide ini sederhana tetapi transformatif. Ketika AI menghasilkan jawaban yang kompleks, Mira tidak menganggapnya sebagai satu blok teks. Ini memecah respons itu menjadi klaim-klaim kecil yang logis. Setiap pernyataan faktual, setiap kesimpulan, setiap rujukan statistik menjadi sesuatu yang dapat diperiksa secara independen. Klaim-klaim ini kemudian didistribusikan di antara beberapa model AI dan validator yang menilai mereka secara terpisah. Hanya ketika kesepakatan mencapai ambang batas yang ditentukan, sistem akan menyelesaikan hasilnya.

Pendekatan ini secara dramatis mengurangi risiko bias model tunggal, halusinasi sistemik, atau ketidakakuratan yang tersembunyi. Alih-alih mempercayai satu "otak," sistem mengandalkan kecerdasan kolektif. Keberagaman menjadi perlindungan.

Tetapi misi Mira melampaui desain teknis. Ini juga mencakup insentif ekonomi untuk memastikan partisipasi yang jujur. Validator dalam jaringan dapat mempertaruhkan token sebagai jaminan, menyelaraskan kepentingan finansial mereka dengan akurasi. Jika mereka memverifikasi dengan bertanggung jawab, mereka akan dihargai. Jika mereka bertindak tidak jujur atau ceroboh, sanksi dapat diterapkan. Ini menciptakan sistem di mana akurasi tidak hanya didorong — tetapi juga secara ekonomi rasional.

Bayangkan bagaimana ini akan bekerja dalam praktik. AI medis menghasilkan ringkasan diagnostik. Alih-alih segera bertindak berdasarkan itu, ringkasan tersebut dipecah menjadi klaim medis individu dan korelasi. Beberapa model independen meninjau klaim-klaim tersebut. Validator membandingkan hasil. Konsensus terbentuk. Hanya kemudian output dikonfirmasi. Proses yang sama dapat diterapkan pada model ramalan finansial, analisis hukum otomatis, robotika industri, atau sistem keputusan otonom. Dalam setiap kasus, verifikasi menjadi pengaman bawaan daripada pemikiran setelahnya.

Apa yang membuat Mira sangat menarik adalah posisinya. Ini tidak berusaha untuk menggantikan penyedia AI yang ada. Ini bertindak sebagai lapisan infrastruktur — mesin verifikasi yang dapat terintegrasi dengan berbagai sistem AI. Sementara audit AI tradisional bergantung pada tinjauan terpusat atau koreksi setelah fakta, Mira memperkenalkan validasi proaktif, di rantai sebelum hasil diselesaikan.

Tentu saja, membangun sistem semacam itu tidak tanpa tantangan. Verifikasi terdesentralisasi memperkenalkan biaya komputasi. Mekanisme konsensus dapat menciptakan latensi. Memecah respons yang kompleks menjadi klaim terstruktur memerlukan desain yang canggih. Menyeimbangkan kecepatan dengan keandalan adalah tantangan teknis yang terus berlanjut. Namun, mengakui hambatan ini memperkuat kredibilitas misi. Inovasi pada tingkat ini memerlukan baik ambisi dan realisme.

Dalam jangka pendek, fokus Mira terletak pada pengembangan protokolnya, mengonboarding validator, dan menguji integrasi dengan platform AI. Dalam jangka menengah, tujuannya adalah untuk memperluas ekosistemnya, memperbaiki model ekonominya, dan memperkuat interoperabilitas. Dalam jangka panjang, ambisinya jauh lebih besar — menjadi lapisan kepercayaan dasar untuk kecerdasan buatan di seluruh dunia.

Signifikansi yang lebih luas dari Jaringan Mira terletak pada pergeseran filosofisnya. Selama bertahun-tahun, masyarakat telah mendekati AI dengan campuran antusiasme dan kehati-hatian. Kami mengagumi kemampuannya sambil secara diam-diam mempertanyakan akurasinya. Mira mengubah percakapan. Alih-alih bertanya apakah kita bisa mempercayai AI, itu bertanya bagaimana kita bisa membangun sistem yang membuat kepercayaan menjadi tidak perlu — sistem di mana verifikasi otomatis, transparan, dan terdesentralisasi.

Jika kecerdasan buatan mewakili pikiran masa depan digital kita, Jaringan Mira bercita-cita untuk menyediakan sistem kekebalannya — terus-menerus memeriksa, memvalidasi, dan menyaring sebelum keputusan membentuk kenyataan. Dalam dunia yang semakin dipengaruhi oleh sistem otonom, lapisan kepercayaan semacam itu mungkin tidak hanya meningkatkan AI. Ini mungkin mendefinisikan evolusinya yang aman.

@Mira - Trust Layer of AI #Mira $MIRA