Saya sering melihat sistem AI otomatis yang bergantung pada kecerdasannya sendiri, tetapi di dunia nyata, hasilnya sering menyimpang dari harapan. Sering terjadi bahwa ketika sebuah sistem membuat keputusan otonom dengan cepat, kesalahan atau perilaku yang tidak terduga muncul terlambat. Inilah saatnya benar-benar masuk akal bahwa kecerdasan model saja tidak cukup, tetapi verifikasi praktisnya diperlukan.

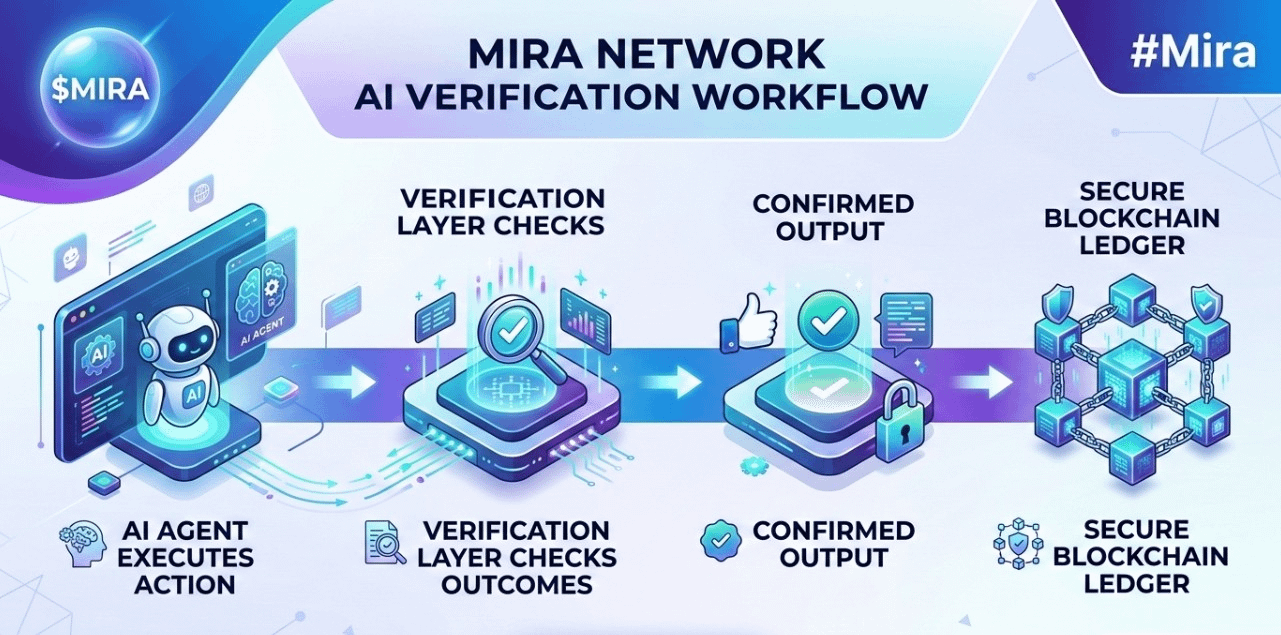

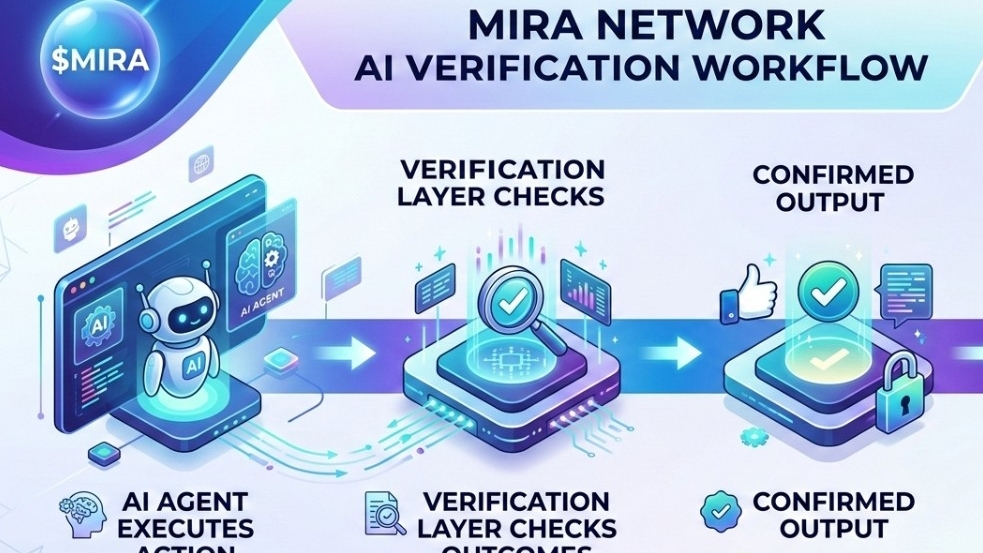

@mira_network menarik bagi saya karena metodologinya tidak hanya bergantung pada hasil, tetapi juga memverifikasi setiap tindakan. $MIRA berfungsi sebagai lapisan yang terus-menerus memeriksa hasil dan memastikan bahwa output dapat diandalkan. Sistem ini tampaknya belajar dengan sendirinya ketika hasilnya benar dan kapan perlu memeriksa ulang, dan inilah perbedaan yang menjadikan perbedaan antara eksperimen dan hasil yang benar-benar dapat diandalkan jelas.

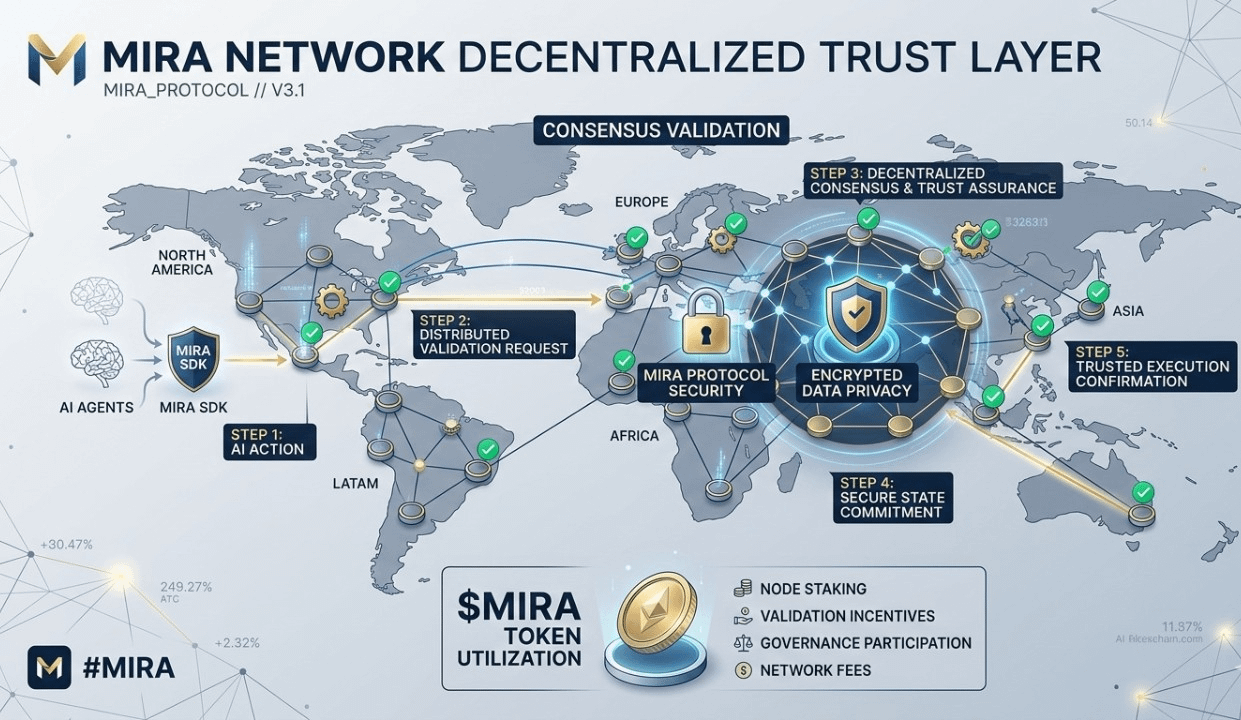

Selain itu, desain Jaringan Mira juga mempertahankan privasi dan ketidakberpihakan. Tidak ada informasi sensitif atau data keuangan yang diungkapkan dalam setiap proses verifikasi, dan tidak ada bias terhadap penyedia AI mana pun. Fitur ini sangat penting ketika keputusan AI dibuat di area sensitif seperti hukum, keuangan, atau infrastruktur. Ini berarti bahwa hasilnya tidak hanya harus akurat seiring waktu, tetapi juga terus dipantau.

Saya menantikan untuk melihat bagaimana sistem ini akan bekerja dalam skala besar, dan seberapa andal sistem ini tetap seiring waktu saat berbagai agen AI menjadi otonom. Saya pikir proses verifikasi yang konstan ini menetapkan batasan dasar yang memperjelas perbedaan antara lingkungan eksperimental dan dunia nyata. Jika sistem ini berhasil dalam skala besar, $MIRA tidak hanya akan menjadi token tetapi juga representasi kepercayaan dan transparansi, yang akan memainkan peran kunci dalam membuat penggunaan AI aman dan dapat diandalkan di masa depan. #Mira