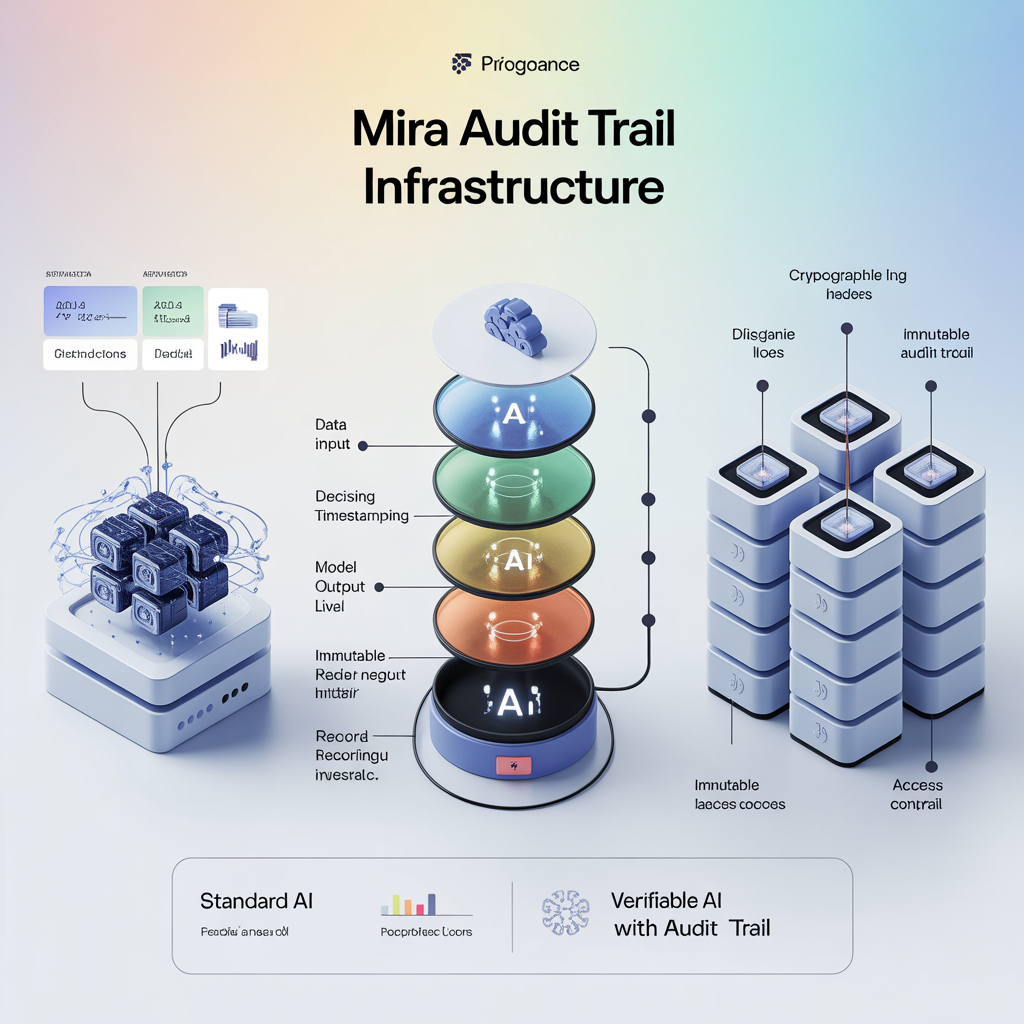

Jalur Audit Mira bisa jadi jawabannya. Dalam dunia di mana transparansi dan akuntabilitas dalam AI adalah hal yang tidak bisa ditawar, Mira memberdayakan organisasi untuk melacak setiap keputusan, tindakan, dan hasil—membuatnya mungkin untuk memverifikasi dan mempercayai sistem AI Anda seperti tidak pernah sebelumnya. Bayangkan masa depan di mana setiap pilihan algoritmik terbuka untuk ditinjau dan diperbaiki! Siap untuk membangun AI Anda di atas fondasi yang dapat Anda percayai? Temukan mengapa Jalur Audit Mira mungkin saja menjadi tulang punggung AI yang dapat diverifikasi. Pertanyaan apa yang Anda miliki tentang membawa transparansi sejati ke kecerdasan buatan?

Sementara janji AI yang dapat diverifikasi terus mendominasi diskursus industri, sedikit solusi yang menawarkan pendekatan praktis dan transparan—di sinilah Mira Audit mengklaim berbeda. Namun, saat organisasi bergegas untuk mengadopsi proses yang didorong oleh AI, kebutuhan akan jejak audit yang kuat tidak pernah lebih mendesak. Jejak Audit Mira memposisikan diri mereka sebagai pengubah permainan potensial, tetapi adopsi mereka menimbulkan pertanyaan kritis.

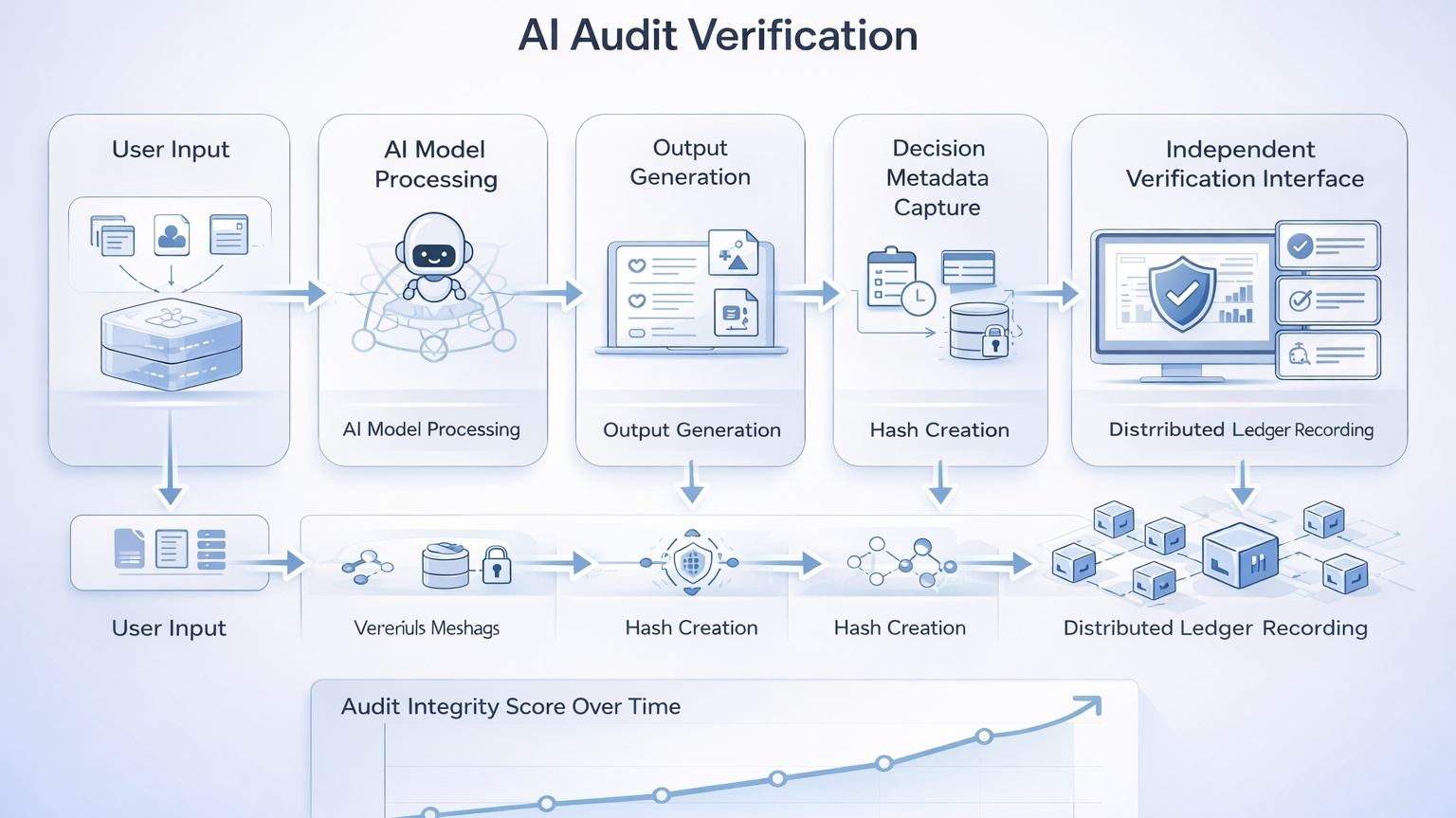

Kekuatan inti Mira Audit terletak pada pencatatan yang rinci dan tidak dapat diubah: setiap keputusan yang diambil oleh sistem AI dicatat, diberi cap waktu, dan terhubung dengan input data yang relevan. Dalam teori, transparansi ini dapat membangun kepercayaan dan memungkinkan tinjauan independen. Namun, para kritikus berpendapat bahwa hanya memiliki jejak audit tidak secara otomatis menjamin akuntabilitas atau interpretabilitas. Badan pengawas dan pemangku kepentingan masih harus menavigasi dokumen teknis yang kompleks—beban yang mungkin mengalihkan tanggung jawab daripada benar-benar mendemokratisasi akses.

Lebih lanjut, sementara Mira Audit mengklaim keterlacakan dari ujung ke ujung sebagai tulang punggung untuk sistem AI yang dapat diverifikasi, ada sedikit pengawasan publik mengenai bagaimana log audit ini dikelola atau siapa yang mengontrol akses ke catatan sensitif. Ada risiko bahwa kontrol terpusat dapat merusak objektivitas dan menimbulkan masalah privasi baru.

Pada akhirnya, jika AI yang dapat diverifikasi bergantung pada mekanisme audit yang dapat dipercaya seperti yang ditawarkan oleh Mira Audit Trails, industri harus secara ketat mempertanyakan tidak hanya apa yang dicatat—tetapi bagaimana transparansi diterjemahkan menjadi akuntabilitas yang bermakna bagi semua pihak yang terlibat.

#Mira @Mira - Trust Layer of AI $MIRA #MarketSentimentToday #MarketUpdate #UsaAttack #IranIsraelConflict