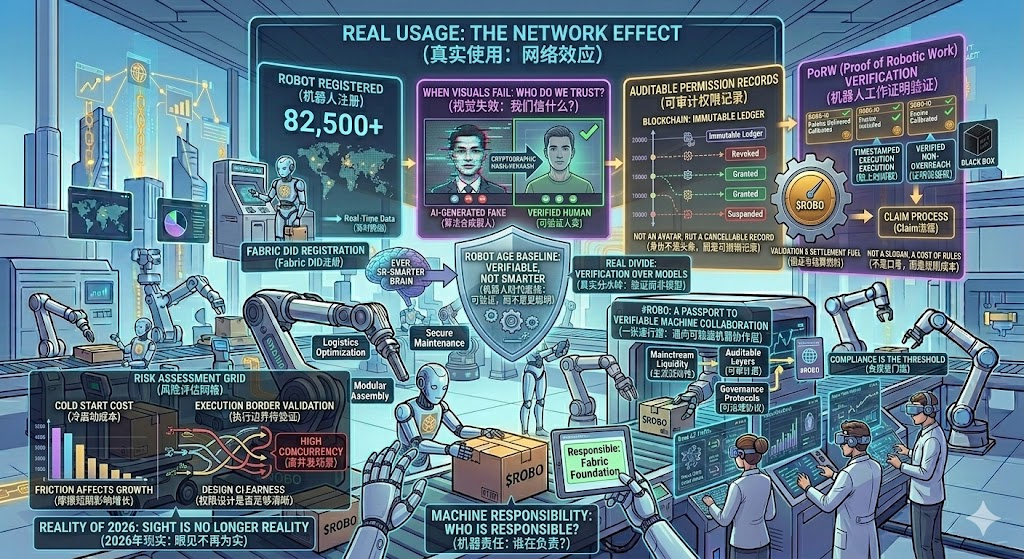

Baru-baru ini saya melihat kasus penipuan AI mengganti wajah: Keuangan perusahaan multinasional telah dipicu untuk mengalihkan sejumlah besar uang dalam "rapat video seluruh eksekutif", dan setelah itu baru menyadari, bahwa selain dirinya sendiri, "rekan" di layar semuanya adalah hasil algoritma. Setelah membacanya, saya hanya merasa dingin. Realitas tahun 2026 adalah — apa yang terlihat tidak lagi nyata, suara juga tidak lagi menjadi bukti. Kita sedang memasuki lingkungan di mana manusia dan mesin sulit dibedakan, setiap interaksi bisa jadi adalah kesalahan pemberian hak. Maka pertanyaannya menjadi tajam: ketika agen cerdas mulai terlibat dalam aktivitas ekonomi, siapa yang bisa membuktikan siapa mereka, apa yang mereka miliki, dan apa yang telah mereka lakukan?

Yang bertentangan dengan intuisi adalah, titik pemisah yang sebenarnya bukanlah model yang lebih kuat, melainkan verifikasi yang lebih ketat.

Pertama, identitas bukanlah avatar, melainkan catatan izin yang dapat dibatalkan dan diaudit. Proses klaim yang melibatkan tanda tangan, konfirmasi, dan syarat tampak rumit di permukaan, tetapi pada dasarnya mirip dengan memberikan 'surat keterangan baik' kepada mesin di masa depan—bukan untuk membagi uang, tetapi untuk meninggalkan jejak perilaku yang dapat dilacak.@Fabric Foundation Anggaplah proses ini sebagai eksperimen perilaku di blockchain: siapa yang bersedia memberikan dukungan untuk aturan, merekalah yang akan masuk ke dalam jaringan.

Kedua, verifikasi bukanlah 'membuktikan bahwa kamu sangat pintar', melainkan 'membuktikan bahwa kamu tidak melanggar batas'. Apa yang disebut Pekerjaan Terverifikasi lebih mirip dengan memberikan cap waktu dan rantai tanggung jawab pada setiap eksekusi. Ini bisa dipahami sebagai 'kotak hitam' dalam buku besar publik: ketika terjadi masalah, dapat diputar ulang, dan saat ada sengketa, dapat dilacak.$ROBO Di dalamnya, berperan sebagai bahan bakar untuk verifikasi dan penyelesaian—bukan sekadar slogan, tetapi barang konsumsi yang membuat aturan benar-benar berfungsi.

Ketiga, kepatuhan bukanlah hiasan, melainkan batasan untuk memasuki likuiditas arus utama. Tindakan demonstrasi pada 27 Februari membuat dunia luar menyadari bahwa jalan ini bukanlah untuk bersenang-senang sendiri. Daripada melihatnya sebagai sebuah token, lebih baik melihat #ROBO sebagai sebuah paspor: jalan menuju lapisan kolaborasi mesin yang dapat diverifikasi, dapat dikelola, dan dapat diaudit.

Risiko juga harus dijelaskan. Pertama, biaya awal tidak rendah. Proses yang rumit akan menyaring spekulan, tetapi juga mungkin menghalangi sebagian pengguna yang sebenarnya; gesekan yang ditimbulkan oleh verifikasi dalam jangka pendek akan mempengaruhi laju pertumbuhan. Kedua, batasan eksekusi masih perlu dibuktikan. Apakah desain identitas, izin, dan syarat penghentian cukup jelas, dan dapatkah tetap efisien dalam skenario dengan banyak permintaan, masih perlu waktu untuk diuji.

Jika mekanisme verifikasi dapat diterapkan secara nyata oleh pihak dalam skenario, biaya verifikasi akan turun seiring dengan skala, jaringan kolaborasi akan lebih mungkin berkembang, dan proses seperti Klaim akan menjadi norma industri; sebaliknya, jika gesekan terus-menerus melebihi manfaat, jaringan mungkin terjebak dalam tahap awal dingin, dan struktur kepercayaan sulit terbentuk. Mesin akan semakin pintar, tetapi jika tidak ada aturan yang mendasari, kecerdasan hanya akan memperbesar risiko. Masalahnya bukan lagi 'seberapa kuat AI', tetapi 'siapa yang bertanggung jawab atasnya'.