Saya menghabiskan banyak waktu untuk menjelajahi alat AI tahap awal, terutama yang kecil tim terburu-buru untuk dijadikan produk. Sesuatu terus menarik perhatian saya: proyek-proyek ini biasanya menunjukkan ide teknis yang berani, tetapi keandalannya belum ada. Model-modelnya mengesankan, tentu saja, tetapi pendiri dengan tenang mengakui bahwa mereka masih membutuhkan orang di belakang layar untuk memeriksa hasilnya. Kesenjangan antara apa yang dapat dilakukan teknologi dan apa yang sebenarnya dipercaya orang berakhir menjadi tempat sebagian besar pekerjaan rekayasa nyata saat ini.

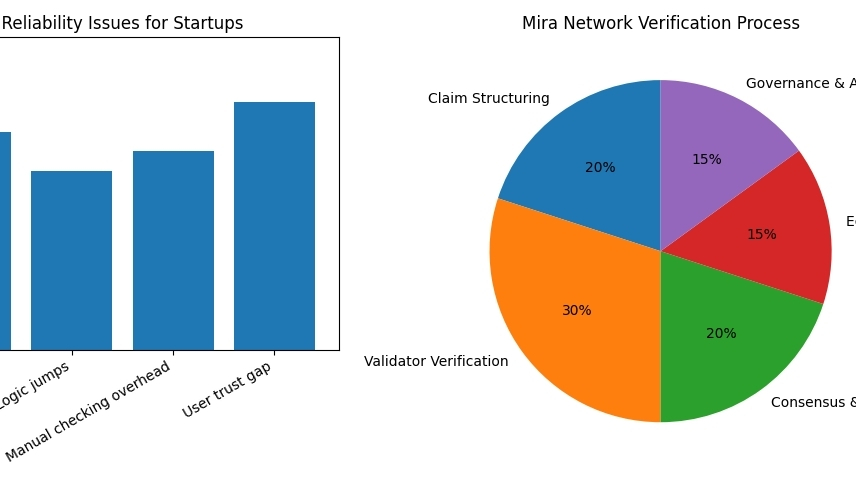

Sejujurnya, membangun model AI bukan lagi sakit kepala utama bagi startup. Model sumber terbuka, API, dan penyempurnaan telah membuatnya jauh lebih mudah untuk bereksperimen dan mencoba-coba. Bagian yang sulit adalah meyakinkan orang bahwa output Anda cukup solid untuk digunakan dalam alur kerja nyata. Jawaban yang halusinasi, logika yang melompat-lompat, dan hasil yang tidak dapat Anda verifikasi adalah risiko nyata. Demo mungkin terlihat mengesankan, tetapi ketika akurasi sebenarnya penting, saat itulah segalanya menjadi kacau. Jadi tim baiknya memperlambat segalanya dengan pemeriksaan manual atau memutuskan untuk hidup dengan tingkat ketidakpastian yang membuat investor dan pengguna cemas.

Ini agak seperti mencoba melakukan akuntansi perusahaan Anda dengan kalkulator yang kadang-kadang hanya membuat angka.

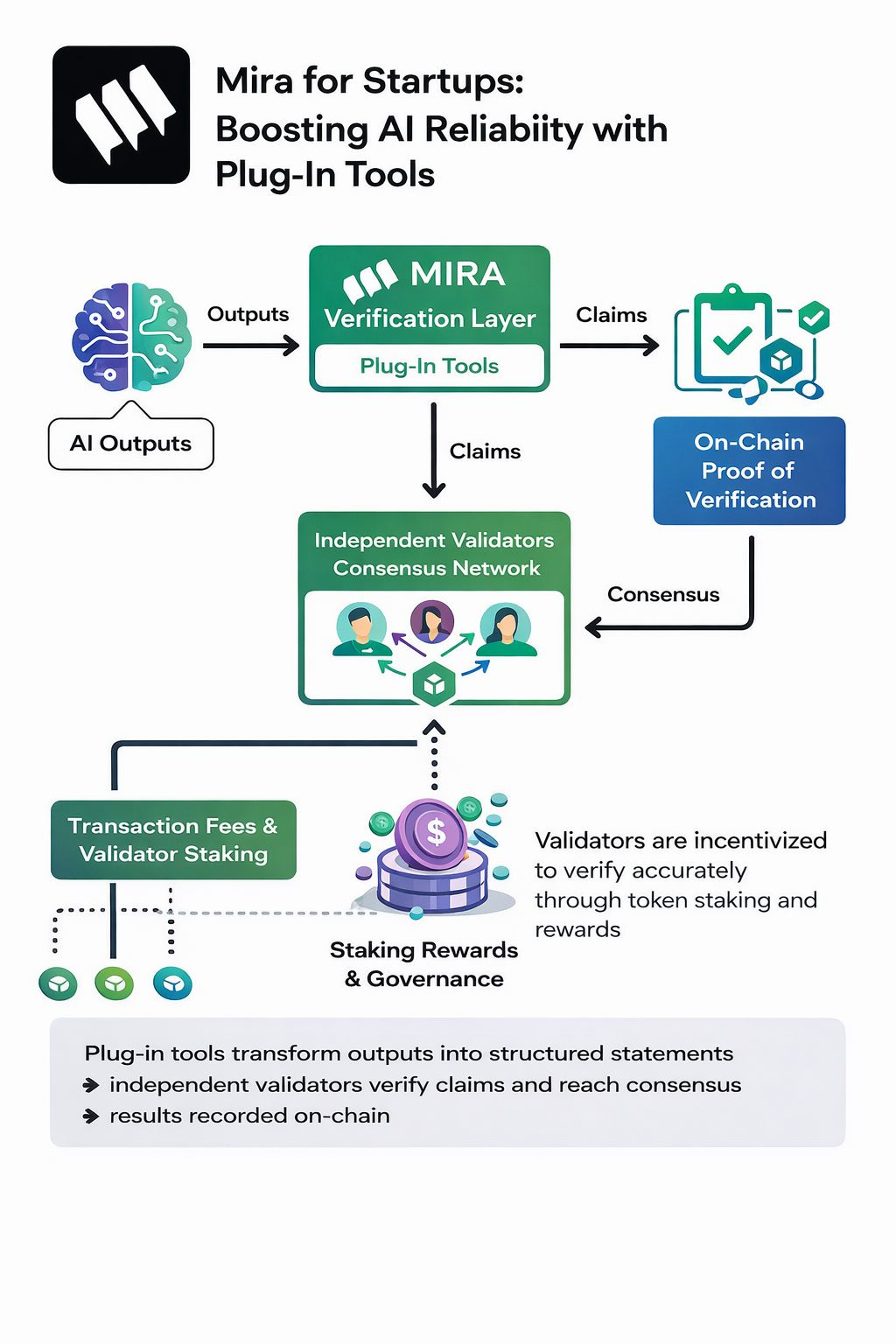

Itu adalah tempat Mira Network berperan. Alih-alih fokus pada pelatihan model agar lebih dapat diandalkan, Mira menyerang masalah dari sisi verifikasi. Ini tidak hanya menerima output AI apa adanya. Sebaliknya, ia memperlakukan setiap jawaban sebagai klaim yang perlu diperiksa oleh orang lain. Ketika AI mengeluarkan hasil, Mira membaginya menjadi pernyataan terstruktur yang benar-benar dapat Anda uji. Ini diteruskan melalui jaringan validator independen yang memeriksa apakah klaim tersebut benar. Setiap pemeriksaan dicatat, jadi alih-alih hanya "AI mengatakan begitu," Anda mendapatkan jejak yang benar-benar dapat Anda ikuti.

Di dalam prosesnya cukup berlapis. Pertama, output AI mentah diubah menjadi klaim yang dapat dibaca mesin, pada dasarnya, mengubah teks atau penalaran menjadi pernyataan yang jelas. Kemudian, lapisan verifikasi mengirim klaim tersebut kepada validator yang dipilih melalui proses konsensus, yang membantu menjaga bias tetap terkendali. Validator memeriksa klaim dengan cara mereka sendiri menggunakan alat atau sumber mereka sendiri lalu mengajukan suara yang ditandatangani. Suara-suara tersebut digabungkan menjadi hasil konsensus, yang dicatat di rantai. Dengan tanda tangan kriptografis dan catatan yang dapat diverifikasi di setiap langkah, Anda tidak hanya mendapatkan jawaban kotak hitam; Anda mendapatkan bukti bahwa jaringan memeriksa hal-hal sesuai dengan aturan yang disepakati.

Mengapa ini penting bagi startup? Sebagian besar tidak mampu mempekerjakan tim besar untuk membangun pemeriksaan keamanan khusus. Dengan Mira, mereka dapat langsung memasang alat yang mengirim output AI melalui lapisan verifikasi eksternal ini. Jaringan berubah menjadi layanan keandalan. Ini tidak menggantikan model Anda; ia hanya membungkus apa yang sudah Anda miliki dan memberi tahu Anda apakah jawaban tersebut dapat bertahan dari pemeriksaan luar.

Ada juga lapisan ekonomi yang menjaga semua orang tetap jujur. Validator mempertaruhkan token untuk bergabung, dan mereka mendapatkan imbalan ketika suara mereka cocok dengan konsensus. Jika mereka mencoba untuk menipu atau hanya salah, mereka berisiko kehilangan taruhan tersebut. Biaya transaksi mendanai proses tersebut, dan tata kelola memungkinkan peserta untuk menyesuaikan hal-hal seperti bagaimana validator dipilih atau bagaimana sengketa diselesaikan. Nilai token, kemudian, berasal dari permintaan aktual untuk verifikasi bukan hanya hype tentang kinerja model.

Tentu saja, pendekatan ini tidak sempurna. Verifikasi terdistribusi memakan waktu dan biaya, jadi tidak akan bekerja untuk setiap kebutuhan waktu nyata. Akurasi sistem juga tergantung pada memiliki kumpulan validator yang beragam dan dirancang dengan baik serta struktur klaim yang solid. Jika salah satu menjadi malas atau terkonsentrasi, Anda kehilangan keunggulan keandalan.

Dan selalu ada hal yang tidak diketahui. AI bergerak cepat, dan trik verifikasi hari ini tidak akan selalu berhasil seiring dengan semakin kompleksnya model. Kerangka kerja Mira bukan tentang menghentikan halusinasi selamanya, tetapi tentang membangun proses yang dapat beradaptasi saat perilaku AI baru muncul.

Ini yang menarik bagi startup: keandalan berhenti menjadi sesuatu yang harus Anda bangun dan pertahankan sendiri. Sebaliknya, itu berubah menjadi lapisan infrastruktur bersama. Mira membingkai kembali kepercayaan pada output AI bukan sebagai sesuatu yang hidup di dalam model Anda, tetapi sebagai sesuatu yang dapat Anda negosiasikan, verifikasi, dan catat di seluruh jaringan terdistribusi. Apakah startup ikut bergabung kemungkinan besar tergantung pada seberapa mudah alat verifikasi ini cocok dengan siklus pengembangan cepat yang mereka andalkan.

@Mira - Trust Layer of AI $MIRA #Mira