Dalam dunia kecerdasan buatan yang bergerak cepat, sebagian besar proyek mengejar tujuan yang sama: lebih banyak kecepatan, lebih banyak skala, dan hasil yang lebih mengesankan. Tetapi Mira Network mendekati masalah ini dari sudut pandang yang sangat berbeda. Alih-alih fokus pada seberapa kuat AI bisa menjadi, ia fokus pada pertanyaan yang lebih sulit dan tidak nyaman: Apa yang terjadi ketika orang mulai mempercayai jawaban AI terlalu mudah?

Pertanyaan ini berada di pusat filosofi Mira.

Hari ini, banyak sistem AI dinilai berdasarkan seberapa lancar mereka menghasilkan bahasa. Jika sebuah jawaban terdengar percaya diri, terstruktur, dan cerdas, orang cenderung menerimanya. Masalahnya adalah bahwa kelancaran bukanlah hal yang sama dengan keandalan. Model AI dapat menghasilkan penjelasan yang halus yang terdengar meyakinkan sementara masih mengandung kesalahan halus, salah tafsir, atau kesimpulan yang dilebih-lebihkan.

Dan begitu sebuah jawaban tampak lengkap, sebagian besar pengguna jarang berhenti untuk memverifikasinya. Mereka membacanya, menerimanya, dan melanjutkan. Perilaku itu menciptakan risiko yang tenang namun serius: AI dapat salah dengan cara yang sangat meyakinkan.

Jaringan Mira tampaknya memahami masalah ini lebih baik daripada sebagian besar proyek di ruang AI-kripto.

Alih-alih berusaha membuat keluaran AI lebih mengesankan, Mira fokus pada membuat kepercayaan lebih sulit diberikan tanpa verifikasi. Ini mengalihkan percakapan dari kinerja murni menuju sesuatu yang lebih penting—penilaian dan akuntabilitas.

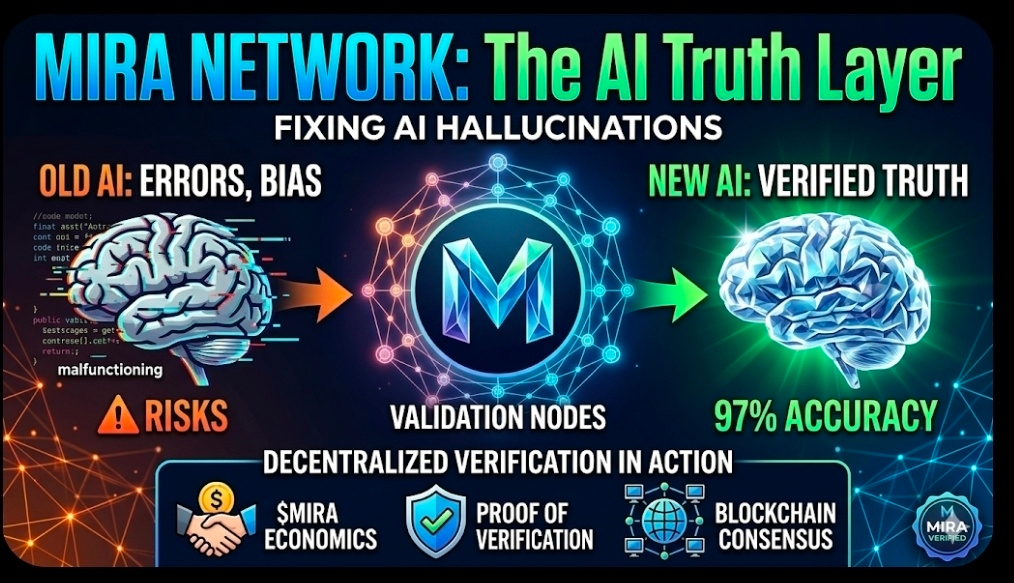

Di inti pendekatan Mira adalah ide sederhana namun kuat: keluaran AI tidak boleh dipercaya hanya karena satu sistem yang memproduksinya. Mereka harus diverifikasi.

Ini berarti klaim yang dibuat oleh sistem AI harus melalui proses di mana mereka diperiksa dan divalidasi sebelum diperlakukan sebagai dapat diandalkan. Kepercayaan harus datang setelah verifikasi, bukan sebelum itu.

Meskipun konsep itu terdengar jelas, sebagian besar ekosistem AI saat ini masih berasumsi bahwa model yang lebih baik pada akhirnya akan menyelesaikan masalah kepercayaan dengan sendirinya. Pelatihan yang ditingkatkan, dataset yang lebih besar, sistem pengambilan yang lebih kuat, dan antarmuka yang lebih baik mungkin mengurangi kesalahan—tetapi mereka tidak dapat menghilangkannya sepenuhnya.

Bahkan model yang paling canggih pun masih dapat menghasilkan kesalahan yang meyakinkan.

Mira memulai dari asumsi yang lebih disiplin: masalah kepercayaan dalam AI tidak hanya tentang model yang lebih baik—tetapi tentang membangun sistem yang memverifikasi keluaran.

Menariknya, filosofi ini sangat selaras dengan prinsip-prinsip di balik teknologi blockchain. Crypto awalnya dibangun atas skeptisisme terhadap kepercayaan terpusat. Alih-alih bergantung pada satu otoritas, sistem blockchain menggunakan validasi terdistribusi untuk mengonfirmasi informasi.

Mira menerapkan pola pikir yang sama itu pada kecerdasan buatan.

Alih-alih mengasumsikan bahwa kecerdasan secara otomatis layak mendapatkan kepercayaan, proyek ini berusaha menciptakan kerangka kerja di mana keluaran AI harus mendapatkan kredibilitas melalui verifikasi.

Ini membuat Mira kurang tentang produksi AI dan lebih tentang akuntabilitas AI.

Alasan lain proyek ini terasa terhubung adalah karena mencerminkan perilaku pengguna yang nyata. Dalam praktiknya, orang jarang memeriksa ulang respons AI. Sebagian besar pengguna sibuk dan lebih memilih jawaban cepat. Ketika respons AI terlihat rapi dan lengkap, itu secara alami menurunkan dorongan untuk mempertanyakannya.

Mira tampaknya dirancang dengan kenyataan itu dalam pikiran. Alih-alih mengharapkan pengguna menjadi pemeriksa fakta yang sempurna, Mira berusaha membangun verifikasi langsung ke dalam sistem.

Pendekatan ini semakin penting saat AI mulai mempengaruhi keputusan daripada hanya menghasilkan teks.

Fase berikutnya dari AI bukan hanya tentang menulis ringkasan atau menjawab pertanyaan. Ini akan semakin membantu orang menafsirkan informasi, mengevaluasi peluang, menganalisis risiko, dan membuat keputusan.

Ketika AI beroperasi di area tersebut, kesalahan tidak lagi tidak berbahaya.

Sebuah keluaran yang cacat dapat mempengaruhi investasi, keputusan pemerintahan, kesimpulan penelitian, atau strategi bisnis. Pada titik itu, konsekuensi dari kesalahan menjadi nyata. Kesalahan AI berhenti menjadi kesalahan memalukan—mereka menjadi risiko operasional.

Di situlah tesis Mira mulai mendapatkan kekuatan.

Proyek ini pada dasarnya menjelajahi apakah kepercayaan pada keluaran AI dapat menjadi bentuk infrastruktur, alih-alih sesuatu yang hanya diasumsikan oleh pengguna. Alih-alih meminta sistem AI untuk menghasilkan lebih banyak jawaban, Mira menanyakan apakah lingkungan di sekitar jawaban tersebut dapat membuat kepercayaan yang salah lebih sulit untuk diciptakan.

Beberapa proyek saat ini sedang bekerja di lapisan itu.

Sebagian besar platform AI bersaing dalam kemampuan—siapa yang dapat menghasilkan respons lebih cepat, teks lebih cerdas, atau otomatisasi yang lebih canggih. Mira, sebaliknya, berusaha bersaing dalam kredibilitas.

Itu adalah pasar yang jauh lebih sulit untuk dibangun. Verifikasi memperkenalkan gesekan. Ini dapat menambah waktu, biaya, dan kompleksitas. Pengembang dan pengguna hanya akan menerima trade-off tersebut jika manfaatnya jelas terlihat.

Ini menjadi tantangan terbesar Mira.

Keberhasilan proyek ini akan bergantung pada apakah verifikasi menjadi praktis perlu, bukan hanya secara teoritis menarik. Jika orang mengagumi konsep tetapi menghindari penggunaannya karena merasa tidak nyaman, Mira bisa tetap menjadi ide yang kuat tanpa adopsi yang luas.

Namun, jika keluaran AI yang tidak terverifikasi mulai terasa berisiko—terutama di lingkungan di mana keputusan membawa konsekuensi nyata—verifikasi bisa menjadi penting.

Ketika itu terjadi, sistem seperti Mira bisa beralih dari alat opsional menjadi infrastruktur dasar, mirip dengan lapisan keamanan di internet.

Sistem tak terlihat seringkali menjadi yang paling penting setelah teknologi matang. Ketika verifikasi berjalan baik, pengguna mungkin hampir tidak menyadarinya. Mereka hanya mengalami lebih sedikit keluaran yang menyesatkan dan mendapatkan kepercayaan.

Ketiadaan kesalahan itu bisa sulit untuk dipasarkan, tetapi nilainya bisa sangat besar.

Pada akhirnya, Jaringan Mira bukan hanya proyek AI lain yang terhubung dengan teknologi blockchain. Ini mewakili sebuah upaya untuk memformalkan skeptisisme di era di mana mesin dapat berbicara dengan meyakinkan.

Alih-alih mempercayai jawaban karena terdengar cerdas, Mira mencoba menciptakan proses di mana jawaban dipercaya karena mereka bertahan dalam verifikasi.

Ambisi itu lebih sempit daripada banyak narasi AI, tetapi juga lebih dalam. Proyek ini tidak mengejar cerita yang paling luas tentang kecerdasan buatan. Sebaliknya, ia menjelajahi masalah spesifik dan semakin penting: bagaimana membangun kepercayaan dalam informasi yang dihasilkan oleh AI.

Ketika AI menjadi lebih terlibat dalam bagaimana orang menafsirkan data, mengevaluasi risiko, dan membuat keputusan, masalah itu hanya akan semakin relevan.

Mira memposisikan dirinya langsung di dalam celah antara penampilan dan keandalan.

\u003ct-21/\u003e

\u003cm-48/\u003e

\u003ct-118/\u003e

\u003cc-6/\u003e