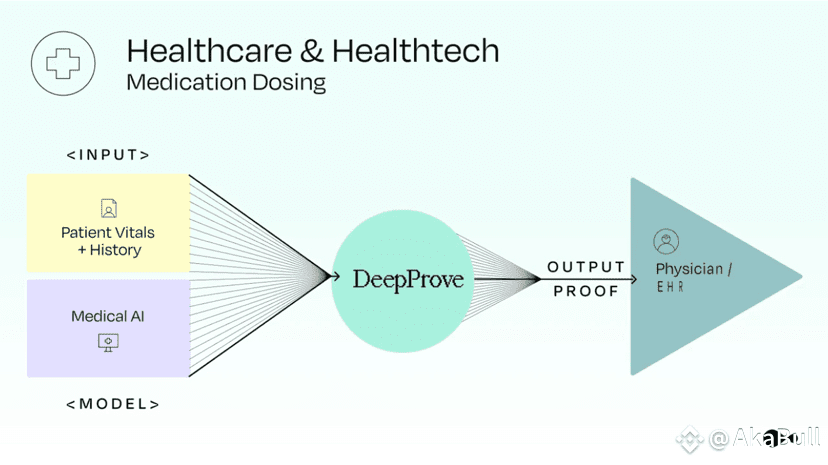

L'IA sta già giocando un grande ruolo negli ospedali, dall'aiutare i medici a calcolare i dosaggi dei farmaci al raccomandare percorsi di trattamento. Ma c'è un problema: se viene utilizzato il modello di IA sbagliato o se i risultati sono imprecisi, le conseguenze possono essere fatali.

È qui che entra in gioco DeepProve di Lagrange. Aggiunge uno strato mancante di prova a ogni decisione medica guidata dall'IA.

Ecco come funziona nella pratica:

I dati vitali e la storia medica di un paziente vengono inseriti.

Un modello di intelligenza artificiale suggerisce un dosaggio o un trattamento.

DeepProve interviene per verificare gli input, il modello e gli output dell'IA.

Il risultato verificato viene poi consegnato al medico.

Questo significa che i medici non ricevono solo un suggerimento dall'IA — ricevono una raccomandazione provabilmente corretta e verificabile supportata da prove concrete.

Per gli ospedali, questo cambia tutto. Garantisce:

Le raccomandazioni sui dosaggi sono sempre affidabili.

Le decisioni dell'IA sono supportate da prove, non da assunzioni.

Le chiamate salvavita possono essere effettuate alla velocità dell'assistenza in tempo reale.

In @Lagrange Official , la visione è chiara: ogni decisione chiave che impatta le vite dovrebbe essere provabile e sicura. DeepProve si assicura di questo, ponendo una base per un'IA affidabile nella sanità.

L'IA può aiutare a salvare vite — ma solo se possiamo fidarci di essa. #DeepProve rende possibile questa fiducia.