Quando le persone immaginano il futuro dell'IA nei sistemi blockchain, spesso visualizzano una scena familiare. Un portafoglio si apre, una transazione appare e qualcosa preme approva. Forse il clic è più veloce, forse è automatizzato, forse è attivato da un software invece che da un dito. Ma la forma dell'interazione rimane la stessa. Una richiesta, seguita dal consenso.

Questo modello mentale sembra intuitivo perché preserva ciò a cui siamo abituati. Mantiene vivo il dramma umano del permesso. Presuppone che l'intelligenza accelererà semplicemente ciò che gli individui già fanno.

Tuttavia, una volta che inizi a osservare come funzionano gli agenti reali, l'illusione si rompe.

Un agente AI non è un umano più veloce. Non sta aspettando di essere interrogato. Sta operando all'interno di un mandato. Esiste per perseguire risultati in modo continuo, spesso attraverso migliaia di passaggi che non hanno un inizio o una fine naturali. Non c'è un momento ovvio per interrompere e richiedere approvazione, perché l'agente non sta pensando in momenti. Sta pensando in traiettorie.

Pertanto il wallet, così come lo conosciamo, diventa un collo di bottiglia non perché sia lento, ma perché assume che la responsabilità venga assegnata dopo il fatto.

Gli agenti hanno bisogno di responsabilità definite prima dell'azione.

E questo è un problema infrastrutturale completamente diverso.

I wallet sono stati inventati per l'assegnazione della colpa

Questo potrebbe sembrare scomodo, ma è vero. Una conferma del wallet è un rituale che risponde a una domanda sopra tutte le altre. Chi ha deciso.

Se qualcosa va storto, cerchiamo la firma. Il clic diventa prova di intenzione. Il consenso è catturato ai margini dell'esecuzione. Questo è estremamente utile nei sistemi umani perché rende la responsabilità visibile.

Ma gli agenti AI non operano con intenzione episodica. Seguono modelli, politiche, probabilità e obiettivi. Se li interrompi per il consenso ogni volta, rimuovi la loro autonomia. Se non li interrompi, perdi la tua prova tradizionale di decisione.

Quindi la sfida diventa questa. Come può esistere un'autorità senza firme costanti.

Hai bisogno di un modo per codificare la responsabilità in anticipo.

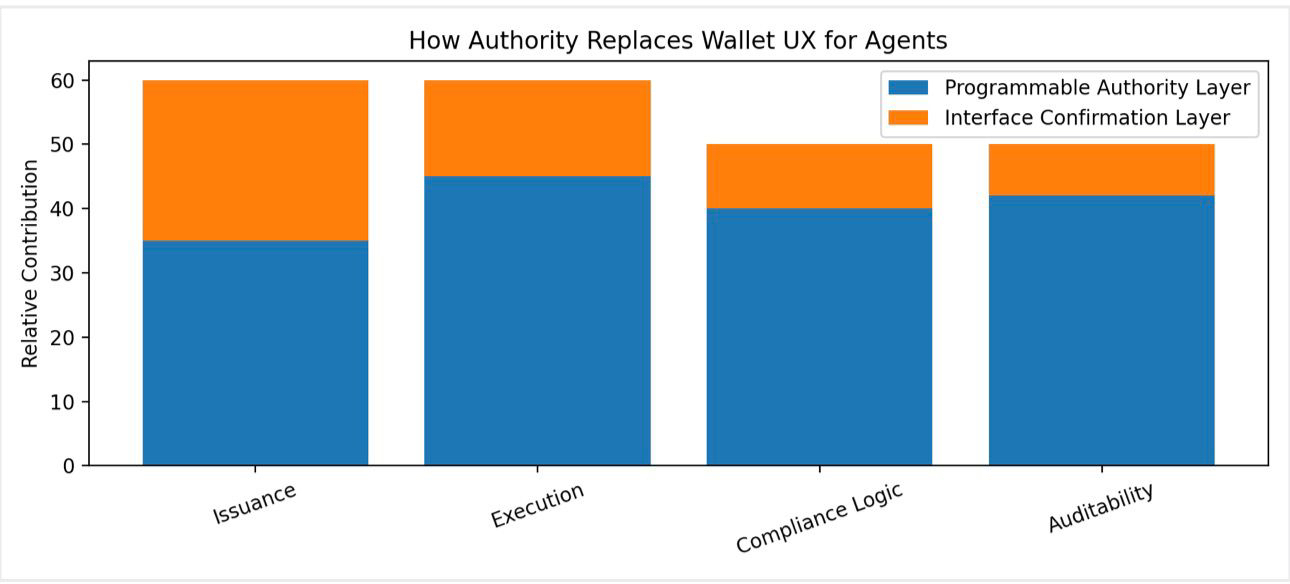

Il preimpegno sostituisce la conferma

Invece di approvare singole transazioni, gli esseri umani che supervisionano gli agenti approveranno quadri. Parametri di rischio. Ambiti di asset. Comportamenti consentiti. Regole di escalation. Questi diventano i confini entro i quali l'intelligenza è libera di agire.

Pensalo come assumere qualcuno. Non gli chiedi prima di ogni azione. Definisci la loro descrizione del lavoro e i limiti. Se rimangono all'interno di quei limiti, sono autorizzati. Se li superano, si applicano conseguenze.

Questo è il modo in cui la responsabilità si espande.

La rilevanza di VANAR emerge qui perché si concentra su ambienti in cui la logica può persistere e essere applicata in modo coerente. L'autorità diventa programmabile. Il sistema sa non solo cosa è successo, ma se era consentito.

Questo è molto più potente di un pulsante.

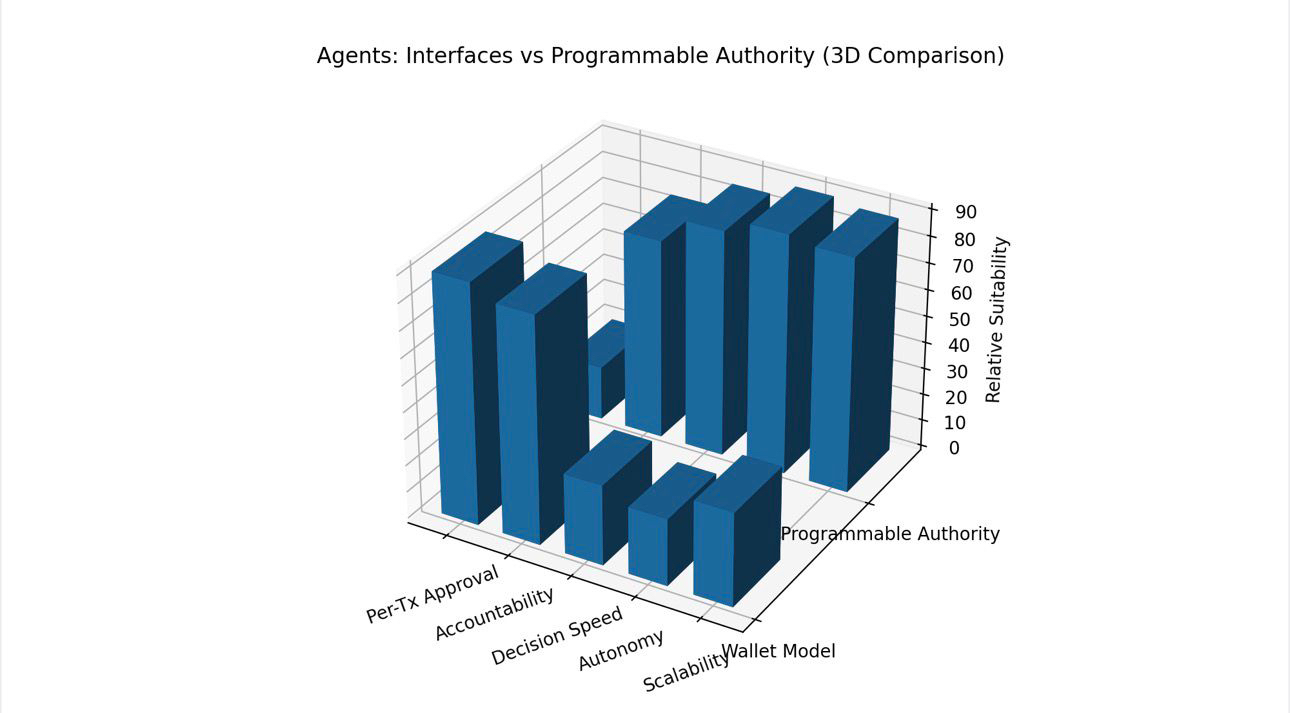

Perché l'UX in stile umano collassa sotto la delega

Se gli agenti AI diventano comuni, il numero di azioni esploderà. Anche piccoli sistemi autonomi potrebbero produrre volumi ben oltre ciò che gli individui potrebbero supervisionare manualmente. Richiedere flussi di portafoglio tradizionali paralizzerebbe l'attività o spingerebbe le persone verso approvazioni generiche pericolose.

Né è sostenibile.

Invece, ciò che è necessario è una delega strutturata. Un modo per gli esseri umani di rimanere in controllo senza essere presenti a ogni decisione.

Questo non è un problema teorico. Le imprese ci si confrontano già. Scrivanie di trading, catene di approvvigionamento, reparti di conformità. L'autorità è distribuita attraverso regole, non attraverso riunioni costanti.

Web3 sta finalmente entrando in quel territorio.

Gli agenti sono estensioni delle istituzioni, non degli individui

Questo è un altro cambiamento che molti sottovalutano. Quando i sistemi AI controllano gli asset, si comportano più come reparti che come utenti. Gestiscono responsabilità. Operano budget. Perseguono metriche di performance.

Un wallet progettato per la custodia personale fatica a rappresentare quella complessità. Vede solo chiavi e saldi. Non comprende gerarchia, ruolo o mandato.

L'approccio di VANAR agli ambienti di esecuzione consente strutture più sfumate. Le autorizzazioni possono allinearsi con la logica organizzativa. Le azioni possono essere ricondotte a un'autorità definita piuttosto che a clic isolati.

Questo è il modo in cui la vera finanza opera.

Quantitativamente, la delega è inevitabile

Se immaginiamo solo un milione di agenti a livello globale che prendono dieci decisioni moderate al minuto, questo equivale a oltre quattordici miliardi di azioni al giorno. Nessun modello di supervisione basato sulla conferma individuale sopravvive a quella scala.

Pertanto i sistemi devono maturare.

La responsabilità deve diventare architettonica.

La trasparenza evolve anch'essa

È interessante notare che l'autorità programmabile può aumentare la trasparenza. Invece di vedere semplicemente che qualcosa è accaduto, gli osservatori possono vedere se ha rispettato regole predefinite. La conformità diventa verificabile.

Per le istituzioni, questo è inestimabile. Riduce l'incertezza senza sacrificare l'automazione.

VANAR diventa il sistema operativo della responsabilità

Trattando l'esecuzione come qualcosa di continuo e supportando logiche persistenti, VANAR crea condizioni in cui gli agenti possono agire con fiducia mentre gli esseri umani rimangono responsabili.

Collega autonomia e controllo.

Il cambiamento emotivo

Per molti utenti, questa transizione sembra scomoda. Lasciare che le macchine operino senza chiedere ogni volta sembra come abbandonare il controllo.

Tuttavia, nella pratica, gli esseri umani si affidano già costantemente all'automazione. Gli algoritmi instradano il traffico internet. Il software bilancia le reti elettriche. I sistemi approvano il credito in millisecondi. La supervisione esiste, ma è strutturale.

La crypto sta recuperando.

Il mio punto di vista

Penso che il dibattito sugli wallet AI sia inquadrato in modo errato. Le persone si chiedono come migliorare le interfacce per gli agenti. La domanda migliore è come rendere l'autorità più chiara prima che gli agenti agiscano.

Una volta che pensi in questo modo, il futuro diventa ovvio.

Il wallet svanisce. La politica rimane. L'infrastruttura porta responsabilità.

E le reti che comprendono questo cambiamento in anticipo diventeranno case naturali per sistemi autonomi.

VANAR si sta muovendo in quella direzione.