Mira Network ha più senso se vista non come un tentativo di creare intelligenza artificiale più intelligente, ma come uno sforzo per rendere le uscite dell'IA sufficientemente affidabili da essere trattate come input verificati. L'obiettivo reale sembra essere meno quello di migliorare come suonano i modelli e più quello di trasformare le loro risposte in risultati che portano responsabilità, simile a numeri finanziari auditati o transazioni confermate. Quando ho esaminato per la prima volta il concetto, sembrava chiaro che l'ambizione è l'affidabilità piuttosto che l'intelligenza da sola.

Il progetto inizia con un'osservazione semplice. Un singolo modello di IA può generare risposte sicure e ben curate pur essendo comunque errato. Per usi casuali come la redazione di idee o il brainstorming, quell'errore potrebbe causare solo inconvenienti. Ma quando i sistemi di IA iniziano a attivare azioni automatiche che coinvolgono pagamenti, permessi, controlli di conformità o decisioni di sicurezza, anche gli errori rari diventano critici. Mira sembra essere costruito attorno all'accettazione di questa verità scomoda invece di ignorarla.

Suddividere l'Output dell'IA in Unità Verificabili

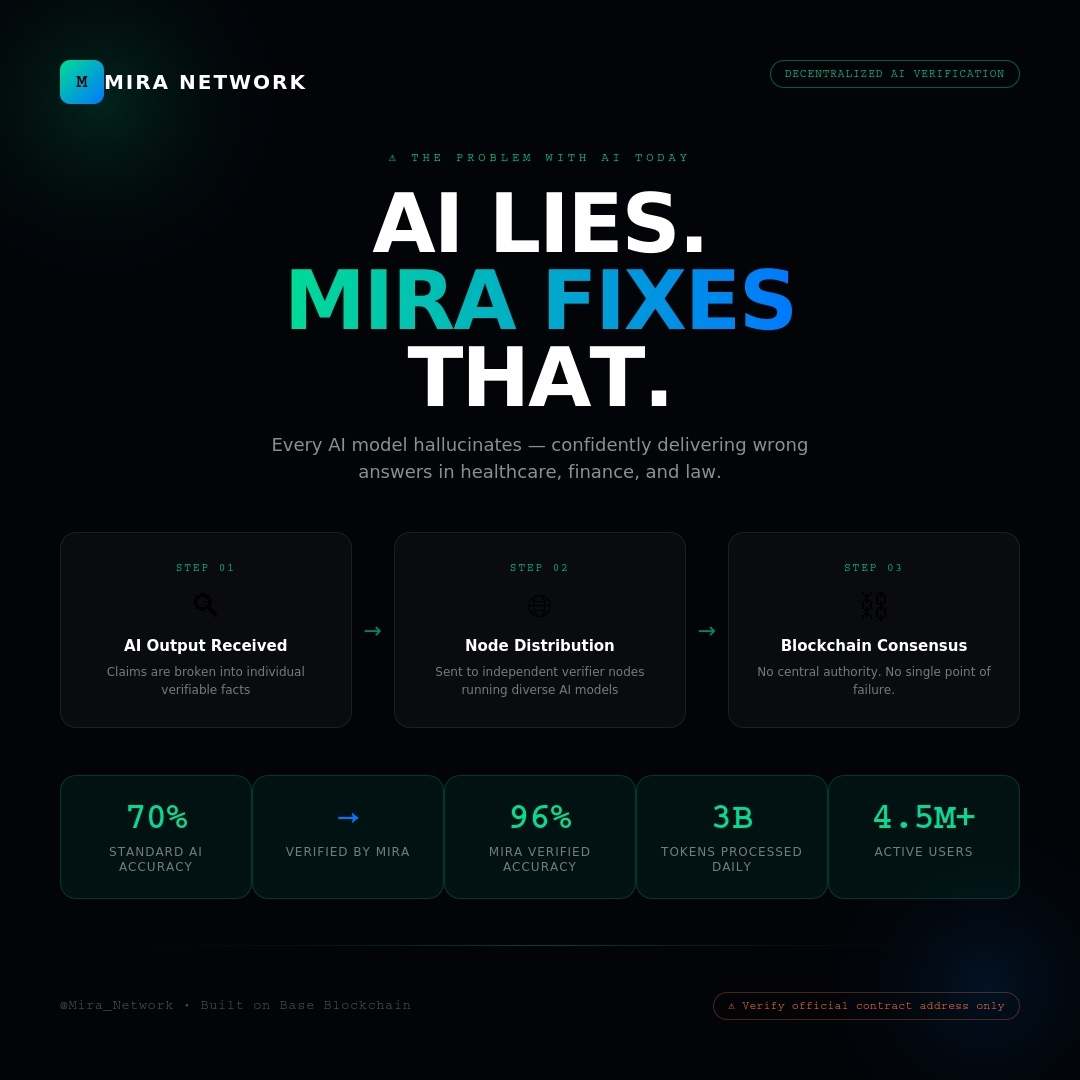

Invece di fidarsi della conclusione di un modello, Mira introduce un processo che separa una risposta dell'IA in componenti più piccoli noti come affermazioni. Queste affermazioni rappresentano dichiarazioni specifiche che la rete può valutare indipendentemente. Ho notato che questo passaggio cambia tutto perché una volta che il linguaggio diventa affermazioni strutturate, il sistema può instradarle per il controllo, metterle in discussione, confrontare i risultati e infine arrivare a un risultato verificato.

Questa fase di decomposizione ha più importanza di quanto possa apparire inizialmente. Il modo in cui le affermazioni sono formate determina cosa può essere effettivamente verificato e quanto costoso diventa il processo. Se le affermazioni sono troppo ampie, la verifica si trasforma in dibattiti vaghi su risposte intere. Se sono troppo ristrette, la verifica diventa costosa e inefficiente. L'efficacia di Mira dipende in gran parte dal trovare un equilibrio in cui le affermazioni restino significative pur essendo pratiche da controllare.

Verifica Guidata da Incentivi Invece di Opinioni

Dopo che le affermazioni sono state create, Mira si sposta verso un sistema di verifica costruito attorno alle conseguenze piuttosto che a un semplice accordo. La verifica non è trattata come un voto casuale, ma come un processo strutturato economicamente. I partecipanti responsabili della verifica devono assumersi dei rischi, i premi sono legati a giudizi accurati e ci sono penalità per comportamenti scorretti o sospetti. Dal mio punto di vista, questo fa sembrare il sistema un meccanismo di risoluzione piuttosto che una discussione comunitaria.

Il ragionamento è semplice. Se i partecipanti potessero guadagnare premi senza accuratezza, il sistema si riempirebbe rapidamente di contributi a basso sforzo. Allegando conseguenze finanziarie, la rete tenta di scoraggiare le congetture e incoraggiare una valutazione attenta. Invece di fare affidamento sulla buona volontà, gli incentivi guidano il comportamento verso risultati affidabili.

Modelli Indipendenti Multipli per Ridurre il Bias

Mira distribuisce anche la verifica attraverso modelli indipendenti multipli. L'idea qui è di evitare di fare affidamento su un singolo sistema che potrebbe avere debolezze nascoste. Negli ambienti del mondo reale, gli errori spesso appaiono in modelli. Quando molti sistemi dipendono da dati di addestramento o design del modello simili, tendono a fare errori simili. Introducendo valutatori indipendenti, Mira cerca di prevenire che punti ciechi condivisi diventino fallimenti sistemici.

Vedo questo approccio come simile ad avere più esaminatori che rivedono lo stesso lavoro piuttosto che consentire a un sistema di valutare se stesso. Prospettive indipendenti creano attrito, e quell'attrito può aiutare a esporre errori prima che diventino risultati accettati.

Costruire un Registro Crescente di Informazioni Verificate

Uno degli aspetti più interessanti appare dopo che la verifica è completata. Nel tempo, le affermazioni verificate possono accumularsi in una crescente collezione di risultati controllati. Invece di ripartire dalla verifica da zero ogni volta, i sistemi futuri potrebbero fare riferimento a affermazioni precedentemente risolte. Questo crea uno strato di affidabilità basato non su verità filosofiche, ma sulla storia di verifica documentata.

Quell'accumulo è importante perché l'affidabilità inizia a comporsi. Ogni risultato verificato contribuisce a una base riutilizzabile che riduce il lavoro ripetuto e rafforza la fiducia nei processi futuri. A mio avviso, questo trasforma la verifica da un'azione temporanea a un'infrastruttura duratura.

Rischi Nascosti All'interno del Processo di Verifica

Nonostante i forti obiettivi di design, rimangono diversi rischi specifici del progetto. Una preoccupazione principale riguarda la formazione delle affermazioni stesse. L'entità o il meccanismo responsabile della trasformazione degli output in affermazioni decide effettivamente quali domande la rete valuta. Anche con verifica decentralizzata, il controllo sulla struttura delle affermazioni può influenzare silenziosamente i risultati. Affermazioni mal formulate potrebbero portare il sistema verso conclusioni sicure ma errate.

Un altro rischio riguarda la possibilità di produrre certificati di verifica che appaiano affidabili senza effettivamente ridurre errori rari ma gravi. I sistemi ottimizzati per la velocità e l'accordo potrebbero trascurare casi limite difficili. Una rete di verifica sana dovrebbe mostrare occasionalmente disaccordo ed escalation, specialmente in domini complessi in cui la certezza richiede uno sforzo aggiuntivo. Se tutto viene verificato troppo rapidamente, potrebbe indicare una semplificazione eccessiva piuttosto che forza.

Bilanciamento della Privacy e Routing delle Informazioni

Il design della privacy gioca anche un ruolo importante nell'architettura di Mira. La rete descrive la suddivisione delle informazioni in modo che i singoli verificatori vedano solo input parziali, con ulteriori dettagli rivelati solo quando necessario. Questo approccio tenta di proteggere i dati sensibili pur consentendo una valutazione significativa. Tuttavia, bilanciare privacy e accuratezza è delicato. Troppo poco contesto può portare a errori di giudizio, mentre troppa esposizione rischia di rivelare informazioni private.

Il modo in cui le informazioni fluiscono attraverso il sistema influisce quindi sia sulla sicurezza che sulla qualità della verifica. Non è solo una caratteristica di privacy, ma un componente strutturale che influenza quanto la rete diventi resistente alla manipolazione.

Un sistema che premia l'accuratezza

Se dovessi riassumere il progetto in modo semplice, descriverei la rete Mira come un tentativo di costruire un sistema economico attorno all'essere corretti. L'accuratezza è misurata affermazione per affermazione, l'affidabilità è acquistata da coloro che hanno bisogno di risultati affidabili e le penalità scoraggiano la partecipazione distratta. L'attenzione non è sulla promessa di una verità perfetta, ma sulla creazione di un processo in cui la verifica si comporta come un'infrastruttura responsabile.

Quella direzione è ciò che rende il progetto davvero coinvolgente per me. Invece di fare affidamento sull'assunzione che l'IA di solito funzioni abbastanza bene, Mira tenta di trasformare la verifica in qualcosa di misurabile, verificabile e fondato economicamente. Trattando la correttezza come una risorsa che può essere valutata e premiata, il progetto avvicina i risultati dell'IA a qualcosa in cui le organizzazioni potrebbero effettivamente fidarsi in ambienti operativi reali.

@Mira - Trust Layer of AI $MIRA #Mira