IL LATO UMANO DELLA FIDUCIA NELL'ERA DELLE MACCHINE INTELLIGENTI

L'intelligenza artificiale sta diventando parte della nostra realtà quotidiana, e a volte sembra quasi magico quanto rapidamente possa rispondere a domande, analizzare dati o generare idee, eppure in fondo c'è sempre una piccola esitazione perché sappiamo tutti che sembrare intelligenti non è la stessa cosa che essere corretti. I sistemi di intelligenza artificiale sono addestrati per prevedere cosa dovrebbe venire dopo, e lo fanno estremamente bene, ma la previsione è diversa dalla prova, e quella differenza conta molto quando le decisioni riguardano denaro, salute, sicurezza o reputazione. Sono potenti, veloci e impressionanti, ma possono anche commettere errori in modi che sono difficili da notare all'inizio. Quella silenziosa incertezza è ciò che rende l'affidabilità una conversazione così importante oggi, e questo è esattamente lo spazio in cui Mira Network sta cercando di fare una vera differenza concentrandosi non solo sull'intelligenza ma anche sulla fiducia.

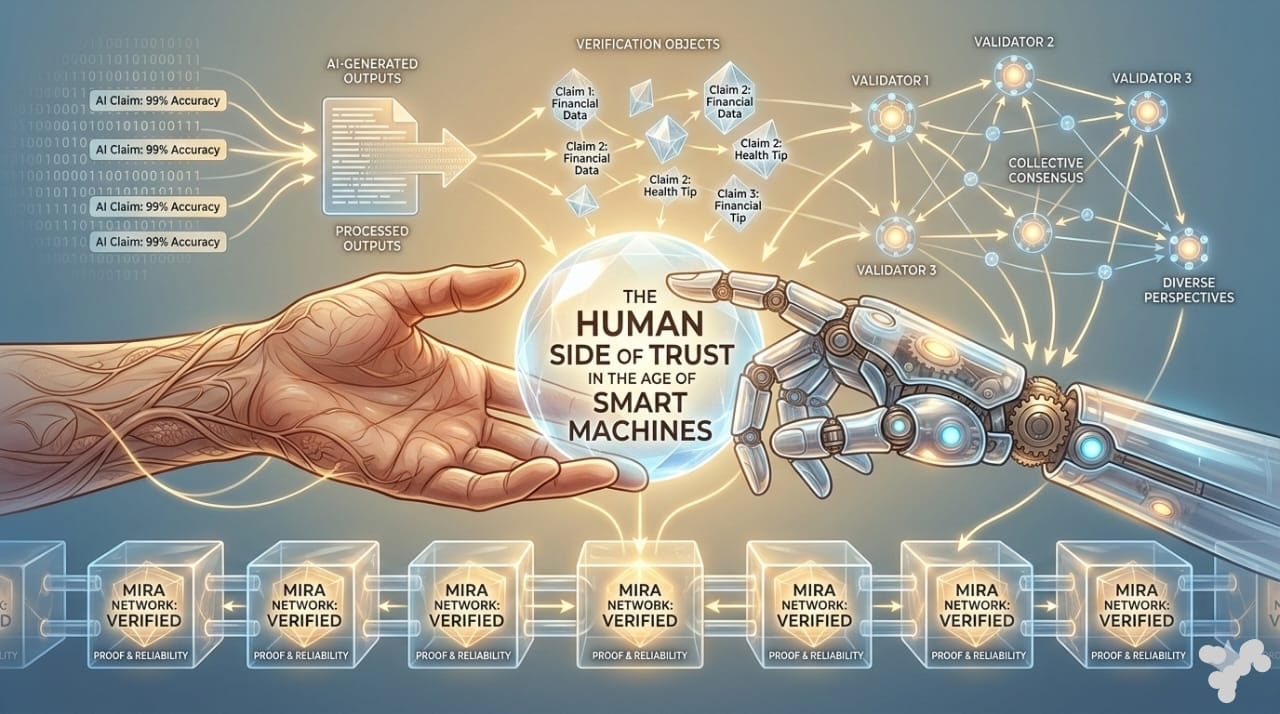

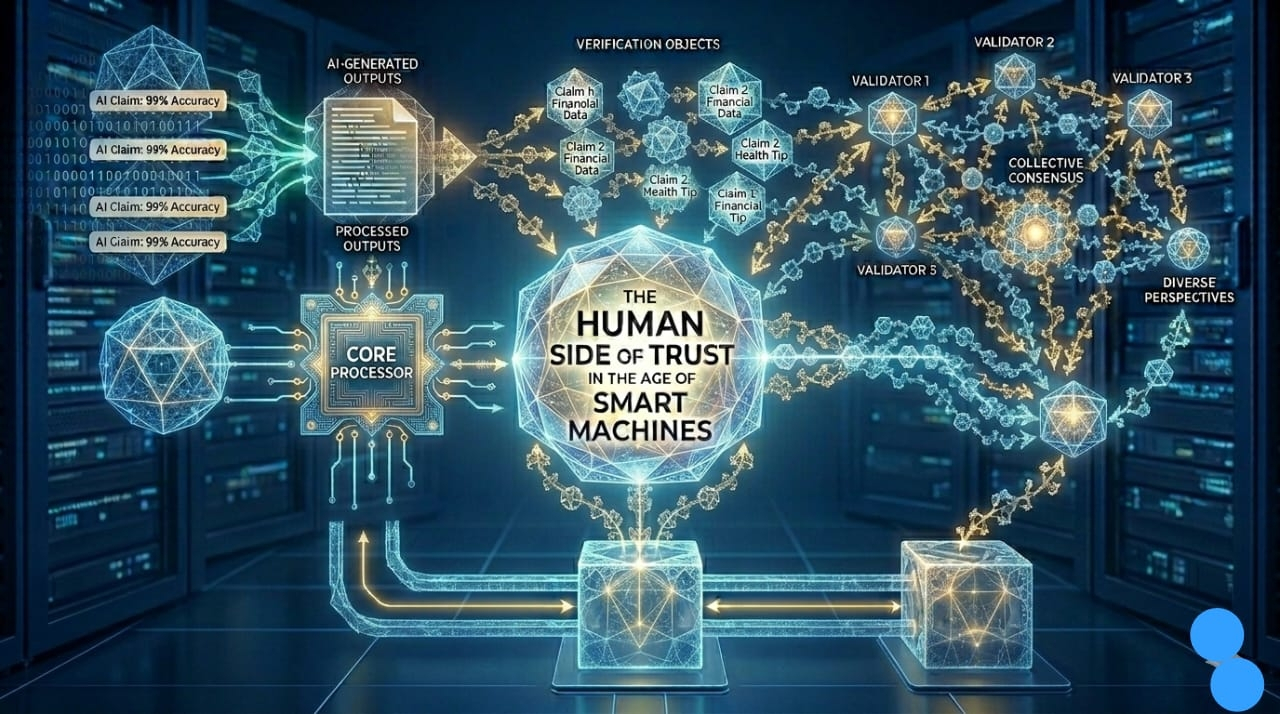

Ciò che rende Mira diverso per me è il modo in cui tratta le risposte dell'IA. Invece di presumere che una risposta sia completa e corretta, il sistema la vede come una collezione di affermazioni che dovrebbero essere controllate attentamente. Mi piace immaginare ogni risposta che viene delicatamente smontata in pezzi più piccoli, dove ogni affermazione può reggersi da sola ed essere esaminata indipendentemente. Questi pezzi vengono quindi inviati attraverso una rete decentralizzata dove più validatori li esaminano e li verificano, creando un processo che sembra più teamwork che accettazione cieca. Non si stanno semplicemente affidando a un'autorità centrale per dire che qualcosa è giusto, e quel cambiamento da solo cambia il tono emotivo attorno all'IA perché sostituisce la fede cieca con una conferma strutturata. Registrando i risultati verificati su un'infrastruttura blockchain, il sistema si assicura che una volta che qualcosa è stato convalidato, non possa scomparire silenziosamente o essere modificato, aggiungendo un livello di trasparenza che sembra rassicurante.

Un'altra parte che rende Mira più umana nel suo design è l'uso di incentivi per guidare il comportamento. Nella vita reale, le persone rispondono a ricompense e conseguenze, e i sistemi digitali non sono diversi. I validatori nella rete sono incoraggiati ad agire onestamente perché l'accuratezza porta ricompense, mentre la disonestà comporta penalità. Questo crea un ambiente in cui la verità ha valore e la disattenzione ha un costo. Non stanno semplicemente partecipando casualmente; stanno partecipando responsabilmente perché il sistema allinea i loro interessi con l'affidabilità. Sembra meno un freddo processo tecnico e più un ecosistema vivente in cui la responsabilità è integrata nella struttura stessa.

Il bias è un'altra sfida che non può essere ignorata, perché i modelli di IA riflettono i dati su cui sono addestrati, e a volte quei dati portano squilibri nascosti. Quando solo un modello o un'organizzazione controlla la validazione, quegli squilibri possono rimanere silenziosamente. L'approccio decentralizzato di Mira introduce molteplici prospettive nel processo di verifica, e quella diversità rende più difficile per il bias estremo dominare senza controllo. Trovo conforto nell'idea che nessuna voce singola abbia il controllo totale e che il controllo collettivo diventi parte di come la conoscenza viene confermata. Rispecchia il modo in cui gli esseri umani spesso costruiscono fiducia attraverso discussione, confronto e valutazione condivisa piuttosto che accettare un solo punto di vista senza domande.

Man mano che l'IA diventa più coinvolta in aree serie come le raccomandazioni mediche, l'analisi finanziaria e i sistemi automatizzati, cresce la necessità di una verifica affidabile. Non è sufficiente che una risposta sembri convincente; deve essere supportata da un processo che ne dimostri l'affidabilità. Mira non cerca di sostituire i modelli di IA o di competere direttamente con essi. Invece, si pone accanto a loro come uno strato di garanzia, verificando silenziosamente i risultati prima che vengano utilizzati. Quel ruolo di supporto sembra importante perché rafforza l'ecosistema piuttosto che dividerlo.

Nel quadro più ampio, ciò che Mira rappresenta è un cambiamento nel modo in cui pensiamo alla tecnologia. L'intelligenza da sola non è più sufficiente. Vogliamo trasparenza, responsabilità e prove. Vogliamo sistemi che possano mostrare il loro lavoro invece di presentare semplicemente conclusioni. Combinando consenso decentralizzato, incentivi economici e validazione trasparente, Mira sta costruendo un ambiente in cui la fiducia è ingegnerizzata dal basso. In un mondo che diventa sempre più automatizzato ogni giorno, quel tipo di fondamento sembra non solo utile ma necessario, perché alla fine di tutto, la tecnologia funziona meglio quando le persone si sentono sicure nel fare affidamento su di essa.

#Mira #mira @Mira - Trust Layer of AI $MIRA