Più utilizzo strumenti di intelligenza artificiale nei flussi di lavoro decisionali reali, meno sono colpito da quanto siano curati. La fluidità non è più rara. Ciò che rimane raro è la certezza.

L'intelligenza artificiale moderna può scrivere in modo persuasivo, riassumere in modo efficiente e costruire argomenti logici. Ma permetteresti che eseguisse qualcosa di irreversibile senza revisione? La maggior parte delle persone esita. Quell'esitazione riflette un problema strutturale più profondo.

I modelli di intelligenza artificiale generano output probabilistici. Predicono schemi; non verificano intrinsecamente la verità. Quando si verificano errori, spesso appaiono sicuri. Non si tratta di un difetto minore dell'interfaccia: è una limitazione dell'architettura.

Quando ho esplorato Mira Network, ciò che si è distinto non era un tentativo di costruire un modello linguistico più potente. Invece, l'attenzione è sulla verifica. Mira si posiziona come uno strato decentralizzato che valuta i risultati dell'IA prima che venga assunta fiducia.

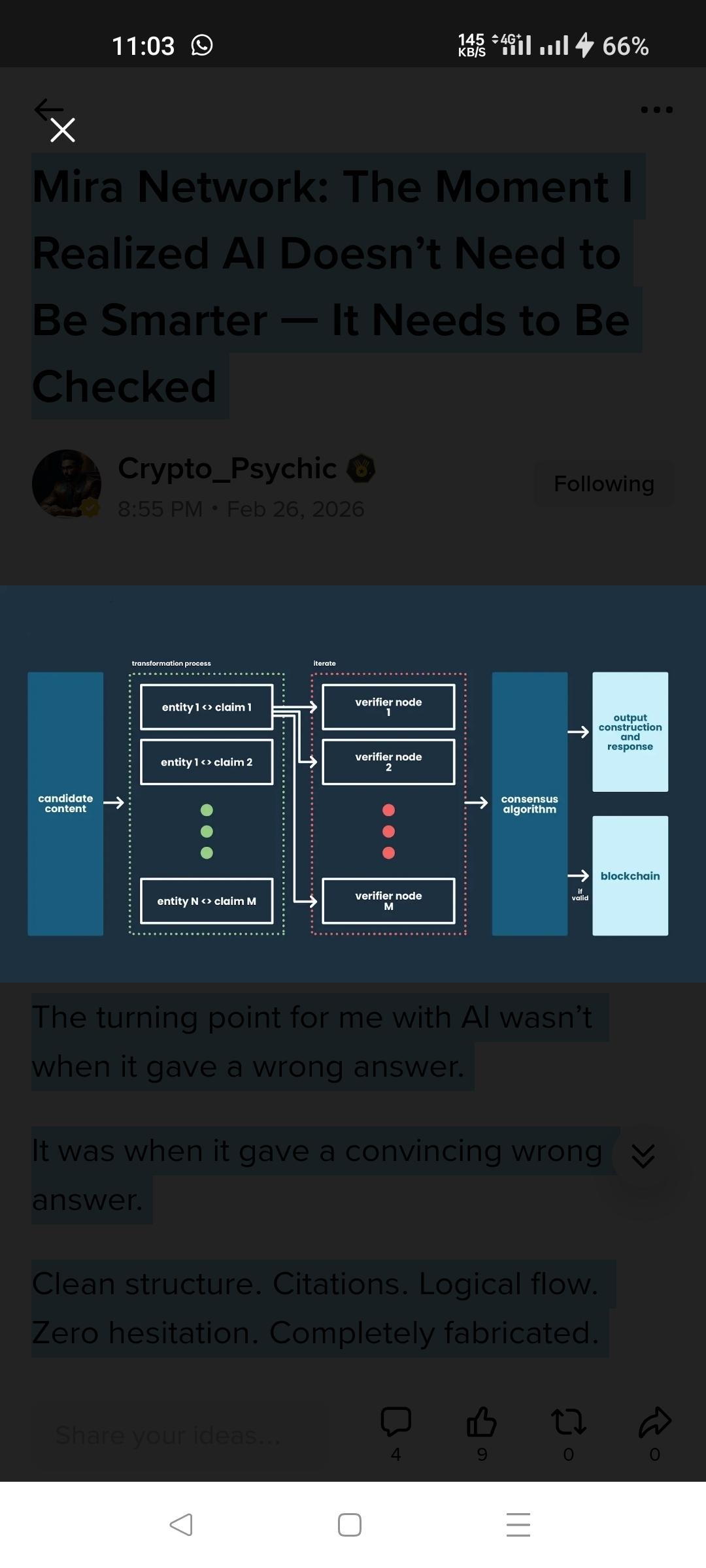

Invece di trattare una risposta dell'IA come una risposta indivisibile, il sistema la scompone in affermazioni più piccole. Queste affermazioni vengono poi valutate da validatori distribuiti. I meccanismi di consenso e gli incentivi economici vengono utilizzati per coordinare i risultati della validazione.

Questo cambia il modello di fiducia. Invece di fare affidamento sull'autorità di un singolo fornitore, la validazione diventa distribuita e allineata agli interessi. I validatori hanno incentivi per valutare attentamente le affermazioni, poiché i risultati li influenzano economicamente.

Quella distinzione diventa importante man mano che i sistemi di IA si avvicinano a una maggiore autonomia. In contesti come l'analisi finanziaria, i flussi di lavoro aziendali o i sistemi di esecuzione automatizzata, 'per lo più accurato' potrebbe non essere sufficiente. I risultati potrebbero dover essere contestabili e auditabili.

Il design di Mira suggerisce che le allucinazioni non scompariranno del tutto — e invece costruisce meccanismi attorno alla verifica. Questo approccio appare pragmatico piuttosto che idealistico.

Ci sono domande aperte. La granularità delle affermazioni, l'allineamento dei validatori e gli incentivi alla coordinazione sono sfide di design complesse. I sistemi distribuiti sono raramente semplici. Ma il tesi centrale è chiara: l'intelligenza da sola non garantisce affidabilità.

Man mano che l'IA diventa più integrata nei sistemi critici, l'infrastruttura di responsabilità potrebbe diventare sempre più importante.

Mira sta esplorando quello strato.

Non promettendo un'intelligenza perfetta — ma concentrandosi sulla fiducia verificabile.

@Mira - Trust Layer of AI #mira $MIRA