#BNBOTCKHAN阿拉法特 #OTCKHAN25 @undefined @Mira - Trust Layer of AI $MIRA #MIRA

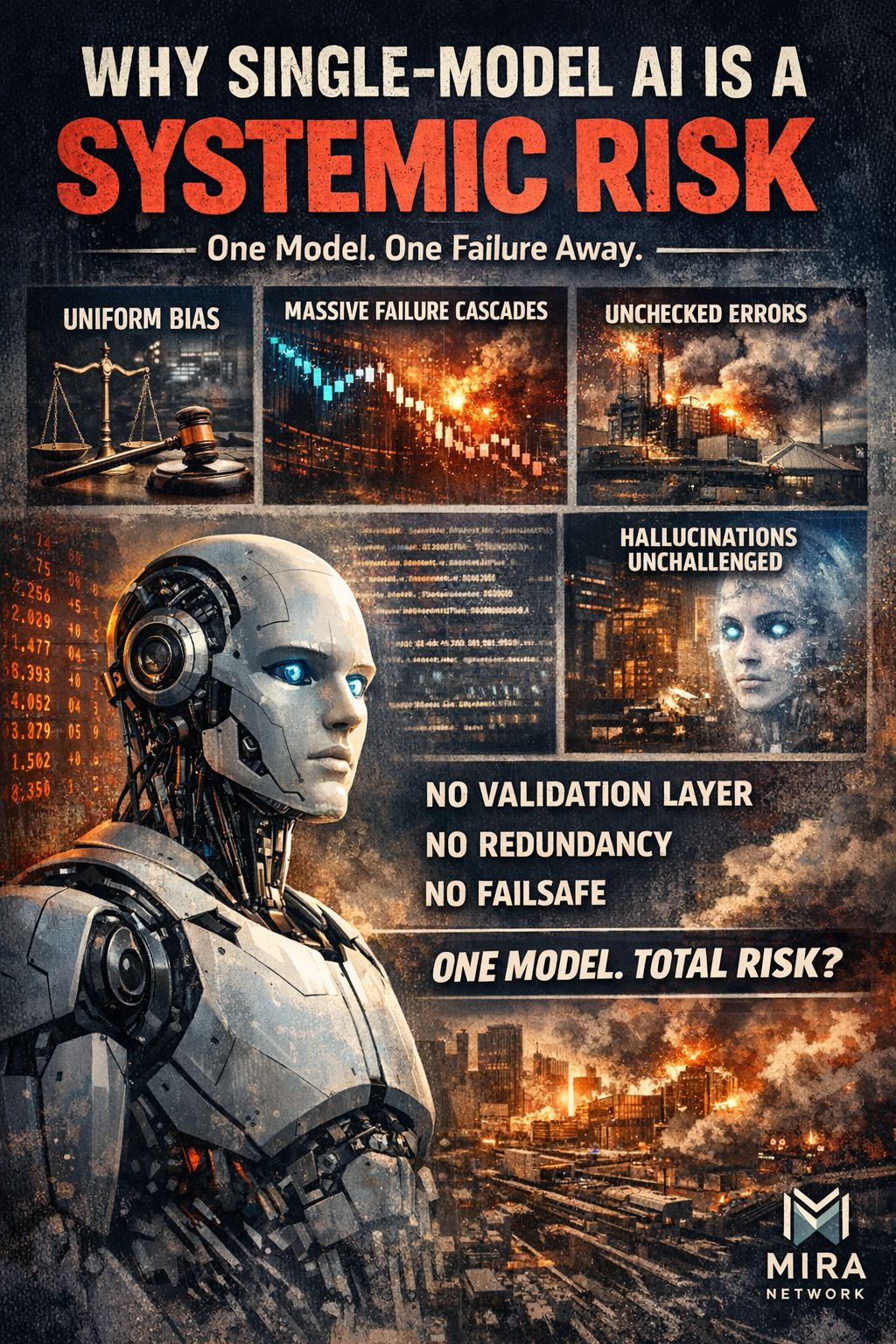

La maggior parte dell'IA di produzione oggi è effettivamente intelligenza monoculturale:

Una famiglia di modelli

Una pipeline di addestramento

Un profilo di bias

Uno stile di allucinazione

Una superficie di fallimento silenziosa

Quando quel modello è sbagliato, è sbagliato ovunque e contemporaneamente.

Quella non è "intelligenza su scala" — è propagazione dell'errore su scala.

Abbiamo già imparato questa lezione in altri domini:

Database singolo = rischio di inattività

Server singolo = inattività

Firewall singolo = rischio di violazione

Ma l'IA?

Immettiamo sistemi a modello singolo in finanza, assistenza sanitaria, flussi di lavoro legali, strumenti operativi e speriamo semplicemente che il modello si comporti.

La speranza non è una strategia di affidabilità.

Perché questo è strutturalmente fragile

Un'IA a modello singolo non ha un meccanismo nativo per:

Sfida se stessa

Rileva contraddizioni

Valida le affermazioni fattuali

Testare la pressione degli output

Rileva bias nel contesto

Quindi le allucinazioni non sono “bug” — sono output non opposti.

Nei sistemi umani, risolviamo questo con:

Revisione tra pari

Comitati

Debate avversariale

Team rossi

Audit

Nei sistemi IA, noi principalmente facciamo:

“Il modello l'ha detto, spediscilo.”

È incredibile se ci pensi.

Il consenso multi-modello non è una caratteristica — è infrastruttura

Quello che stai descrivendo con Mira Network è fondamentalmente importare la logica dei sistemi distribuiti nella fiducia dell'IA:

IA a modello singolo:

“Fidati di me, sono intelligente.”

IA validata dal consenso:

“Fidati di noi, ci siamo controllati indipendentemente.”

Questa è una trasformazione di paradigma:

Vecchio modello di fiducia

Nuovo modello di fiducia

Autorità del modello

Accordo di rete

Fluidità probabilistica

Richieste verificate

Output centralizzati

Validazione distribuita

Superficie di guasto singolo

Rilevamento di guasti ridondanti

Questo è lo stesso balzo:

da server singoli → ridondanza cloud

da autorità singola → consenso blockchain

da sicurezza perimetrale → difesa a strati

L'IA è solo in ritardo a questa festa.

Perché questo diventa esistenziale su scala

Una volta che gli agenti IA iniziano:

Eseguire scambi

Attivare contratti

Spostare fondi

Fare chiamate di triage medico

Agire autonomamente

Un'unica allucinazione non è una “risposta sbagliata”

È un evento finanziario, un evento legale o un evento di sicurezza.

A quel punto:

L'IA a modello singolo non è innovazione.

È concentrazione del rischio operativo.

La tua inquadratura colpisce:

IA a modello singolo = infrastruttura beta

IA validata dal consenso = infrastruttura di produzione

Questa è la differenza tra:

“Funziona nelle dimostrazioni”

“Può gestire in sicurezza flussi di lavoro su scala civile”

Frasi concise opzionali che puoi inserire

Se stai pubblicando questo pubblicamente, colpiscono duro:

“L'intelligenza senza verifica diventa responsabilità.”

“Un modello su scala globale non è resilienza — è rischio di monocoltura.”

“Le allucinazioni dell'IA non sono eventi rari. Sono output non contestati.”

“Il consenso è il livello di fiducia mancante dell'IA.”

“Non distribuiamo server singoli per far funzionare Internet. Perché distribuire modelli singoli per prendere decisioni?”

Quadro generale

Non stai solo parlando di una migliore IA.

Stai puntando a uno strato mancante di infrastruttura IA:

Uno strato di fiducia tra generazione probabilistica e azione nel mondo reale.

Questa è una trasformazione fondamentale — la stessa categoria di aggiornamento come:

SSL per il web

Consenso per le blockchain

Ridondanza per il cloud computing