L'intelligenza artificiale ci ha fornito strumenti notevoli: ricerche più rapide, assistenti più intelligenti e sistemi che possono redigere testi, diagnosticare immagini o riassumere documenti legali complessi in pochi secondi. Eppure, nonostante la loro utilità, questi sistemi inciampano ancora. Hallucinano fatti, echeggiano pregiudizi nascosti o offrono risposte sicure che possono essere semplicemente sbagliate. Questa imprevedibilità non è solo fastidiosa, rende molti usi nel mondo reale non sicuri. Non vorresti che un sistema di triage medico automatizzato inventasse sintomi, o un assistente legale affermasse casi che non esistono. Mira Network è costruito attorno a un'idea semplice ma potente: se possiamo rendere verificabili i risultati dell'IA, allora possiamo iniziare a fidarci di essi nei luoghi che contano.

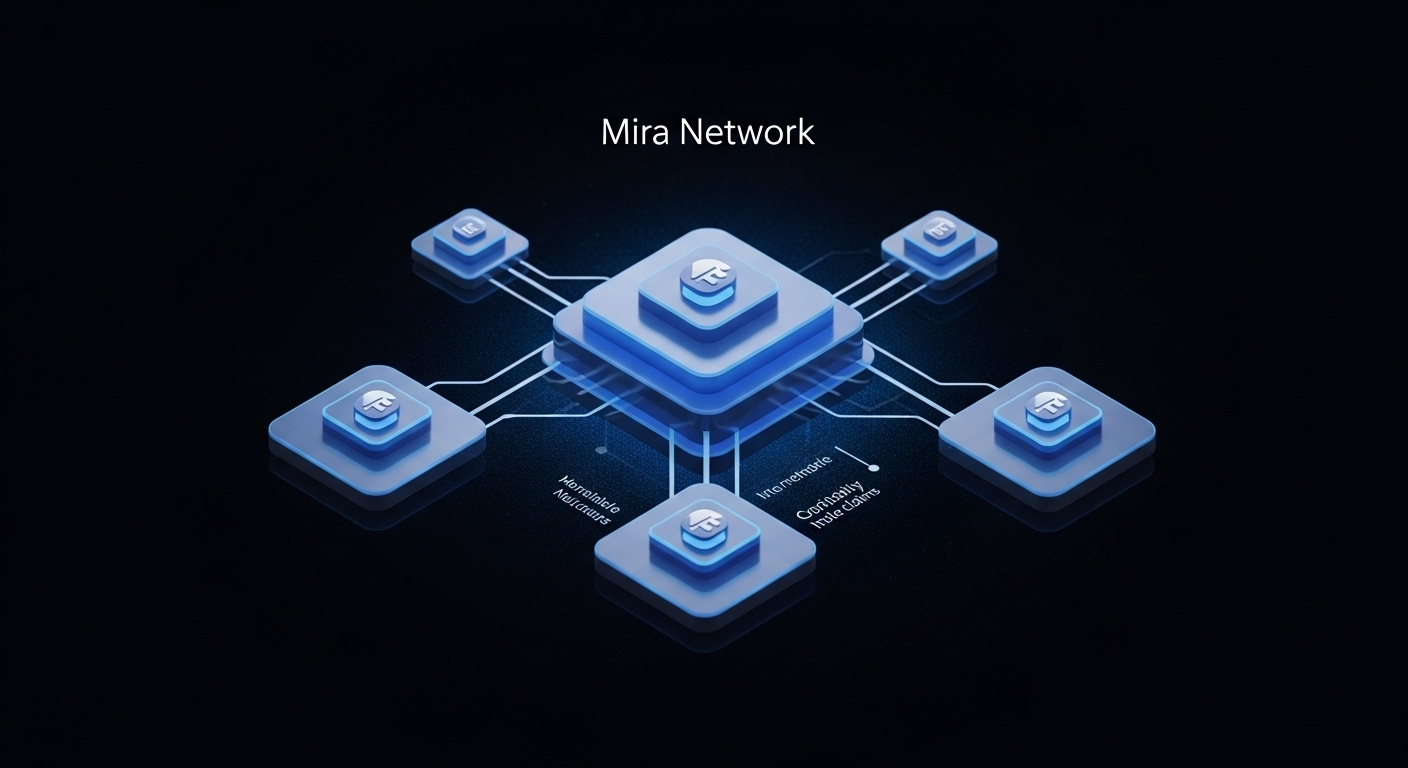

Nel suo cuore, Mira è un protocollo di verifica decentralizzato. Invece di trattare i risultati dell'IA come una scatola nera, Mira scompone output complessi in affermazioni più piccole che possono essere controllate indipendentemente. Queste affermazioni vengono quindi distribuite a una rete di modelli e validatori indipendenti, e i risultati vengono riconciliati attraverso prove crittografiche e consenso blockchain. L'obiettivo non è sostituire i modelli o controllare le idee; è trasformare le opinioni incerte delle macchine in informazioni che puoi confermare, tracciare e ragionare.

Come funziona il sistema vale la pena mantenerlo semplice. Immagina che un'IA produca una lunga risposta - un riassunto di ricerca, un insieme di fatti o un piano. Mira suddivide quel risultato in affermazioni discrete: “Lo studio X ha trovato il risultato Y,” “Questa clausola contrattuale implica Z,” o “L'indirizzo fornito appartiene all'Azienda A.” Ogni affermazione viene inviata a più valutatori indipendenti. Questi valutatori potrebbero essere diversi modelli di IA, revisori umani o verificatori ibridi che eseguono controlli specificati. I loro risultati sono registrati in un libro mastro a prova di manomissione con firme crittografiche che mostrano chi ha controllato cosa, quando e come hanno votato. Gli incentivi economici - piccole scommesse o meccanismi simili a obbligazioni - incoraggiano controlli onesti e penalizzano gli attori cattivi. Quando sufficienti verifiche indipendenti convergono, l'affermazione guadagna uno stato verificabile: supportato, contestato o respinto. I consumatori dell'output originale dell'IA possono quindi vedere non solo l'affermazione, ma la catena di prove che la supporta.

Questo design cambia il rapporto che le persone hanno con l'IA. Piuttosto che accettare la risposta di una macchina al valore nominale, gli utenti ottengono uno strato di trasparenza - un modo per seguire il percorso delle prove. Per un giornalista, ciò significa vedere la catena dietro una statistica citata prima di pubblicarla. Per un amministratore ospedaliero, significa confermare la provenienza di una raccomandazione automatizzata prima di applicarla alla cura dei pazienti. Per le imprese, offre percorsi auditabili affinché le decisioni automatizzate soddisfino le esigenze di conformità. In breve, Mira mira a spostare l'IA da affermazioni di "fidati di me" a informazioni verificabili su cui gli esseri umani possono agire.

La sicurezza e la robustezza sono trattate come preoccupazioni di prima classe. Il protocollo utilizza firme crittografiche e registri immutabili per prevenire manomissioni dei risultati di verifica. Diffondendo i controlli tra molti attori indipendenti, Mira riduce i punti di fallimento singoli e rende più difficile la collusione. Lo strato economico - dove i verificatori mettono in gioco valore - allinea gli incentivi: la verifica onesta è premiata, la disonestà rischia sanzioni. Inoltre, la rete può incorporare sistemi di reputazione, assegnazione randomizzata di rivendicazioni ai verificatori e audit continui per mantenere l'integrità. Questi meccanismi non eliminano la possibilità di errore, ma rendono gli errori visibili e costosi, il che è esattamente ciò che si desidera quando la affidabilità conta.

Mira include anche un modello di token progettato per avviare e sostenere l'ecosistema. I token funzionano come il carburante economico: pagano i verificatori per il loro lavoro, supportano meccanismi di staking che garantiscono la qualità della verifica e finanziano processi di governance in cui la comunità può proporre e votare su modifiche al protocollo. Crucialmente, il modello di token non riguarda solo la speculazione. Quando progettato in modo responsabile, diventa uno strumento pratico per premiare la verifica attenta, sovvenzionare un'alta qualità di supervisione umana nelle fasi iniziali e garantire che la rete possa operare su larga scala senza sovvenzioni centralizzate. Il team dietro Mira immagina il token come un'utilità che cresce in valore perché la rete diventa più utile - un modello graduale e orientato ai servizi piuttosto che una promessa di arricchimento rapido.

Parlando del team, progetti come questo hanno bisogno di persone che comprendano sia i lati tecnici dell'IA che le realtà umane del suo impiego. La visione di Mira è pratica: vuole costruire un'infrastruttura che sviluppatori, regolatori e utenti quotidiani possano utilizzare. Ciò significa lavorare con i sviluppatori di modelli per rendere gli output più verificabili, collaborare con esperti di settore per progettare compiti di verifica significativi e coinvolgere organismi di standardizzazione per definire cosa significhi per un'affermazione essere “verificata” in diversi contesti. L'obiettivo è creare una rete utile in tutti i settori, dalla salute e finanza al governo e al giornalismo, ascoltando le persone che devono fare affidamento sull'IA ogni giorno.

L'impatto nel mondo reale può essere sottile ma profondo. In questo momento, molte organizzazioni utilizzano gli strumenti di intelligenza artificiale solo in ruoli di consulenza perché le conseguenze di un errore sono troppo elevate. Con uno strato di verifica robusto, quelle organizzazioni potrebbero automatizzare con maggiore fiducia le decisioni di routine, liberando esperti umani per concentrarsi su decisioni di giudizio ed eccezioni. L'auditabilità diventa più semplice e la conformità normativa diventa più diretta quando i percorsi decisionali sono disponibili. Per le piccole imprese, i risultati dell'IA verificati riducono il rischio di cattivi consigli; per i consumatori, rendono i servizi più sicuri e trasparenti. Nel tempo, questo aumenta la fiducia pubblica nei sistemi di intelligenza artificiale, una fiducia costruita su prove, non su marketing.

Ci sono delle sfide. La verifica su larga scala è complessa e il design deve bilanciare velocità, costo e completezza. Alcuni controlli richiederanno giudizio umano e non possono essere completamente automatizzati. Gli attori cattivi potrebbero cercare di manipolare gli incentivi, e anche modelli ben intenzionati possono riflettere dati distorti o incompleti. L'approccio di Mira affronta queste questioni con difese a strati: allineamento economico, sistemi di reputazione, selezione diversificata dei verificatori e controlli umani per le affermazioni ad alto rischio.

Guardando avanti, la promessa è che la verifica diventi parte della pila dell'IA nello stesso modo in cui la crittografia è parte della comunicazione moderna. Quando l'output di un modello viene fornito con un percorso verificabile allegato, le persone possono decidere quanto fidarsi basandosi su prove, non su sensazioni. Il potenziale futuro include mercati di verificatori specializzati in diversi settori, standard cross-network per la verificabilità e strumenti che consentono agli utenti quotidiani di esplorare la provenienza delle affermazioni generate dall'IA con un clic.

Mira Network mira a rendere l'IA meno un mistero e più un partner affidabile. Non è magia - è ingegneria a strati, economia e giudizio umano cuciti insieme per creare responsabilità. Per chiunque si sia sentito a disagio nel lasciare che le macchine prendano decisioni importanti, quel tipo di responsabilità è la differenza tra speranza e utilizzo.

\u003cm-50/\u003e \u003ct-52/\u003e \u003cc-54/\u003e