La prima volta che ho usato un chatbot AI e mi ha dato una risposta che sembrava giusta ma era chiaramente falsa non l'ho ignorata. Ha lasciato un piccolo nodo silenzioso nel mio cervello come quando senti una canzone familiare suonata leggermente stonata. A quel tempo non sapevo molto sulla verifica dell'AI. Sapevo solo che qualcosa di profondo sotto la superficie doveva cambiare.

I chatbot sono diventati un modo abbreviato per l'AI conversazionale. Sono ovunque nel supporto clienti, vendite, istruzione e intrattenimento. La promessa è semplice. Parla con una macchina come parli con una persona. Eppure, la fluidità conversazionale e la correttezza effettiva sono cose diverse. Un'AI può suonare empatica e comunque allucinare un fatto. Può scrivere magnificamente e comunque essere sbagliata. Quella consistenza, la differenza tra sembrare giusto ed essere giusto è il problema centrale che MIRA affronta.

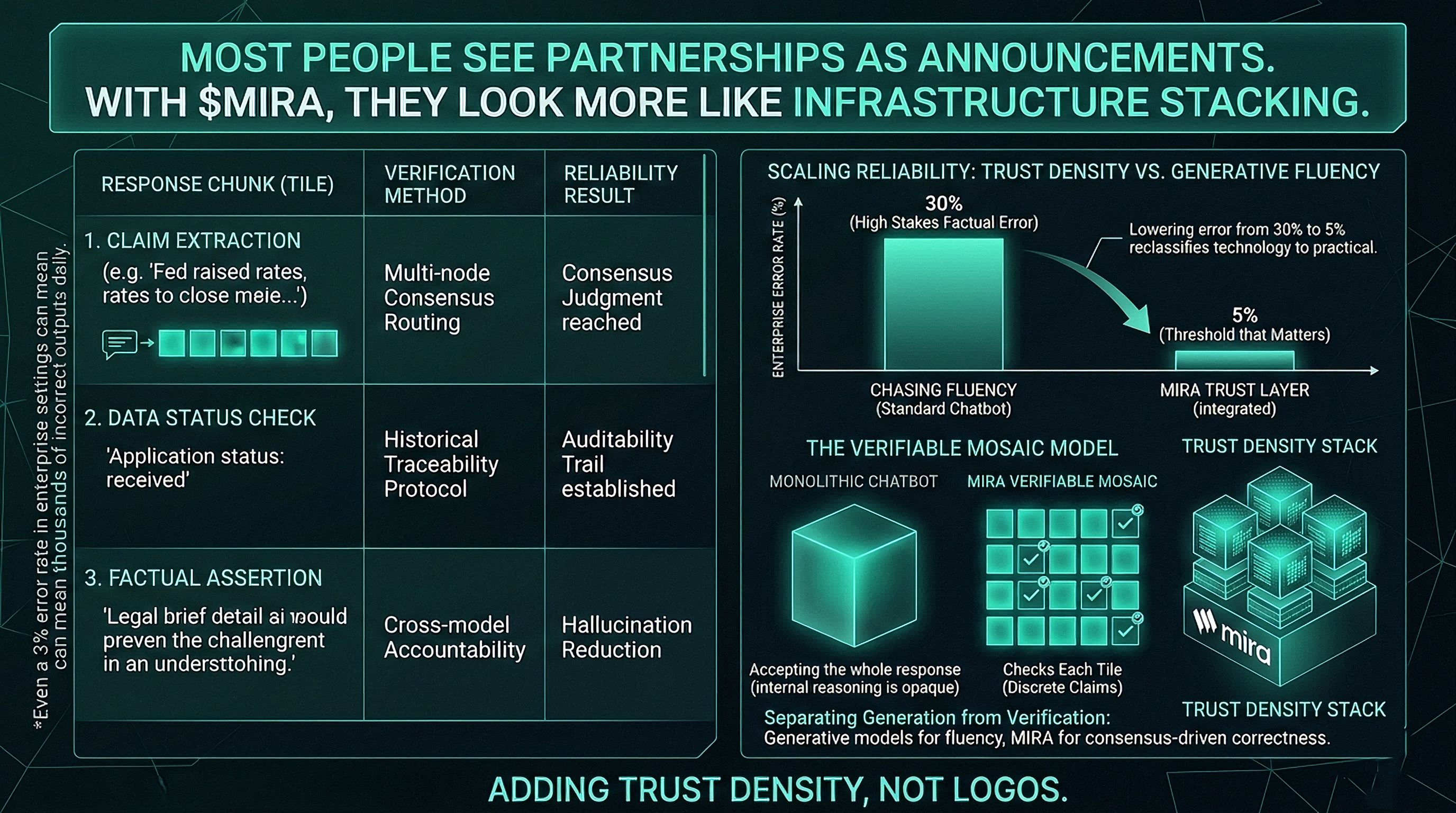

A prima vista, migliorare i chatbot IA sembra un problema di prestazioni. Rendere i modelli più grandi, addestrarli su più dati, ottimizzare la velocità di risposta. Molti progetti seguono quella strada. Ciò che si trova sotto quella superficie è il problema della fiducia. Man mano che l'IA viene integrata nei flussi di lavoro che contano, come documenti legali, risoluzione di problemi finanziari e triage sanitario, il costo di una singola risposta errata aumenta drammaticamente. In contesti aziendali, anche un tasso di errore del 3% può significare migliaia di output errati ogni giorno, il che si traduce in reali rischi finanziari, reputazionali o normativi.

Quell'intuizione che la base dell'IA conversazionale deve essere la fiducia piuttosto che solo la fluidità è parte di ciò che distingue @mira_network. L'architettura tradizionale tratta i chatbot come oracoli monolitici il cui ragionamento interno è opaco. MIRA capovolge questa assunzione. Invece di prendere il valore di output di un modello per buono, lo scompone in affermazioni individuali che possono essere verificate in modo indipendente. Immagina la risposta di un chatbot come un mosaico. Invece di accettare il tutto, MIRA controlla ogni tassello.

Scomporre una risposta IA in sezioni discrete è importante perché trasforma un punteggio di fiducia amorfo in checkpoint misurabili. Ad esempio, se un chatbot afferma che La Federal Reserve ha aumentato i tassi di interesse dello 0,25 percento a marzo, il sistema può estrarre quella affermazione, indirizzarla a più nodi di verifica indipendenti e raggiungere un giudizio di consenso sulla sua verità. Questo trasforma ciò che normalmente è una singola risposta indistinta in una sequenza di fatti verificabili.

Sotto questo processo c'è uno schema di equità che vale la pena notare. Le allucinazioni dell'IA non sono casuali. Sono artefatti della previsione statistica. Il modello indovina il token successivo più probabile basato sui dati di addestramento. Questo funziona per la prosa creativa. Fallisce in contesti fattuali ad alto rischio. Instradando ogni affermazione attraverso nodi di verifica diversi e poi aggregando i giudizi, si introduce uno strato di responsabilità incrociata tra i modelli che non è tipico nei flussi standard dei chatbot.

Utilizzare questo metodo cambia il comportamento di un chatbot sulla superficie e sotto. In superficie, gli utenti godono ancora di un'interfaccia conversazionale. Il dialogo appare naturale e il contesto è preservato. Sotto, ogni affermazione incorporata nell'interfaccia porta non solo una risposta, ma un supporto di consenso decentralizzato. Questo cambia la texture di affidabilità dell'output.

Nel frattempo, questo approccio si allinea con una tendenza più ampia nell'IA, che è separare la generazione dalla verifica. I modelli generativi sono forti nel produrre testi plausibili, ma non tutto il testo plausibile è veritiero. Le reti di verifica come MIRA colmano quella lacuna introducendo incentivi economici e protocolli di consenso che scoraggiano output falsi. Questo non è un'aggiunta tecnica. È un cambiamento nel modo in cui i sistemi di dialogo IA sono progettati.

Un esempio pratico aiuta a chiarire questo. Supponiamo che tu stia utilizzando un chatbot IA costruito con #Mira verifica integrata in un flusso di lavoro di supporto clienti. Un utente chiede informazioni sullo stato di un'applicazione. Un tipico chatbot potrebbe generare una risposta che suona sicura ma si basa su dati backend obsoleti o contesto incompleto. Una versione alimentata da MIRA scompone la risposta in elementi verificabili, come la data in cui è stata ricevuta l'applicazione, il codice di stato attuale e la prossima milestone prevista, quindi verifica ciascuno con consenso prima di comporre la risposta finale. Gli utenti ricevono non solo risposte che suonano corrette, ma risposte che sono statisticamente e socialmente verificate come corrette.

Ciò non significa che il sistema non commetta mai errori. Nessun sistema può rivendicare un'accuratezza perfetta. I primi segnali suggeriscono che sovrapporre la verifica sotto l'IA conversazionale riduce significativamente il tasso di affermazioni errate. Se i chatbot di base allucinano nel mondo a tassi misurabili a seconda del dominio, aggiungere uno strato di controllo della verità può avvicinare i livelli di errore a soglie che contano nei contesti aziendali e di governance. Ridurre l'errore dal 30% al 5% non è incrementale. Riconfigura la tecnologia da esplorativa a pratica.

Ciò che mi ha colpito è il sottile cambiamento nel modo in cui pensiamo alle interazioni con l'IA. Tradizionalmente, i chatbot venivano giudicati in base a quanto suonavano umani. Oggi vengono sempre più giudicati in base a quanto siano affidabili. Quel cambiamento è silenzioso ma inconfondibile. Riflette aspettative più profonde da parte degli utenti aziendali e dei consumatori. Le persone si preoccupano meno della verbosità e più della verificabilità. Si preoccupano meno dello stile e più delle basi.

Includere la verifica nell'IA conversazionale ha anche implicazioni più ampie. Quando gli output possono essere auditati in modo indipendente, consente il monitoraggio della conformità, la tracciabilità storica e i percorsi di responsabilità che sono essenziali in settori regolamentati. Sistemi come MIRA non stanno solo migliorando i chatbot. Stanno costruendo strati di fiducia che possono essere auditati e contestati. Questo rappresenta un livello di maturità diverso.

I mercati stanno rispondendo a questo cambiamento. Token e protocolli legati a infrastrutture che si concentrano sulla consegna affidabile piuttosto che sulla generazione appariscente stanno attirando l'attenzione di costruttori e istituzioni. La narrazione attorno a Mira riflette questo. Non è semplicemente un altro token IA. È un token legato a una rete di infrastrutture di verifica che consente all'IA conversazionale di fornire output che possono essere auditati, contestati e verificati.

Ci sono ovvie controargomentazioni. Alcuni sviluppatori sostengono che questo aggiunge latenza o complessità. La verifica in tempo reale può introdurre sovraccarichi, specialmente in applicazioni sensibili al tempo. Questo è valido e rimane una sfida ingegneristica. Se la verifica può scalare a ogni caso d'uso senza compromettere la reattività rimane da vedere. L'idea fondamentale che la fiducia sia il nuovo collo di bottiglia delle prestazioni sembra giustificata.

Nel più ampio schema della tecnologia, i livelli di affidabilità seguono solitamente i livelli generativi. I protocolli internet iniziali si concentravano sulla connettività. I livelli successivi hanno aggiunto crittografia, identità e verifica. Ciò che MIRA sta facendo con i chatbot assomiglia ad aggiungere SSL al web. In superficie si naviga ancora. Sotto la connessione è sicura. Nella chat IA, la superficie è il dialogo. Sotto, la verità viene controllata.

I chatbot erano giudicati in base a quanto bene imitano gli esseri umani. Ora vengono giudicati in base a quanto bene possono essere verificati. In un mondo in cui l'IA è integrata nelle decisioni finanziarie, legali e personali, quella seconda misura conta di più della fluidità. Quando la fiducia entra nel dialogo, la conversazione cambia fondamentalmente.