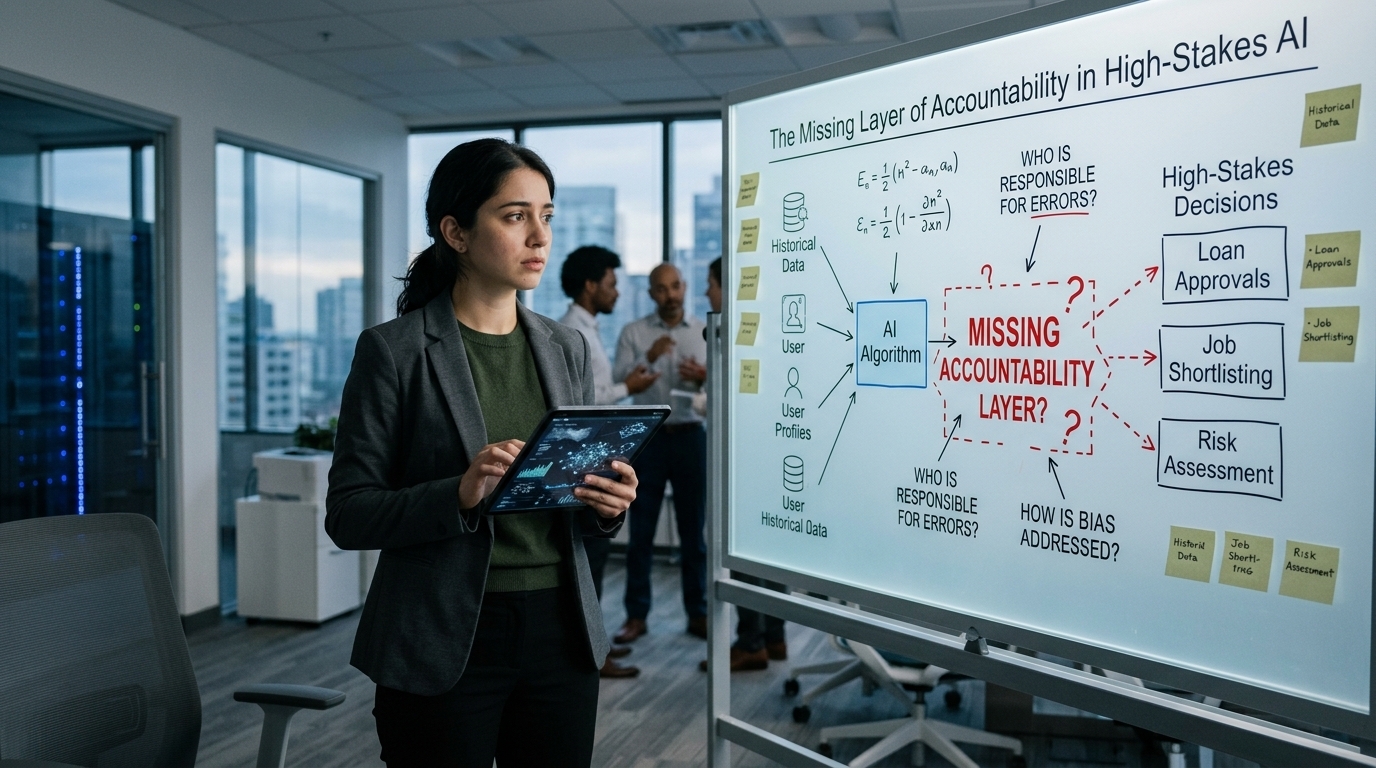

L'industria dell'IA è diventata molto brava nel migliorare i metriche di performance. I modelli sono più veloci, più grandi, più accurati. Ma c'è una domanda che rimane ancora sullo sfondo, senza risposta: quando un sistema di IA causa danni, chi è responsabile?

Non in teoria. Nella pratica.

Stiamo parlando di responsabilità che innescano indagini, azioni regolatorie, sanzioni finanziarie, danni reputazionali. Quella di cui i consigli e i team di compliance perdono il sonno. In questo momento, non c'è una risposta chiara. E quell'incertezza—non la qualità del modello, non il costo, non la complessità dell'integrazione—è ciò che mantiene le istituzioni caute.

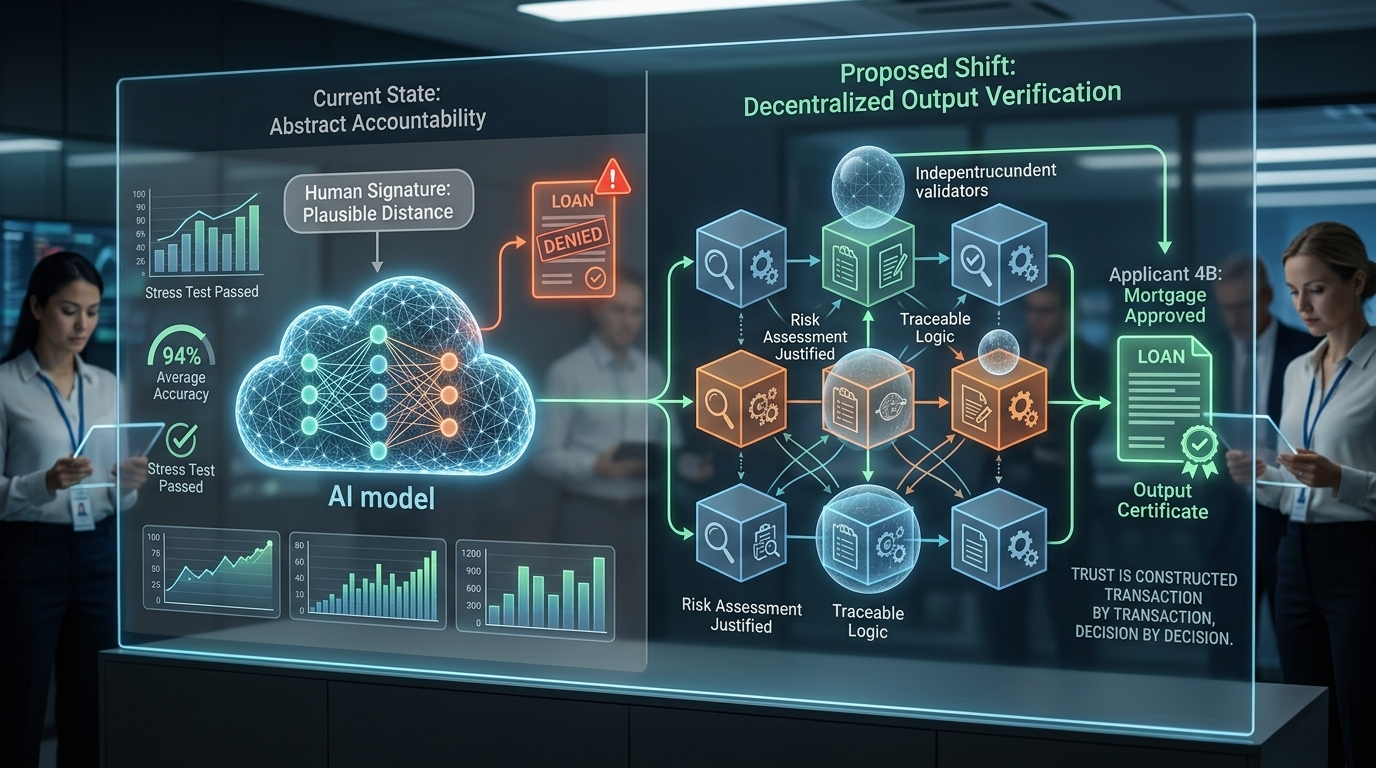

In settori come la valutazione del credito, l'assicurazione e la valutazione del rischio, i sistemi di IA raramente “prendono” decisioni ufficiali. Producono raccomandazioni. Un umano approva. Sulla carta, l'umano è responsabile.

Ma la realtà è più complicata. Se un modello di IA ha già filtrato, classificato e valutato migliaia di domande, il revisore umano spesso conferma ciò che il sistema ha effettivamente deciso. L'organizzazione guadagna l'efficienza dell'automazione mantenendo una distanza plausibile dal risultato.

Quella zona grigia sta diventando più difficile da difendere.

I regolatori in regioni come l'Unione Europea, attraverso framework come l'AI Act, stanno spingendo per l'interpretabilità, l'auditabilità e la tracciabilità nei sistemi di IA ad alto rischio. La risposta dell'industria è stata prevedibile: schede di modello, audit sui bias, comitati di governance, dashboard di spiegabilità.

Questi strumenti sono utili. Ma non risolvono il problema centrale.

Descrivono il modello. Non verificano l'output.

La maggior parte delle discussioni sulla affidabilità dell'IA si concentra sulle medie. Un modello è preciso al 94%. Funziona bene sui benchmark. Supera i test di stress. Sembra rassicurante—fino a quando non sei nel 6% dei casi in cui fallisce. Quando quel fallimento influisce sul mutuo, sulla richiesta di assicurazione o sulla libertà di qualcuno, le medie perdono il loro conforto.

Gli ambienti ad alto rischio non operano sulla buona volontà statistica. Operano su registri.

I revisori esaminano decisioni specifiche. I regolatori esaminano casi individuali. I tribunali valutano risultati particolari. In questi contesti, è meno importante che un sistema sia “generalmente affidabile” e più che un output specifico possa essere tracciato, esaminato e giustificato.

È qui che la verifica decentralizzata introduce un cambiamento strutturale.

Invece di assumere che un modello ben addestrato sarà di solito corretto, l'infrastruttura di verifica valuta gli output individualmente. Ogni risultato può essere controllato, confermato o segnalato da validatori indipendenti. L'enfasi si sposta dalla fiducia a livello di modello alla responsabilità a livello di output.

La differenza è sottile ma potente.

È la differenza tra un produttore che dice: “I nostri prodotti sono sicuri in media,” e allegare un certificato che dice: “Questa specifica unità ha superato l'ispezione.” Nelle industrie regolamentate, quella distinzione cambia tutto.

Gli incentivi economici rafforzano ulteriormente questa struttura. Quando i validatori sono ricompensati per la precisione e penalizzati per negligenza, la responsabilità diventa parte integrante del design del sistema. La responsabilità non è più astratta. È distribuita e economicamente imposta.

Certo, questo approccio introduce compromessi. La verifica richiede tempo. In ambienti dove la velocità è critica—trading ad alta frequenza, risposta alle emergenze, rilevamento delle frodi in tempo reale—la latenza può compromettere l'adozione. Se i meccanismi di responsabilità rallentano i sistemi al punto di diventare impraticabili, le istituzioni li bypasseranno.

Velocità e responsabilità devono coesistere.

Ci sono anche questioni legali irrisolte. Se un output verificato si rivela errato, chi porta la responsabilità? L'istituzione che utilizza il sistema? La rete decentralizzata? I validatori individuali? Fino a quando i regolatori non chiariranno come la verifica distribuita dell'IA si inserisce nei framework di responsabilità esistenti, rimarrà cautela.

Eppure, la direzione è chiara.

L'IA non è più confinata alla redazione di email o alla raccomandazione di contenuti. Viene integrata in settori che influenzano denaro, diritti e opportunità. Questi settori hanno già standard di responsabilità costruiti nel corso di decenni. I sistemi di IA non riceveranno esenzioni semplicemente perché sono complessi.

La fiducia nei sistemi ad alto rischio non è dichiarata. È costruita—transazione dopo transazione, decisione dopo decisione—attraverso meccanismi che rendono la responsabilità visibile quando qualcosa va storto.

La sola performance non è sufficiente. La sola trasparenza non è sufficiente. I soli strati di governance non sono sufficienti.

Affinché l'IA operi con fiducia in ambienti regolamentati e ad alta conseguenza, la responsabilità non può essere opzionale o implicita.

Deve essere integrato nell'infrastruttura stessa.