@Mira - Trust Layer of AI #Mira

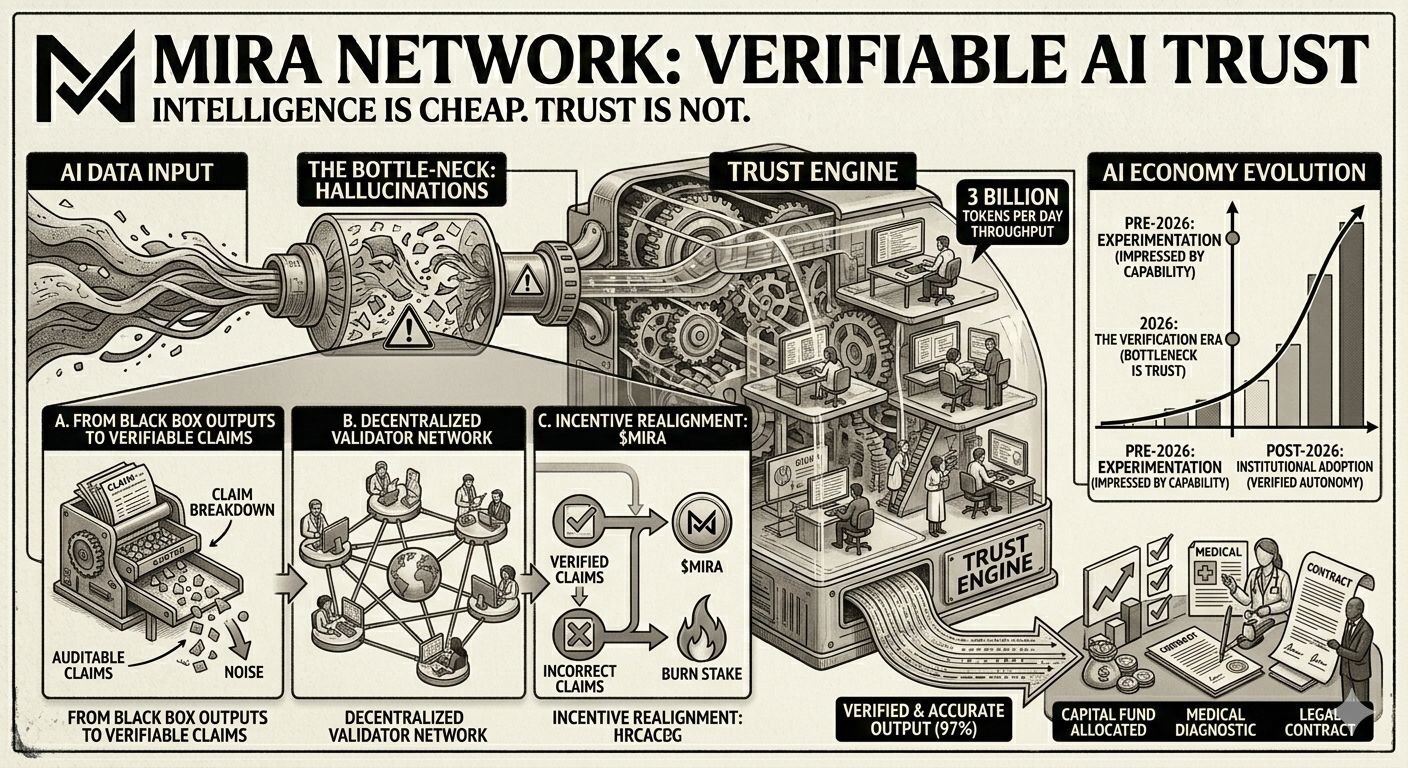

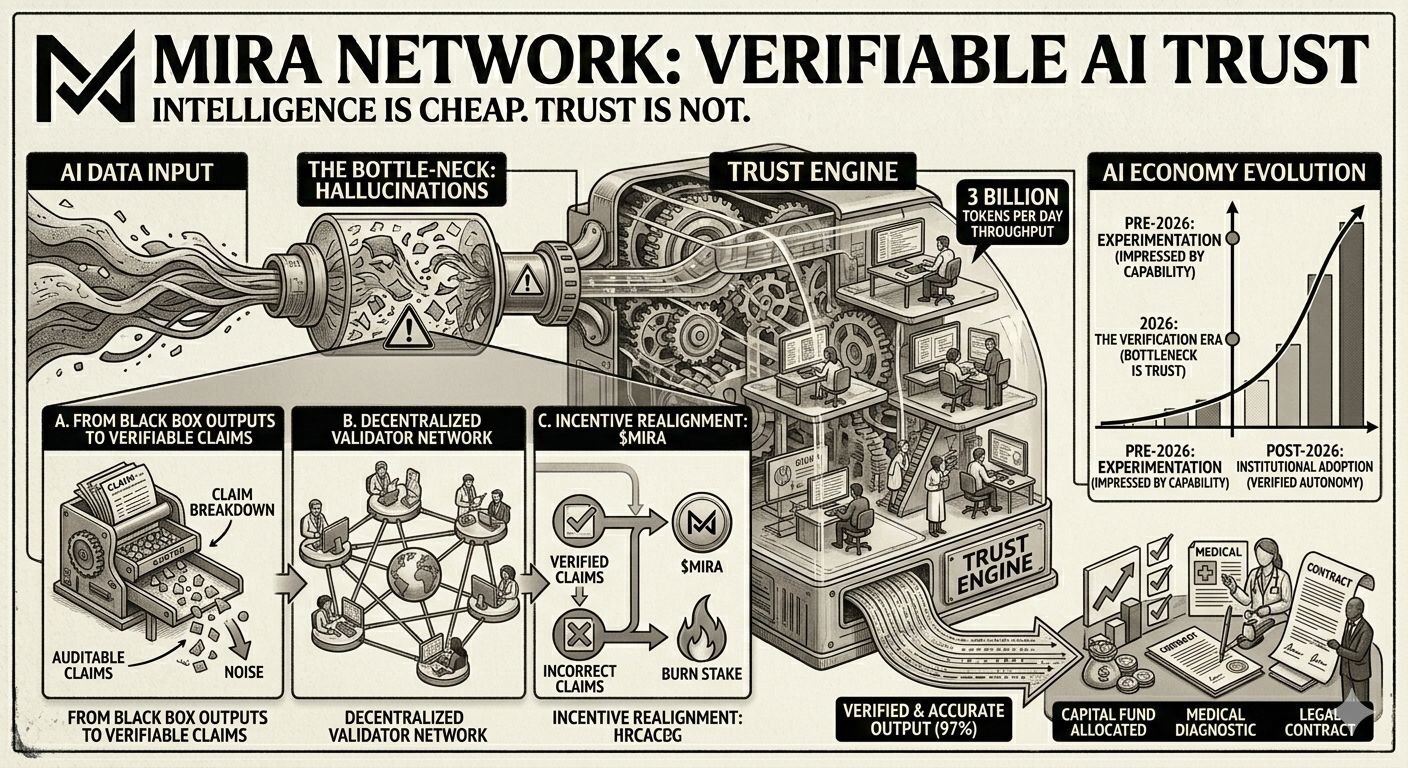

La maggiore debolezza dell'AI non è la capacità. È la credibilità.

Siamo andati oltre la fase di essere impressionati da ciò che l'AI può generare.

Ora la vera domanda è: può dimostrarlo?

Le allucinazioni erano tollerabili quando l'AI scriveva didascalie.

Sono inaccettabili quando l'AI sta allocando capitale, assistendo flussi di lavoro medici, o influenzando risultati legali.

Il collo di bottiglia dell'economia dell'AI non è più il calcolo.

È verifica.

È qui che entra in gioco Mira — non come un altro modello, non come un'altra interfaccia — ma come il layer di fiducia mancante.

Da output a scatola nera a reclami verificabili

L'IA tradizionale funziona come un motore sigillato.

L'input entra. L'output esce. La fiducia suona convincente.

Ma la fiducia non è prova.

Mira scompone gli output dell'IA in reclami granulari e auditabili.

Ogni reclamo è verificato in modo indipendente da una rete di validatori decentralizzati.

A differenza di sistemi come Bitcoin, dove la Proof of Work dimostra lo sforzo computazionale, la Proof of Verification di Mira dimostra la correttezza.

I validatori controllano gli output tra modelli e fonti.

La validazione corretta guadagna $MIRA.

La validazione errata brucia il capitale.

Gli incentivi sono allineati con l'accuratezza, non con il rumore.

Infrastrutture reali. Scala reale.

All'inizio del 2026, il mainnet di Mira ha superato 3 miliardi di token elaborati al giorno.

Questo non è marketing. Questo è throughput.

Applicazioni come:

Klok — un'interfaccia IA multi-modello

WikiSentry — uno strato di verifica dei fatti alimentato dall'IA

hanno dimostrato come la verifica possa spingere l'accuratezza del modello dal ~70% fino al 97%.

Quella delta cambia tutto.

È la differenza tra sperimentazione e adozione istituzionale.

L'autonomia verificata è il traguardo finale.

Gli agenti IA stanno andando oltre la conversazione.

Gestiranno gli asset. Eseguiranno contratti. Coordineranno il valore economico.

A quel livello, “probabilmente corretto” è un rischio sistemico.

Mira non sta cercando di rendere l'IA più rumorosa.

Sta rendendo l'IA responsabile.

Perché nella prossima fase dell'economia dell'IA, i vincitori non saranno i modelli che sembrano i più intelligenti.

Saranno i sistemi che possono dimostrare di avere ragione.