Le Audit Trails di Mira potrebbero essere la risposta. In un mondo in cui la trasparenza e la responsabilità nell'IA sono non negoziabili, Mira consente alle organizzazioni di tracciare ogni decisione, azione e risultato, rendendo possibile verificare e fidarsi dei propri sistemi di IA come mai prima d'ora. Immagina un futuro in cui ogni scelta algoritmica è aperta alla revisione e al miglioramento! Pronto a costruire la tua IA su una base su cui puoi contare? Scopri perché le Audit Trails di Mira potrebbero essere il pilastro dell'IA verificabile. Quali domande hai riguardo a portare una vera trasparenza all'intelligenza artificiale?

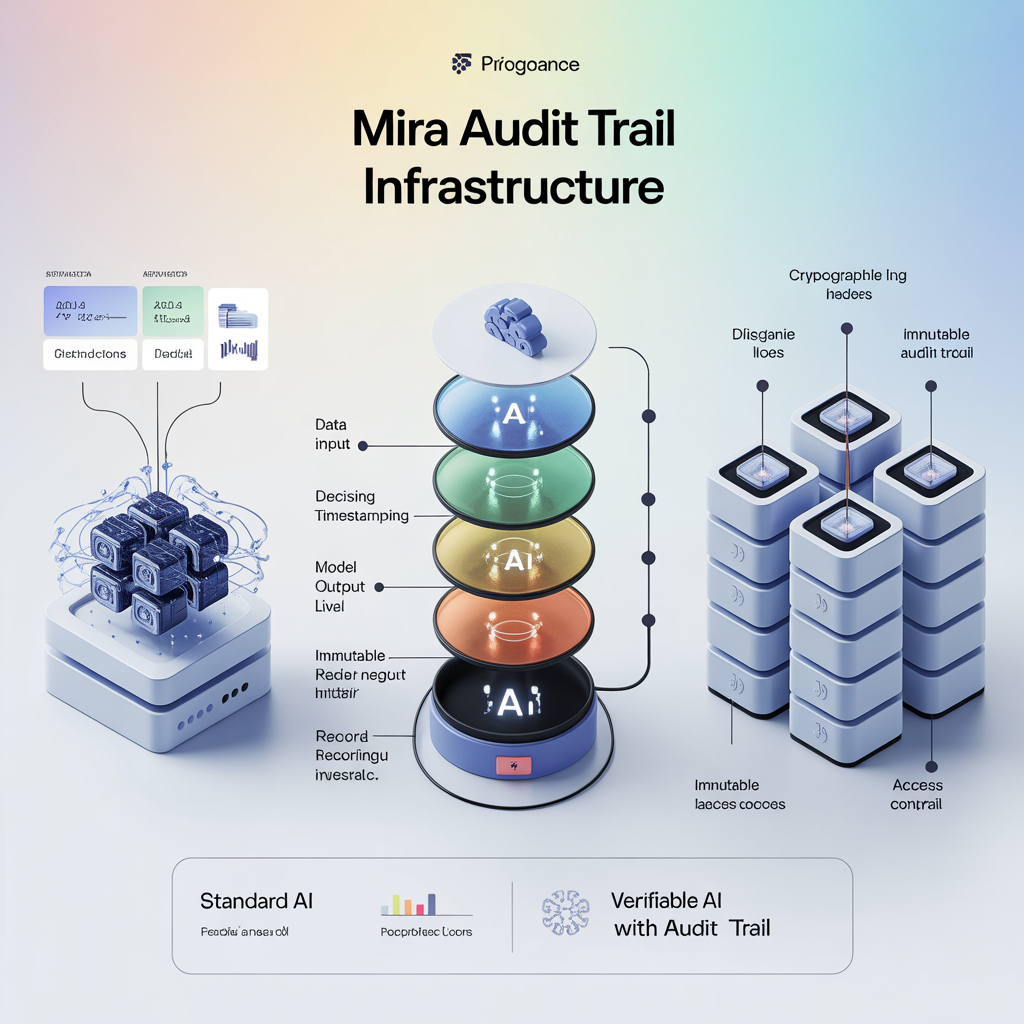

Mentre la promessa dell'IA verificabile continua a dominare il discorso dell'industria, poche soluzioni offrono un approccio pratico e trasparente: è qui che Mira Audit afferma di distinguersi. Tuttavia, mentre le organizzazioni si affrettano ad abbracciare processi guidati dall'IA, la necessità di robusti audit trails non è mai stata così urgente. I Audit Trails di Mira si posizionano come potenziali cambiatori di gioco, ma la loro adozione solleva domande critiche.

La forza centrale di Mira Audit risiede nella sua registrazione dettagliata e immutabile: ogni decisione presa da un sistema di IA è registrata, timbrata e collegata ai dati di input pertinenti. In teoria, questa trasparenza potrebbe costruire fiducia e abilitare una revisione indipendente. Tuttavia, i critici sostengono che avere semplicemente un audit trail non garantisce automaticamente responsabilità o interpretabilità. Gli organismi di supervisione e gli stakeholder devono comunque navigare in documentazione tecnica complessa: un onere che potrebbe spostare la responsabilità piuttosto che democratizzare veramente l'accesso.

Inoltre, mentre Mira Audit vanta la tracciabilità end-to-end come un pilastro per i sistemi di IA verificabile, c'è poco scrutinio pubblico riguardo a come questi log di audit vengono gestiti o chi controlla l'accesso ai registri sensibili. Esiste il rischio che il controllo centralizzato possa compromettere l'oggettività e sollevare nuove preoccupazioni sulla privacy.

In ultima analisi, se l'IA verificabile dipende da meccanismi di auditing affidabili come quelli offerti da Mira Audit Trails, l'industria deve interrogarsi rigorosamente non solo su cosa viene registrato, ma su come la trasparenza si traduce in responsabilità significativa per tutte le parti coinvolte.

#Mira @Mira - Trust Layer of AI $MIRA #MarketSentimentToday #MarketUpdate #UsaAttack #IranIsraelConflict