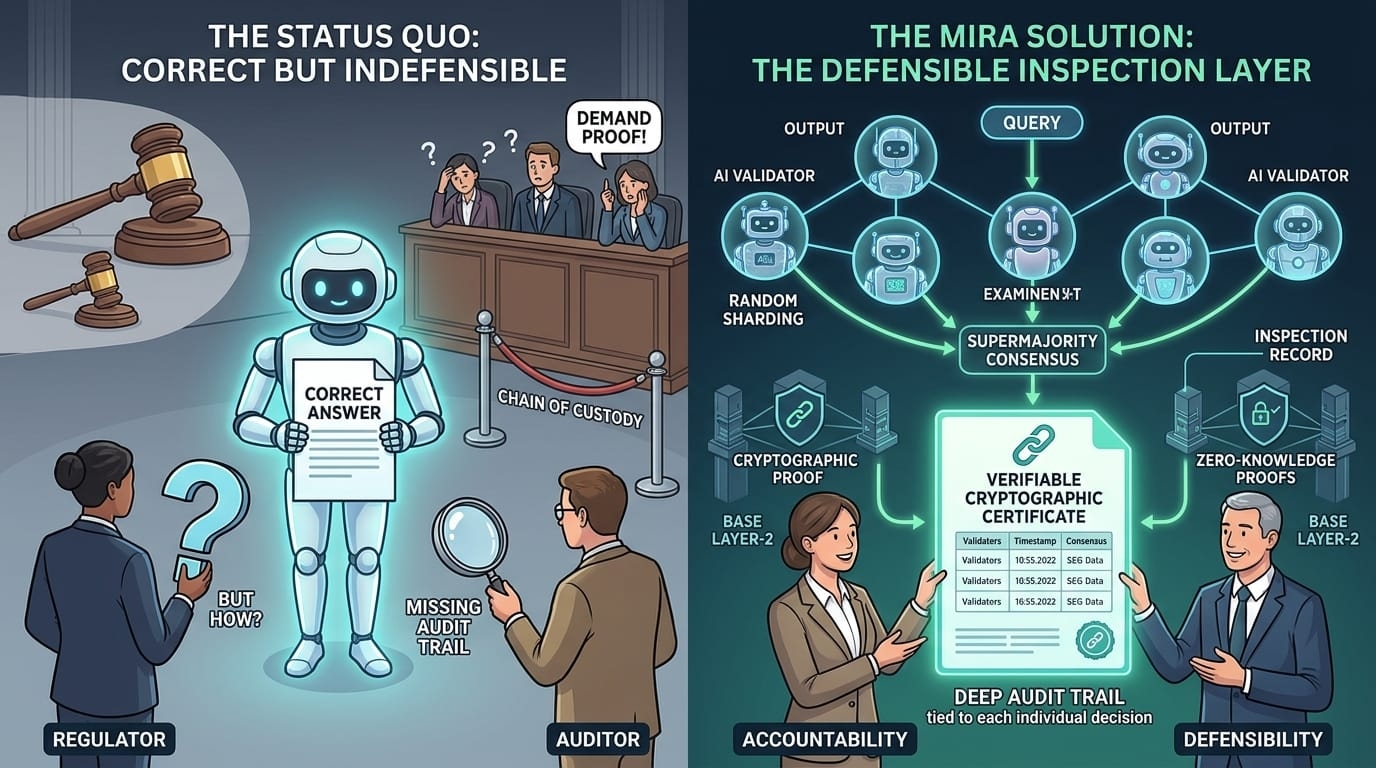

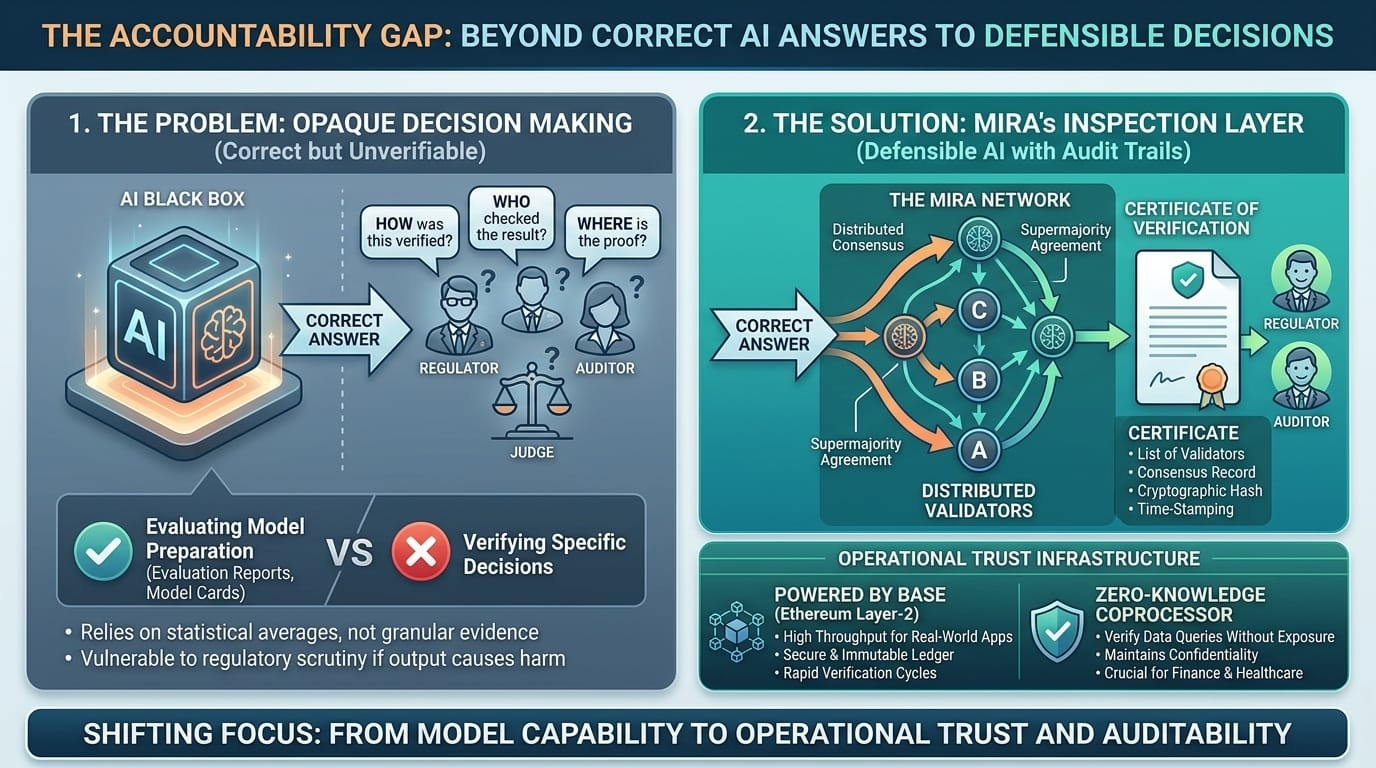

C'è una modalità di fallimento silenziosa nell'intelligenza artificiale che appare raramente in articoli di ricerca o nelle classifiche di riferimento. Non è il tipo di fallimento in cui un modello produce sciocchezze o inventa fatti. In questa situazione, il sistema funziona. La risposta è tecnicamente corretta. Il processo funziona come progettato. Eppure l'organizzazione che si è affidata all'output finisce comunque per spiegarsi ai regolatori, agli auditor o a volte anche a un tribunale.

Il problema non è l'accuratezza. Il problema è la responsabilità.

Per anni, la conversazione sull'IA si è concentrata su se i modelli possano produrre risposte corrette. Ma le istituzioni che effettivamente implementano sistemi IA stanno scoprendo che la correttezza da sola non è sufficiente. Una risposta corretta senza un processo verificabile dietro di essa è comunque difficile da difendere quando qualcosa va storto. Se una banca, un ospedale o un'agenzia governativa si affida a un output di IA, la domanda che alla fine pongono i regolatori non è semplicemente se la risposta fosse accurata. Vogliono sapere cosa è successo in quel preciso momento. Chi ha controllato il risultato. Quale validazione è avvenuta. E se c'è un documento che prova che il processo si è svolto.

Quella lacuna tra output corretto e decisione difendibile è dove entra in gioco Mira Network.

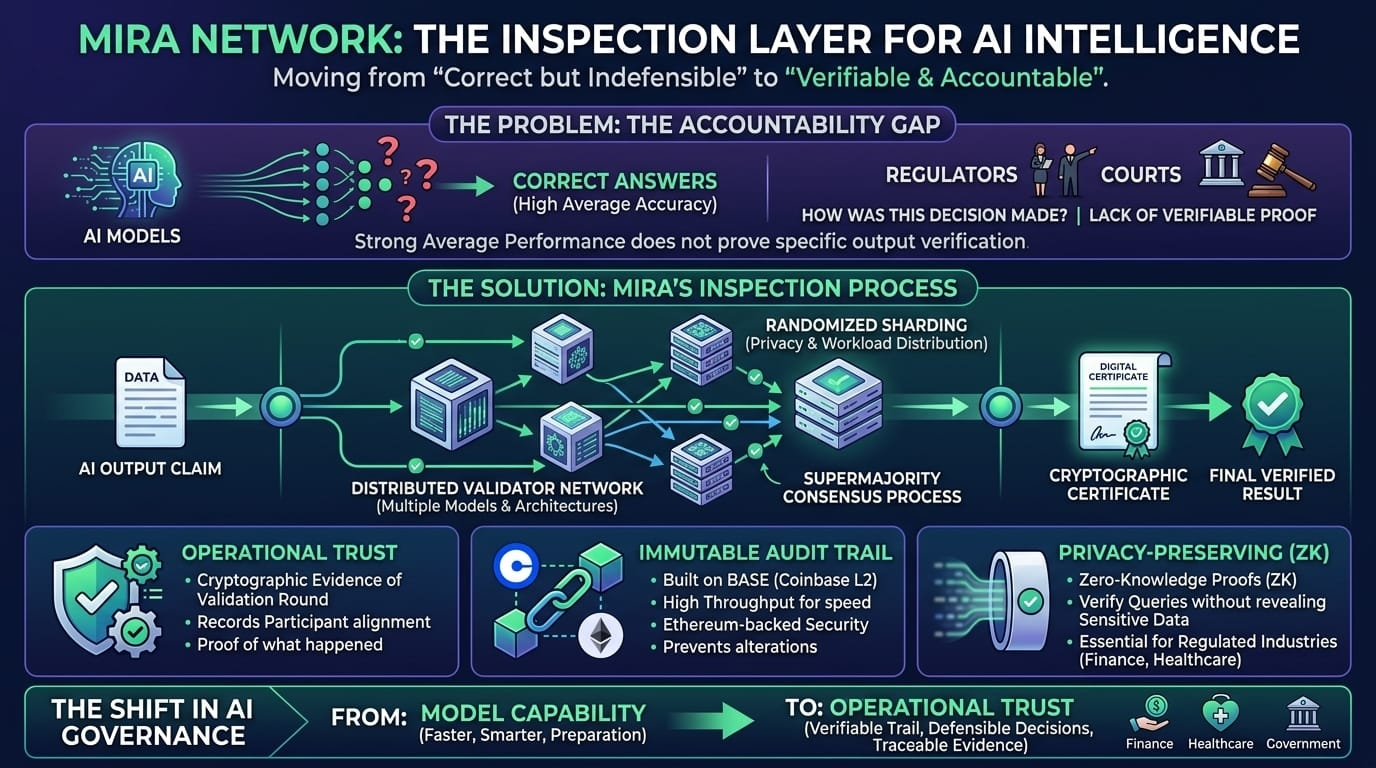

A prima vista, Mira Network sembra un altro sistema progettato per migliorare l'affidabilità dell'IA. Invece di fidarsi del giudizio di un singolo modello, instrada gli output attraverso una rete distribuita di validatori. Modelli multipli, spesso addestrati su architetture e set di dati diversi, esaminano la stessa affermazione prima che un risultato venga finalizzato. La logica è semplice: un errore che sfugge a un modello potrebbe non sopravvivere a diverse valutazioni indipendenti. In pratica, questo riduce drasticamente le allucinazioni e spinge l'affidabilità ben oltre ciò che un singolo modello può fornire da solo.

Ma l'accuratezza è solo la storia a livello superficiale.

L'idea più profonda dietro Mira non riguarda semplicemente il miglioramento delle risposte dell'IA. Si tratta di trasformare ogni output dell'IA in qualcosa di più simile a un registro di ispezione.

Per capire perché ciò sia importante, è utile osservare come altre industrie gestiscono la fiducia. Nella produzione, un'azienda non difende la qualità del prodotto dicendo che le sue macchine sono solitamente calibrate correttamente. Invece, ogni articolo che esce dalla linea di produzione può essere tracciato attraverso un processo di ispezione documentato. Se appare un difetto in un secondo momento, gli investigatori possono esaminare il registro e ricostruire esattamente cosa è successo.

I sistemi di intelligenza artificiale raramente funzionano in questo modo oggi. Quando un modello di IA genera un output, la maggior parte delle organizzazioni può solo fare riferimento a prove generali che il modello funziona bene in media. Possono avere rapporti di valutazione, schede informative del modello o documentazione di conformità che mostrano che il sistema è stato testato prima del deployment. Questi documenti provano la preparazione, ma non dimostrano che un output specifico è stato verificato prima che qualcuno agisse su di esso.

Quella differenza sta diventando sempre più importante.

I regolatori di tutto il mondo stanno cominciando a richiedere una responsabilità più granulare per il processo decisionale automatizzato. Anche i tribunali stanno iniziando a chiedere come le organizzazioni verificano gli output dell'IA prima che influenzino i risultati nel mondo reale. In molti casi, le aziende che credevano che forti metriche di prestazione media soddisfacessero i requisiti di controllo stanno scoprendo che i regolatori vogliono qualcosa di molto più concreto.

Vogliono prove legate a decisioni individuali.

Mira Network cerca di fornire quella prova trasformando la verifica dell'IA in un processo crittografico. Ogni output che passa attraverso la rete può produrre un certificato che registra cosa è successo durante il round di validazione. Il registro mostra quali validatori hanno partecipato, come si sono allineate le loro risposte e quale risultato ha raggiunto infine il consenso. Invece di fare affidamento su affermazioni statistiche sulle prestazioni del modello, il sistema genera un artefatto verificabile legato a un momento specifico nel tempo.

Le scelte architettoniche dietro Mira riflettono questo focus sulla fiducia operativa. La rete è costruita su Base, l'infrastruttura Ethereum Layer-2 di Coinbase. Questa decisione riguarda meno il branding e più la praticità. I sistemi di verifica devono operare abbastanza rapidamente da supportare applicazioni nel mondo reale, mantenendo i loro registri in un ambiente sicuro. Base fornisce il throughput necessario per cicli di verifica rapidi, mentre il modello di sicurezza di Ethereum assicura che i certificati risultanti non possano essere facilmente alterati dopo la registrazione.

Un record di verifica memorizzato su una catena fragile sconfiggerebbe l'intero scopo. Se il libro mastro sottostante può essere riorganizzato o riscritto, il registro diventa poco più di una nota temporanea piuttosto che un audit trail permanente.

Oltre il livello blockchain, Mira introduce meccanismi progettati per preservare sia affidabilità che privacy. Le richieste che entrano nel sistema sono standardizzate prima di raggiungere i validatori in modo che piccole differenze contestuali non distorcano il processo di valutazione. I compiti vengono quindi distribuiti tra i nodi utilizzando lo sharding casuale, che impedisce a qualsiasi singolo partecipante di vedere l'intero quadro mentre distribuisce anche il carico di lavoro attraverso la rete.

Quando i validatori inviano le loro valutazioni, il sistema aggrega le risposte utilizzando un processo di consenso a maggioranza qualificata. Il certificato finale rappresenta un accordo attraverso la rete piuttosto che un voto ristretto. In effetti, la rete funziona come un team di ispezione distribuito che esamina ogni affermazione generata dall'IA.

Un altro pezzo del sistema spinge silenziosamente Mira più vicino all'infrastruttura aziendale. La rete include un coprocessore a conoscenza zero progettato per verificare le query del database senza rivelare i dati sottostanti. Questa capacità è molto più importante per le istituzioni rispetto a quanto lo sia per gli sviluppatori occasionali. Le organizzazioni operanti sotto leggi sulla privacy o regole di riservatezza rigorose non possono esporre set di dati sensibili semplicemente per dimostrare che una risposta generata dall'IA era corretta. La verifica a conoscenza zero consente loro di dimostrare l'accuratezza mantenendo le informazioni originali nascoste.

Per settori come finanza, sanità e amministrazione pubblica, quella differenza può determinare se un sistema di IA è semplicemente un esperimento o qualcosa che può essere implementato su larga scala.

Tuttavia, Mira Network non rimuove ogni sfida relativa alla governance dell'IA. La verifica aggiunge un ulteriore passaggio al processo decisionale, e ciò introduce inevitabilmente un certo ritardo. In ambienti in cui i millisecondi contano, qualsiasi sistema che richiede consenso distribuito deve bilanciare velocità e affidabilità. Ci sono anche questioni legali irrisolte. Se una rete di validatori approva un output che successivamente causa danni, la questione della responsabilità non scompare semplicemente perché il processo di verifica è stato decentralizzato.

La tecnologia può imporre trasparenza, ma non può sostituire i quadri giuridici.

Anche con queste limitazioni, la direzione rappresentata da Mira riflette un cambiamento più ampio in come le istituzioni stanno cominciando ad affrontare l'intelligenza artificiale. L'era iniziale dell'adozione dell'IA si è concentrata fortemente sulla capacità del modello. Le organizzazioni volevano sistemi che fossero più intelligenti, più veloci e più accurati delle generazioni precedenti.

La prossima fase riguarda qualcosa di diverso.

Man mano che i sistemi di IA diventano più potenti, cresce il controllo attorno alle loro decisioni. Le istituzioni che vogliono fare affidamento sull'intelligenza automatizzata devono essere in grado di spiegare non solo cosa fanno i loro sistemi, ma anche come ogni output importante è stato verificato prima di influenzare un'azione.

In quell'ambiente, i vincitori non saranno necessariamente le aziende con i modelli più sicuri. Saranno quelle capaci di produrre un chiaro percorso di prove che mostri cosa è stato controllato, quando è stato controllato e come è emersa la decisione finale.

L'accuratezza può avviare la conversazione sull'intelligenza artificiale.

Ma la responsabilità è ciò che alla fine determina se qualcuno è disposto a fidarsi di esso.