@Mira - Trust Layer of AI #Mira

@Mira - Trust Layer of AI #Mira

Quando le persone parlano di migliorare l'IA, la conversazione di solito inizia con modelli più grandi, più dati di addestramento o un'inferenza più veloce. La mia prima reazione a questa impostazione è scetticismo. Non perché queste cose non contino, ma perché trascurano la questione più silenziosa sotto la maggior parte dei sistemi di IA oggi: l'interpretazione. L'IA può produrre enormi volumi di output, ma la vera domanda è se qualcuno possa fidarsi in modo affidabile di cosa significhino quegli output.

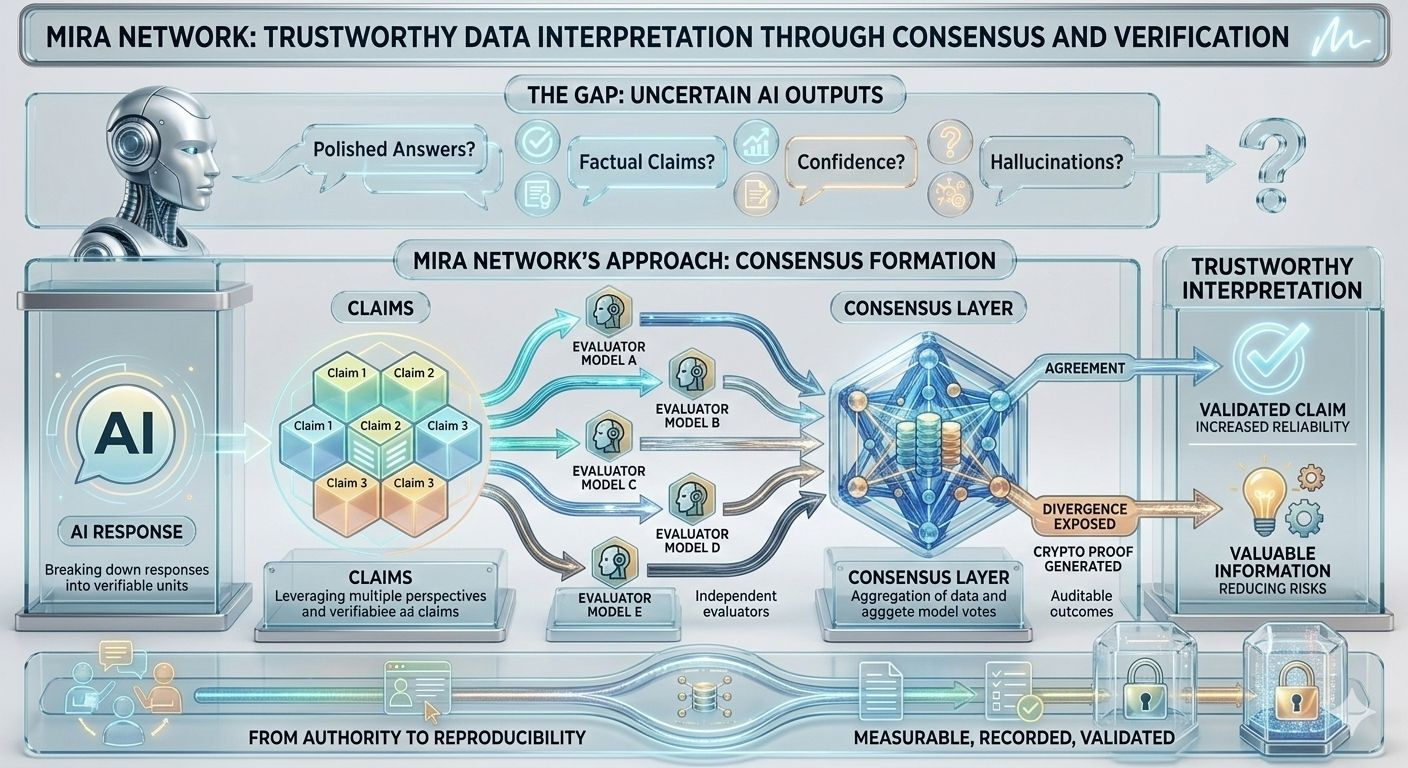

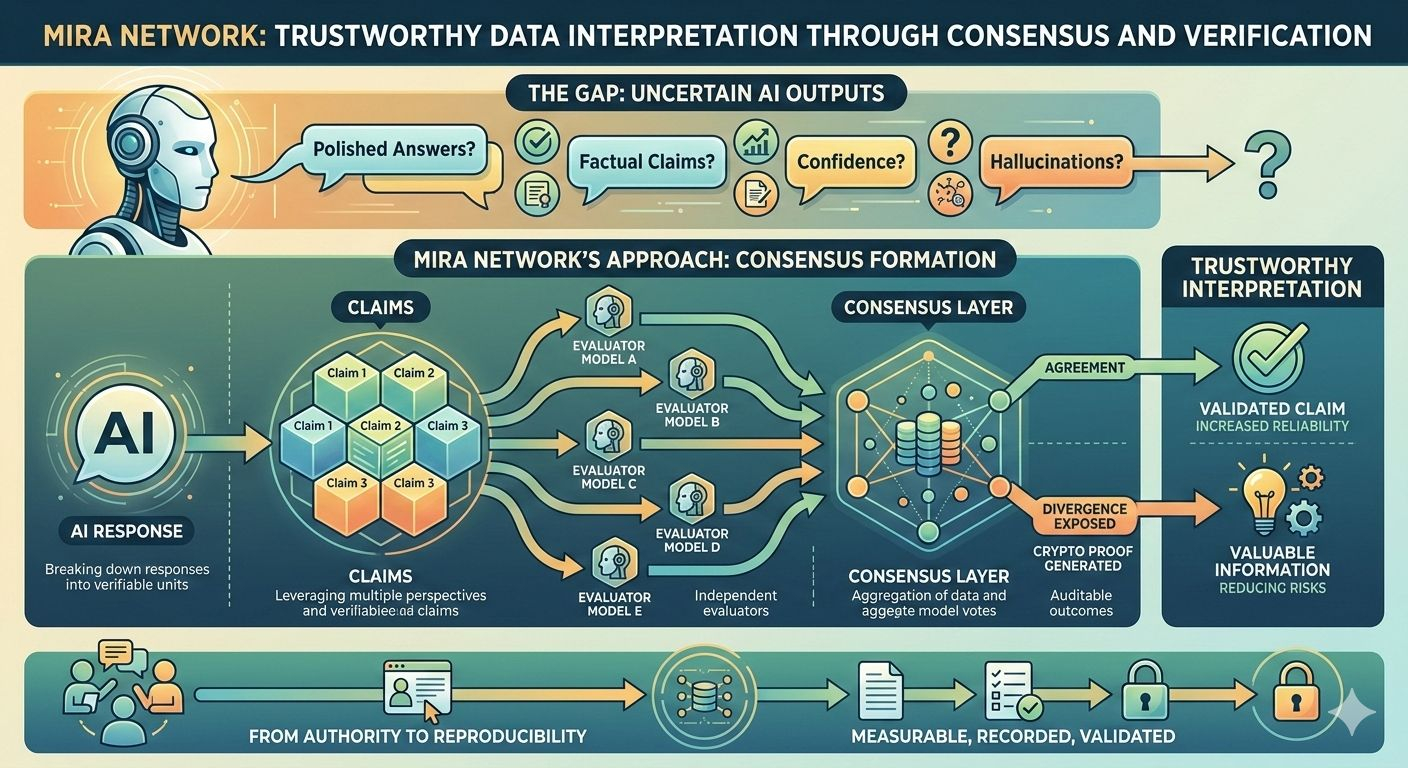

Questo è il divario che l'interpretazione affidabile cerca di colmare. La sfida non è solo che i modelli occasionalmente hallucinano; è che gli utenti raramente hanno un modo chiaro per verificare se una specifica affermazione generata da un sistema di IA debba essere creduta. Quando una risposta appare lucida e sicura, è facile dimenticare che il sistema che la produce potrebbe attingere a schemi incerti piuttosto che a fatti verificabili.

La maggior parte delle attuali implementazioni di AI tratta questa incertezza come un compromesso accettabile. Se una risposta sembra ragionevole e arriva rapidamente, il sistema è considerato efficace. Ma una volta che l'AI inizia a supportare decisioni finanziarie, operazioni automatizzate o processi di governance, "ragionevolmente" smette di essere sufficiente. L'interpretazione diventa un problema infrastrutturale piuttosto che un miglioramento cosmetico.

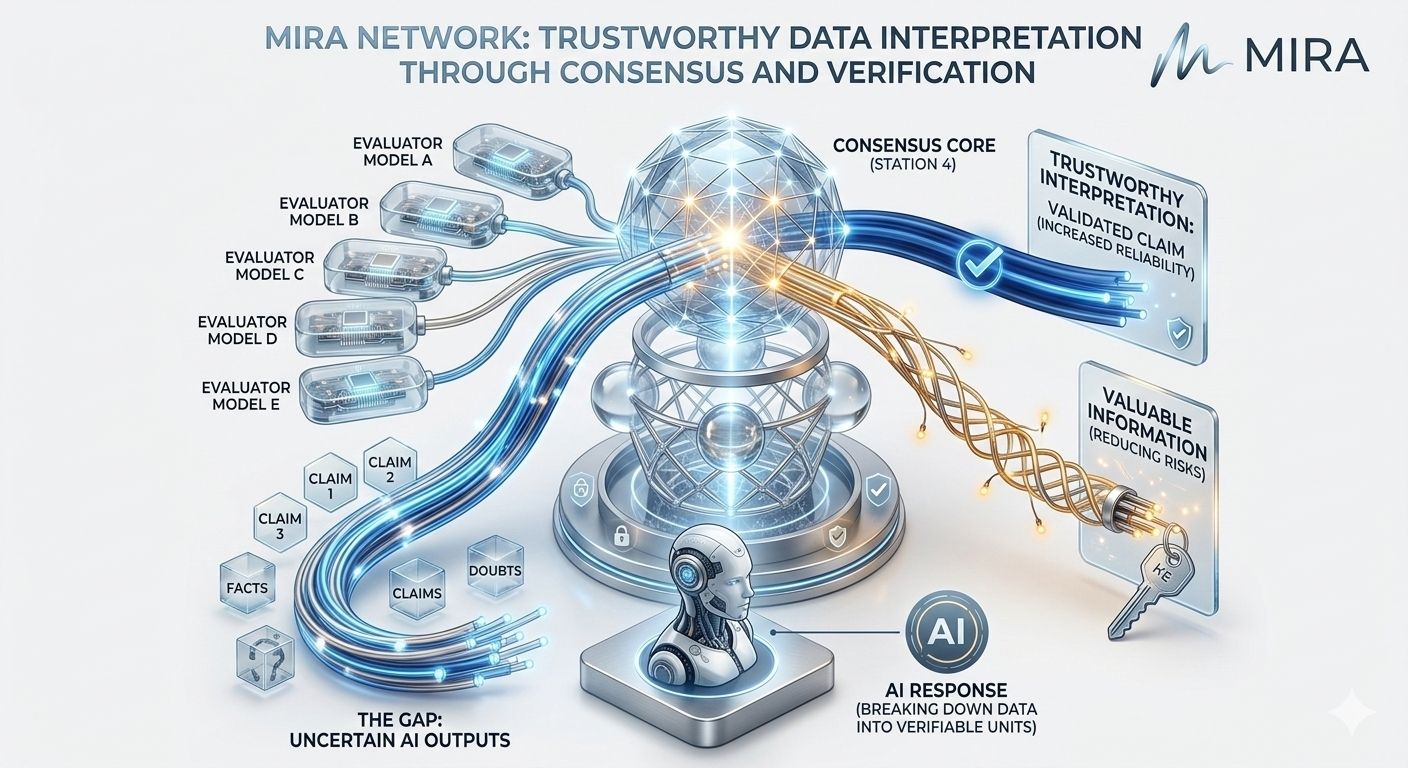

Questo è dove Mira Network introduce un approccio diverso. Invece di trattare una risposta AI come un singolo pezzo di output, il sistema la scompone in affermazioni più piccole che possono essere valutate indipendentemente. Ogni affermazione può quindi essere esaminata attraverso più modelli, consentendo alla rete di confrontare le interpretazioni piuttosto che fare affidamento su una singola fonte di ragionamento.

Una volta che ci pensi in questo modo, l'interpretazione dei dati smette di essere un compito di un solo modello e inizia a sembrare più come una formazione di consenso. Se diversi sistemi indipendenti valutano la stessa affermazione e giungono a conclusioni simili, la probabilità di affidabilità aumenta. Se le loro interpretazioni divergono, il disaccordo stesso diventa un'informazione preziosa.

Ma la parte interessante non è solo la verifica — è come il processo di verifica viene strutturato. Trasformare le affermazioni in unità verificabili significa che l'interpretazione può essere misurata, registrata e convalidata. Invece di fidarsi del punteggio di fiducia di un modello, gli utenti interagiscono con un sistema che produce una prova crittografica che più valutatori hanno esaminato le informazioni.

Certo, questo solleva un'altra domanda: chi esegue quel lavoro di valutazione? In una rete di verifica decentralizzata, il ruolo passa da un singolo fornitore di AI centralizzato a un insieme distribuito di partecipanti che eseguono modelli diversi. Ogni partecipante contribuisce all'analisi e la rete aggrega i risultati in un'interpretazione guidata dal consenso.

Quel cambiamento modifica gli incentivi attorno all'affidabilità dei dati. Nei servizi AI tradizionali, gli utenti si fidano implicitamente del fornitore che gestisce il modello. Con uno strato di verifica, la fiducia diventa distribuita tra valutatori indipendenti le cui conclusioni devono allinearsi per convalidare un'affermazione. Il sistema diventa meno un problema di autorità e più di riproducibilità.

Naturalmente, la meccanica dietro quel processo è molto importante. Le affermazioni devono essere strutturate in modo chiaro da poter essere valutate indipendentemente. I valutatori devono avere incentivi per fornire giudizi accurati piuttosto che semplicemente concordare con la maggioranza. E la rete ha bisogno di un modo per registrare i risultati in modo trasparente affinché l'interpretazione rimanga auditabile nel tempo.

Questi dettagli sono dove l'interpretazione passa dal concetto all'infrastruttura. La verifica non riguarda solo il controllo dei fatti; si tratta di progettare un sistema in cui più prospettive possano convergere su una risposta affidabile senza dipendere da un singolo custode.

C'è anche un'implicazione più ampia che spesso viene trascurata. Una volta che l'interpretazione AI diventa verificabile, apre la porta all'automazione in aree che precedentemente richiedevano supervisione umana. I sistemi autonomi potrebbero fare riferimento a affermazioni convalidate invece di output grezzi dei modelli, riducendo il rischio che un singolo allucinazione interrompa un intero flusso di lavoro.

Questo non significa che la verifica elimini completamente l'incertezza. I disaccordi tra modelli si verificheranno ancora, e la rete deve decidere come risolvere quei conflitti. Ma anche quel processo può essere prezioso perché espone l'ambiguità invece di nasconderla dietro a una singola risposta sicura.

Nel tempo, la vera misura del successo per sistemi come Mira Network non sarà semplicemente se verificano correttamente gli output AI durante condizioni normali. La vera prova arriverà quando i dati sono disordinati, i modelli discordano nettamente o gli incentivi spingono i partecipanti verso la manipolazione. L'interpretazione affidabile conta solo se continua a funzionare quando l'ambiente informativo diventa complicato.

Quindi, la domanda più importante non è se l'AI possa generare risposte più velocemente o più fluentemente. La domanda è se l'ecosistema possa costruire sistemi che interpretino quelle risposte in modi che le persone possano verificare, auditare e su cui possano fare affidamento. Perché in un mondo sempre più plasmato da decisioni automatizzate, la differenza tra informazione e interpretazione affidabile potrebbe rivelarsi il livello più importante di tutti.