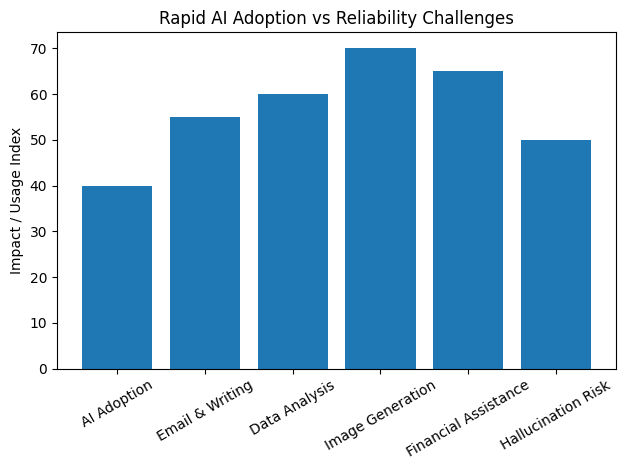

Ho pensato molto a quanto velocemente l'intelligenza artificiale stia diventando parte della vita quotidiana. Solo pochi anni fa, l'IA veniva utilizzata principalmente in laboratori di ricerca o in aziende specializzate. Oggi scrive email, analizza dati, crea immagini e aiuta persino le persone a prendere decisioni finanziarie. La velocità di questa trasformazione è incredibile. Ma più potenti diventano questi sistemi, più inizia a contare una domanda: possiamo davvero fidarci di ciò che produce l'IA?

Oggi, molti modelli di intelligenza artificiale operano utilizzando la probabilità. Analizzano enormi quantità di dati e prevedono la risposta più probabile a una domanda. Molte volte i risultati sono impressionanti e accurati. Ma a volte questi sistemi producono informazioni che semplicemente non sono corrette. Possono inventare fatti, fraintendere le fonti o creare affermazioni che suonano convincenti ma non hanno prove reali a sostenerle. Questo fenomeno è spesso chiamato allucinazione, ed è una delle più grandi limitazioni dell'IA moderna.

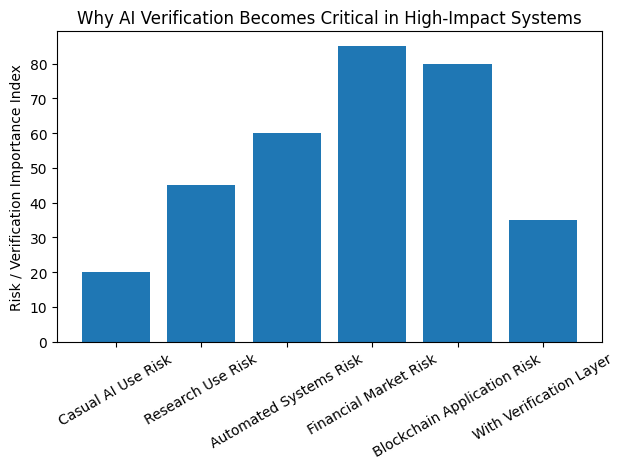

Per conversazioni casuali o compiti semplici, questi errori potrebbero non causare problemi gravi. Ma quando l'IA inizia a essere utilizzata nei mercati finanziari, nei sistemi automatizzati, negli ambienti di ricerca o nelle applicazioni blockchain, l'accuratezza diventa estremamente importante. Un'informazione errata potrebbe portare a decisioni sbagliate, perdite finanziarie o fiducia danneggiata. È per questo che la verifica sta diventando uno dei temi più importanti nel futuro dell'intelligenza artificiale.

Mira Network affronta questa sfida da una prospettiva molto interessante. Invece di cercare di competere nella corsa per costruire modelli di IA più grandi o veloci, il progetto si concentra sul rendere le uscite dell'IA affidabili e verificabili. L'obiettivo non è solo generare informazioni, ma confermare se tali informazioni sono realmente corrette.

L'idea centrale dietro Mira Network è trasformare uscite complesse dell'IA in affermazioni più piccole e verificabili. Quando un sistema di IA genera una risposta, Mira non accetta semplicemente l'uscita come un unico blocco di informazioni. Invece, il sistema separa quella risposta in più dichiarazioni individuali. Ogni dichiarazione può quindi essere esaminata e convalidata indipendentemente.

Queste affermazioni sono distribuite attraverso una rete di validatori AI indipendenti. Ogni validatore esamina le affermazioni e controlla la loro accuratezza. Poiché il processo di validazione è decentralizzato, il sistema non fa affidamento su un modello, un'azienda o un'autorità. Invece, più partecipanti contribuiscono al processo di verifica, creando un consenso su ciò che è vero e ciò che non lo è.

Questa struttura decentralizzata crea una forma di fiducia più forte. Invece di fidarsi di una sola fonte, la rete costruisce fiducia attraverso un accordo distribuito. La tecnologia blockchain aiuta a coordinare questo processo, garantendo che i risultati della verifica siano trasparenti e verificabili.

Un'altra parte importante del sistema è la struttura degli incentivi. I partecipanti che forniscono verifiche accurate vengono premiati, mentre i comportamenti disonesti o negligenti possono essere penalizzati. Questi incentivi economici aiutano a mantenere l'integrità della rete. Incoraggiano i partecipanti a contribuire con analisi oneste e dissuadono la manipolazione o la falsa validazione.

Quello che trovo particolarmente entusiasmante è come questo modello potrebbe sostenere il futuro dei sistemi autonomi. Negli anni a venire, gli agenti AI potrebbero operare direttamente nella finanza decentralizzata, nei mercati dei dati e nell'infrastruttura digitale. Questi agenti potrebbero analizzare i mercati, eseguire strategie e interagire con contratti intelligenti senza intervento umano. In un tale ambiente, le informazioni affidabili diventano essenziali.

Uno strato di verifica come Mira Network può agire come salvaguardia per questi sistemi. Confermando l'accuratezza delle uscite dell'IA prima che vengano utilizzate in processi critici, la rete può ridurre il rischio e migliorare l'affidabilità. Invece di fare affidamento su una fiducia cieca nei modelli di IA, sviluppatori e utenti ottengono accesso a intelligenza verificata.

Poiché l'intelligenza artificiale continua ad espandersi in nuove aree della tecnologia, la fiducia diventerà una delle risorse più preziose. Modelli potenti da soli non sono sufficienti. I sistemi devono anche dimostrare che le loro uscite sono corrette e affidabili. Mira Network rappresenta un tentativo di costruire quel livello di fiducia per il mondo guidato dall'IA.

Il futuro dell'IA sarà probabilmente plasmato non solo dall'innovazione nel design dei modelli, ma anche da sistemi che garantiscono trasparenza e responsabilità. Progetti che combinano intelligenza artificiale con verifica decentralizzata potrebbero svolgere un ruolo importante in quella trasformazione.

Per me, Mira Network rappresenta un primo passo verso un futuro in cui l'intelligenza non è solo potente, ma anche dimostrabile.