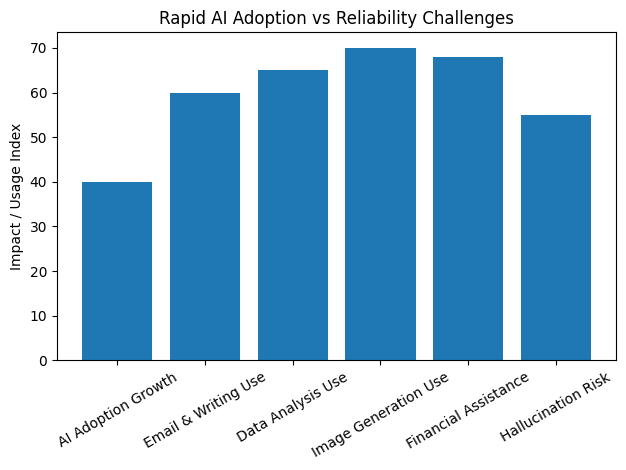

Penso spesso a quanto rapidamente l'intelligenza artificiale stia diventando parte della vita quotidiana. Solo pochi anni fa, la maggior parte delle persone sentiva parlare di IA solo nei laboratori di ricerca o nelle conferenze tecnologiche. Oggi è ovunque. Scrive email, aiuta le persone a studiare, analizza dati, crea immagini e persino assiste nella decisione finanziaria. La velocità di questo cambiamento è incredibile e ogni mese i sistemi di IA diventano più capaci di prima.

Ma man mano che questa tecnologia diventa più potente, una nuova domanda diventa più importante che mai. Possiamo davvero fidarci delle informazioni prodotte dall'IA?

La maggior parte dei modelli AI moderni funziona utilizzando la probabilità. Analizzano enormi quantità di dati e cercano di prevedere la risposta più probabile a una domanda. Molte volte queste risposte sono utili e accurate. Tuttavia, i sistemi AI a volte generano risposte che sembrano sicure ma in realtà sono incorrette. Questi errori vengono spesso chiamati allucinazioni. Il sistema può inventare fatti, fraintendere le fonti o combinare informazioni in modi che creano qualcosa che sembra vero ma non è supportato da prove.

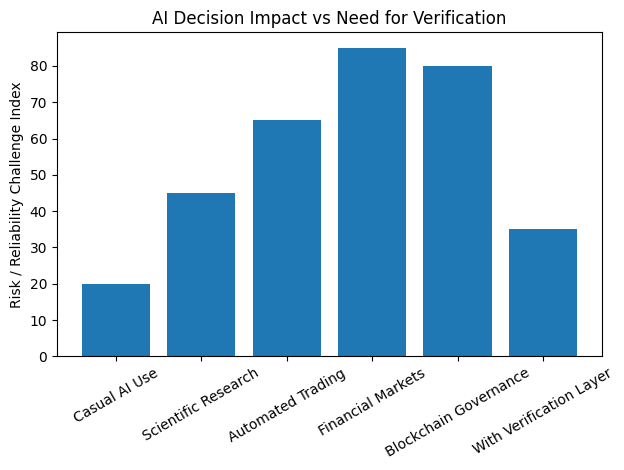

In conversazioni semplici questo potrebbe non causare seri problemi. Ma la situazione cambia quando l'AI inizia a influenzare decisioni importanti. Immagina l'AI utilizzata nei mercati finanziari, nei sistemi di trading automatizzati, nella ricerca scientifica o nella governance blockchain. In questi ambienti anche un piccolo errore potrebbe portare a grandi perdite finanziarie, strategie scadenti o fiducia danneggiata. È per questo che l'affidabilità sta diventando una delle sfide più grandi nel futuro dell'intelligenza artificiale.

Qui è dove Mira Network introduce una soluzione interessante.

Invece di concentrarsi solo sulla costruzione di modelli AI più grandi o più veloci, Mira Network si concentra su qualcosa di più profondo. Il progetto si concentra sulla verifica. Il suo obiettivo è trasformare le informazioni generate dall'AI in qualcosa che possa essere controllato, convalidato e di cui ci si possa fidare.

Il modo in cui Mira Network affronta questo problema è piuttosto innovativo. Quando un'AI produce una risposta complessa, Mira non la tratta come un'unica informazione. Invece, il sistema suddivide quell'output in affermazioni più piccole. Ognuna di queste affermazioni può quindi essere analizzata indipendentemente.

Queste affermazioni sono distribuite attraverso una rete di validatori indipendenti. Ogni validaatore esamina l'affermazione e determina se l'informazione è accurata. Poiché molti validatori partecipano a questo processo, il risultato finale si basa sul consenso piuttosto che sulla fiducia in un modello o in un'azienda. Questa struttura decentralizzata aiuta a ridurre il bias e migliora l'affidabilità.

La tecnologia blockchain gioca anche un ruolo importante in questo processo. Consente di registrare i risultati della verifica in modo trasparente e crea una storia verificabile di come le informazioni siano state convalidate. Questa trasparenza aiuta a costruire fiducia tra sviluppatori, utenti e sistemi che si basano sui dati.

Un altro elemento importante è il meccanismo di incentivazione. I validatori che forniscono analisi accurate vengono ricompensati, mentre comportamenti disonesti possono portare a sanzioni. Questo incoraggia i partecipanti a contribuire onestamente e rafforza l'affidabilità della rete.

Ciò che rende questo concetto entusiasmante è come potrebbe supportare il futuro dei sistemi digitali autonomi. Negli anni a venire, gli agenti AI potrebbero interagire direttamente con piattaforme di finanza decentralizzata, contratti intelligenti ed economie digitali. Potrebbero gestire liquidità, analizzare i mercati o eseguire strategie automatizzate. In un tale ambiente, informazioni affidabili diventano estremamente importanti.

Uno strato di verifica come Mira Network potrebbe fungere da sistema protettivo per questi agenti intelligenti. Verificando gli output dell'AI prima che vengano utilizzati in decisioni critiche, la rete può aiutare a ridurre il rischio e migliorare la fiducia nei sistemi automatizzati.

Man mano che l'intelligenza artificiale continua ad espandersi in più aree della tecnologia, la fiducia diventerà una delle risorse più preziose. Algoritmi potenti da soli non sono sufficienti. I sistemi che avranno successo a lungo termine saranno quelli in grado di dimostrare che le loro informazioni sono accurate e affidabili.

Mira Network rappresenta un primo passo verso quel futuro. Mostra che la prossima fase dello sviluppo dell'AI potrebbe non riguardare solo la creazione di modelli più intelligenti, ma anche la costruzione di sistemi che rendono l'intelligenza verificabile.

Se l'intelligenza artificiale è il motore che guida il futuro digitale, allora la verifica potrebbe diventare il sistema di sicurezza che mantiene quel motore in funzione in modo affidabile.

\u003ct-46/\u003e \u003cc-48/\u003e \u003cm-50/\u003e